Reproduzierbarer Benchmark: Qwen Image 2512 vs SDXL vs FLUX für Text-in-Image

Hallo, alle zusammen. Ich bin Dora. In letzter Zeit führe ich Text-Rendering-Benchmarks durch und stelle Qwen Image 2512, SDXL und FLUX gegeneinander an. Ich habe die letzten drei Wochen damit verbracht, Text-in-Image-Generierung zu testen, weil ich immer wieder Aussagen sah wie “dieses Modell löst Text-Rendering endlich.” Die Aussagen wirkten laut. Der Beweis wirkte dünn.

Also habe ich einen reproduzierbaren Benchmark mit Qwen Image 2512, SDXL und FLUX erstellt – drei Modelle, die die Leute ständig vergleichen. Ich wollte sehen, was tatsächlich passiert, wenn man sie bittet, Plakate, Menüs und gemischte Layouts zu rendern. Nicht sorgfältig ausgewählte Beispiele. Nicht Marketing-Screenshots. Nur konsistente Tests über identische Prompts.

Warum reproduzierbare Benchmarks wichtig sind

Die meisten Vergleiche, die ich gesehen habe, zeigen einzelne Beispiele. Ein wunderschönes Plakat von Modell A, ein kaputtes Schild von Modell B. Das sagt dir, dass etwas einmal passiert ist – nicht, was zuverlässig passiert.

Ich musste die Kompromisse verstehen. Wo hat SDXL Schwächen? Wo glänzt FLUX? Was liefert Qwen Image 2512 tatsächlich, wenn man es mit langem Text oder komplexen Layouts herausfordert?

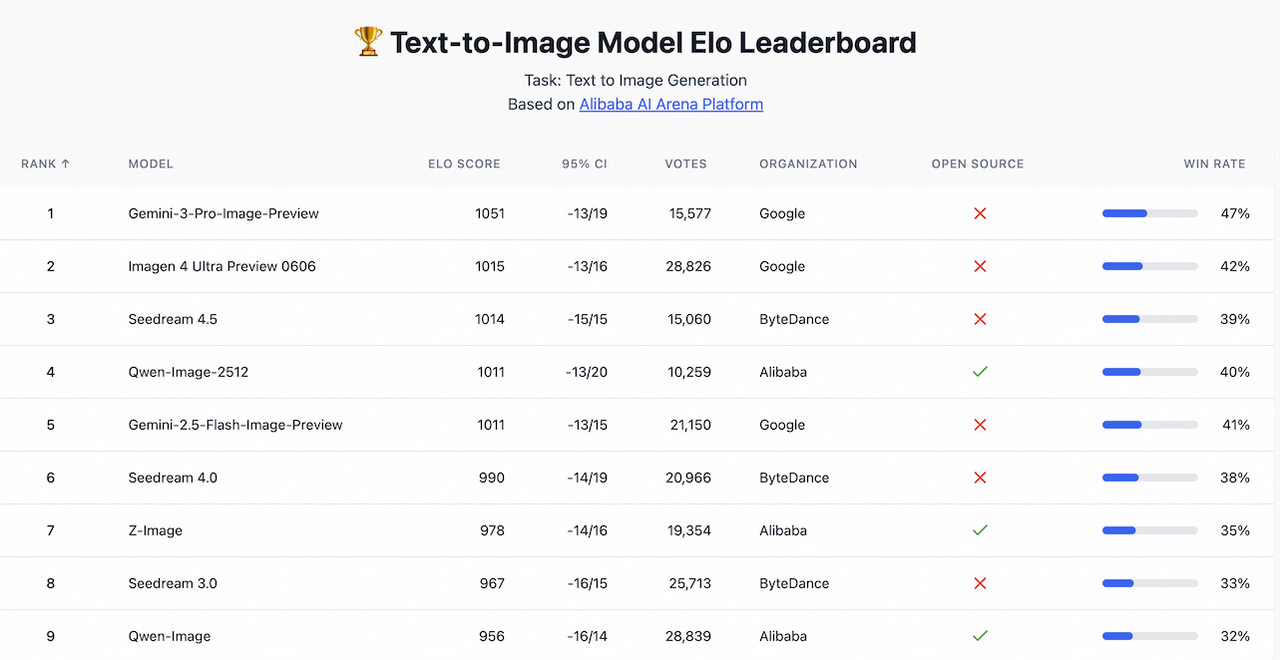

Nach Hugging Face’s Modell-Dokumentation verbessert Qwen Image 2512 die Genauigkeit der Textdarstellung und die Layoutqualität, mit über 10.000 Runden verblindeter Bewertungen, die es als führendes Open-Source-Modell zeigen. Unterdessen fanden Community-Tests heraus, dass FLUX Text-Rendering gegenüber SDXL eindeutig gewinnt, wobei es in jedem Testbild korrekten Text generiert, während SDXL kämpft.

Aber diese Bewertungen beantworteten meine spezifische Frage nicht: Was passiert mit Plakat-Layouts versus Menü-Text versus Thumbnail-Grafiken?

Aber diese Bewertungen beantworteten meine spezifische Frage nicht: Was passiert mit Plakat-Layouts versus Menü-Text versus Thumbnail-Grafiken?

Benchmark-Setup

Ich testete alle drei Modelle mit derselben Hardware – eine NVIDIA RTX 4090 mit 24 GB VRAM. Jedes Modell lief mit seinen empfohlenen Einstellungen, um unfaire Benachteiligungen zu vermeiden.

Gleicher Prompt-Satz über alle Modelle hinweg

Insgesamt zwanzig Prompts, organisiert in vier Kategorien. Jeder Prompt spezifizierte exakte Textinhalte, Layout-Anforderungen und visuellen Stil. Ich führte jeden Prompt dreimal pro Modell aus, um Inkonsistenzen zu erfassen.

Ich verwendete keine negativen Prompts für FLUX, da FLUX Flow Matching anstelle von klassifizierer-freier Anleitung nutzt, was bedeutet, dass es keine negative Konditionierung unterstützt. Um Vergleiche fair zu halten, verzichtete ich bei allen Modellen auf negative Prompts.

Gleiche Seitenverhältnisse und Parameter

Jeder Test verwendete 1024×1024 Auflösung.

- SDXL lief mit 30 Schritten und CFG-Skala 7

- FLUX Dev verwendete 20 Schritte mit Guidance-Skala 5

- Qwen Image 2512 lief mit 28 Schritten und Guidance-Skala 5, was Community-Tests zufolge Qualität und Prompt-Einhaltung ausgleicht

Die Generierungszeiten variierten erheblich. SDXL brauchte etwa 13 Sekunden für vier Bilder, während FLUX Dev 57 Sekunden benötigte – ungefähr viermal länger. Qwen Image 2512 lag mit optimierten Einstellungen dazwischen bei etwa 5 Sekunden pro Bild.

Prompt-Set (Open Source)

Ich teile das vollständige Prompt-Set, weil Reproduzierbarkeit das Sehen der tatsächlichen Tests erfordert. Das sind nicht perfekte Prompts – das sind realistische Szenarien, die ich tatsächlich antreffe.

Um Vergleiche auf Prompt-Ebene reproduzierbarer und erweiterbar zu gestalten, testen wir auch die gleichen Prompt-Sets in verschiedenen Ausführungsumgebungen, einschließlich WaveSpeed, das eine konsistente Schnittstelle zum Ausführen mehrerer Bildmodelle mit vergleichbaren Parametern bietet.

Wie bei allen Ergebnissen hier sind Ausgaben empfindlich gegenüber Prompt-Formulierung, Schrittanzahl und Guidance-Skala – daher sollten Ergebnisse als direktional statt absolut interpretiert werden.

Plakat-Prompts (5 Beispiele)

- “Event-Plakat mit fettgedrucktem Titel ‘Summer Festival’ oben, Untertitel ‘July 15-17’ darunter, drei Aufzählungspunkte mit Aktivitäten und Fußzeilentext ‘Register at summerfest.com’”

- “Film-Plakat-Stil mit großem Text ‘THE LAST HORIZON’ zentriert, kleinerer Text ‘Coming Soon’ unten”

- “Workshop-Ankündigung mit Überschrift ‘Learn Python in 5 Days’, Datums- und Zeitangaben, Instruktor-Name, Registrierungsinformationen”

- “Konzert-Plakat mit Bandname in dekorativer Schrift, Veranstaltungsort-Details, Ticketpreise”

- “Buchcover-Layout mit Autorname, Titel in Serifenschrift, Untertitel, Verlogs-Logo”

Thumbnail-Prompts (5 Beispiele)

- “YouTube-Thumbnail mit großem Text ‘TOP 5 TIPS’ und kleinem Badge mit ‘NEW’”

- “Produkt-Thumbnail zeigt Text ‘50% OFF’ prominent mit kleinerer Bezeichnung ‘Limited Time’”

- “Kurs-Thumbnail mit Titel ‘Advanced AI’ und Schwierigkeitsanzeige ‘Expert Level’”

- “Rezept-Thumbnail mit Gerichtsnamen und ‘Ready in 30 min’ Badge”

- “Nachrichten-Thumbnail mit Schlagzeile und ‘BREAKING’ Tag”

Menü / Schild-Prompts (5 Beispiele)

- “Kaffehaus-Menütafel mit fünf Artikeln, Preisen und ‘Daily Specials’ Überschrift”

- “Restaurant-Schild mit ‘Now Open’ und Geschäftszeiten aufgelistet darunter”

- “Schaufenster-Schild mit ‘Grand Opening’ und Datuminformationen”

- “Cafe-Kreidetafel-Menü mit drei Abschnitten und dekorativen Rahmen”

- “Einzelhandelsschilder mit ‘Clearance Sale’ und Prozentrabaten”

Gemischte Content-Prompts (5 Beispiele)

- “Infografik mit Titel, drei nummerierten Schritten und Zusammenfassungs-Box”

- “Social-Media-Beitrag mit Zitat-Text über Gradient-Hintergrund überlagert”

- “Präsentations-Folie mit Aufzählungspunkten und Fußzeilentext”

- “Magazin-Layout mit Schlagzeile, Body-Text-Vorschau und Seitennummern”

- “Anzeige mit Produktname, Funktionsliste und Call-to-Action”

Bewertungs-Rubrik

Ich bewertete jede Ausgabe auf vier Dimensionen mit einer 1–5 Skala. Ich verwendete keine OCR-Automatisierung, da ich Layout-Probleme erfassen wollte, die reine Zeichenerkennung übersieht.

Text-Lesbarkeit (1–5)

Kannst du jedes Wort ohne Anstrengung lesen? Sind Zeichen korrekt geformt? Verschwimmen Buchstaben zusammen oder zeigen Artefakte?

- Bewertung 5: Jedes Zeichen ist knackig und lesbar. Keine Tippfehler, keine verschmolzenen Buchstaben, keine fehlenden Striche.

- Bewertung 3: Der meiste Text ist lesbar, zeigt aber kleinere Probleme – leichte Unschärfe, gelegentliche Zeichen-Verwechslungen.

- Bewertung 1: Text ist weitgehend unleserlich oder enthält größere Tippfehler.

Layout-Genauigkeit (1–5)

Erscheint der Text dort, wo der Prompt es spezifiziert? Werden Hierarchien respektiert – Überschriften größer als Body-Text, korrekter Abstand zwischen Elementen?

Qwen Image 2512 beeindruckte mich hier. Nach Testing-Dokumentation verbessert es Layoutqualität und multimodale Komposition, was Wiederholungsanzahlen für komplexe Designs reduziert.

Visuelle Treue (1–5)

Jenseits lesbaren Texts, sieht das Gesamtbild kohärent aus? Sind Schriftenarten kontextgerecht? Integriert sich der Text natürlich mit Hintergrund-Elementen?

Hier wurden Unterschiede offensichtlich. Manche Modelle renderten perfekten Text auf inkohärenten Hintergründen. Andere erstellten wunderschöne Bilder mit zerbrochenem Text.

Gesamte Ästhetik (1–5)

Würdest du diese Ausgabe tatsächlich verwenden? Sieht es fertig aus oder braucht es erhebliche Nachbearbeitung?

Ergebnis-Zusammenfassung

Nach 180 Gesamtgenerierungen (20 Prompts × 3 Modelle × 3 Versuche) entstanden Muster, die mich überraschten.

Wo Qwen Image 2512 gewinnt

Plakat-Layouts mit 50+ Zeichen. Wenn ich um Event-Plakate mit mehreren Textblöcken bat, positionierte Qwen Image 2512 Elemente konsistent korrekt. Text blieb knackig, auch bei längeren Strings.

Das Modell betont Text-Rendering-Qualität mit klareren Zeichen, stabiler Zeilenabstand und vorhersehbarer Ausrichtung – besonders wertvoll für Marketing-Visuals und Design-Entwürfe. Ich bemerkte das besonders bei chinesisch–englisch gemischtem Inhalt, obwohl meine Tests auf Englisch fokussierten.

Geschwindigkeit war bemerkenswert. Fünf Sekunden pro Bild bedeutete, ich konnte schnell iterieren, ohne Qualität zu verlieren. Das zählt, wenn man einen Design durch mehrere Versuche verfeinert.

Wo SDXL gewinnt

Künstlerische Stile und schnelle Iteration. Wenn Prompts Stil vor Text-Präzision betonten – “retro poster aesthetic” oder “vintage sign look” – lieferte SDXL konsistentere künstlerische Interpretation.

SDXLs Dual-Architektur-Ansatz mit Base- und Refiner-Modellen gibt ihm starke ästhetische Leistung, besonders für stilisierte Inhalte. Der Ökosystem-Vorteil zählt auch: mehr LoRAs, mehr ControlNet-Optionen, mehr Community-Ressourcen.

SDXLs Dual-Architektur-Ansatz mit Base- und Refiner-Modellen gibt ihm starke ästhetische Leistung, besonders für stilisierte Inhalte. Der Ökosystem-Vorteil zählt auch: mehr LoRAs, mehr ControlNet-Optionen, mehr Community-Ressourcen.

Generierungsgeschwindigkeit gab SDXL einen Vorteil für grobe Entwürfe. Dreizehn Sekunden für vier Bilder schlägt eine Minute warten, wenn man nur Konzepte erkundet.

Wo FLUX gewinnt

Kurzer Text mit komplexen Prompts. Für Thumbnails und einfache Schilder machte FLUX Dev selten Tippfehler. Community-Tests zeigen, dass FLUX bei Kerning, Abstand und Font-Stil-Reproduktion glänzt und knackigen Text produziert, der professionellen Typografie-Standards entspricht.

Der T5-Encoder scheint einen Unterschied zu machen. FLUX verwendet T5-Technologie von Googles Sprachmodellen, was das Verständnis komplexer Prompts und Text-Rendering-Qualität verbessert.

Aber FLUX kämpfte mit längeren Textblöcken. Nach etwa 30 Zeichen fiel die Genauigkeit merklich. Und unabhängiges Testing bestätigte, dass obwohl FLUX Verbesserungen gegenüber früheren Modellen zeigt, Ausgaben oft hinter den fehlerfreien Beispielen in Marketing-Materialien zurückbleiben.

Empfehlungen nach Anwendungsfall

Wenn du Plakate mit mehreren Textelementen generierst und zuverlässiges Layout brauchst: Qwen Image 2512 handhabte das besser als ich erwartet hatte. Die 28-Schritt-Generierung lieferte gute Qualität ohne übermäßige Wartezeiten.

Wenn du Designs prototypisierst und Stil wichtiger als perfekter Text ist: SDXL gibt dir Geschwindigkeit plus künstlerische Flexibilität. Du wirst Text wahrscheinlich ohnehin in der Nachbearbeitung korrigieren.

Wenn du Thumbnails oder kurze Schilder erstellst und Text-Genauigkeit kritisch ist: FLUX Dev lieferte den saubersten Kurzform-Text. Fordere es einfach nicht auf, Absätze zu rendern.

Für gemischte Workflows fand ich mich in verschiedenen Modellen für verschiedene Stufen nutzend. SDXL zum schnellen Erkunden visueller Richtungen. Qwen Image 2512, wenn Layout-Komplexität stieg. FLUX Dev, wenn finaler Text für kürzere Inhalte pixel-perfekt sein musste.

Was mich am meisten überraschte, war nicht, welches Modell insgesamt gewann – denn es gibt keinen einzelnen Gewinner. Es war die Erkenntnis, dass “Text-in-Image” nicht ein Problem ist. Es sind mindestens drei: Zeichen-Genauigkeit, Layout-Präzision und ästhetische Integration. Verschiedene Modelle lösen verschiedene Teile.

Was mich am meisten überraschte, war nicht, welches Modell insgesamt gewann – denn es gibt keinen einzelnen Gewinner. Es war die Erkenntnis, dass “Text-in-Image” nicht ein Problem ist. Es sind mindestens drei: Zeichen-Genauigkeit, Layout-Präzision und ästhetische Integration. Verschiedene Modelle lösen verschiedene Teile.

Die Benchmark-Prompts sind für alle verfügbar, die diese Erkenntnisse verifizieren oder andere Modelle testen wollen. Ich bin neugierig, ob diese Muster über verschiedene Hardware-Konfigurationen oder Prompt-Stile hinweg halten.

Hast du kürzlich Text-Rendering getestet? Welches Modell hat dich am meisten überrascht (oder am meisten frustriert)? Gerne kannst du deine Ergebnisse und Prompts in den Kommentaren teilen!