Nano Banana 2 Leak: Ein Blick auf Googles nächste Generation KI-Bildmodell

Nano Banana 2 Leak: Ein Einblick in Googles nächstgeneriatives KI-Bildmodell

Vor einigen Monaten wurde Nano Banana für die Erstellung hyperrealistischer KI-Figuren mit sammelkartenähnlicher Ästhetik bekannt. Jetzt steht es wieder im Rampenlicht – diesmal aus einem unerwarteten Grund.

Am 10. November erschien ein frühes Preview-Build von Googles nächstgenerativem Bildmodell Nano Banana 2 (NB 2.0) kurzzeitig auf der Third-Party-Plattform Media.io. Der Build wurde innerhalb weniger Stunden entfernt, aber das war lange genug, damit Screenshots und Testergebnisse weit verbreitet online zirkulierten.

Das kurzlebige Leak hat bereits intensive Diskussionen in der KI-Community ausgelöst. Was haben die Leute also tatsächlich gesehen, und wie weit verschiebt Nano Banana 2 die Grenzen der generativen Bildgebung?

Erste Eindrücke vom Leak

Benutzer, die das Modell vor seiner Entfernung testen konnten, teilten eine Reihe von beeindruckenden Beispielen. Obwohl inoffiziell, deuten diese frühen Ergebnisse auf ein Modell mit einem viel tieferen Verständnis für Licht, Material und Kontext hin.

”KI, die Physik versteht”

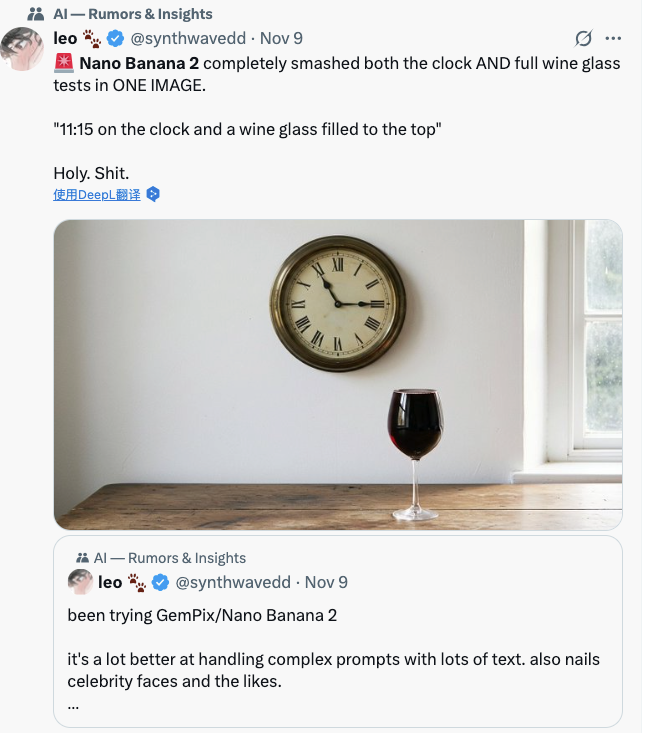

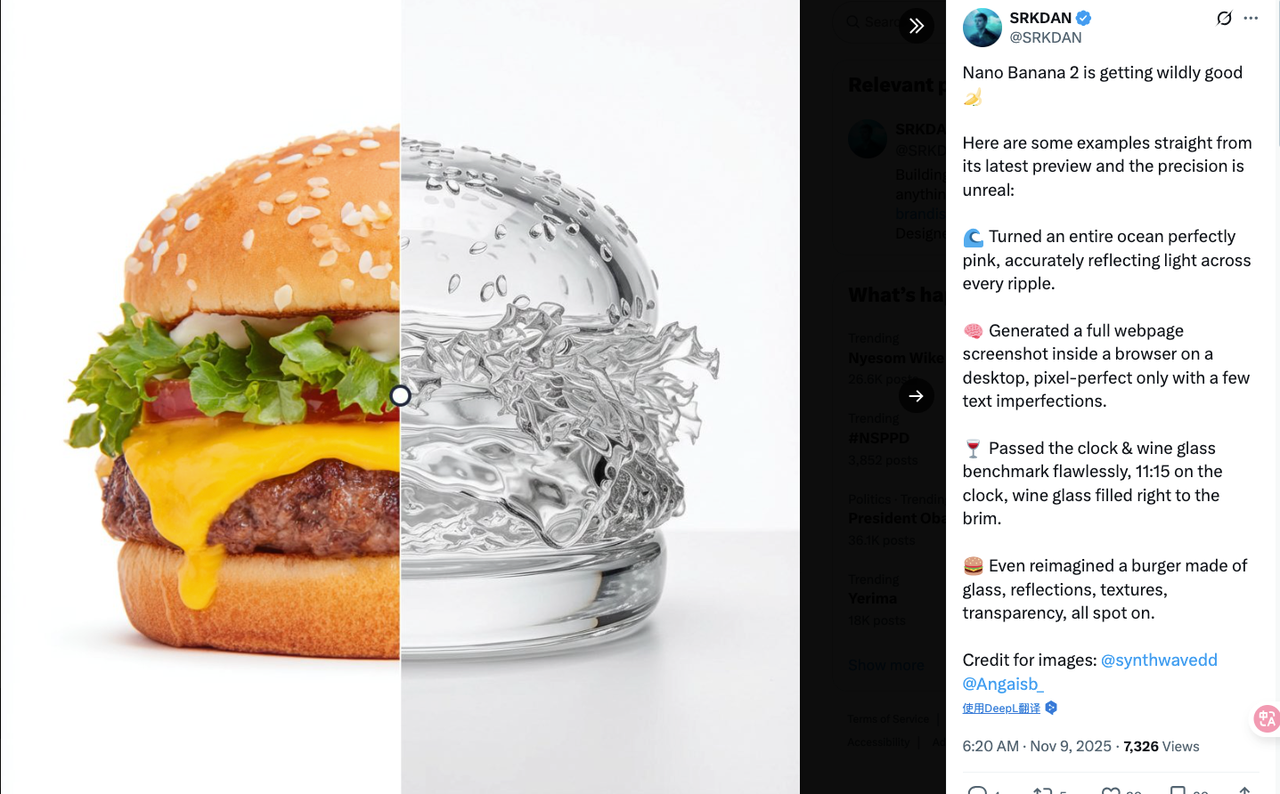

Zwei frühe Benchmarks, informell als “Wine Glass Test” und “Glass Burger Challenge” bezeichnet, zeigten, wie präzise Nano Banana 2 Transparenz und Brechung handhaben kann.

Im Weinglasbeispiel wurde berichtet, dass der Brechungswinkel des Lichts durch Glas und Flüssigkeit um weniger als drei Grad abweicht – ein beeindruckendes Maß an physikalischem Realismus für ein generatives Modell. Der “Glass Burger”-Test drückte ähnliche Grenzen, indem er Transparenz, Reflexion und realistische Oberflächentextur in einem einzigen Bild kombinierte. Ein weiteres Demo, das “Pink Ocean”, zeigte genaue Farbdiffusion und Lichtreflexion über eine stilisierte Wasseroberfläche.

Schnellere Generierung und hochwertige Textwiedergabe

Geschwindigkeit scheint eine der Stärken des Modells zu sein: Komplexe 4K-Szenen wurden angeblich in etwa 10 Sekunden gerendert.

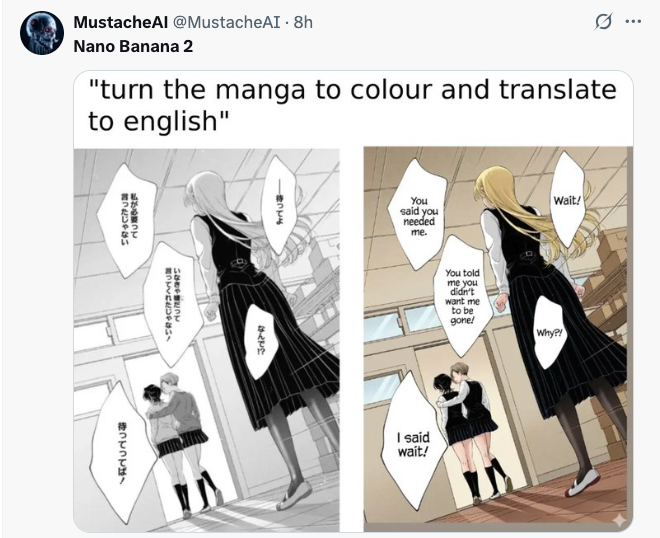

Überraschender ist die Genauigkeit der Textwiedergabe. Frühe Tester behaupten, dass Nano Banana 2 vollständige UI-Mockups generieren kann, komplett mit lesbaren Menüs, URLs und sogar Zeitstempel-Overlays – Aufgaben, die für diffusionsbasierte Modelle traditionell eine Herausforderung darstellen.

Logische und mathematische Überlegungen

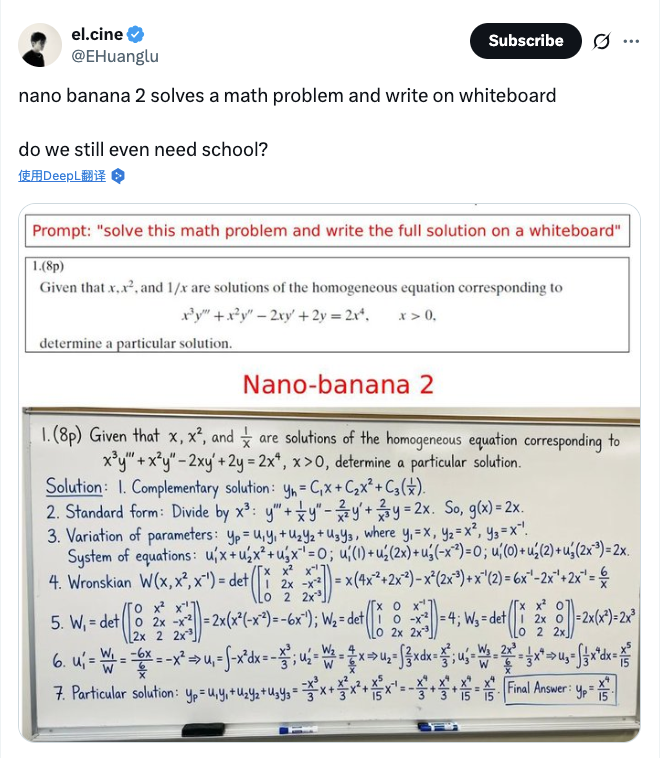

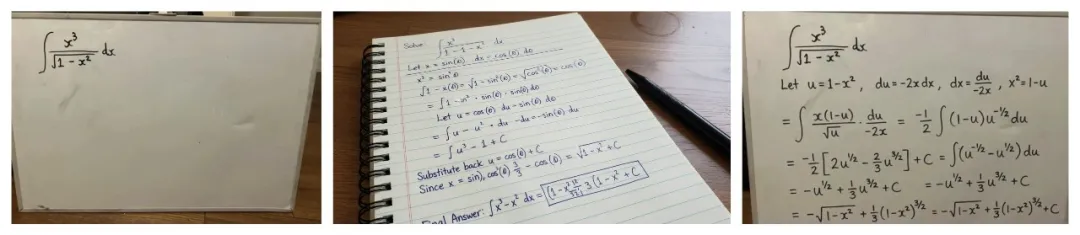

Vielleicht die interessanteste Fähigkeit, die in den durchgesickerten Tests gezeigt wurde, war visuelles Denken. Gegeben ein Foto eines handschriftlichen Mathematikproblems, konnte Nano Banana 2 nicht nur die Frage interpretieren, sondern auch eine Schritt-für-Schritt-Ableitung generieren, als würde sie auf einem digitalen Whiteboard geschrieben.

Dies deutet auf ein ganzheitlicheres multimodales Verständnis hin – die Fähigkeit, Text-, Mathematik- und Bilderkennung in einer Ausgabe zu kombinieren.

Vergleich Nano Banana 1 und 2: Von visueller Realität zu kognitiver Kohärenz

Um das Ausmaß des Upgrades zu verstehen, schauen wir uns Vergleiche nebeneinander zwischen Nano Banana (V1) und Nano Banana 2 (V2) über mehrere Kategorien an.

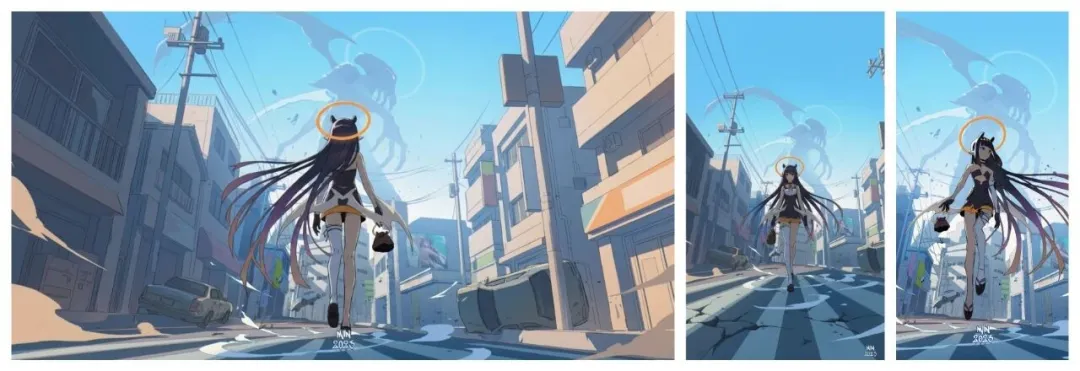

Prompt-Treue

Prompt: “Lass das Mädchen sich umdrehen.”

Während das erste Modell die Pose anpassen konnte, verlor es oft den ursprünglichen Kunststil. Im Gegensatz dazu bewahrte Nano Banana 2 die cel-shaded Ästhetik und Linienarbeit der Quelle, während die Transformation genau ausgeführt wurde. Das Ergebnis wirkt eher wie eine echte Bearbeitung als eine Neuerstellung.

Physikalische Konsistenz

Prompt: “Hat den Uhr- und Weinglas-Benchmark fehlerfrei bestanden – 11:15 auf der Uhr, Weinglas bis zum Rand gefüllt.”

V2 folgte dem Prompt fast wörtlich, mit korrekter Beleuchtung, Zeit und Reflexionen. V1 erfasste die allgemeine Szene, verfehlte aber wichtige Details – ein Zeichen für das begrenztere Szenenverständnis des älteren Modells.

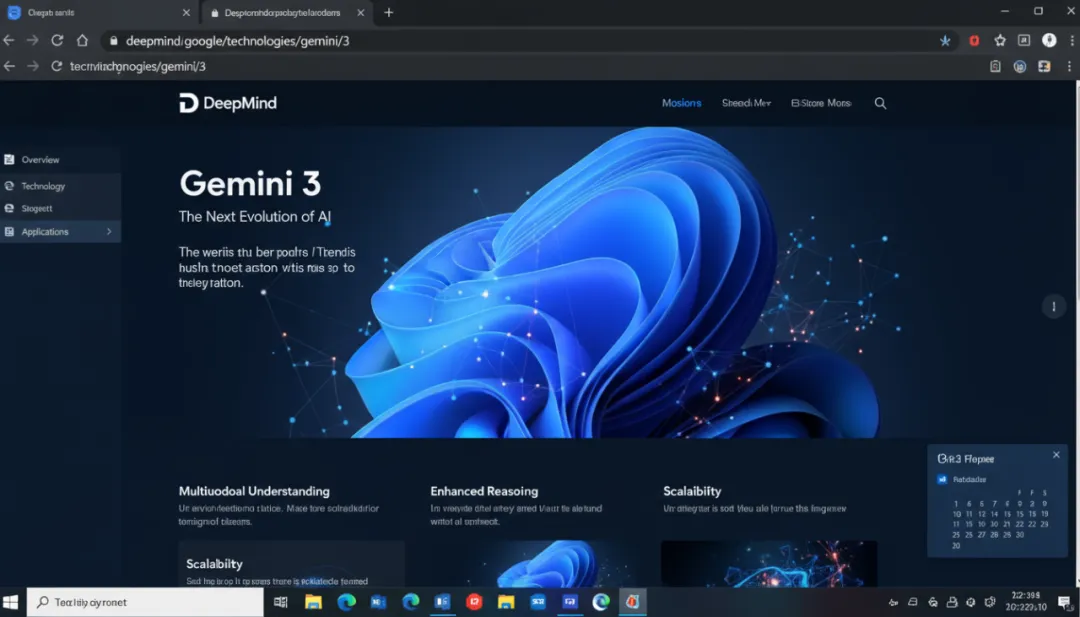

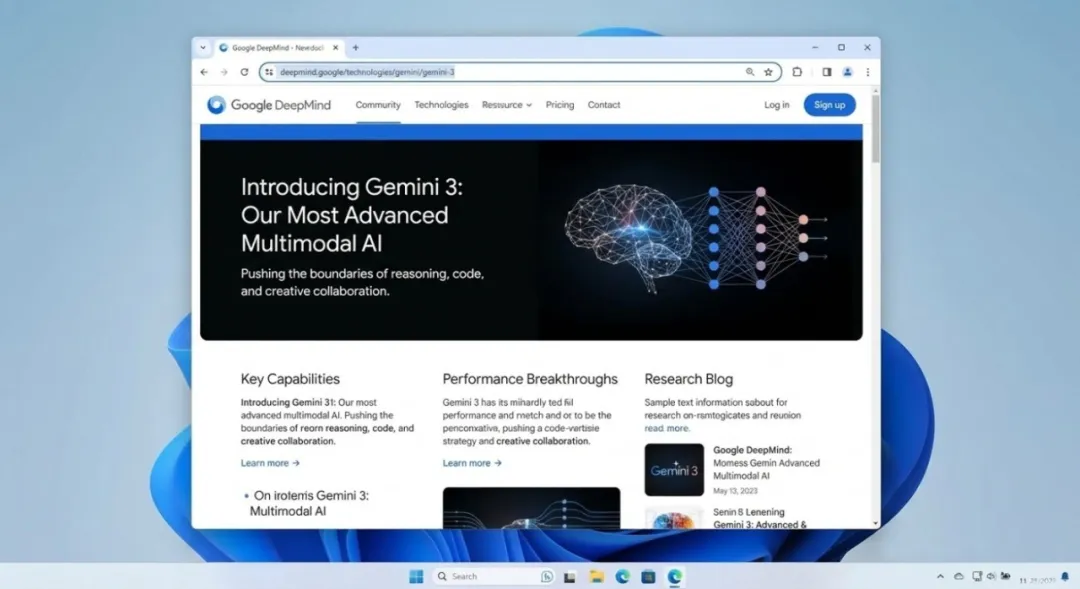

Text-Wiedergabe und UI-Simulation

Auf die Aufforderung, einen Screenshot eines Windows 11-Desktops mit der DeepMind Gemini 3-Webseite zu generieren, erstellte Nano Banana 2 ein Layout, das von einem echten Browser-Screenshot kaum zu unterscheiden ist. Der Text, die Symbole und die Oberflächenelemente waren alle scharf und lesbar.

Im Vergleich dazu renderte V1 denselben Prompt mit verzerrtem oder unlesbarem Text – eine häufige Einschränkung älterer Diffusionsmodelle.

Visuelles Denken

Prompt: “Löse diese Frage und zeige eine Schritt-für-Schritt-Ableitung.”

Hier geht die Verbesserung über die visuelle Qualität hinaus. V1s Lösung erschien logisch, war aber mathematisch falsch wegen Transkriptionsfehlern. V2 interpretierte das Problem jedoch korrekt und leitete die richtige Antwort ab – ein Einblick in echtes symbolisches Denken in einem visuellen Modell.

WaveSpeedAI bestätigt Integration

Das durchgesickerte Preview auf Media.io wurde inzwischen offiziell geschlossen, aber die zukünftige Veröffentlichung des Modells steht bereits bevor.

WaveSpeedAI hat Pläne bestätigt, Nano Banana 2 zu integrieren, sobald es öffentlich verfügbar wird. Früher Zugriff wird durch ein Whitelist-Programm zum Testen und für Feedback bereitgestellt.

In der Zwischenzeit können Benutzer immer noch Nano Banana (V1) direkt über die WaveSpeedAI-Plattform erkunden – eine gute Möglichkeit, um zu schätzen, wie weit sich das Modell entwickelt hat, bevor das V2-Debüt offiziell kommt.

Abschließende Gedanken

Falls die durchgesickerten Ergebnisse authentisch sind, stellt Nano Banana 2 mehr als nur ein inkrementelles Upgrade dar – es deutet auf eine neue Phase der KI-Bildmodellierung hin, in der visuelles Denken, Physik-Simulation und multimodales Verständnis konvergieren.

Ob die endgültige Veröffentlichung diesen frühen Eindrücken entspricht, bleibt abzuwarten, aber eines ist klar: Die nächste Generation der KI-Bildsynthese kommt schneller und intelligenter an, als jemand erwartet hat.