Wie Freepik die FLUX-Mediengenerierung mit DataCrunch und WaveSpeed auf Millionen Anfragen pro Tag skaliert

Here’s your German translation of the article:

Wie Freepik die FLUX-Mediengenerierung mit DataCrunch und WaveSpeed auf Millionen von Anfragen pro Tag skaliert hat

Zusammenfassung

Freepik arbeitet seit Anfang 2024 mit DataCrunch zusammen, um modernste Mediengenerierung in seine AI Suite zu integrieren und über Millionen von Inferenzanfragen pro Tag hinaus zu skalieren. DataCrunch hat Freepik seine hochmoderne GPU-Infrastruktur und verwaltete Inferenzdienste zur Verfügung gestellt und dabei folgende Funktionen bereitgestellt:

- Verwaltete GPU-Orchestrierung

- Elastische Skalierung und nahezu null Kaltstarts

- Hochgeschwindigkeits-Modellbereitstellung mit WaveSpeed

- Direkter Kontakt für Expertenunterstützung und strategische Zusammenarbeit Die Kunden von Freepik generieren über 60 Millionen Bilder pro Monat, wobei ein erheblicher Teil dieser Anfragen durch die DataCrunch-Infrastruktur und -Dienste ermöglicht wird.

1. Kundenprofil

Freepik ist eine führende KI-gestützte kreative Suite, die fortschrittliche generative KI-Tools mit über 250 Millionen kuratierten Stock-Assets kombiniert, um die Erstellung hochwertiger Inhalte zu optimieren.

Anfang 2024 definierte Freepik sein Geschäftsmodell neu, um generative KI für die Erstellung hochwertiger Medieninhalte zu nutzen. Freepik begann seine Reise in die Bildgenerierung mit Modellen wie Stable Diffusion XL und experimentellen Endpunkten. Zum Jahr 2025 hin hat Freepik seinen Ansatz verfeinert, um Modelle wie FLUX zu übernehmen und auf produktionsreife Infrastruktur zu skalieren, während gleichzeitig eine schnell wachsende Nutzerbasis bedient wird.

Freepiks AI Suite bietet einen KI-Bildgenerator, der Modelle wie FLUX verwendet, um fotorealistische Bilder aus Textprompts (T2I) oder Bildern (I2I) zu erzeugen, und einen KI-Videogenerator, der von Modellen wie Google DeepMind Veo 2 betrieben wird, um Videos aus Text oder Bildern zu erstellen. Diese Funktionen wurden so konzipiert, dass sie intuitiv sind und gleichzeitig Stil-Anpassung und geführte Workflows priorisieren.

Freepiks AI Suite verzeichnete über:

- 80 Millionen Besucher pro Monat

- 600 Tausend abonnierte Nutzer

- 60 Millionen generierte Bilder pro Monat

Ein erheblicher Teil dieser Inferenzanfragen betrifft die FLUX-Modellsuite mit den von DataCrunch verwalteten Inferenz-Endpunkten unter Verwendung der Inferenz-Engine von WaveSpeed:

- FLUX Dev

- FLUX Tools (z.B. Inpainting)

2. Kosteneffiziente Mediengenerierung: FLUX Dev

2.1. Anfängliche Herausforderungen

Die Skalierung der Infrastruktur ist selten eine einfache Aufgabe. Die Skalierung der Infrastruktur bei gleichzeitiger Bedienung einer exponentiell wachsenden Nutzerbasis, Bewältigung täglicher Nutzungsspitzen und Optimierung von Inferenzkosten und -geschwindigkeit ist nahezu unmöglich. Da Freepik sich vorgenommen hat, ein erstklassiges Produkt und Kundenerlebnis zu schaffen, musste ihre Bildgenerierungs-Infrastruktur an der Spitze der Leistung stehen und dabei folgende Anforderungen erfüllen:

- Aufrechterhaltung einer Latenz unter 2-6 Sekunden (p50)

- Optimierung für Durchsatz/$ (Bilder pro Stunde pro Recheneinheit)

- Vermeidung wahrnehmbarer Qualitätsregressionen gegenüber der offiziellen, nicht optimierten Baseline

Um diese Anforderungen zu erfüllen, muss Freepik an der Spitze der Effizienz arbeiten, da selbst Bruchteile von Cents und eine optimalere GPU-Nutzung pro Generierung bei dieser Größenordnung erhebliche Kosteneinsparungen bedeuten würden.

2.2. Technischer Ansatz

Durch die Zusammenarbeit mit DataCrunch beim Aufbau und der Skalierung seiner Inferenz-Infrastruktur kann sich Freepik vollständig darauf konzentrieren, die Produktqualität zu verbessern und ein erstklassiges Nutzererlebnis zu bieten. DataCrunch hat Freepik außerdem ermöglicht, sich an die rasanten Fortschritte in der Bildgenerierung anzupassen. DataCrunch hat kontinuierlich direkte Kommunikation zwischen seinen Ingenieuren und Freepik bereitgestellt, was eine schnelle Zusammenarbeit und Anpassungen ermöglicht. Diese direkte Kommunikation war erforderlich, um die Größenordnung und das Wachstum zu unterstützen, die Freepik erlebt hat, und um jegliche Verzögerung oder Missverständnisse zu vermeiden.

„Der direkte Kontakt zwischen unseren Engineering-Teams ermöglicht es uns, unglaublich schnell zu arbeiten. Die Möglichkeit, jedes Modell in großem Maßstab bereitzustellen, ist genau das, was wir in dieser sich schnell entwickelnden Branche brauchen. DataCrunch ermöglicht es uns, benutzerdefinierte Modelle schnell und mühelos bereitzustellen.” – Iván de Prado, Head of AI bei Freepik

Als Ergebnis hat Freepik von einer kosteneffizienten Modellbereitstellung in seiner AI Suite profitiert und dabei die Zielwerte für Durchsatz/$ und Latenz erreicht. Unsere Bemühungen bei DataCrunch waren darauf ausgerichtet, die Falle „Inferenzgeschwindigkeit um jeden Preis” zu vermeiden, die normalerweise mit Kompromissen wie Ausgabe-Degradation und instabiler Skalierung einhergeht. Um dies zu erreichen, führten wir eingehende Forschungen zu verlustfreien Optimierungen durch, die die Modellfähigkeiten erhalten, gefolgt von strenger Evaluierung:

- Multi-Metrik-Evaluierung: Verwendung der Kombination aus DreamSim, FID, CLIP, ImageReward und Aesthetic

- Menschliche Evaluierung: Freepik führte umfangreiche Bewertungen über A/B-Arenen durch, im Vergleich zur Baseline und anderen Inferenz-Anbietern.

- Prompt-Diversität: Bewertung verschiedener Prompt-Kategorien mit Fokus auf Objekte, Szenen und abstrakte Konzepte.

Ab 2025 hat uns die DataCrunch-WaveSpeed HW-SW Co-Design-Forschung ermöglicht, die maximale praktische Inferenzeffizienz, die Freepik angeboten wird, weiter zu steigern, während die Kernstärken jeder Organisation genutzt werden:

- Die DataCrunch GPU-Infrastruktur und Serverless Container mit Auto-Skalierung auf internem Kubernetes-Cluster, Hochdurchsatz-Netzwerk und niedrig-latenter Objektspeicherung.

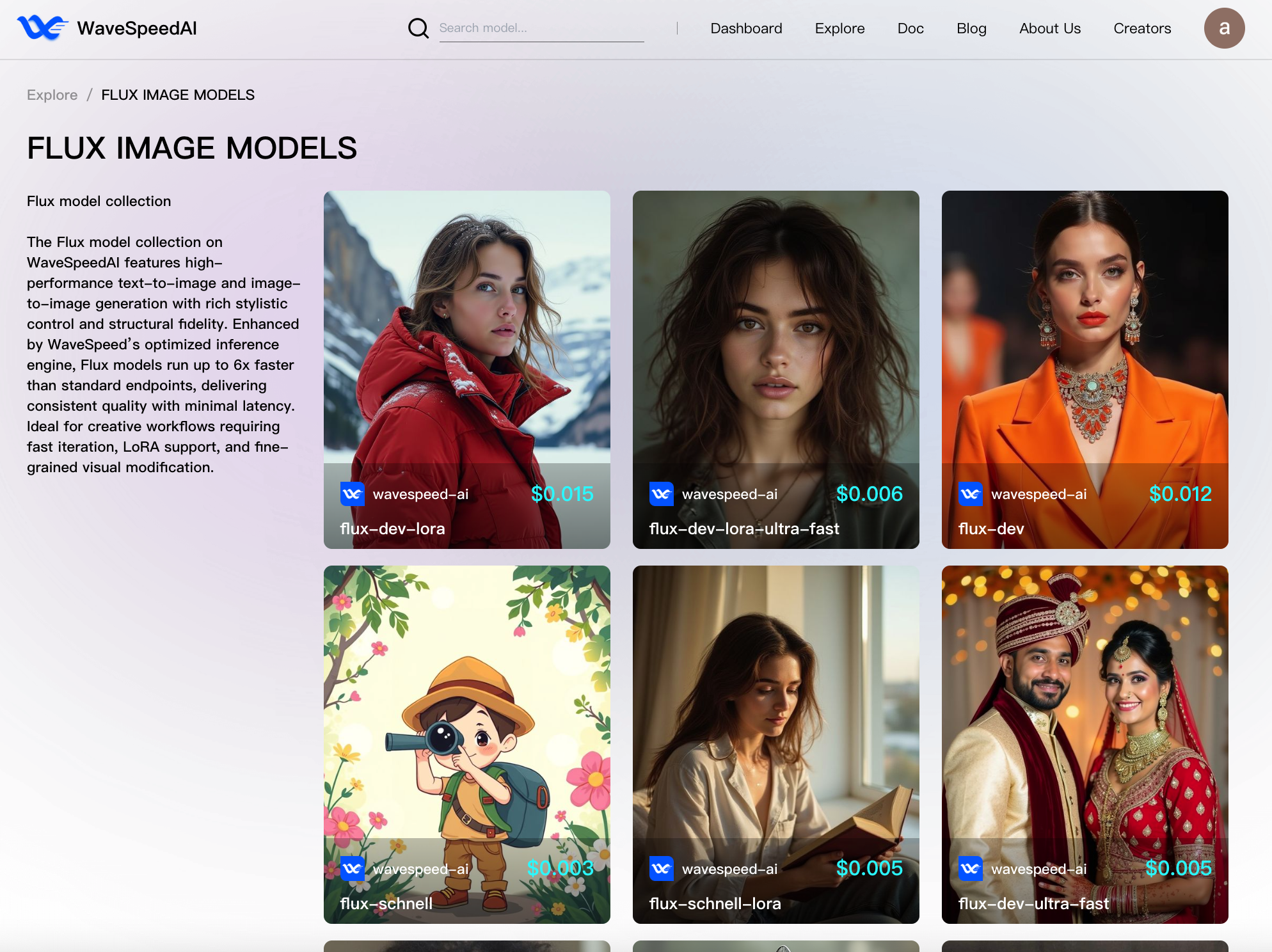

- Die WaveSpeed Inferenz-Engine mit einem hauseigenen ML-Compiler, individuell abgestimmten und fusionierten CUDA-Kernels, fortgeschrittener verlustfreier Quantisierung, DiT-Aktivierungs-Caching (z.B. AdaCache) und leichtgewichtigen Inferenz-Servern mit vernachlässigbarem Overhead.

3. Inferenz-Benchmarking: Methodik & Ergebnisse

Wichtige Metriken: Durchschnittliche Inferenzzeit und Latenz (p99), Kosten pro Generierung und Durchsatz pro Stunde.

Alle folgenden Ergebnisse wurden mit einer Weltgröße von 1 Gerät erreicht. Die Optimierung jedes Endpunkts für Effizienz hat es uns ermöglicht, verfügbare Ressourcen dynamisch basierend auf dem Traffic von Freepik zu einem bestimmten Zeitpunkt und den Anforderungen (z.B. Nutzer-Tiers) zuzuweisen.

| Endpunkt | Eingabeparameter | GPU-Inferenzzeit (Sek.) | Durchsatz pro GPU/h |

|---|---|---|---|

| flux-dev | Größe = 1024x1024, Schritte = 28, optionaler Cache = 0.1 | 4.4 | 818.2 |

| flux-dev-fast | Größe = 1024x1024, Schritte = 28, optionaler Cache = Keine | 3.3 | 1091 |

| flux-dev-fast | Größe = 1024x1024, Schritte = 28, optionaler Cache = 0.1 | 2.2 | 1636 |

| flux-dev-fast | Größe = 1024x1024, Schritte = 28, optionaler Cache = Keine | 1.64 | 2184 |

| flux-dev-ultra | Größe = 1024x1024, Schritte = 28, optionaler Cache = Keine | 1.648 | 2184 |

| flux-dev-ultra | Größe = 1024x1024, Schritte = 28, optionaler Cache = 0.1 | 1.045 | 3445 |

| flux-dev-ultra | Größe = 1024x1024, Schritte = 28, optionaler Cache = 0.16 | 0.768 | 4688 |

4. Technische Lösung: Produktionsreife GPU-Infrastruktur

Die DataCrunch GPU-Infrastruktur bietet eine produktionsreife Grundlage für groß angelegte generative KI-Systeme, wobei die WaveSpeed-Optimierungs-Engine die Grenzen der Effizienz weiter verschiebt.

- Verwaltete GPU-Orchestrierung: Feinkörniges GPU-Ressourcenmanagement wird über einen internen Kubernetes-Cluster bereitgestellt, wodurch WaveSpeed die Ressourcenzuweisung für Inferenz kontrollieren kann, ohne sich um Infrastrukturmanagement kümmern oder sich in Infrastructure-as-Code vertiefen zu müssen.

- Elastische Skalierung: Die Serverless Container wurden angepasst, um automatisch von null auf über 500 GPU-Instanzen basierend auf der Anzahl eingehender Anfragen zu skalieren. Diese Fähigkeit ist entscheidend, um die täglichen Traffic-Spitzen ohne Warteschlangen oder verworfene Anfragen zu absorbieren sowie auf null zu skalieren, wenn keine Aktivität vorliegt, um unnötige Kosten zu vermeiden.

- Nahezu null Kaltstarts: Die Kaltstart-Latenz wurde durch Vorwärm-Kompilierungen, schnellere Image-Pull-Zeiten und Container-Caching erheblich reduziert, was die echte Lambda-Leistung für GPU-Workloads annähert.

- Hochgeschwindigkeits-Modellbereitstellung: Optimierte Speicher- und Netzwerk-Fabrics haben die Zeit zum Laden der Modellgewichte und zum Pullen der Docker-Images erheblich reduziert. Dies ist besonders wichtig für FLUX LoRA-Deployments, da die LoRA-Gewichte gecacht und zu jeder GPU-Instanz verschoben werden müssen. Darüber hinaus erhöht das DataCrunch Shared Filesystem die Modellbereitstellungsgeschwindigkeit weiter und reduziert die Datenübertragungsoverheads, indem es mehreren Instanzen ermöglicht, auf dasselbe zentralisierte Datei-Repository zu lesen und zu schreiben.

5. Geschäftsergebnisse: Kosteneinsparungen & strategische Vorteile

DataCrunch hat in Zusammenarbeit mit WaveSpeed Freepik ermöglicht, die Bildgenerierung mit den FLUX Dev-Modellen zu skalieren und gleichzeitig die Inferenzkosten zu minimieren. Zusätzlich zu direkten Kosteneinsparungen hat die strategische Partnerschaft einem großen Teil der Freepik-Nutzer ermöglicht, auf die FLUX-Modelle mit höheren Generierungskontingenten zuzugreifen. Das DataCrunch-Team hat die Ausgabequalität streng bewertet und sichergestellt, während es heterogene Recheninfrastruktur durch Anwendung HW-bewusster Optimierungen nutzt. Eine der wichtigsten Erkenntnisse war, dass nachhaltige und skalierbare Inferenz ein Verständnis von ML-Systemen aus verschiedenen Perspektiven erfordert:

- GPU-bewusste Optimierungen (z.B. B200 benutzerdefinierte CUDA-Kernels)

- Rigorose Tests und Evaluierung

- Infrastruktur-Integration (d.h. Auto-Skalierung, null Kaltstarts, Netzwerk-Tuning) Da Freepik mit seinem neuen Enterprise-Plan höheren Traffic und höhere Inferenzvolumen anstrebt, wird DataCrunch diesen erfolgreichen Ansatz weiterhin anwenden, um kontinuierliche Skalierungsleistung zu erreichen.

6. Zukunftsprognosen: Was kommt als Nächstes für die Mediengenerierung

Die Bildgenerierung aus Textprompts oder Bild-Konditionierung ist unzureichend geworden, um der wachsenden Nachfrage nach Kontroll- und Bearbeitungsfähigkeiten in professionellen Umgebungen gerecht zu werden, wie sie von digitalen Künstlern und Werbeagenturen genutzt werden. Mit der Veröffentlichung von FLUX hat Black Forest Labs einen Riesensprung in der Bildgenerierungsqualität gemacht. Wir erwarten, dass FLUX.1 Kontext [dev] einen ähnlichen Wendepunkt für die Bildbearbeitung schaffen wird, mit Adoptionsraten, die die der FLUX-Modelle übertreffen. Geschichten wie die OpenAI 4o Bildgenerierung bestätigen, dass eine hohe Nachfrage nach Modellen mit hoher Steuerbarkeit, einfacher Konditionierung mit Eingabebildern, Charakterkonsistenz und starker Prompt-Befolgung besteht. Mit der Veröffentlichung von FLUX.1 Kontext [max] und [pro] hat Black Forest Labs demonstriert, dass sie in der Lage sind, solche Fähigkeiten zu reproduzieren und dabei kosteneffizienter zu sein. In Zukunft plant DataCrunch, über die Bildgenerierung hinaus zu gehen und sich auf End-to-End-Workflows zu konzentrieren. Laufende Forschungs- und Entwicklungsprojekte haben sich auf Folgendes konzentriert:

- Skalierbare und kosteneffektive Integration modernster Videogenerierung mit Modellen wie Alibaba WAN 2.1 und VACE

- Bild- und Video-Upscaling-Modelle

- Reduzierung der Komplexität beim Aufbau agentischer Medienprodukte

- Veröffentlichung von FLUX Dev (Basismodell, LoRA, Tools) Inferenz-Endpunkten in der DataCrunch Cloud Platform – bleiben Sie dran

Probieren Sie FLUX Dev und weitere Modelle jetzt aus!

🔗FLUX-dev

🔗FLUX-dev-ultra-fast

🔗FLUX-dev-lora

🔗FLUX-Modellsammlung

🔗Wan-2.1-14b-vace

🔗Seedance 1.0