Zugriff auf GLM-4.7-Flash über die WaveSpeed API

Hallo, ich bin Dora. Der Anstoß kam von einer kleinen Unannehmlichkeit: noch ein weiteres Projekt, noch ein API-Schlüssel und noch ein SDK mit seinen eigenen Vorstellungen über Token und Wiederholungsversuche. Ich wollte GLM-4.7-Flash ausprobieren, weil Leute ständig über dessen Geschwindigkeit für alltägliche Entwürfe und schnelle Recherchen sprachen. Aber ich wollte meinen Stack nicht völlig umstrukturieren, nur um ein paar Tests durchzuführen.

Also versuchte ich einen ruhigeren Weg: Zugriff auf GLM-4.7-Flash über die WaveSpeed-API. Gleiche Client-Muster, ein Schlüssel, Modell gewechselt. Ich testete dies im Januar 2026 in ein paar Skripten und machte mir Notizen. Nichts davon ist dramatisch. Aber es machte meinen Alltag ein wenig leichter. Und ehrlich gesagt, das ist jetzt die Messlatte – leichter schlägt lauter.

Warum WaveSpeed verwenden

Ich werde nicht so tun, als wäre WaveSpeed Zauberei. Es ist eher wie eine zuverlässige Schublade voller Adapter: nicht aufregend, aber das Teil, das man greift, wenn man seine Arbeit erledigen will.

Was für mich zählte, war nicht die Modellanzahl, sondern das Fehlen von Reibung. Ich konnte denselben Code auf verschiedene Modelle anwenden, eine Zeile wechseln und weitermachen. Das war’s, kein Drama.

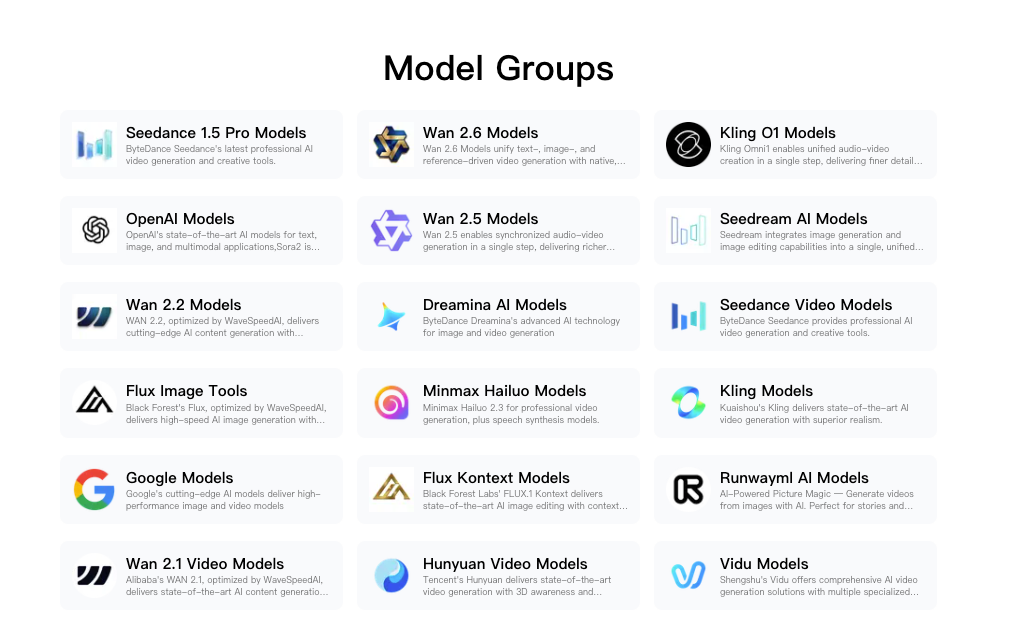

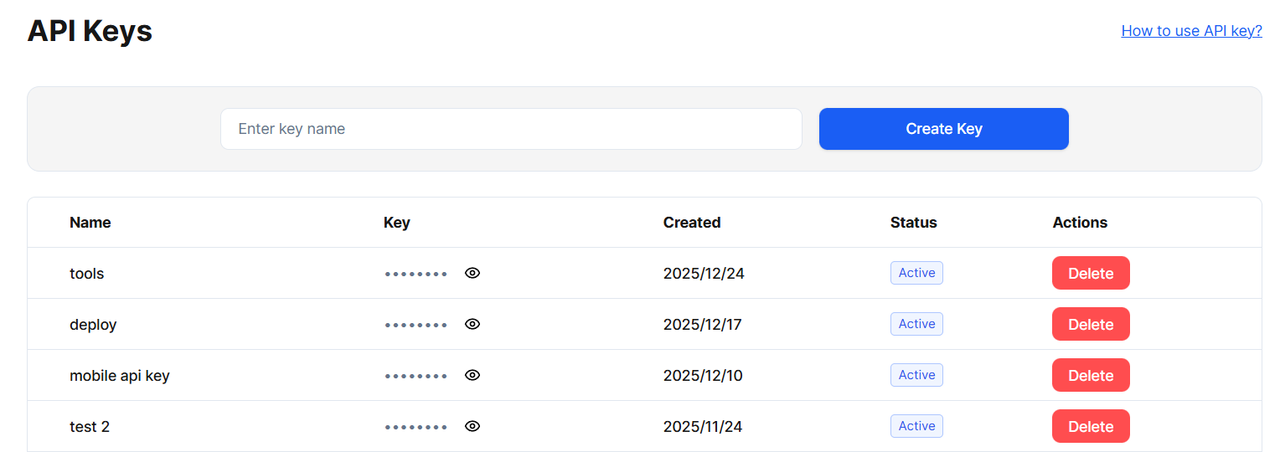

Ein API-Schlüssel, 600+ Modelle

Mein echter Gewinn war mentaler Natur. Ich durchsuche keine Provider-Dashboards, um Schlüssel zu rotieren oder Ausgaben zu begrenzen. Ein Schlüssel in meinem Secrets-Manager, und ich kann zu GLM-4.7-Flash für schnelle Entwürfe leiten, dann zu einem schwereren Modell wechseln, wenn ein Prompt mehr Tiefe braucht. Ich stelle immer noch Limits pro Projekt ein, aber der Aufwand sinkt.

Mein echter Gewinn war mentaler Natur. Ich durchsuche keine Provider-Dashboards, um Schlüssel zu rotieren oder Ausgaben zu begrenzen. Ein Schlüssel in meinem Secrets-Manager, und ich kann zu GLM-4.7-Flash für schnelle Entwürfe leiten, dann zu einem schwereren Modell wechseln, wenn ein Prompt mehr Tiefe braucht. Ich stelle immer noch Limits pro Projekt ein, aber der Aufwand sinkt.

In der Praxis: Ich behielt meine vorhandene Umgebungsvariable (WAVESPEED_API_KEY in meinem Fall) und änderte nur den Modellnamen. Diese kleine Entscheidung – Namen gleich halten, nicht clever sein – ersparte mir, meine CI zu zerstören.

Kein SDK-Wechsel

Ich blieb bei dem OpenAI-kompatiblen Client, den ich bereits nutze. Keine neuen Methodennamen, kein Neuerlernen von Streaming-Flags. Wenn Sie kleine Utilities um Chat-Completions, Streaming und Tool-Calls gebaut haben, funktionieren sie größtenteils weiterhin. Mir gefällt, dass WaveSpeed mich nicht zwingt, seine Weltsicht zu übernehmen, bevor es mir ein Token zurückgibt, falls das Sinn macht.

Zwei Vorbehalte, die ich bemerkt habe:

- Modellnamen variieren zwischen Providern. Ich überprüfe den genauen Bezeichner in der offiziellen WaveSpeed-Dokumentation, bevor ich Code commit.

- Provider-spezifische Funktionen (wie spezielle Antwortformate oder Besonderheiten bei Funktionsaufrufen) können sich dennoch unterscheiden. Behalten Sie eine kleine Adapter-Datei, in der Sie Payloads normalisieren. Meine ist 60 Zeilen und verdient jede Woche ihr Geld.

Schnellstart-Code

Ich verwendete die OpenAI-kompatiblen Endpoints, die WaveSpeed bereitstellt. Wenn Ihr Code bereits eine Chat-Completions-API aufruft, sollte sich das vertraut anfühlen. Die einzige echte Änderung ist die Basis-URL und der Modellname.

Ich testete dies vom 12. bis 15. Januar 2026 mit kleinen Batch-Prompts. Kurze Prompts begannen in weniger als einer Sekunde zu streamen, gemessen an meiner Verbindung. Natürlich werden Ihre Ergebnisse je nach Netzwerk, Prompt-Größe und Serverlast unterschiedlich sein.

Ich testete dies vom 12. bis 15. Januar 2026 mit kleinen Batch-Prompts. Kurze Prompts begannen in weniger als einer Sekunde zu streamen, gemessen an meiner Verbindung. Natürlich werden Ihre Ergebnisse je nach Netzwerk, Prompt-Größe und Serverlast unterschiedlich sein.

Drop-in-Replacement-Beispiel

Hier ist die Form, die ich verwendete. Überprüfen Sie die offizielle WaveSpeed-Dokumentation auf den neuesten Modellbezeichner (ich habe ihn als glm-4.7-flash aufgelistet gesehen).

Node.js (fetch):

const resp = await fetch("https://api.wavespeed.ai/v1/chat/completions", {

method: "POST",

headers: {

"Content-Type": "application/json",

"Authorization": `Bearer ${process.env.WAVESPEED_API_KEY}`

},

body: JSON.stringify({

model: "glm-4.7-flash",

messages: [

{ role: "system", content: "You are a concise assistant." },

{ role: "user", content: "Summarize this link in 3 bullets: https://example.com/post" }

],

temperature: 0.3,

stream: true

})

});Python (requests):

import os, requests

url = "https://api.wavespeed.ai/v1/chat/completions"

headers = {

"Authorization": f"Bearer {os.environ['WAVESPEED_API_KEY']}",

"Content-Type": "application/json",

}

payload = {

"model": "glm-4.7-flash",

"messages": [

{"role": "system", "content": "You are a concise assistant."},

{"role": "user", "content": "Outline a 5-step plan to vet a research source."}

],

"temperature": 0.2

}

r = requests.post(url, headers=headers, json=payload, timeout=30)

r.raise_for_status()

print(r.json()["choices"][0]["message"]["content"])Kleine Notizen, die ich nützlich fand:

- Wenn Ihre App Token streamt, übernehmen Sie das gleiche SSE-Parsing: WaveSpeed’s Stream-Flag verhielt sich in meinen Tests wie erwartet.

- Ich setze das Timeout pro Anfrage etwas höher als üblich, wenn ich mir nicht sicher über die Modellauslastung bin.

- Protokollieren Sie den Modellnamen in Antworten. Das zukünftige Sie wird sich bedanken, wenn die Ausgaben abweichen und Sie bestätigen müssen, was gelaufen ist.

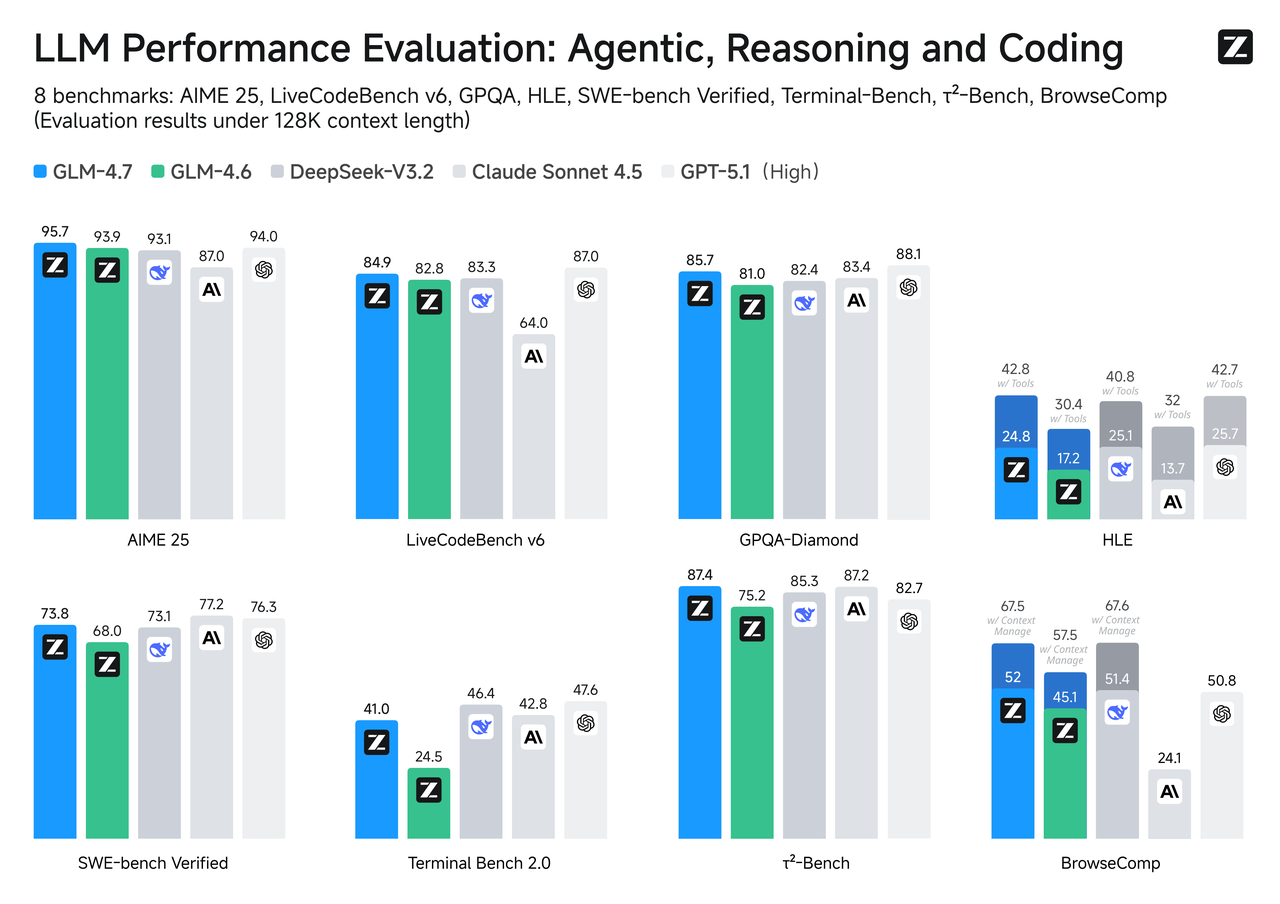

Mit anderen Modellen kombinieren

Der Großteil meiner Arbeit mischt Modelle. GLM-4.7-Flash ist schnell für erste Durchgänge, Entwürfe, Zusammenfassungen, grundlegende Fragen. Wenn ich schwerere Überlegungen brauche oder eine spezifische Funktion (wie einen starken Code-Interpreter oder ein bestimmtes Vision-Feature), leite ich anderswohin. WaveSpeed lässt mich diese Weiterleitung an einem Ort behalten.

Der Großteil meiner Arbeit mischt Modelle. GLM-4.7-Flash ist schnell für erste Durchgänge, Entwürfe, Zusammenfassungen, grundlegende Fragen. Wenn ich schwerere Überlegungen brauche oder eine spezifische Funktion (wie einen starken Code-Interpreter oder ein bestimmtes Vision-Feature), leite ich anderswohin. WaveSpeed lässt mich diese Weiterleitung an einem Ort behalten.

Was mich ein wenig überraschte: Ich erwartete, dass der Modellwechsel während der Ausführung unordentlich wirken würde. Das war nicht der Fall. Die Prompts behielten die gleiche Form, sodass ich Ausgaben vergleichen konnte, ohne den Code zu verdrehen.

Text + Bild-Workflow

Ich versuchte eine kleine Routine: einen Screenshot aus einem Benutzerbericht erfassen, leichte OCR oder eine Vision-Beschriftung durchführen, dann GLM-4.7-Flash bitten, eine Aktionszusammenfassung in verständlicher Sprache zu erstellen.

Meine Schritte:

- Verwenden Sie ein Vision-fähiges Modell, um Text/Labels aus dem Bild zu extrahieren. Halten Sie die Ausgabe kompakt, denken Sie an Schlüssel-Wert-Paare oder kurze Aufzählungen.

- Leiten Sie diesen Text mit einem stabilen System-Prompt (zwei Zeilen) an GLM-4.7-Flash weiter und bitten Sie um eine kurze Zusammenfassung mit Entscheidungen.

- Wenn das Bild Tabellen enthält, füge ich eine schnelle Regel hinzu: „Zahlen und Einheiten exakt beibehalten.” Dies reduzierte die Bereinigung später.

Feldnotizen:

- Bei einer 1,2-MB-PNG mit gemischter Benutzeroberfläche + Text dauerte der Vision-Pass für mich etwa 2–4 Sekunden: Die GLM-4.7-Flash-Zusammenfassung kam in weniger als einer Sekunde zurück. Diese Aufteilung hielt den Fluss flüssig.

- Die Kosten waren vorhersehbar, weil ich die Vision-Ausgabe auf ein paar hundert Token begrenzte, bevor ich sie weiterleitete.

- Wenn Sie keine Vision-Nuance brauchen, führen Sie zuerst grundlegende OCR durch (Tesseract oder eine bezahlte OCR-API), dann leiten Sie den Text an GLM-4.7-Flash weiter. Günstiger, oft gut genug.

Text + Video-Workflow

Video ist offensichtlich schwerer. Ich schickte kein vollständiges Video an irgendein Modell. Ich extrahierte zuerst das Transkript (Whisper oder ein bezahlter ASR), dann leitete ich Abschnitte an GLM-4.7-Flash für schnelle Zusammenfassungen weiter.

Eine Schleife, die funktionierte:

- Das Video einmal transkribieren. Wenn möglich, behalten Sie Zeitstempel bei.

- Nach Sprecherwechseln oder 3–5-Minuten-Segmenten aufteilen (was sauberer ist).

- GLM-4.7-Flash bitten, Segment-Zusammenfassungen und Entscheidungen zu treffen. Halten Sie den System-Prompt verankert: „Sie geben nur strukturierte JSON mit den Feldern A/B/C zurück.”

- Mit einem zweiten Durchgang eine übergeordnete Gliederung aus den Segmenten zusammensetzen.

In der Praxis fühlte sich GLM-4.7-Flash für die Segment-Zusammenfassungen richtig an: schnell, wenig Reibung, gute Genauigkeit für die Planung. Für die finale Gliederung wechselte ich manchmal Modelle für Ton oder Nuance. Ich hielt alles in WaveSpeed, sodass mein Code nicht seine Form änderte.

Preise

Bei den Preisen verlangsame ich mich. Nicht weil es kompliziert ist, sondern weil Überraschungen in Logs auftauchen, nicht in Dashboards.

GLM-4.7-Flash auf WaveSpeed

Ab Januar 2026 ist GLM-4.7-Flash über WaveSpeed mit seinem eigenen Pro-Token-Tarif verfügbar. Die genauen Zahlen können sich verschieben, daher werde ich sie hier nicht festhalten. Ich überprüfe die offizielle Preisseite, bevor ich etwas in die Produktion drücke, und setze Soft-Limits in meiner Env-Konfiguration.

Ab Januar 2026 ist GLM-4.7-Flash über WaveSpeed mit seinem eigenen Pro-Token-Tarif verfügbar. Die genauen Zahlen können sich verschieben, daher werde ich sie hier nicht festhalten. Ich überprüfe die offizielle Preisseite, bevor ich etwas in die Produktion drücke, und setze Soft-Limits in meiner Env-Konfiguration.

Wie ich schätze:

- Einen typischen Prompt + Antwort testen. Mit der Anzahl der täglichen Durchläufe multiplizieren. So komme ich zu täglichen Tokens.

- 20–30% Spielraum für schlechte Tage oder neue Prompts hinzufügen.

- Ein langsameres, aber billigeres Modell für die gleiche Aufgabe vergleichen. Wenn das langsamere Modell die menschliche Bearbeitungszeit nicht erhöht, könnte es insgesamt gewinnen.

Ein praktischer Trick: Token nach Feature-Flag protokollieren. Ich schalte GLM-4.7-Flash für einen Teil der Benutzer ein und vergleiche Bearbeitungszeit und Beschwerden. Das sagt mir mehr als eine Preistabelle.

Volumenrabatte

WaveSpeed bietet volumenbasierte Preisgestaltung. Die Stufen sind wichtig, wenn Sie Jobs stapeln oder Datensicherungen durchführen. Ich kontaktierte einmal den Support, um die Schwellen vor einer Spitzenwoche zu bestätigen: Die Antwort war unkompliziert und ersparte mir, Arbeit in unangenehmen Fenstern zu drosseln.

Meine Regel: Wenn ich einen 10x-Anstieg, eine Kampagne, Migration oder einen Forschungssprint erwarte, kontaktiere ich zuerst den Support. Es geht nicht um einen besonderen Deal: Es ist eine klare Obergrenze, damit ich Jobs nicht die ganze Nacht über beaufsichtige, weil niemand das will.

Wir haben WaveSpeed genau für diese Art von Workflow gebaut: weniger Schlüssel, weniger SDK-Wechsel und weniger Zeit, die man mit Infrastruktur-Überlegungen verbringt. Wenn Sie Modelle jonglieren und möchten, dass sie sich hinter einer einzigen, vorhersehbaren API verhalten, das ist das Problem, das wir lösen wollen.

➡️Sie können es hier erkunden.

Jetzt sind Sie dran: Was ist der lächerlichste API-Schlüssel-Zirkus, den Sie in letzter Zeit erlebt haben? Schreiben Sie es in die Kommentare – ich lese sie alle, während ich Kaffee schlürfe und mich ein bisschen weniger allein fühle.