GLM-4.7-Flash lokal ausführen: Ollama, Mac & Windows Setup

Hallo, ich bin Dora. Vor einigen Tagen hat mich eine kleine Ungereimtheit dazu gebracht, dies zu versuchen: Ich bin ständig auf Remote-Vervollständigungen für kleinere Entwurfstasks gewartet. Nicht Minuten, nur genug Verzögerung, dass ich zur E-Mail abgedriftet bin und den Faden verloren habe. Letzte Woche (Januar 2026) habe ich versucht, GLM-4.7-Flash lokal auszuführen, um zu sehen, ob das Einsparen dieser Sekunden mir wirklich helfen würde, klarer zu denken.

Kurzversion: Es hat geholfen, aber nicht aus den glamourösen Gründen. GLM-4.7-Flash fühlte sich mehr wie ein zuverlässiger Assistent als ein großes Modell an. Es ist schnell genug, um mich im Flow zu halten, und leicht genug, um auf einem Laptop zu laufen, ohne ihn zum Glühen zu bringen. Ich werde teilen, was funktioniert hat, wo es steckengeblieben ist, und die Einrichtung, die die Dinge auf gute Weise langweilig gemacht hat.

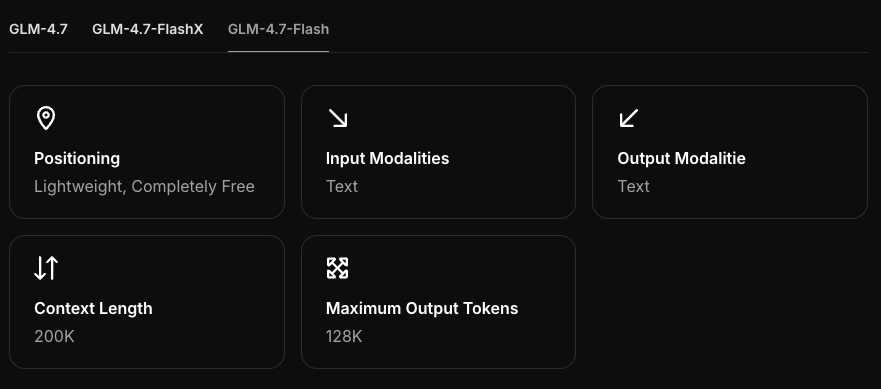

Hardware-Anforderungen

Minimale GPU / RAM

Ich habe GLM-4.7-Flash auf drei Maschinen getestet:

- MacBook Pro M3 Pro (12-Core CPU / 18-Core GPU, 36 GB RAM)

- Mac mini M2 (24-GB unified memory)

- Windows-Desktop mit RTX 4090 (24-GB VRAM)

Aus diesen Tests ergibt sich ein praktisches Minimum:

- Nur CPU (Mac/Windows/Linux): 16 GB Systemspeicher funktionieren, 32 GB sind angenehmer. Erwarten Sie langsamere erste Tokens.

- Apple Silicon (Metal): 16 GB unified memory ist nutzbar mit 4-Bit-/5-Bit-Quantisierung und moderatem Kontext (2–4K). 8 GB fühlte sich beengt an.

- NVIDIA: 8–12 GB VRAM ist das Minimum, das ich für eine 4-Bit-Quantisierung versuchen würde. 16 GB+ sind komfortabler.

GLM-4.7-Flash fühlt sich wie ein mittelgroßes Modell an (denken Sie an unter 10–12B Parameter). In 4-Bit suchen Sie normalerweise nach ~5–6 GB Gerätespeicher plus KV-Cache. Wenn Sie lange Kontexte oder viele parallele Prompts verwenden, steigt der Speicher.

Empfohlene Spezifikationen

Wenn Sie möchten, dass sich die Anwendung “immer reaktionsschnell” anfühlt:

- Apple Silicon: M3 oder neuere Version mit 24–36 GB unified memory: Kontext auf 4–8K halten.

- NVIDIA: 24 GB VRAM (z.B. 3090/4090) gibt Spielraum für höheren Kontext und Parallelität.

- Speicher: schnelle SSD: Modelle werden schneller geladen und wechseln weniger aus.

Ich habe bemerkt, dass sich das Modell nicht mehr “blitzschnell” anfühlt, wenn der Speicherdruck zunimmt, Auslagerungen oder VRAM-Überläufe fügen ein subtiles Stottern hinzu, das den Flow unterbricht. Ein wenig zusätzlicher Spielraum macht viel Unterschied.

Ollama-Einrichtung

Ich habe Ollama verwendet, da es lokale Ausführungen einfach und konsistent auf allen Maschinen hält.

Installieren Sie Ollama 0.14.3+

- macOS: brew install ollama (oder mit brew upgrade ollama aktualisieren).

- Windows: Verwenden Sie das offizielle Installationsprogramm von der Ollama-Website.

- Linux: Folgen Sie dem curl-Skript aus der Dokumentation.

Ich bin auf 0.14.3 (Januar 2026). Neuere Versionen ändern manchmal Standard-Backends oder das Quantisierungsverhalten, daher bleibe ich bei der Version, die für mich stabil ist, bis ich einen Grund habe, zu wechseln.

Abrufen und Ausführen von GLM-4.7-Flash

Zwei Wege funktionieren für mich:

-

Wenn Ihre Ollama-Bibliothek einen offiziellen GLM-4.7-Flash-Build enthält:

- ollama pull glm-4.7-flash

- ollama run glm-4.7-flash

-

Wenn es nicht angezeigt wird (dies passierte auf einer Maschine):

- Erstellen Sie eine Modelfile, die auf ein bekanntes GGUF oder kompatibles Artefakt für GLM-4.7-Flash verweist.

- Beispiel Modelfile (vereinfacht):

- FROM ./glm-4.7-flash-q4.gguf

- Prompt-Vorlagen nur hinzufügen, wenn Sie wissen, dass Sie sie benötigen: Ich ließ es minimal.

- Dann: ollama create glm-4.7-flash-local -f Modelfile

- Ausführung: ollama run glm-4.7-flash-local

Notizen aus der Verwendung:

- Das erste Laden ist langsamer, da es Caches aufwärmt.

- Ich halte num_ctx konservativ (4K oder 8K), es sei denn, ich fasse einen Buchentwurf zusammen. Größere Kontexte fühlen sich schön an, aber sie sind speicherintensiv und helfen nicht immer bei der Qualität für alltägliches Schreiben.

- Wenn Generationen zögerlich wirken, versuchen Sie, die Temperatur auf 0,6–0,7 zu senken und top_p leicht zu erhöhen: Es strafte meine Ausgaben, ohne die Geschwindigkeit zu verlieren.

Referenzen: Die Ollama-Dokumentation ist großartig für plattformspezifische Flags und aktuelle Backends.

Mac-Leistung

M4 / M3 / M2 Benchmarks

Diese sind nicht laborgüte, nur stetige Läufe bei Schreib- und leichten Code-Prompts, Temperatur 0,7, 4K Kontext, 4-Bit-Quantisierung:

- M4 (ausgeliehene Maschine, 48 GB): 60–85 tok/s nach dem Aufwärmen. Erstes Token in ~350–500 ms.

- M3 Pro (36 GB): 35–55 tok/s. Erstes Token in ~500–800 ms.

- M2 (24 GB): 20–30 tok/s. Erstes Token in ~900–1200 ms.

Nehmen Sie die Bereiche als Gefühlsprobe. Ich habe auf dem M3 Pro einige 8K-Kontexte verwendet: Die Geschwindigkeit sank ~20–30%, blieb aber für Entwürfe nutzbar. Auf dem M2 überschritten lange Kontexte meine “fühlt sich klebrig an”-Grenze. Ich behielt es dort bei 2–4K.

Speicheroptimierung

Was auf macOS am meisten geholfen hat:

- Halten Sie weniger Terminal-Tabs mit laufenden Modellen. Offensichtlich, ja, aber ich vergesse es.

- Richtige Größe für Kontext. 4K ist für mich ein optimaler Punkt.

- Verwenden Sie 4-Bit-Quantisierung, wenn möglich. 5-Bit war bei der Qualität ähnlich, aber langsamer.

- Schließen Sie Apps, die GPU-Zeit beanspruchen (Video-Editoren, einige Browser-Registerkarten mit WebGL).

Ich bemerkte auch, dass die Verwendung einer stabilen Systemaufforderung die Überarbeitungen reduzierte. Nicht schneller auf dem Papier, aber weniger Versuche bedeuten bessere “gefühlte Geschwindigkeit”. Eine kleine Aufforderung wie: “Sei prägnant, verwende einfaches Englisch, kein Marketing-Ton.” Sie passt zu den Stärken des Modells.

Windows + NVIDIA

RTX 3090 / 4090 Config

Auf der 4090 (24 GB) fühlte sich GLM-4.7-Flash konsistent schnell an:

- 4-Bit-Quantisierung, 4–8K Kontext: 120–220 tok/s nach dem Aufwärmen.

- Erstes Token: ~250–400 ms.

- Parallele Prompts: 2–3 Streams, bevor ich Stottern sah.

Ein Freund führte es auf einer 3090 (24 GB) aus und sah ~15–25% niedrigeren Durchsatz mit ähnlichen Einstellungen. Wenn Sie über 8K Kontext hinausgehen oder viele Antworten gleichzeitig ausführen, werden Sie VRAM-Spielraum treffen. Ich gehe normalerweise auf 4–6K zurück und halte die Chargen klein.

CUDA-Einrichtung

Was in der Praxis wichtig war:

- Aktueller NVIDIA-Treiber (eine saubere Installation half einer Maschine, die stotterte).

- CUDA 12.x und passende Runtime, wenn Sie außerhalb von Ollama gehen (vLLM/SGLang). Für Ollama selbst benötigen Sie nicht immer ein vollständiges Toolkit, aber aktuelle Treiber sind unverzichtbar.

- Energieeinstellungen: Setzen Sie Ihre GPU auf “Maximale Leistung bevorzugen.” Es klingt nach Gamer-Rat, aber es stoppte die Takt-Drosselung bei langen Läufen.

Wenn Sie auf Ladefehler stoßen oder hart zur CPU fallen, würde ich überprüfen:

- Treiberversionkonformität mit CUDA-Runtime.

- Ob ein Antivirus Ihr Modellverzeichnis scannt (es passierte: es war dumm: es war langsam).

Referenz: NVIDIAs Treiber-CUDA-Kompatibilitätstabelle ist einen schnellen Blick wert, bevor Sie eine Stunde in das Debuggen investieren.

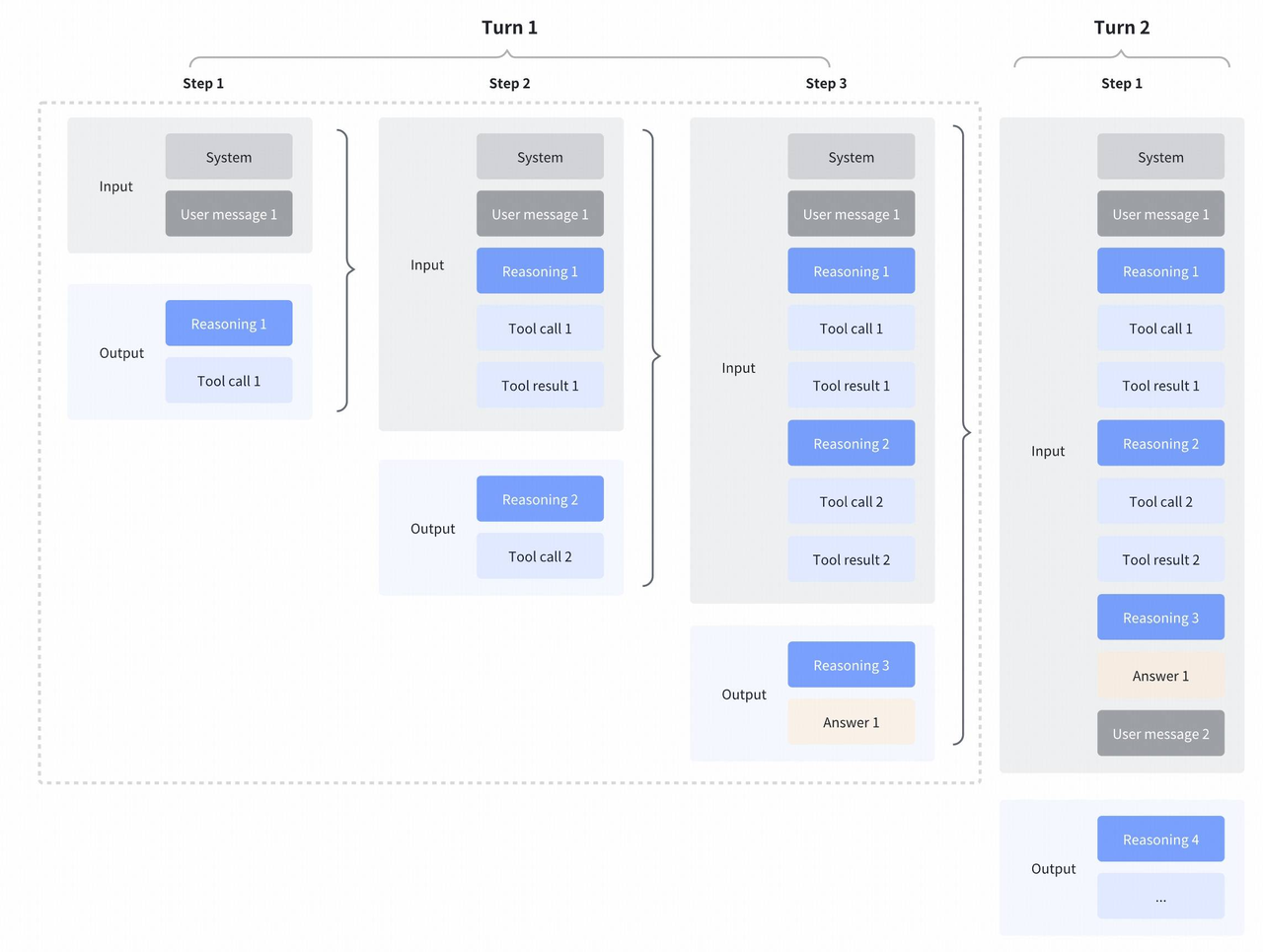

vLLM / SGLang

Ich habe GLM-4.7-Flash mit vLLM und SGLang versucht, wenn ich mehr Kontrolle über Batching und Server-ähnliche Endpunkte wollte.

vLLM

- Installation: Aktuelle Python, CUDA-kompatible PyTorch, dann pip install vllm.

- Ausführung:

python -m vllm.entrypoints.openai.api_server --model <your_glm_flash_id> --dtype auto --max-model-len 4096 - Warum ich es verwendet habe: Stabile OpenAI-kompatible API, solider Durchsatz für Multi-User- oder Multi-Tab-Workflows.

SGLang

- Installation: pip install sglang

- Ausführung:

python -m sglang.launch_server --model <your_glm_flash_id> --context-length 4096 - Warum ich es verwendet habe: Low-Latenz-Streaming fühlte sich schnell an, und es funktionierte gut mit kleinen Routing-Tasks.

Beide mögen einen ordentlichen Modellpfad oder HF-Repo-ID. Wenn GLM-4.7-Flash nicht in Ihrem Standard-Index ist, müssen Sie sie auf ein lokales GGUF oder ein kompatibles Gewichtformat verweisen. Auch: CUDA- und Treiber-Versionen abgleichen, oder Sie verfolgen undurchsichtige Kernel-Fehler. Ich halte dtype auf auto und erzwinge fp16 nur, wenn ich weiß, dass ich VRAM zu erübrigen habe.

Für meine Single-User-Schreibsitzungen blieb Ollama einfacher. vLLM/SGLang machte Sinn, wenn ich Tools testete, die einen OpenAI-ähnlichen Endpunkt brauchten.

Fehlerbehebung

Modell-Ladefehler

Was ich sah:

- “Nicht genug Speicher” beim Laden. Fix: Wechseln Sie zu einer kleineren Quantisierung (z.B. 4-Bit), senken Sie num_ctx, oder schließen Sie GPU-intensive Apps.

- “Kein kompatibler Backend” unter Windows. Fix: GPU-Treiber aktualisieren: Stellen Sie sicher, dass Sie nicht versehentlich PyTorch nur für CPU installiert haben, wenn Sie vLLM/SGLang verwenden: Starten Sie nach Treiber-Upgrades neu.

- Modell nicht in Ollama gefunden. Fix: Erstellen Sie eine Modelfile und ollama create: oder pull aus dem exakten Repo-Tag, wenn er existiert.

Wenn ein Modell stillschweigend zur CPU zurückfällt, ist das Zeichen Lüftergeräusche (oder das Fehlen davon) plus viel langsamere tokens/sec. Ich habe gelernt, die Geräteauslastung zu überprüfen, bevor ich annehme, dass das Modell “schlechter” geworden ist.

Slow-Inference-Fixes

Kleine Änderungen, die mehr Auswirkungen hatten, als ich erwartet hatte:

- Richtige Größe für Kontext. Das Halbieren des Kontexts beschleunigt die Dinge oft mehr als das Herumspielen mit Sampling.

- Cache aufwärmen. Ein kurzer Kurzlauf verbessert den nächsten.

- Parallele Streams reduzieren. Parallelität sieht effizient aus, bis der KV-Cache Sie stolpert.

- Für NVIDIA: Setzen Sie den Hochleistungs-Stromsparmodus, schließen Sie Overlay-Apps, und stoppen Sie Hintergrund-Encoder.

- Auf macOS: Halten Sie das Ladegerät drin: Einige Laptops werden bei Batterieversorgung reduziert.

Noch etwas: Ich hörte auf, maximale tokens/sec zu verfolgen. Die bessere Metrik für mich war “erster brauchbarer Gedanke.” GLM-4.7-Flash gab mir das schnell, wenn ich Prompts fokussiert und Kontexte angemessen hielt.

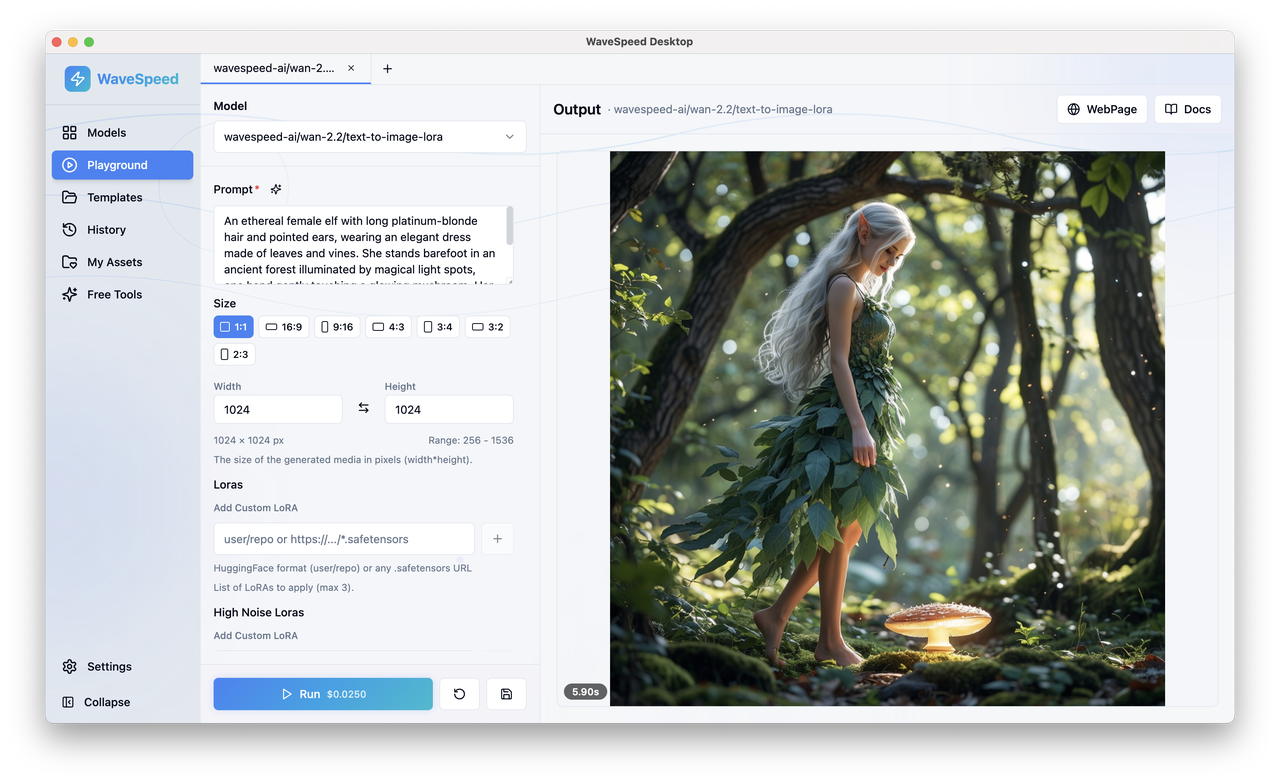

Wenn Ihnen die Geschwindigkeit von GLM-4.7-Flash gefällt, aber Sie keine Lust haben, Treiber, CUDA-Versionen oder Backend-Eigenheiten zu betreuen, versuchen Sie WaveSpeed - unsere eigene Plattform, die auf stabiler, schneller Inferenz ohne Low-Level-Tuning konzentriert ist. Sie erhalten vorhersehbare Latenz, ohne sich über Modelldateien, Quantisierungsformate oder GPU-Kompatibilität Sorgen zu machen.

Wenn Ihnen die Geschwindigkeit von GLM-4.7-Flash gefällt, aber Sie keine Lust haben, Treiber, CUDA-Versionen oder Backend-Eigenheiten zu betreuen, versuchen Sie WaveSpeed - unsere eigene Plattform, die auf stabiler, schneller Inferenz ohne Low-Level-Tuning konzentriert ist. Sie erhalten vorhersehbare Latenz, ohne sich über Modelldateien, Quantisierungsformate oder GPU-Kompatibilität Sorgen zu machen.