GLM-4.7-Flash API: Chat Completions & Streaming Quick Start

Hallo, ich bin Dora. Letzte Woche bin ich auf ein kleines Problem gestoßen: eine Aufgabe zur Zusammenfassung eines Entwurfs, die schwerer wirkte, als sie sein sollte. Die Tools, die ich normalerweise nutze, waren entweder zu langsam oder zu clever für ihren eigenen Zweck. Ich wollte etwas Schnelles und Vorhersehbares, auch wenn es nicht spektakulär war.

Also habe ich die GLM-4.7-Flash API ordnungsgemäß getestet (Januar 2026). Ich war nicht auf der Suche nach einem „Wow-Effekt”. Ich wollte saubere Anfragen, schnelle Antworten und Einstellungen, die sich so verhalten, wie sie sollten. Hier ist, was ich eingerichtet habe, was geholfen hat, wo es Probleme gab, und warum ich es wieder nutzen würde, wenn ich Geschwindigkeit ohne Drama brauche.

API-Schlüssel abrufen

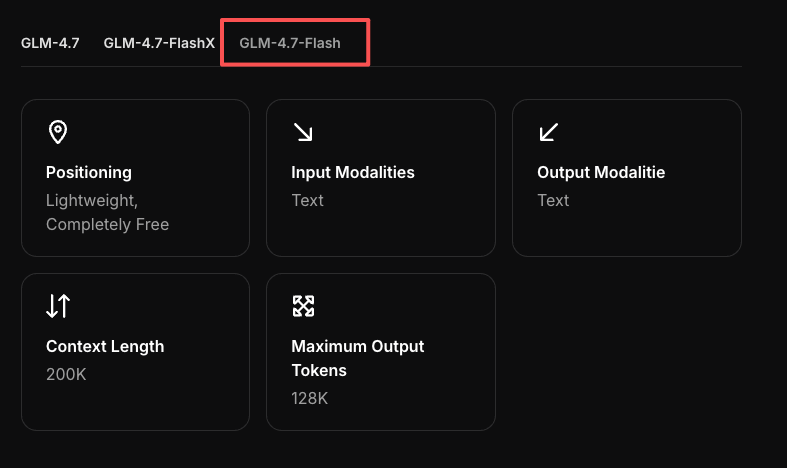

Ich habe einfach angefangen: einen Schlüssel holen, eine Anfrage stellen, schauen, ob die Basics sinnvoll wirken. Ich schätze APIs, die die Bedienelemente nicht verstecken. Im Hintergrund: GLM-4.7-Flash ist Teil der breiteren GLM-Modellfamilie von Zhipu AI, die viele der Designentscheidungen rund um Geschwindigkeit und Vorhersehbarkeit prägt.

WaveSpeed Dashboard Anleitung

Ich habe das WaveSpeed Dashboard verwendet, das den Zugriff auf die GLM-4.7-Flash API umhüllt. Der Ablauf war einfach genug:

- Ein Projekt erstellen (ich nannte meins „flash-notes”).

- Einen Server-Schlüssel und ein leichtes Client-Token generieren. Ich habe nur den Server-Schlüssel in meinen lokalen Skripten verwendet.

- Das Nutzungspanel überfliegen, um die Standard-Rate-Limits zu erkennen. Meines zeigte einen bescheidenen Burst-Cap und ein Pro-Minute-Kontingent, ausreichend für Tests, aber nicht für einen Produktions-Anstieg.

Eine kleine Sache, die mir gefiel: das Dashboard zeigt aktuelle 4xx/5xx-Fehler mit Zeitstempel an. Als ich später an Limits stieß, musste ich nicht raten. Wenn Sie Teamarbeit machen, hilft die rollenbasierte Schlüsselsichtbarkeit: Ich hielt den schreibfähigen Schlüssel in einer .env-Datei und rotierte ihn einmal während der Woche, um zu überprüfen, ob die Sperrung funktionierte (es tat es, sofort).

Einfache Anfrage

Mein erster Checkpoint war derselbe, den ich für jedes neue Modell verwende: eine kurze Anfrage, eine kurze Antwort und keine Überraschungen im JSON.

Das API-Schema folgt dem gleichen Chat-Completions-Muster, das in der offiziellen GLM-4.7 API-Dokumentation beschrieben ist, was bedeutete, dass ich die Anfrage-Semantik nicht neu lernen musste.

curl-Beispiel

Hier ist der einfachste Aufruf, der für mich konsistent funktioniert hat. Der Endpunkt-Name kann zwischen Anbietern variieren: das ist das Muster, das ich während der Tests verwendet habe.

curl https://api.wavespeed.ai/v1/chat/completions \

-H "Authorization: Bearer $WAVESPEED_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "GLM-4.7-Flash",

"messages": [

{"role": "system", "content": "You are concise and helpful."},

{"role": "user", "content": "Summarize this in one sentence: GLM-4.7-Flash API quick test."}

],

"temperature": 0.2,

"max_tokens": 120

}'Anmerkungen aus dem Test

- Latenz: Ich sah das erste Token ~200–400 ms bei einer kleinen Anfrage am Vormittag (US-Zeit). Anfang bis Ende wurde für kurze Antworten in unter einer Sekunde abgeschlossen.

- Stabilität: Responses waren jedes Mal wohlgeformtes JSON, wenn Streaming aus war.

- Kosten: Ich kann nicht über Ihren Plan sprechen, aber Token wurden deutlich in den Nutzungsprotokollen gemeldet. Das ist wichtig, wenn Sie schnelle Iterationen vorantreiben.

Python-Beispiel

Für kleine Skripte bevorzuge ich eine einzelne Funktion mit umgebungsgeladenen Schlüsseln.

import os

import requests

API_KEY = os.getenv("WAVESPEED_API_KEY")

BASE_URL = "https://api.wavespeed.ai/v1/chat/completions"

payload = {

"model": "GLM-4.7-Flash",

"messages": [

{"role": "system", "content": "You are concise and helpful."},

{

"role": "user",

"content": "Give me 3 bullet points on maintaining a calm writing workflow."

}

],

"temperature": 0.3,

"max_tokens": 180

}

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

resp = requests.post(BASE_URL, json=payload, headers=headers, timeout=30)

resp.raise_for_status()

data = resp.json()

print(data["choices"][0]["message"]["content"]) # typical OpenAI-style schemaZwei kleine Reaktionen:

- Erleichterung: Das Schema entsprach dem üblichen Chat-Completions-Format, was bedeutete, dass keine Adapter-Schicht nötig war. Ich ließ es in ein bereits vorhandenes Tool mit minimalen Änderungen fallen.

- Eine Einschränkung: Längere Ausgaben bei höherer Temperatur schweiften manchmal ab. Das ist normal für „Flash”-Modelle: Ich begrenzte mit

max_tokensund passte den Ton über einen straffer durchdachten System-Prompt an.

Streaming aktivieren

Ich schalte Streaming nur ein, wenn ich Text live forme oder wenn Latenz wichtiger ist als Vollständigkeit. GLM-4.7-Flash schien dafür gemacht: schnelle erste Token, stabiles Chunking, sobald die Parameter richtig eingestellt waren.

Stream-Parameter-Setup

Um Server-Sent Events (SSE) zu aktivieren, setze ich stream: true. Das ist alles. Der Rest ist Hausarbeit: Stellen Sie sicher, dass Ihr Client Event-Zeilen liest und bei [DONE] stoppt.

curl-Version, die ich verwendet habe:

curl https://api.wavespeed.ai/v1/chat/completions \

-H "Authorization: Bearer $WAVESPEED_API_KEY" \

-H "Content-Type: application/json" \

-N \

-d '{

"model": "GLM-4.7-Flash",

"messages": [

{"role": "user", "content": "Draft a two-sentence intro about quiet tools."}

],

"stream": true,

"temperature": 0.2,

"max_tokens": 120

}'Zwei Feldnotizen:

- Wenn Sie

-N(no-buffer) mit curl vergessen, kann der Stream stecken bleiben. - Wenn Sie statt Events ein einfaches JSON-Blob erhalten, überprüfen Sie, dass

streambooleschtrueund kein String ist.

Chunks im Code verarbeiten

In Python lese ich zeilenweise, parse data:-Frames und stoppe bei der Sentinel. Dieses Muster funktionierte reibungslos.

import os, json, requests

API_KEY = os.getenv("WAVESPEED_API_KEY")

BASE_URL = "https://api.wavespeed.ai/v1/chat/completions"

payload = {

"model": "GLM-4.7-Flash",

"messages": [{"role": "user", "content": "Write a calm closing paragraph."}],

"stream": True,

"temperature": 0.2,

}

with requests.post(

BASE_URL,

json=payload,

headers={

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

},

stream=True,

timeout=60

) as r:

r.raise_for_status()

for line in r.iter_lines(decode_unicode=True):

if not line or not line.startswith("data:"):

continue

data = line[len("data:"):].strip()

if data == "[DONE]":

break

try:

delta = json.loads(data)["choices"][0]["delta"].get("content", "")

print(delta, end="", flush=True)

except (KeyError, json.JSONDecodeError):

# Skip malformed or heartbeat frames gracefully

continue

print() # newlineWas mich ein wenig überraschte: Die Chunk-Zeitsteuerung war stetig. Ich versuchte ein paar längere Prompts und erhielt immer noch vorhersehbare Abstände. Streaming sparte keine Wanduhrzeit bei sehr kurzen Antworten, reduzierte aber mein Gefühl des Wartens, was zählt, wenn ich direkt im Terminal bearbeite.

Parameter-Referenz

Ich stelle nur wenige Regler täglich um. Mit der GLM-4.7-Flash API verhielten sich diese wie erwartet.

temperature / top_p / max_tokens

- temperature: Ich hielt dies zwischen 0.1 und 0.4 für produktionsorientierte Aufgaben. Niedrigere Zahlen ergaben straffere, weniger fantasievolle Sätze, was für Zusammenfassungen und Supporttext in Ordnung ist. Wenn Sie über 0,7 driften, erwarten Sie Abschweifungen.

- top_p: Ich ließ top_p um 0.9. Wenn ich es bei niedriger Temperatur auf 0.6 anpasste, fühlten sich Outputs gekürzt an, nützlich für Aufzählungspunkte, weniger für nuancierte Schreiben.

- max_tokens: Dies war meine Schutzschiene. Für Short-Form-Aufgaben hielten 150–250 die Kosten niedrig und verhinderten Schweifsucht. Für Gliederungen reichten 600–800. Wenn das Modell früh stoppt, ist es normalerweise dies, nicht ein Bug.

Ein kleines Setup, das für mich gut funktionierte, wenn ich prägnante, sachliche Antworten brauchte:

{

"model": "GLM-4.7-Flash",

"temperature": 0.2,

"top_p": 0.9,

"max_tokens": 200

}Warum dies in der Praxis wichtig ist: Wenn Sie Geschwindigkeit wollen, wollen Sie keine Umschreibungen. Eine konservative Temperatur mit einem großzügigen, aber nicht unbegrenzten max_tokens sparte mir, den gleichen Aufruf zweimal nur zum Trimmen der Sätze ausführen zu müssen.

Häufige Fehler

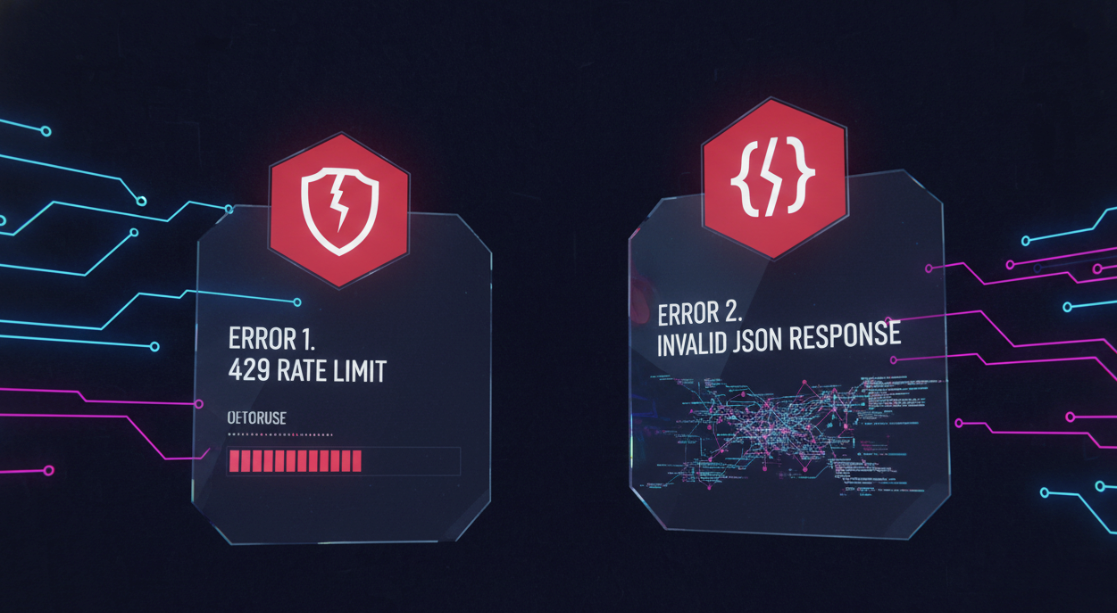

Ich hielt ein kleines Notizbuch neben mir, während ich testete. Zwei Fehler traten häufig genug auf, um erwähnt zu werden.

Ich hielt ein kleines Notizbuch neben mir, während ich testete. Zwei Fehler traten häufig genug auf, um erwähnt zu werden.

429 Rate Limit

Was ich sah:

- Bursts paralleler Anfragen (5–10 auf einmal) lösten manchmal ein 429 aus. Es geschah häufiger in der ersten Minute eines frischen Schlüssels.

Was half:

- Backoff: Jittered exponential delay (z.B. 200 ms, 400 ms, 800 ms, bis ~3 s) beseitigte Spitzen, ohne dass ich mich darum kümmern musste.

- Warteschlangen: Das Zusammenlegen fast identischer Prompts in ein kurzes Batch-Fenster (100–200 ms) reduzierte meine Spitzenrate um ~30%, ohne UX zu verändern.

- Dashboard-Überprüfungen: Das Nutzungspanel bestätigte, wann ich das Problem war. Kein Rätselraten dort, was ich schätzte.

Wer das auslöst: Teams, die GLM-4.7-Flash gleichzeitig in UI-Vorschauen und Server-Hooks verdrahten. Falls es wichtig ist, fragen Sie Ihren Anbieter nach höheren Pro-Minute-Limits oder verwenden Sie eine leichte In-Memory-Warteschlange.

Ungültige JSON-Response

Was ich sah:

- Wenn Streaming aktiviert ist, versuchen einige Clients, jeden

data:-Frame als vollständiges JSON zu parsen. Das ist nicht wie SSE funktioniert. Frames sind Teilstücke. - Einmal bekam ich bei einer störanfälligen Verbindung eine gekürzte Event-Zeile, die strikte Parser brach.

Was half:

- Schützen Sie Ihren Parser: Parsen Sie nur das JSON nach

data:und erwarten Sie, dass es ein kleines Delta enthält, nicht die vollständige Nachricht. Stoppen Sie bei[DONE]. - Timeouts: Halten Sie einen angemessenen Read-Timeout, aber vermeiden Sie, einen Stream wegen eines einzelnen fehlgeformten Frame zu töten.

- Wenn Sie nicht-Stream JSON brauchen: Schalten Sie Stream aus und Sie erhalten normalerweise ein sauberes, einzelnes JSON-Objekt. In meinen Durchläufen produzierte nicht-Stream-Modus nie fehlgeformtes JSON.

Ein weiterer kleiner Snag: Wenn Ihr Proxy oder Server Logs in stdout injiziert, kann es den Stream verschmutzen. Halten Sie Logs getrennt von Response-Pipes.

Nach all diesem Testing ist der Grund, warum ich bei WaveSpeed blieb, ziemlich einfach: Ich wollte nicht über die Rohrleitungen nachdenken.

Wir haben WaveSpeed gebaut, um die langweilig zuverlässige Schicht zwischen Ihrem Code und schnellen Modellen wie GLM-4.7-Flash zu sein. Saubere Endpunkte, vorhersehbares Verhalten und ein Dashboard, das Ihnen sagt, was tatsächlich passiert ist, wenn etwas schief geht – Rate Limits, Fehler, Nutzung – ohne Rätselraten.

Wir haben WaveSpeed gebaut, um die langweilig zuverlässige Schicht zwischen Ihrem Code und schnellen Modellen wie GLM-4.7-Flash zu sein. Saubere Endpunkte, vorhersehbares Verhalten und ein Dashboard, das Ihnen sagt, was tatsächlich passiert ist, wenn etwas schief geht – Rate Limits, Fehler, Nutzung – ohne Rätselraten.

Wenn Sie Flash in Zusammenfassungen, Entwürfe, UI-Vorschauen oder Hintergrund-Jobs verdrahten und möchten, dass es einfach aus dem Weg bleibt, das ist genau die Lücke, die wir füllen möchten. → Klicken Sie hier!