FLUX.1 Kontext MCP Weltpremiere: Entfesseln Sie Real-Time Multimodal Agent Power mit einem Klick

FLUX.1 Kontext MCP Global Premiere: Entsperren Sie multimodale Agent-Power in Echtzeit mit nur einem Klick

1. Einführung in FLUX.1 Kontext

FLUX.1 Kontext ist ein professionelles Bild-zu-Bild-Bearbeitungsmodell von Black Forest Labs, das für intelligentes kontextuales Verständnis und präzise Bildmanipulation konzipiert ist. Es unterstützt eine breite Palette von Bearbeitungsaufgaben ohne komplexe Eingabeaufforderungen, darunter Objektänderung, Stilumwandlung, Hintergrundaustausch, Konsistenzbearbeitung von Charakteren und Textbearbeitung.

Die Kernstärken von FLUX.1 Kontext liegen in seinem außergewöhnlichen kontextualen Verständnis und seiner Fähigkeit, die Charakterkonsistenz zu bewahren. Es stellt sicher, dass Schlüsselelemente – wie Charaktermerkmale und Kompositionslayouts – auch nach mehreren Bearbeitungsrunden stabil bleiben.

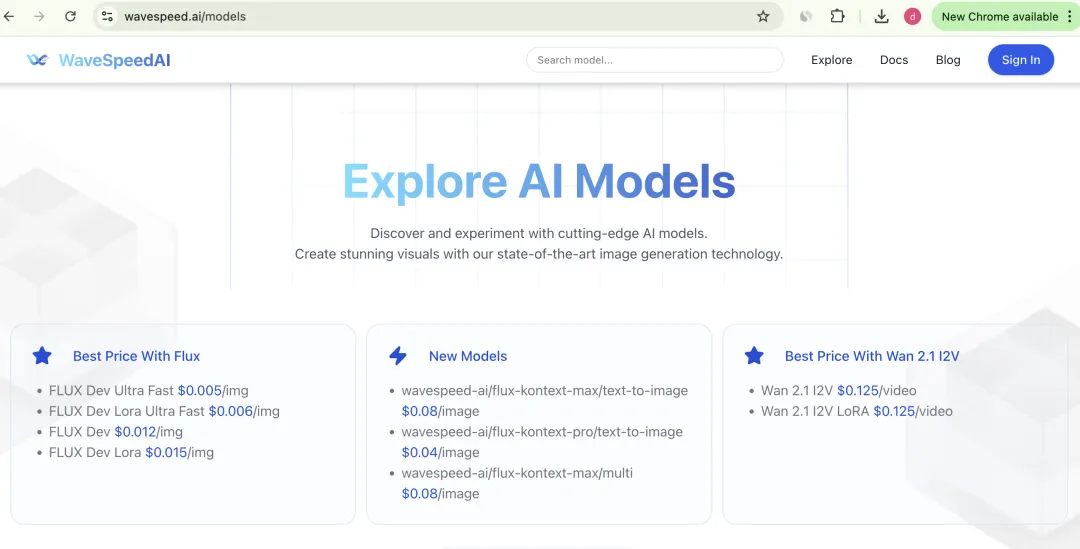

Darüber hinaus sind nun beide Versionen FLUX.1 Kontext Pro und FLUX.1 Kontext Max der API als bezahlte Angebote verfügbar. Black Forest Labs kündigte an, dass bald die Open-Source-Version FLUX.1 Kontext Dev veröffentlicht wird.

- FLUX.1 Kontext Pro: Ideal für Bearbeitung, Compositing und kreative Neuerstellung.

- FLUX.1 Kontext Max: Optimiert für erweiterte Typografie, Prompt-Präzision und Bearbeitungsgeschwindigkeit.

- FLUX.1 Kontext Dev: Kommt bald.

2. Einführung in WaveSpeed MCP: Multimodalität von Agents erweitern

WaveSpeedAI ist eine global führende Plattform zur Beschleunigung von multimodaler KI und integriert die fortschrittlichsten KI-Modelle zur Video- und Bildgenerierung. Wir bieten effiziente, sichere und zuverlässige Lösungen, die Entwickler und Unternehmen ermächtigen, Erstellung und Kommerzialisierung zu beschleunigen.

Nahtlose Integration, erweiterte Agent-Funktionen

WaveSpeed MCP ermächtigt jeden Agent – wie beispielsweise die auf großen Sprachmodellen wie DeepSeek basierten – mühelos Bild- und Videogenerierungsfähigkeiten durch eine standardisierte Schnittstelle zu erlangen, was echte multimodale Interaktion ermöglicht.

Professionelle Ausgabequalität

- Hochwertige Bilder: Reich an Details, vielfältig im Stil und einsatzbereit für professionelle kreative Nutzung.

- Sanfte Videoanimation: 24 fps Hochbildrate sorgt für flüssige und natürliche Bewegung.

- Vielfältige Stilunterstützung: Von realistisch bis abstrakt, westliche bis östliche Ästhetik – angepasst an vielfältige kreative Anforderungen.

Vereinfachter Entwicklungs-Workflow

Entwickler müssen nicht die Komplexität der Bild- und Videogenerierung beherrschen. Mit einfacher Integration über MCP können Agents sofort mit leistungsstarken visuellen Erstellungsfähigkeiten ausgestattet werden.

Effizient und zuverlässig

- Schnelle Antwort: Der gesamte Generierungsprozess ist in nur wenigen Sekunden abgeschlossen.

- Stabil und konsistent: Standardisierte Schnittstellen gewährleisten konsistente Ausgabequalität.

- Skalierbar: Unterstützt mehrere Modelle und Parameteranpassung, um verschiedene Anwendungsszenarien zu erfüllen.

3. Einführung in TRAE von ByteDance

TRAE ist eine von ByteDance entwickelte AI-native integrierte Entwicklungsumgebung (AI IDE). Sie unterstützt KI-gestützte Frage-Antwort, Code-Autocompletion und Agent-basierte KI-Programmierung und bietet Entwicklern ein intelligentes und effizientes Codiererlebnis.

Allerdings hat TRAE immer noch einige Einschränkungen. Zum Beispiel, wenn Sie während der Entwicklung möchten, dass es ein Website-Logo abruft, ein Produkt-Promotionsvideo generiert oder direkt eine Datenbank abfragt, um Benutzerdaten abzurufen – Aufgaben, die multimodale Verarbeitung oder Echtzeit-Ausführung beinhalten – fällt TRAE oft kurz.

Dies ist genau der Punkt, an dem MCP einen Unterschied macht. Es erweitert die Fähigkeiten von TRAE über das Denken hinaus und ermöglicht es ihm zu handeln. Mit MCP entwickelt sich TRAE von einem Tool, das “denken” kann, zu einem, das auch “tun” kann – und wird so zu einem wirklich einheitlichen KI-Assistenten, der Entwicklern hilft, die gesamte Schleife vom intelligenten Inferieren bis zur realen Ausführung zu durchlaufen.

4. Integration von WaveSpeed MCP in TRAE

Dieser Artikel verwendet TRAE als Beispiel, um zu demonstrieren, wie man Bild- und Videogenerierungsfähigkeiten mit WaveSpeed MCP hinzufügt. Bevor wir beginnen, stellen Sie bitte sicher, dass Sie folgende Voraussetzungen erfüllt haben:

TRAE herunterladen und anmelden

Sie sind wahrscheinlich bereits mit TRAE vertraut. Falls nicht, können Sie es von der offiziellen Website herunterladen. Melden Sie sich nach der Installation mit Ihrer Mobilfunknummer und dem Verifizierungscode an.

WaveSpeedAI öffnen und anmelden

Viele von Ihnen sind wahrscheinlich bereits mit WaveSpeedAI vertraut, der schnellsten und kostengünstigsten KI-Plattform der Welt für Bild- und Videogenerierung.

Wenn Sie noch kein Konto haben, können Sie sich hier anmelden: https://wavespeed.ai/.

Melden Sie sich mit GitHub oder Google an und erhalten Sie sofort 1 Dollar.

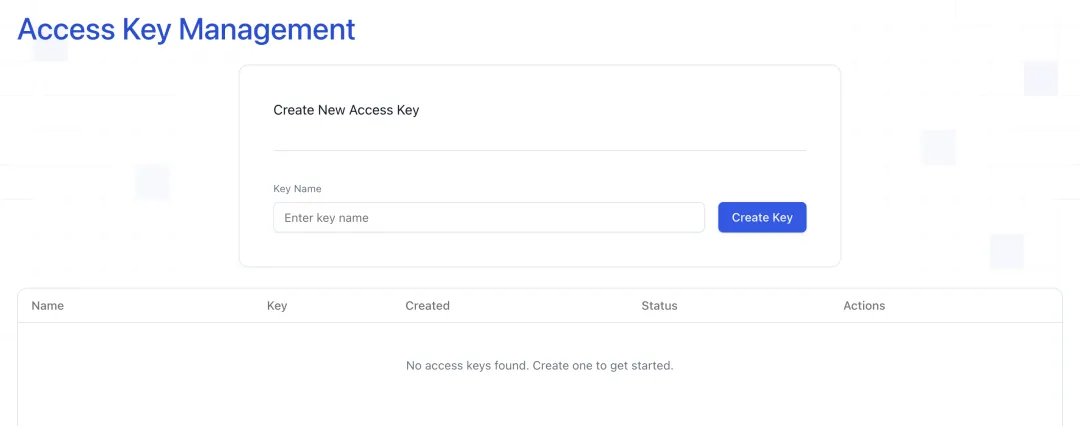

API-Schlüssel erhalten.

WaveSpeedAI MCP herunterladen

Dies ist ein einfacher Schritt: Verwenden Sie einfach den MCP-Service von WaveSpeedAI und installieren Sie den MCP-Client. Wenn Sie sich für den Code interessieren, können Sie unsere Dokumentation lesen, um mehr zu erfahren.

Wenn Sie mit MCP noch nicht vertraut sind, denken Sie daran als einen KI-Orchestrator – er koordiniert mehrere große Modelle und Tools, um komplexe Aufgaben zu automatisieren und ermöglicht KI nicht nur zu denken, sondern auch zu handeln.

pip install wavespeed-mcpSie können die Versionsinformationen nach der Installation überprüfen.

pip show wavespeed-mcpKonfiguration von TRAE

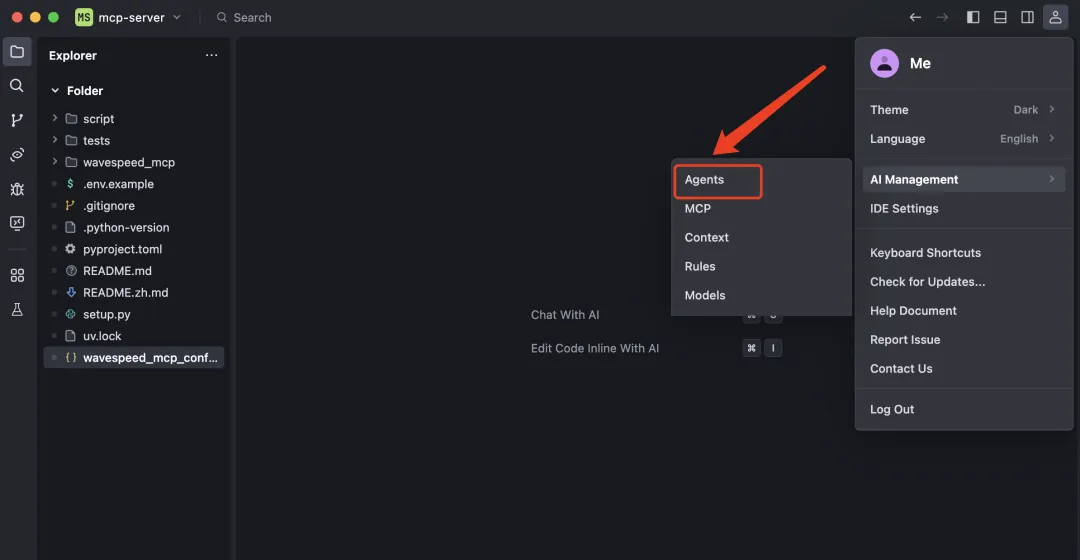

Schritt 1: Öffnen Sie die TRAE IDE und klicken Sie auf das Zahnradsymbol in der oberen rechten Ecke, um die Option „Agents” zu sehen.

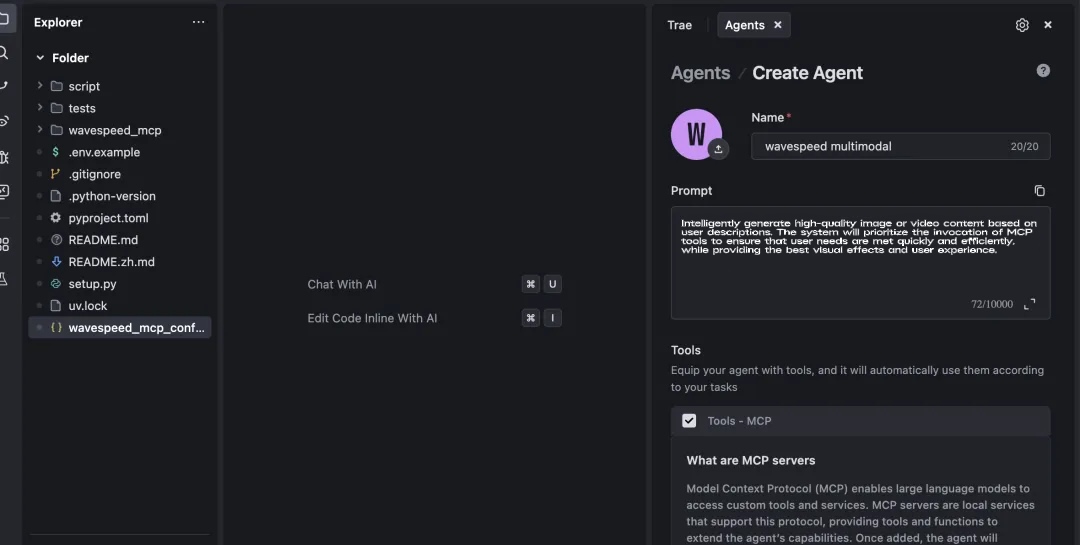

Schritt 2: Agent erstellen, Name und Beschreibung eingeben.

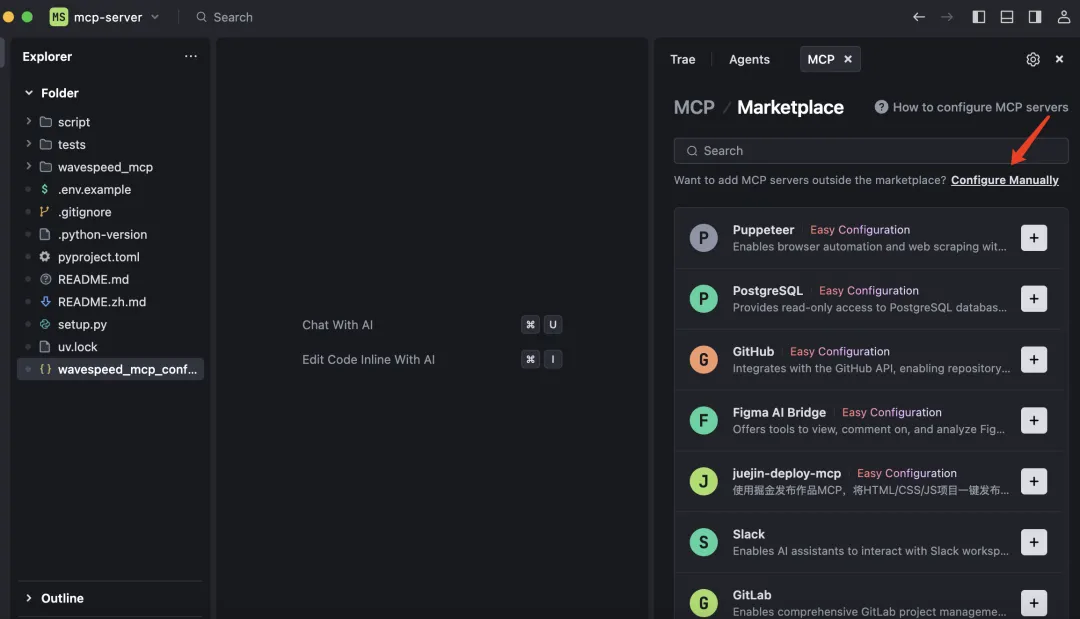

Schritt 3: Konfiguration des MCP-Servers. Wenn die Seite zur MCP-Liste springt, klicken Sie auf „Hinzufügen”. Dann werden Sie zum MCP-Marktplatz weitergeleitet. Unter dem Suchfeld klicken Sie auf „Manuell konfigurieren”.

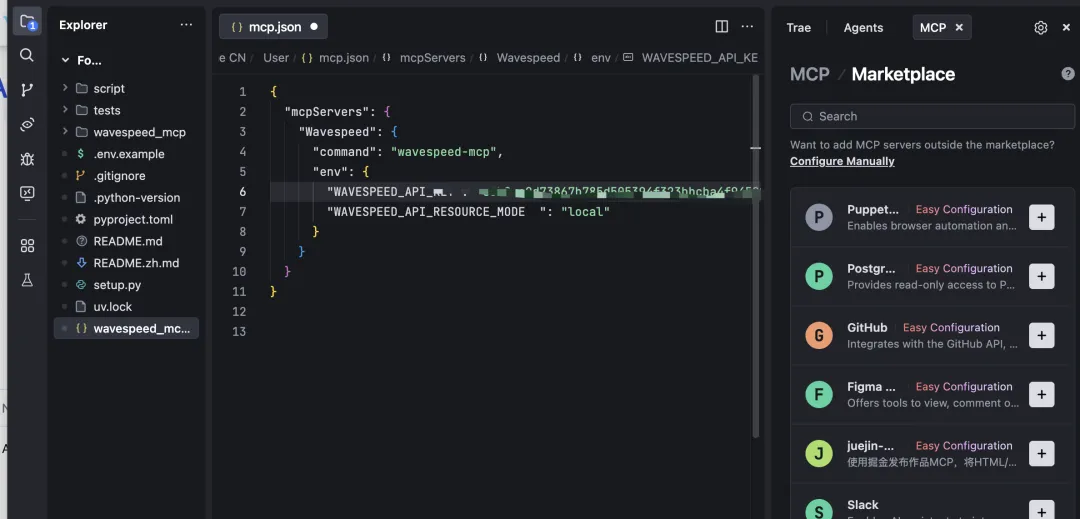

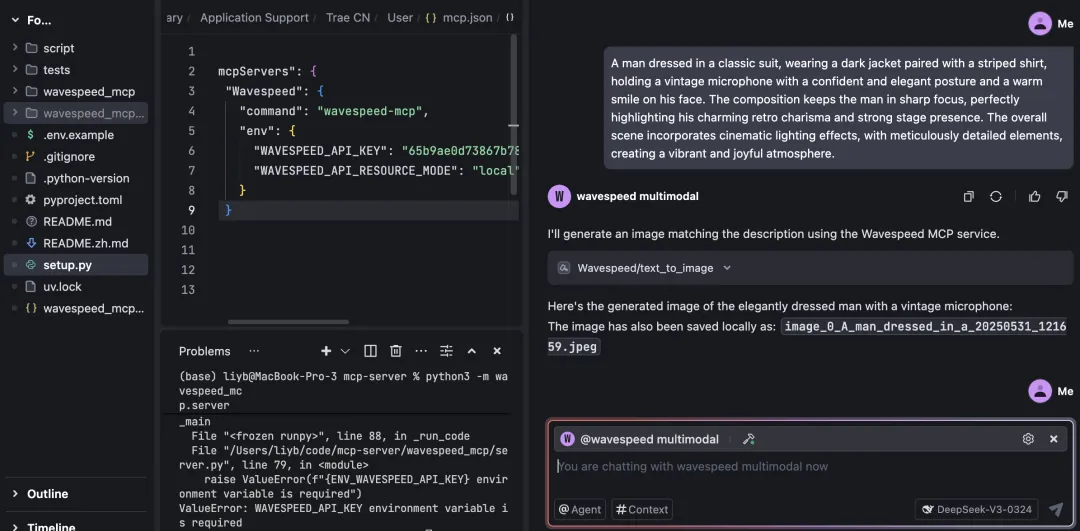

Schritt 4: Konfiguration von WAVESPEED_API_KEY.

Geben Sie auf der Konfigurationsseite folgende JSON ein:

WAVESPEED_API_RESOURCE_MODE ist ein Aufzählungswert: „url”, „base64” oder „local”. Der Standardwert ist „url”.

{

"mcpServers": {

"Wavespeed": {

"command": "wavespeed-mcp",

"env": {

"WAVESPEED_API_KEY": "<YOUR_WAVESPEED_API_KEY>",

"WAVESPEED_API_RESOURCE_MODE": "local"

}

}

}

}

Klicken Sie auf „Bestätigen” und alle Konfigurationen sind abgeschlossen.

6. Starten Sie FLUX.1 Kontext und probieren Sie es aus

Durch die Verwendung des neu erstellten Agents in TRAE können Sie mit nur einem Klick Bilder oder Videos generieren. Die folgenden sieben Beispiele zeigen die Leistung von FLUX.1 Kontext.

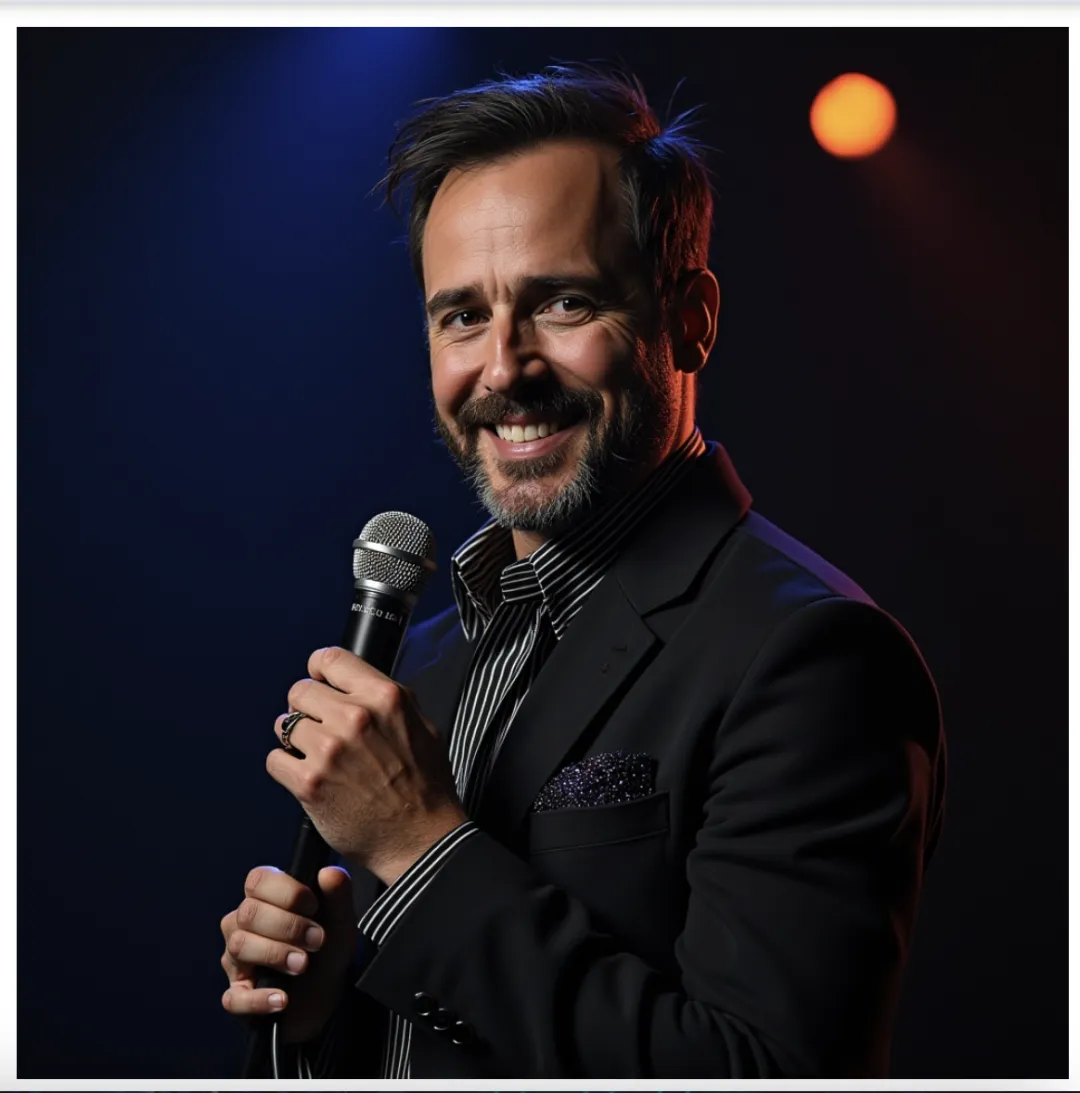

Start: Erstellen eines Bildes mit FLUX Dev

Eingabeaufforderung:

Ein Mann, elegante Kleidung in einem klassischen Anzug, trägt eine dunkle Jacke mit gestreiftem Hemd, hält ein Vintage-Mikrofon mit selbstbewusstem und elegante Körperhaltung und warmem Lächeln im Gesicht. Die Komposition hält den Mann im scharfen Fokus und unterstreicht perfekt seinen charmanten Retro-Charisma und starke Bühnenpräsenz. Die gesamte Szene integriert kinematografische Beleuchtungseffekte, mit akribisch detaillierten Elementen, die eine lebendige und fröhliche Atmosphäre schaffen.

Agent-Ausführungsprozess:

Ergebnis:

Verwenden Sie FLUX.1 Kontext und sehen Sie sich die Präsentation an

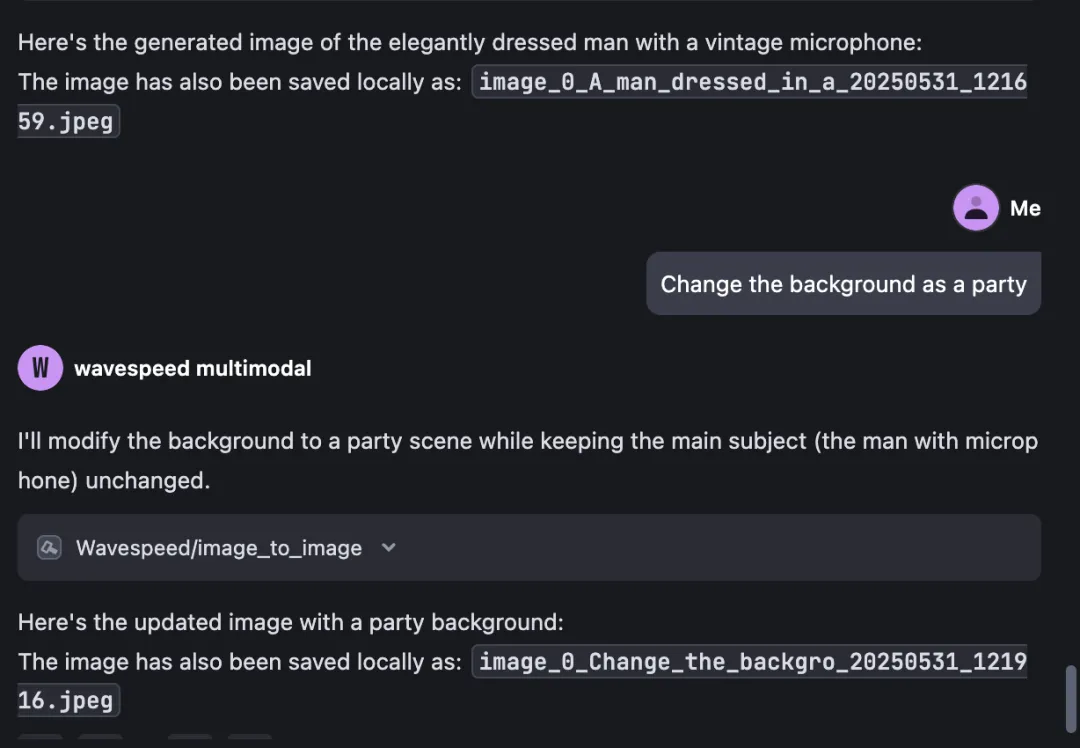

Präsentation 1: FLUX.1 Kontext Hintergrund ändern

Eingabeaufforderung: Ändern Sie den Hintergrund zu einer Party.

Agent-Ausführungsprozess:

Ergebnis:

Bilder werden automatisch hochgeladen und basierend auf der Eingabeaufforderung optimiert.

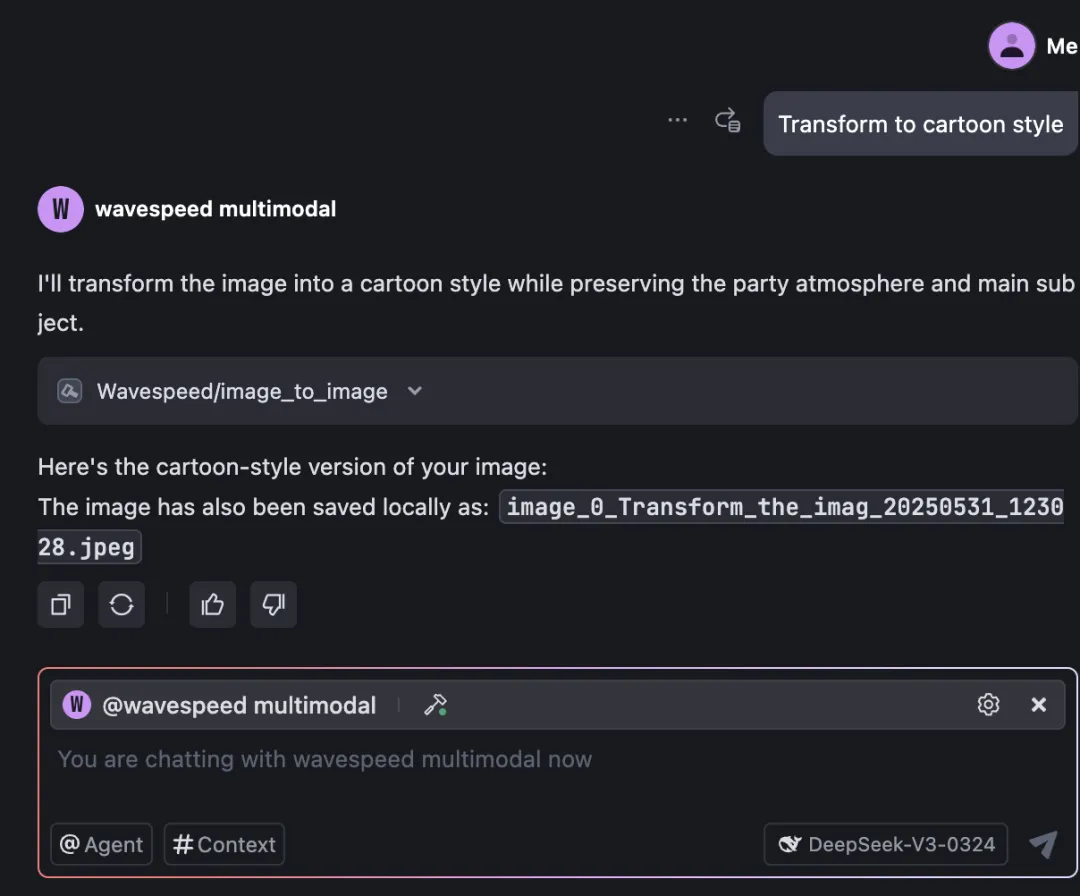

Präsentation 2: FLUX.1 Kontext Stiländerung

Eingabeaufforderung: In Cartoon-Stil umwandeln.

Agent-Ausführungsprozess:

Ergebnis:

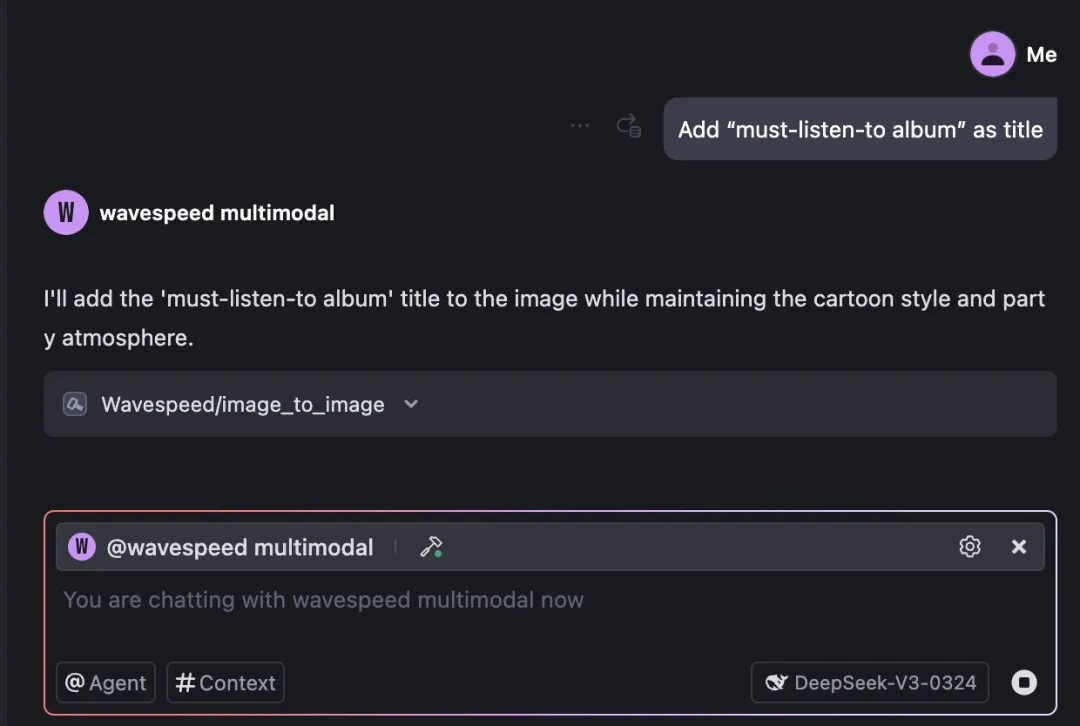

Präsentation 3: FLUX.1 Kontext Text hinzufügen

Eingabeaufforderung: Fügen Sie „must-listen-to album” als Titel hinzu.

Agent-Ausführungsprozess:

Ergebnis:

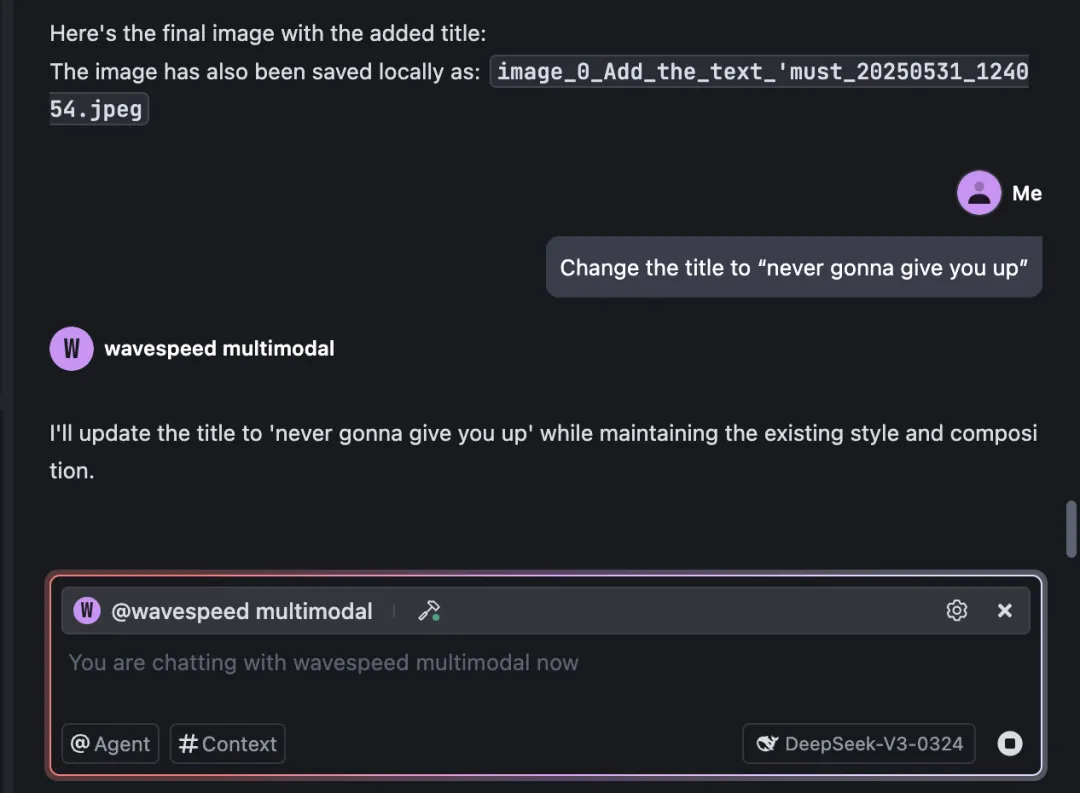

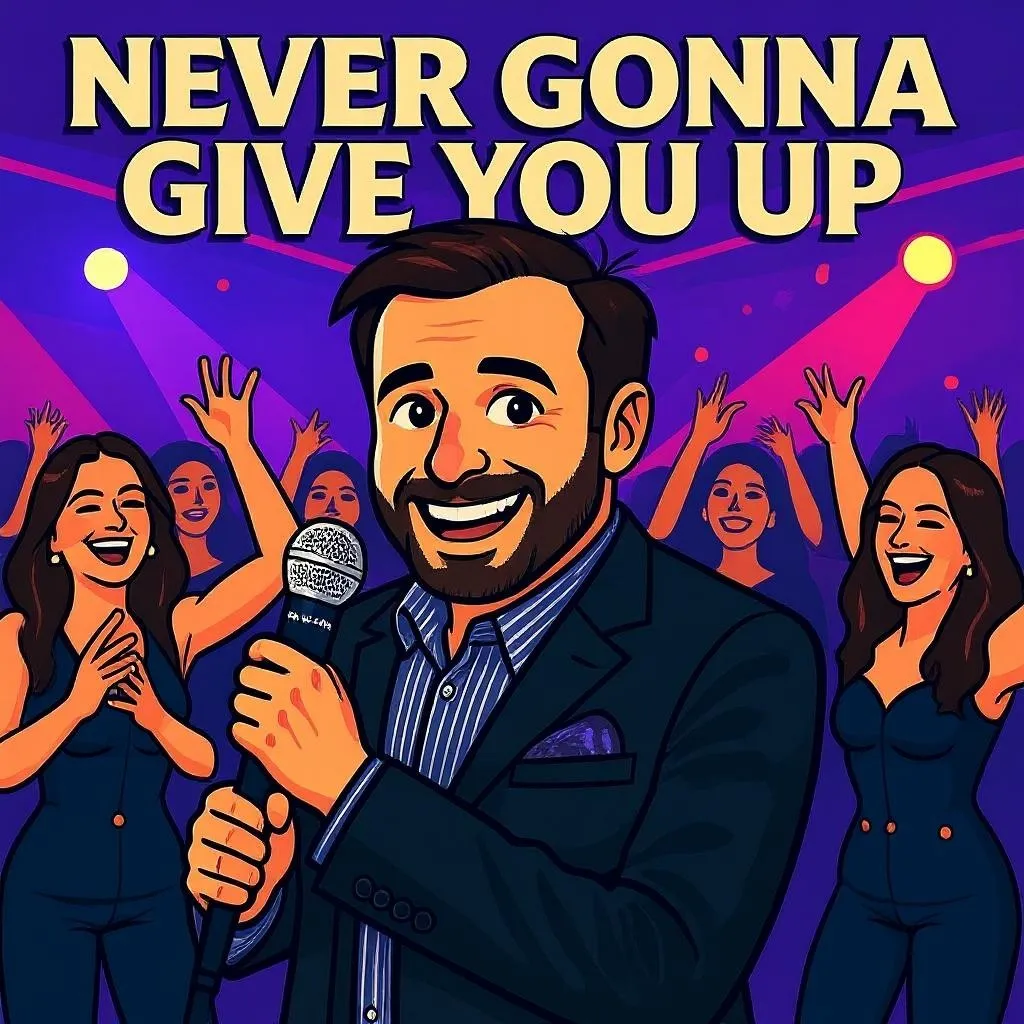

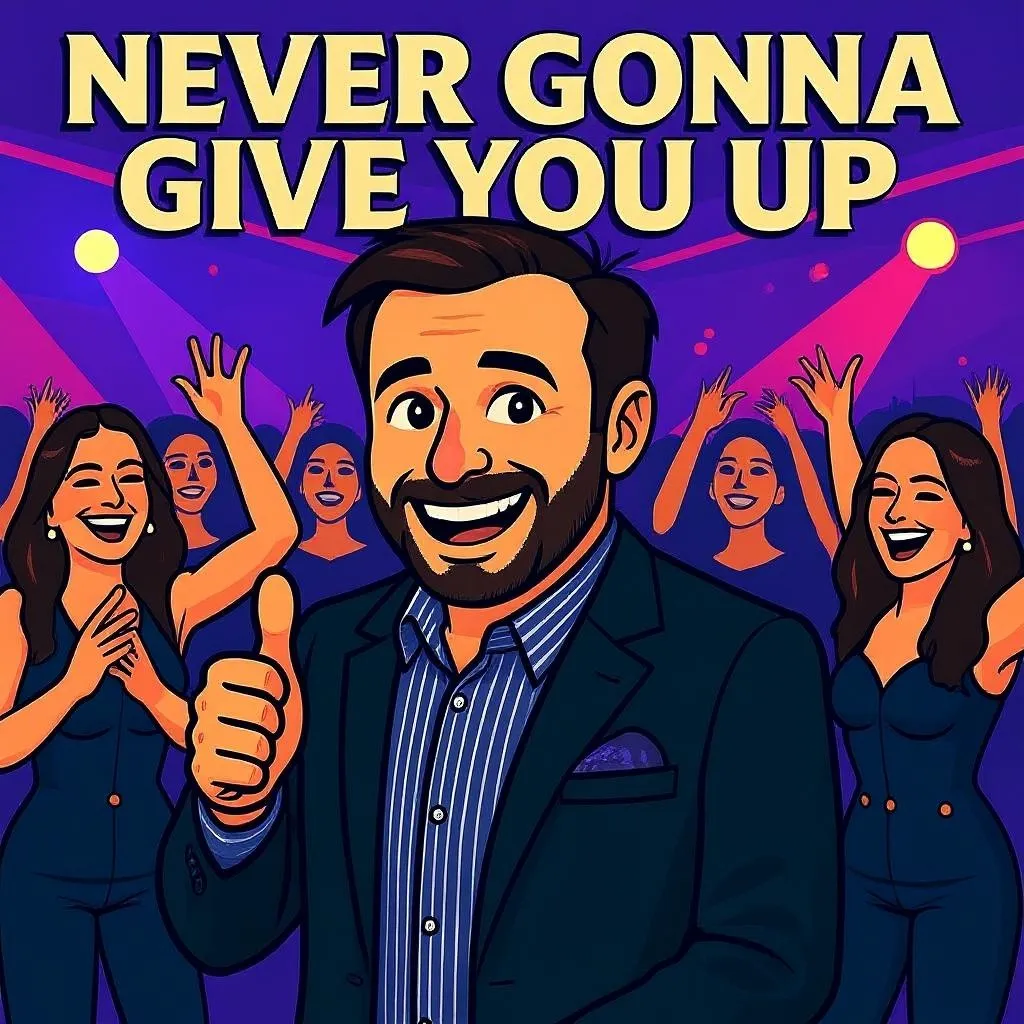

Präsentation 4: FLUX.1 Kontext Textbearbeitung

Eingabeaufforderung: Ändern Sie den Titel zu „never gonna give you up”

Agent-Ausführungsprozess:

Ergebnis:

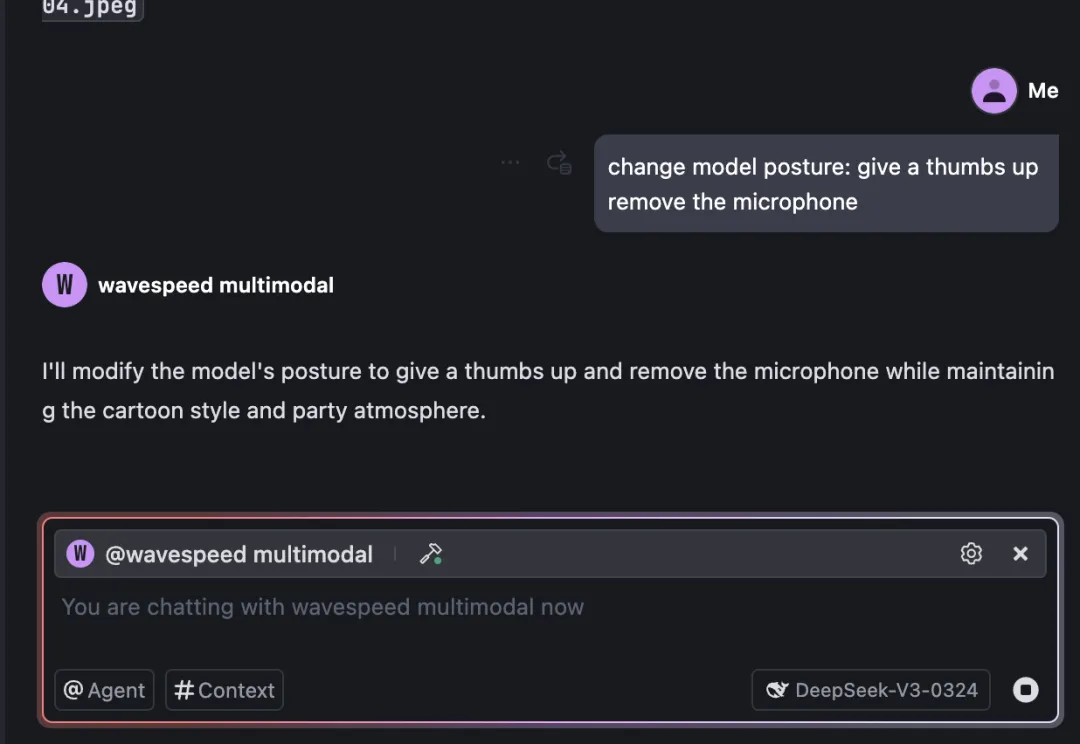

Präsentation 5: FLUX.1 Kontext Haltungsänderung

Eingabeaufforderung: Ändern Sie die Modellhaltung: geben Sie einen Daumen hoch, entfernen Sie das Mikrofon.

Ergebnis:

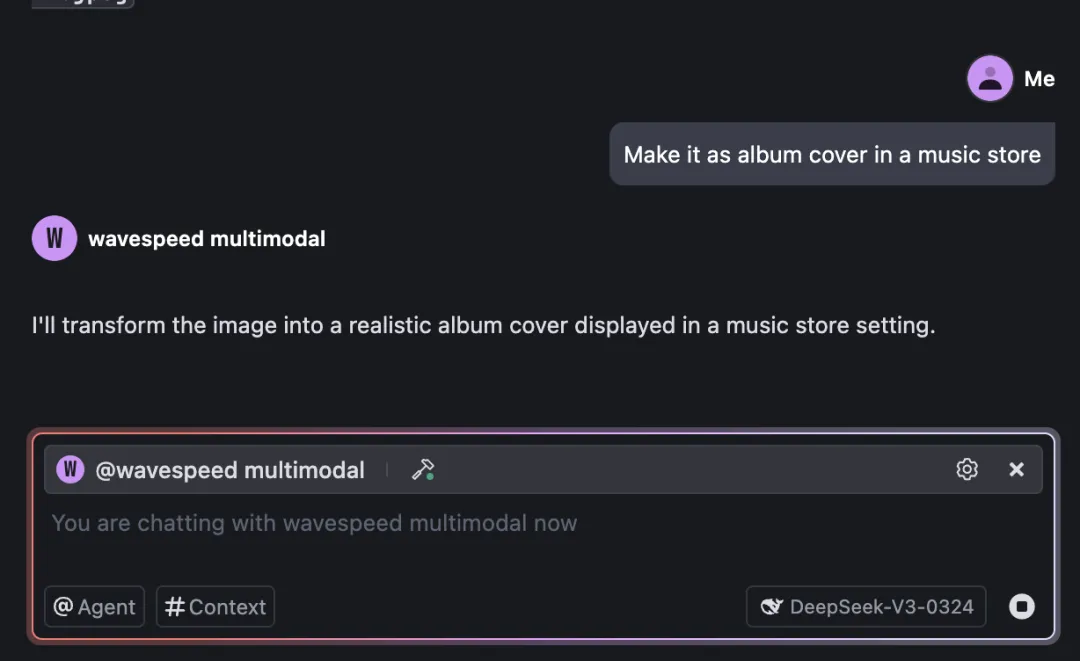

Präsentation 6: FLUX.1 Kontext semantisches Verständnis

Eingabeaufforderung: Machen Sie es ein Album-Cover in einem Musikladen

Agent-Ausführungsprozess:

Ergebnis:

7. Probieren Sie FLUX.1 Kontext jetzt aus!

WaveSpeedAI und TRAE Agent ermöglichen es Entwicklern, ihre Kreativität freizusetzen und hochwertigste multimodale Kreationen in kürzester Zeit zu vollbringen.

Probieren Sie es jetzt aus und beginnen Sie effizient zu erstellen!