Was ist Google Genie 3? DeepMinds World Model erklärt

I need to request permission to edit the file. Let me try with the Write tool instead since it appears the file needs full rewrite permission.

Hallo, Dora hier. Eine kleine Sache hat mich ins Grübeln gebracht. Ich schnitt gerade einen kurzen Referenzvideo-Clip für eine UX-Idee, und ich erwischte mich dabei, wie ich mir wünschte, den Clip zu „poken”, die Szene zu verschieben, den Winkel zu ändern, die Figur zwei Schritte nach links zu bewegen, ohne Figma erneut zu öffnen oder After Effects anzufassen. Das war der Moment, in dem ich zur Google Genie-Reihe zurückkehrte. Ich hatte die frühen Genie-Demos Monate zuvor gesehen, dann das neuere „Genie 3”-Geplauder.

Ich verbrachte ein paar Abende Ende Januar 2026 damit, die offiziellen Posts zu lesen, die Forschungsvideos anzuschauen und sie mit früheren interaktiven Umgebungsmodellen zu vergleichen, die ich tatsächlich ausprobiert habe. Wo ich konnte, habe ich kleine Abläufe aus den älteren öffentlichen Genie-Materialien nachgebildet. Wo der Zugang gesperrt war, machte ich mir Notizen und pausierte, wenn die Behauptungen vage wurden. Hier ist, was hängen blieb, mit Fokus auf das, was „Weltmodelle” in der Praxis bedeuten, nicht in Pressemitteilungen.

Was Google Genie 3 tut

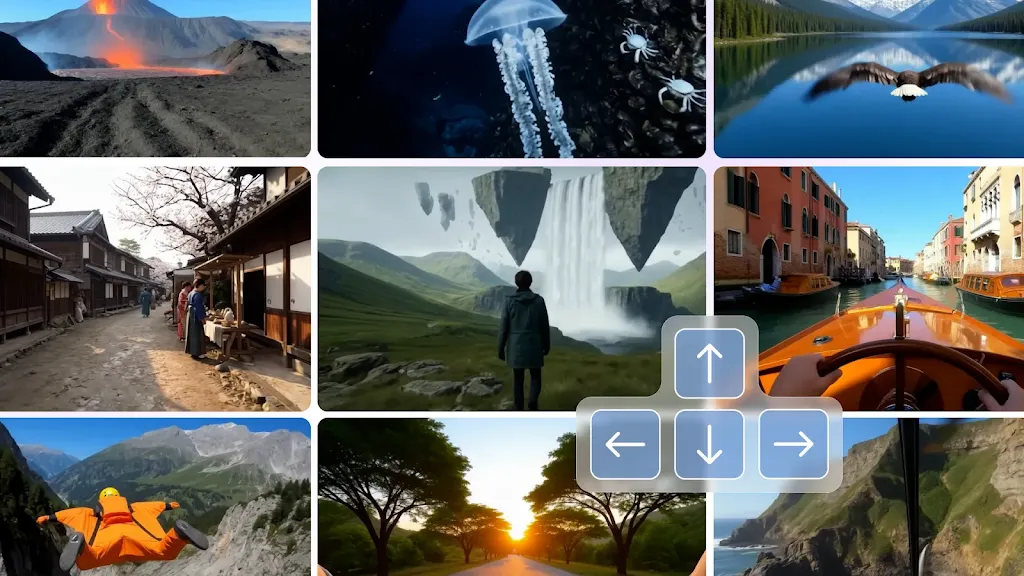

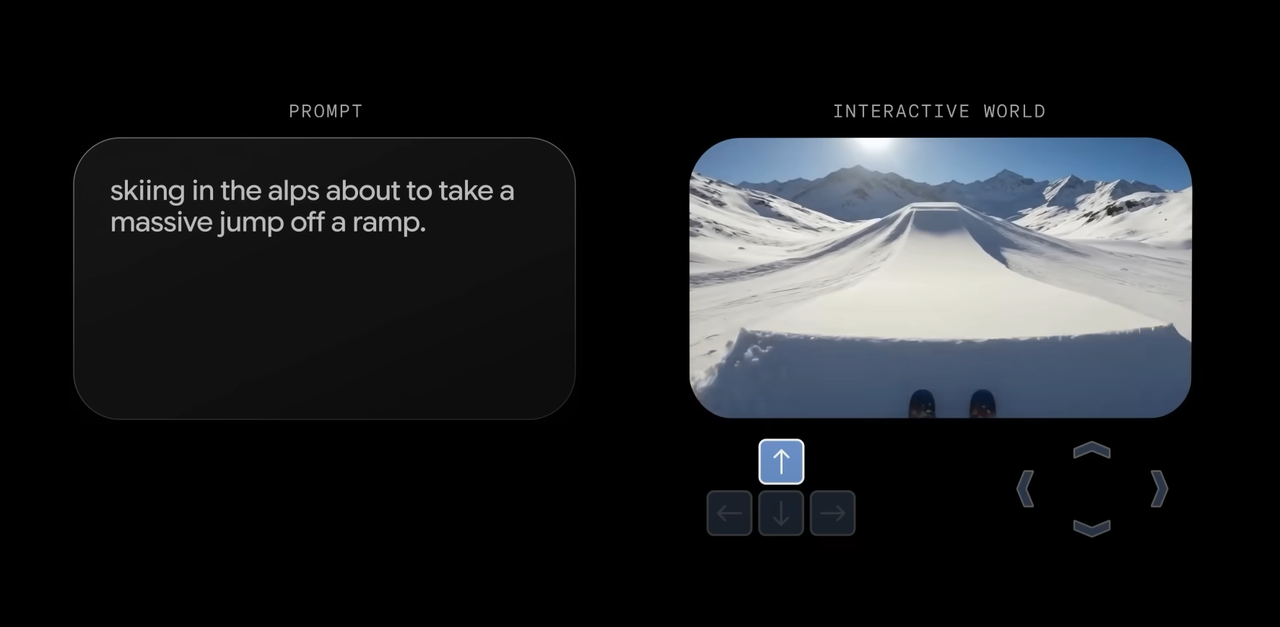

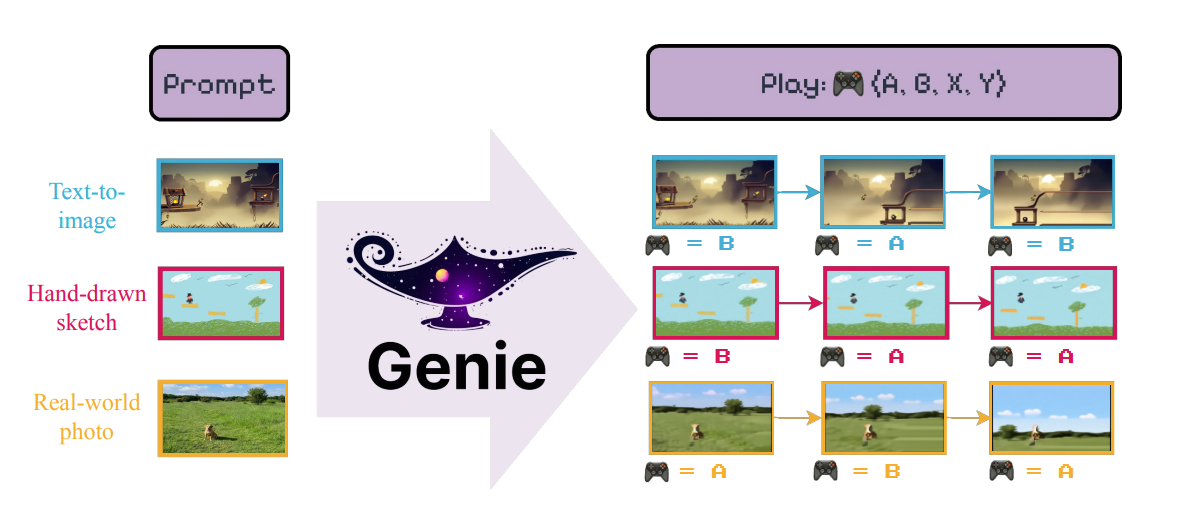

Auf hoher Ebene wird Genie 3 als ein Weltmodell präsentiert, das Text oder Bilder in interaktive, spielbare Szenen umwandeln kann – denken Sie an kurze 2D oder stilisierte 3D-Schnipsel, die Sie tatsächlich kontrollieren können, anstatt sie nur anzuschauen. In den Demos von Google/DeepMind skizzieren oder beschreiben Sie eine Szene, und das Modell erzeugt eine konsistente Umgebung mit Objekten, physikalischen Regeln und einer kontrollierbaren Figur. Das Endergebnis sieht wie Video aus, verhält sich aber wie ein winziges Spiel.

Auf hoher Ebene wird Genie 3 als ein Weltmodell präsentiert, das Text oder Bilder in interaktive, spielbare Szenen umwandeln kann – denken Sie an kurze 2D oder stilisierte 3D-Schnipsel, die Sie tatsächlich kontrollieren können, anstatt sie nur anzuschauen. In den Demos von Google/DeepMind skizzieren oder beschreiben Sie eine Szene, und das Modell erzeugt eine konsistente Umgebung mit Objekten, physikalischen Regeln und einer kontrollierbaren Figur. Das Endergebnis sieht wie Video aus, verhält sich aber wie ein winziges Spiel.

Der Pitch ist subtil, aber wichtig: Statt einzelne Frames zu rendern, die nur aus der Ferne richtig aussehen, versucht ein Weltmodell die Dynamik darunter zu erlernen. Wenn Sie nach links drücken, bewegt sich die Figur auf eine Weise, die immer noch zur Welt passt, die sie gerade imaginiert hat. Wenn ein Ball fällt, verhält sich die Schwerkraft jedes Mal gleich. Diese Konsistenz ist der Unterschied zwischen einem coolen Clip und einem Werkzeug, das Sie verwenden können.

Was mir beim Vergleich von Genie 3s Demos mit früheren Genie-Iterationen auffiel, ist der Schub hin zu längeren, kohärenteren Rollouts. Frühere Genies konnten lustige, Single-Level-Spielzeuge produzieren: Genie 3 scheint Regeln länger zu halten, sodass Aktionen zusammenhängen, ohne dass die Szene auseinanderfällt. Ich sage „scheint”, weil ich keinen direkten Zugang zum genauen Forschungs-Build habe. Aber die Clips zeigen weniger seltsame Fehler, weniger Momente, in denen eine Figur durch eine Wand klippt oder in denen Texturen schmelzen, wenn die Kamera schwenkt. Das Upgrade scheint weniger um Glanz zu gehen und mehr um Stabilität.

In der Praxis, so würde ich etwas wie das heute nutzen, wenn es in meiner Werkzeugkiste wäre:

- Rohversion eines Prototypen: Verwandeln Sie ein skizziertes Layout in ein spielbares Mock-up, damit Stakeholder Timing und Affordances spüren können, nicht nur sehen können.

- Bewegungsideen erkunden: Generieren Sie Varianten von Übergängen oder Interaktionen und wählen Sie diejenige aus, die sich in der Hand richtig anfühlt.

- Unterrichten oder testen: Bauen Sie kleine, begrenzte Welten, um eine Abfolge von Aktionen zu überprüfen, wie Onboarding-Flows oder Trainingsaufgaben.

Das ist der Reiz. Nicht Magie, nur weniger Reibung in den frühen Durchgängen.

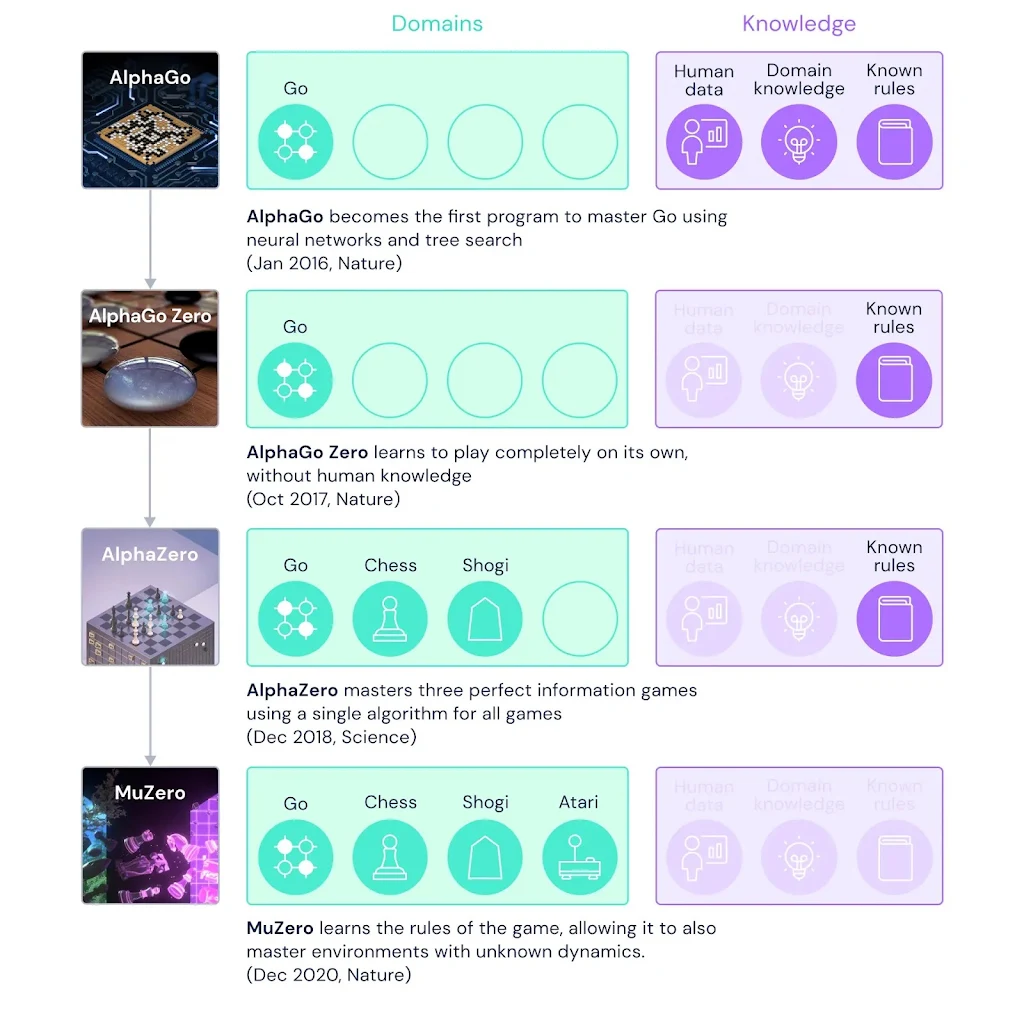

Wie Weltmodelle funktionieren

Ich werde nicht mit Jargon aufwarten. Die Kernidee: Ein Weltmodell versucht zu lernen, wie sich eine Szene im Laufe der Zeit verändert, nicht nur wie sie aussieht. Wenn Sie Arbeiten wie MuZero oder Dreamer gesehen haben, wird Ihnen der Faden vertraut vorkommen – lerne eine kompakte Darstellung des Zustands, prognostiziere wie er sich mit Aktionen entwickelt, und sample Bilder, die charaktergetreu bleiben.

Ein paar praktische Dinge, die ich im Hinterkopf behalte, wenn ich „Weltmodell” höre:

Ein paar praktische Dinge, die ich im Hinterkopf behalte, wenn ich „Weltmodell” höre:

- Es gibt ein internes Gedächtnis der Szene. Das Modell zeichnet nicht jeden Frame von vorne neu: es behält die Kontrolle über Entitäten und Regeln, sodass die Bewegung Kontinuität hat.

- Aktionen zählen. Statt nur den nächsten Frame vorherzusagen, prognostiziert es den nächsten Zustand bei einer bestimmten Aktion (Springen, Drehen, Kollision). Das macht es spielbar.

- Kohärenz kostet Rechenleistung. Längere, stabile Rollouts bedeuten sorgfältigeres Training und Inferenz. Wenn sich etwas langsam anfühlt, ist das oft der Grund.

Weltmodell vs. Videogenerator

Die meisten Videogeneratoren heute erzeugen plausible Pixel und hoffen, dass Ihr Gehirn die Lücken füllt. Sie glänzen mit kurzen, kinematischen Ausbrüchen und schnellen Schnitten. Aber versuchen Sie, sie zu kontrollieren, und die Illusion bröckelt. In dem Moment, in dem Sie Input hinzufügen, muss sich das Modell daran erinnern, was existiert, wo es ist und wie es sich verhält.

Ein Weltmodell dreht die Priorität um: Erst erinnern, dann rendern. Es kostet mehr Aufwand – Daten, Training, Schutzvorrichtungen – aber es zahlt sich in Interaktivität aus. In meinen Notizen schrieb ich: „Videogenerierung ist ein Geschichtenerzähler: Weltmodell ist ein Bühnenmanager.” Keine perfekte Analogie, aber sie erklärt, warum sich Genie 3 anders anfühlt. Sie fragen nicht nur: „Kannst du das wie einen Platformer aussehen lassen?” Sie fragen: „Kann ich es zweimal spielen und die gleichen Regeln bekommen?” Das ist die Messlatte, die für die Arbeit zählt.

Wichtigste gezeigte Fähigkeiten

Da ich keinen direkten Zugang zum Genie 3-Build hatte, verankerte ich mich in dem, was sichtbar und konsistent über offizielle Demos und Paper hinweg ist, und in dem, was ich mit älteren öffentlichen Artefakten reproduzieren konnte. Hier sind die Teile, die bedeutsam wirkten:

Da ich keinen direkten Zugang zum Genie 3-Build hatte, verankerte ich mich in dem, was sichtbar und konsistent über offizielle Demos und Paper hinweg ist, und in dem, was ich mit älteren öffentlichen Artefakten reproduzieren konnte. Hier sind die Teile, die bedeutsam wirkten:

- Prompt-zu-spielbaren Szenen: Umwandlung von Text oder Skizzen in kleine Umgebungen, die Sie kontrollieren können. In älteren Genie-Materialien konnte ich aus einem groben Sprite-Sheet in Minuten einen einfachen Platformer erstellen. In Genie 3 Demos zeigt sich die gleiche Idee mit besserer Stabilität und längeren Sequenzen. Die Sprungbögen sehen reproduzierbar aus. Kollisionen sehen weniger matschig aus.

- Regelbeständigkeit über die Zeit: Das ist der leise Gewinn. Bei Video-Gen driften längere Clips oft, Objekte verformen sich, Beleuchtung stottert, Layouts kriechen. In Genie-ähnlichen Weltmodellen bleiben die „Physik” und Objektidentitäten bestehen. Ich sah weniger Kontinuitätsbrüche in den Genie 3-Clips im Vergleich zu früheren.

- Bearbeitbare Startzustände: Einige Demos zeigen das Seeding der Welt aus einem Bild oder Layout, dann von dort aus spielen. Das ist wichtiger als es klingt. Es bedeutet, dass ich mich in meinem Werkzeug der Wahl grob einarbeiten kann und dann zu einem spielbaren Test übergehen kann, ohne Assets neu zu erstellen.

- Aktionsbedingte Rollouts: Das Modell reagiert auf Eingaben mit konsistenten Ergebnissen. Nach links drücken: Sie bewegen sich nach links. Oben drücken neben einer Kante: Sie greifen sie. Das klingt grundlegend, aber es ist der Unterschied zwischen einem Spielzeug und einem Testbett.

- Stilisierte aber lesbare Visuals: Der Look sitzt irgendwo zwischen Retro-Spielkunst und malerei-artigen Video. Es ist nicht fotorealistisch, was für viele Workflows ein Feature ist. Sie bekommen Klarheit ohne unheimliche Kanten.

- Längere Horizonte, immer noch begrenzt: Ich bemerkte Rollouts, die sich wie Dutzende von Sekunden mit stabilen Regeln anfühlen. Aber sie sind keine Open-World-Sandboxen. Die Räume sind absichtlich kompakt, was ehrlich gesagt in Ordnung ist für die meisten Prototyping.

Wo es ein bisschen rieb:

- Latenz und Iterationsgeschwindigkeit: In früheren Experimenten wartete ich oft länger als ich wollte, bis sich eine neue „Welt” stabilisierte. Wenn Genie 3 schwerer ist, erwarte ich ähnliche Wartezeiten. Das ist in Ordnung, wenn die Outputs wiederverwendbar sind, weniger in Ordnung, wenn Sie erkunden.

- Kontrolle über Constraints: Designer wollen Regler: Schwerkraftstärke, Reibung, Kollisionstoleranz. Die Demos zeigen selten explizite Knöpfe. Wenn Kontrolle existiert, ist sie wahrscheinlich in Prompts oder versteckten Parametern versteckt. Ich würde sichtbare Schieberegler bevorzugen.

- Asset-Übergabe: Auch wenn sich eine Szene richtig anfühlt, ist der Export in eine Produktions-Pipeline nicht trivial. Sprite-Extraktion, Hitboxen, State Machines – das sind Klebaufgaben. Ich habe in öffentlichen Materialien noch keine klaren Pfade gesehen.

Eine kleine Freude aus meinen Seitentests mit früheren Genie-Artefakten: Die mentale Belastung sank. Ich war nicht auf der Suche nach dem „richtigen” Plug-in, um Physik in einem Mock zu fälschen. Ich tippte, generierte und schob eine Figur herum. Es machte mich anfangs nicht schneller, aber es machte mich weniger angespannt. Das war wichtiger als ich erwartet hatte.

Aktueller Zugriffsstatus

Ab früher Februar 2026 sitzt Genie 3 im Forschungsland. Es gibt Papers, Talks und Demo-Videos. Ich habe keinen breiten, öffentlichen API gesehen, bei dem Sie sich mit einem Google-Konto anmelden können, und ich habe keinen Consumer-Release in einem Workspace-Tool. Wenn Sie dies später lesen und das sich geändert hat, großartig, geben Sie mir Bescheid und ich werde aktualisieren.

Wo man jetzt suchen sollte:

- Offizielle Forschungsposts von Google DeepMind. Beginnen Sie mit dem ursprünglichen Genie-Paper und Blog für Grundlagen, dann überfliegen Sie Follow-up-Talks, die „Genie 2” oder „Genie 3” als interne Iterationen erwähnen.

- Konferenzaufzeichnungen und Lab-Demos. Sie zeigen oft die neuesten Rollouts Monate bevor ein öffentlicher Preview vorhanden ist.

- Akademische Preprints, die „world-model video generation” oder „interactive environment generation” referenzieren. Die Nomenklatur variiert, aber die Mechaniken reimen sich.

Praktische Erkenntnisse, wenn Sie entscheiden, ob Sie warten, bauen oder ignorieren sollen

- Wenn Sie viel Interaktionen prototypisieren (Produkt, Spiel, Lernen), behalten Sie Genie im Auge. Selbst ein begrenzter öffentlicher Preview würde für Vorvisualisierung und Gefühlstests nützlich sein.

- Wenn Sie heute Produktions-Assets benötigen, planen Sie nicht danach. Behandeln Sie es als einen Skizzen-Begleiter, nicht als eine Pipeline.

- Wenn Sie sich um Forschungs-Replikation kümmern, können Sie immer noch viel lernen, indem Sie mit offenen Weltmodell-Projekten wie Dreamer-Varianten spielen und Genies Methodenteile lesen. Die Prinzipien übertragen sich.

Ich werde einen kleinen, leicht langweiligen Hinweis hinzufügen. Der Suchbegriff „Genie 3 Google” zieht eine Mischung aus älteren Genie-Posts und neueren Weltmodell-Nachrichten. Einige Write-ups verwischen Marketing und Forschung. Im Zweifelsfall verfolgen Sie Ansprüche zurück zum DeepMind-Blog oder den Paper-PDFs. Es spart Zeit und hält Erwartungen stabil.