WAN 2.2 LoRA-Trainingseinstellungen: Beste Learning Rate, Schritte und Trigger-Wörter

Hallo meine Freunde. Wisst ihr? Mir gefiel, wie WAN 2.2 mit Haut und Beleuchtung umging, aber meine üblichen LoRA-Trainingsgewohnheiten ließen sich nicht sauber übertragen. Gesichter sahen zu glänzend aus, und das Modell zog ständig Hintergründe in denselben weichen Studio-Look. Es war nicht “falsch”, nur nicht meins. Also führte ich Anfang Januar 2026 eine Handvoll kurzer Experimente durch, um WAN-2.2-spezifische LoRA-Trainingseinstellungen zu finden, die sinnvoll erschienen. Nichts Spektakuläres. Nur genug, um den Kunststoffglanz zu reduzieren, ein Motiv stabil zu halten und dem Basismodell trotzdem Spielraum zu geben.

Falls du nach einer schnellen Vorlage suchst: das ist nicht sie. Ich teile, was sich über mehrere Durchläufe bewährt hat, wo ich gezögert habe und wie ich angepasst habe. Das Zielschlüsselwort hier ist klar, WAN-2.2-LoRA-Trainingseinstellungen, aber das Ziel ist ruhigere Arbeit, nicht ein neues Kaninchenloch.

Warum WAN LoRA anders ist

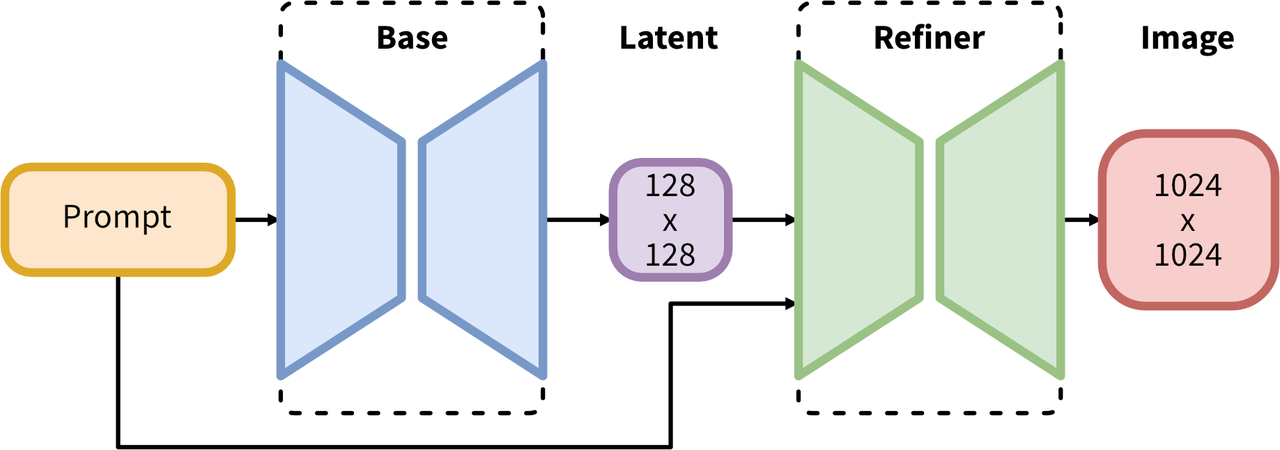

Ich bemerkte, dass WAN 2.2 sich verhält wie ein sehr eigensinniger SDXL-Checkpoint: Es ist für knackige Porträts, sanfte Farbverläufe und kinematisches Licht optimiert. Als ich LoRAs so trainierte wie auf einfacheren SDXL-Basen, drückte WAN meine Ergebnisse immer wieder zu diesem polierten Studio-Feeling zurück.

Feldnotizen:

- Die Prompt-Schwerkraft ist stark. Selbst niedrige Gewichte (0,4–0,6) ziehen zu sauberer Haut und symmetrischen Rahmen.

- Farbclustering erscheint früh. Wenn dein Datensatz warm wirkt, verstärkt WAN das.

- Hintergründe verschmelzen. Ohne Eingriffe wird es immer zu flacher Schärfentiefe und weichem Bokeh, egal was du einfütterst.

Was sich in der Praxis änderte: Ich senkte die Lernraten, nutzte mehr Regularisierungsbilder als üblich und hielt die Bildunterschriften absichtlich einfach. WAN 2.2 belohnt Zurückhaltung. Als ich versuchte, Stil und Motiv gleichzeitig zu “lehren”, kamen schnell Überanpassungen auf.

Wenn du von SD-1.5-LoRA-Gewohnheiten kommst, denk: weniger clevere Tricks, mehr kontrollierte Baselines. Wenn du SDXL gewöhnt bist, geh ein bisschen langsamer als normal und bake Regularisierung früher ein.

Größenleitfaden für Datensätze

Ich führte vier Durchläufe mit kuratierten Porträtmengen durch (5.–12. Januar 2026), jeweils mit ordentlichen Bildunterschriften und gemischter Beleuchtung. Hier ist, was sich bewährt hat:

- 8–12 Bilder: Genug, um eine bestimmte Person oder ein Produktprofil zu verankern. Nutze starke Regularisierung. Halte Kompositionen vielfältig.

- 15–30 Bilder: Sweet Spot für Einzelmotiv-Identität mit leichtem Stil. Füge 20–40% Nicht-Porträt-Aufnahmen hinzu, wenn du möchtest, dass sich Hintergründe verallgemeinern.

- 40–80 Bilder: Nützlich, wenn du einen konsistenten Brand-Look oder eine Multi-Winkel-Produktlinie kodierst. Du brauchst sorgfältige Bildunterschriften und mehr Schritte.

Dinge, die wichtiger waren als die reine Anzahl:

- Pose-Vielfalt über Orts-Vielfalt. WAN verallgemeinert Orte gut: es kämpft, wenn jede Aufnahme denselben Winkel hat.

- Belichtungsausgleich. Wenn die Hälfte deines Satzes unterbelichtet ist, verdunkelt WAN später alles. Ich standardisierte Histogramme vor dem Training.

- Bildunterschrift-Einfachheit. Deskriptiv, nicht poetisch. “subject_token, Jeansjacke, Fensterlicht, mittlere Nahaufnahme” schlägt “stimmungsvolles Candid-Porträt neben einem regnerischen Fenster”.

Für Identitäts-LoRAs landete ich bei 12–20 Bildern als zuverlässige Untergrenze. Für Stil-LoRAs gaben mir 30–50 Raum zum Atmen, ohne zu WANs Standard-Porträt-Glanz zu kollabieren.

LR/Schritte-Baseline

Die WAN-2.2-LoRA-Trainingseinstellungen, die sich für mich stabil anfühlten (Kohya-ss und SDXL-Basis):

- Rank (dim): 16–32. Ich standardmäßig 16 für Identität, 32 für Stil.

- Alpha: entspricht dim (z.B. 16/16). Niedrigeres Alpha machte Ergebnisse spröde.

- Optimizer: AdamW mit weight_decay 0,01.

- Lernrate: 5e-5 für Identität, 7e-5 bis 1e-4 für Stil. WAN bestraft hohe LR mit plastischer Haut und Verlustspitzen.

- Scheduler: Kosinus mit Warmup. Warmup 5% der Gesamtschritte.

- Batch-Größe: 2–4 (A100/4090). Gradient-Akkumulation zur Simulation von 8, falls nötig.

- Auflösung: SDXL-nativ 1024 auf der langen Seite mit Bucketing (z.B. 1024×768, 1024×1024). Keine Vergrößerung: es merkt sich nur Rauschen.

- Epochen/Schritte: Ich höre nach Schritten auf, nicht nach Epochen.

- 12–20 Bilder: 1.200–2.000 Schritte

- 30–50 Bilder: 2.000–3.500 Schritte

- 60–80 Bilder: 3.500–5.000 Schritte

Sanity Checks, die ich nutzte:

- Alle 200–400 Schritte speichern und mit festem Prompt + Seed in der Vorschau anzeigen.

- Wenn Proben vor Schritt 600 zu schnell schärfen, ist die LR hoch.

- Wenn Identität nicht um ~1.400 Schritte bei einem 20-Bild-Satz gesperrt ist, sind Bildunterschriften oder Regularisierung stärker aus als LR.

Diese Zahlen gewinnen kein Leaderboard, aber sie widerstehen WANs Tendenz, alles glatt zu machen.

Trigger-Wort-Strategie

Ich hielt Trigger minimal. WAN hat bereits einen starken Prior: Nette Tokens stapeln fügt nur Rauschen hinzu.

Das habe ich getan:

- Ein Instance-Token + ein Class-Token. Beispiel: “sora_person” als die Instanz, “person” oder “woman/man” als die Klasse in Bildunterschriften.

- Platziere das Instance-Token am Anfang jeder Bildunterschrift. Halte es kleingeschrieben, ein Wort wenn möglich.

- Vermeide Style-Tokens in derselben LoRA, es sei denn, du möchtest wirklich eine Style-LoRA. Das Mischen von Identität und Stil in WAN 2.2 wurde schnell matschig.

In Prompts rufe ich nur die LoRA und das Instance-Token auf, dann schichte sanfte Lenkung:

- lora: Name bei 0,5–0,8

- Instance-Token früh im Prompt

- Style-Wörter spät und leicht (“natürliches Licht, saubere Farbe, minimale Retusche”)

Ich versuchte aus Neugier erfundene “WAN-Style”-Trigger. Sie halfen nicht. Die Basis macht diesen Teil bereits, die LoRA sollte ausschneiden, was du brauchst, nicht erneut ankündigen, worin WAN 2.2 gut ist.

Regularisierungsbilder

Das war der stille Held. Ich nutzte 1–3x Regularisierungsbilder pro Trainingsbild, klassengegenüber zu Bildunterschriften.

- Für Identitäts-LoRAs: 20–60 Reg-Bilder mit derselben Klasse (“person”). Ich erstellte sie von WAN 2.2 selbst mit einfachen Prompts: “Foto einer Person, neutraler Hintergrund, mittlere Nahaufnahme, natürliches Licht.”

- Für Objekt-LoRAs: Reg-Bilder pro Produktklasse (“Schuh”, “Flasche”, “Stuhl”). Halte sie genau: keine Klassen mischen.

Warum es wichtig war: WAN 2.2 mag es, seine Porträt-Ästhetik auf alles zu drucken. Reg-Bilder gaben ihm die Erlaubnis, die Reichweite der Basis zu halten, während die LoRA Identität festhielt. Ohne sie betonten meine LoRAs übermäßig Hautglättung und Bokeh und wollten dann nicht weg.

Einstellungen, die richtig schienen:

Einstellungen, die richtig schienen:

- Halte Reg-Bilder visuell einfach und gut belichtet.

- Beschriften Reg-Bilder nicht mit Instance-Tokens: nur die Klasse.

- Mische 10–20% der Trainingsbatches mit Reg-Bildern durchgehend (nicht nur am Anfang).

Falls dir die Zeit kurz wird, füge Reg-Bilder hinzu, bevor du den Optimizer anpasst. Es ist hier der größere Hebel.

Überanpassungs-Erkennung

Ich verließ mich nicht nur auf den Verlust. WAN versteckt Überanpassung hinter schönen Proben. Das waren meine Anzeichen:

- Prompt-Trägheit: Das Ändern des Prompts ändert kaum die Ausgabe. Alles driftet zurück zum gleichen Objektiv und Hintergrund.

- Hautplastizität: Poren verschwinden gleichmäßig, besonders um Wangen und Stirn, selbst mit körnigen Beleuchtungs-Prompts.

- Pose-Echo: wiederholte Schulter-/Nackenwinkel über verschiedene Seeds.

- Farb-Sperre: Ein warmer Farbton, der über verschiedene Weißabgleich-Hinweise hängt.

Schnelle Checks, die ich alle 200–400 Schritte lief:

- Gegner-Prompt: Wechsele zu “hartes Overhead-Bürolicht, Leuchtstoff, unvorteilhaft” und schau, ob Textur zurückkommt.

- Hintergrund-Flip: Erzwinge “belebte Straße, vollgestellt mit Regalen” um Kompositions-Flexibilität zu testen.

- Negativer Prompt-Druck: Füge “über-glatte Haut, Kunststoff-Textur, schwere Retusche” hinzu und schau, ob es zuhört.

Falls zwei dieser Tests hintereinander fehlschlugen, rollte ich zum vorherigen Checkpoint zurück und fügte entweder mehr Reg-Bilder hinzu oder senkte LR einen Schritt.

Kollapsen beheben

Ich traf zwei Arten von Kollapsen: Identitäts-Schmelze und Style-Sperre.

Wenn Identität schmolz (Gesichter trieben, Augen verliefen sich):

- Senke LR einen Schritt (z.B. 7e-5 → 5e-5).

- Erhöhe Rank von 16 auf 32 nur, wenn der Datensatz genug Winkel hat: sonst merkt er sich Poses, nicht Identität.

- Strenge Bildunterschriften an: Schneide Adjektive, behalte Brennweiten-Hinweise, halte Instance-Token vorn.

- Füge 10–20 mehr Reg-Bilder derselben Klasse hinzu.

Wenn Style gesperrt war (alles sah wie WANs Standard-Studio-Porträt aus):

- Füge Nicht-Porträt-Aufnahmen zum Datensatz hinzu (Umgebung, Hände, Teilkörper).

- Erhöhe Schritte um 400–800 mit Kosinus-Schedule: kein LR-Spike.

- Reduziere LoRA-Gewicht bei Inferenz (0,8 → 0,5) und senke Guidance (CFG 5–6 → 3,5–4,5). WAN antwortet gut auf niedrigeres CFG.

- Falls Noise Offset oder schwere Farb-Aug genutzt, drehe sie zurück. WAN stabilisiert bereits Farbe: Extra-Aug machte meine Ausgaben matschig.

Andere Knöpfe, die halfen:

- Gradient Clipping bei 1,0 um plötzliche Spitzen zu vermeiden.

- EMA aus für kleine Läufe: Bei winzigen Datensätzen ließ EMA Identität hinter Vorschaubildern zurück.

- Seed-Disziplin: Alle vorschauen mit festem Seed. Kleine Änderungen sind leichter zu beurteilen, wenn alles sonst stillsteht.

Export & Wiederverwendung

Ein paar Gewohnheiten sparten mir später Zeit:

- Speichere inkrementelle Checkpoints mit klaren Namen: Modell, Rank, LR, Schritte und Datum. Beispiel: wan22_lora_id_r16_lr5e-5_s1800_2026-01-09.safetensors.

- Halte den Training-Prompt, Validierungs-Prompt und Seed in den LoRA-Metadaten, falls dein Tool das unterstützt. Zukünftiges Ich dankt immer vergangenem Ich.

- Versions-sticky Nutzung: LoRAs trainiert auf WAN 2.2 funktioniert best auf WAN 2.2 und nahe Verwandte. Sie waren auf anderen SDXL-Basen nutzbar, aber Farb- und Hautbehandlung verschob sich. Ich behandle sie als “WAN-first”.

- Inferenz-Defaults, die sich gut anfühlten:

- LoRA-Gewicht 0,5–0,8 (Identität), 0,3–0,6 (Stil-Overlay)

- CFG 3,5–5,5

- 30–40 Schritte mit einem stabilen Sampler (DPM++ 2M Karras funktionierte gut)

- Halte Prompts kurz: WAN hört subtile Nudges

Falls du LoRAs mergen möchtest: Ich hatte besseres Glück mit dem Stapeln von kleinen, zweckgebundenen LoRAs (Identität bei 0,6 + milder Farb-Look bei 0,3) als mit dem Training einer großen “alles” LoRA. WAN respektiert Modularität.

Für detailliertere WAN-2.2-Workflows und Beispiele, sieh dir die offizielle ComfyUI-Dokumentation an.

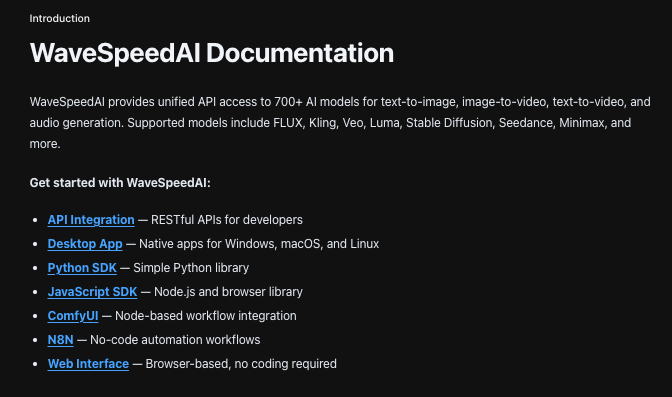

Zum Trainieren bevorzuge ich immer noch, Dinge lokal auszuführen, wo ich jeden Knopf sehen kann. Aber wenn es um Inferenz, Modell-Routing oder den Wechsel zwischen Basismodellen ohne API-Jonglage geht, kannst du unser WaveSpeed probieren. Es hält verschiedene Modelle hinter einem konsistenten Endpunkt, damit ich mich auf Prompts und Ausgaben konzentrieren kann, statt auf Infrastruktur.

Zum Trainieren bevorzuge ich immer noch, Dinge lokal auszuführen, wo ich jeden Knopf sehen kann. Aber wenn es um Inferenz, Modell-Routing oder den Wechsel zwischen Basismodellen ohne API-Jonglage geht, kannst du unser WaveSpeed probieren. Es hält verschiedene Modelle hinter einem konsistenten Endpunkt, damit ich mich auf Prompts und Ausgaben konzentrieren kann, statt auf Infrastruktur.