LTX-2 VRAM-Anforderungen: 12GB vs 24GB Reality Check (4K@50fps getestet)

Hallo, ich bin der Typ, der die VRAM-Speicherkapazität seiner GPU als mürrischen Hausverwalter personifiziert hat, der mich sofort rauswirft, sobald ich eine etwas ehrgeizigere Party schmeisse. Schön dich kennenzulernen—ich bin hier, um meine Narben aus einer Woche OOM-Krieg im Januar 2026 mit dir zu teilen.

Beim ersten Mal, dass LTX-2 bei mir abstürzte, war es nicht dramatisch. Einfach nur eine stille “out of memory”-Meldung und ein Seufzer, den ich mir normalerweise für einen Druckerstau aufspare. Ich trieb nichts Wildes, einfach ein kurzer Clip, einfacher Prompt, aber die VRAM-Mathematik kümmert sich nicht um Absichten. Der mürrische Hausverwalter war gar nicht begeistert. … vertrau mir.

Über die letzte Woche (Jan 2026) hielt ich Notizen fest, während ich LTX-2 auf einer 12GB Laptop-GPU, einer 16GB Desktop-Grafikkarte und einer ausgeliehenen 24GB-Maschine laufen ließ. Nichts Wissenschaftliches. Einfach nur Durchläufe, Neustarts und eine simple Frage: Wie weit kann ich gehen, bevor VRAM mich auf die Schulter tippt? Das ist das, was wirklich zählte.

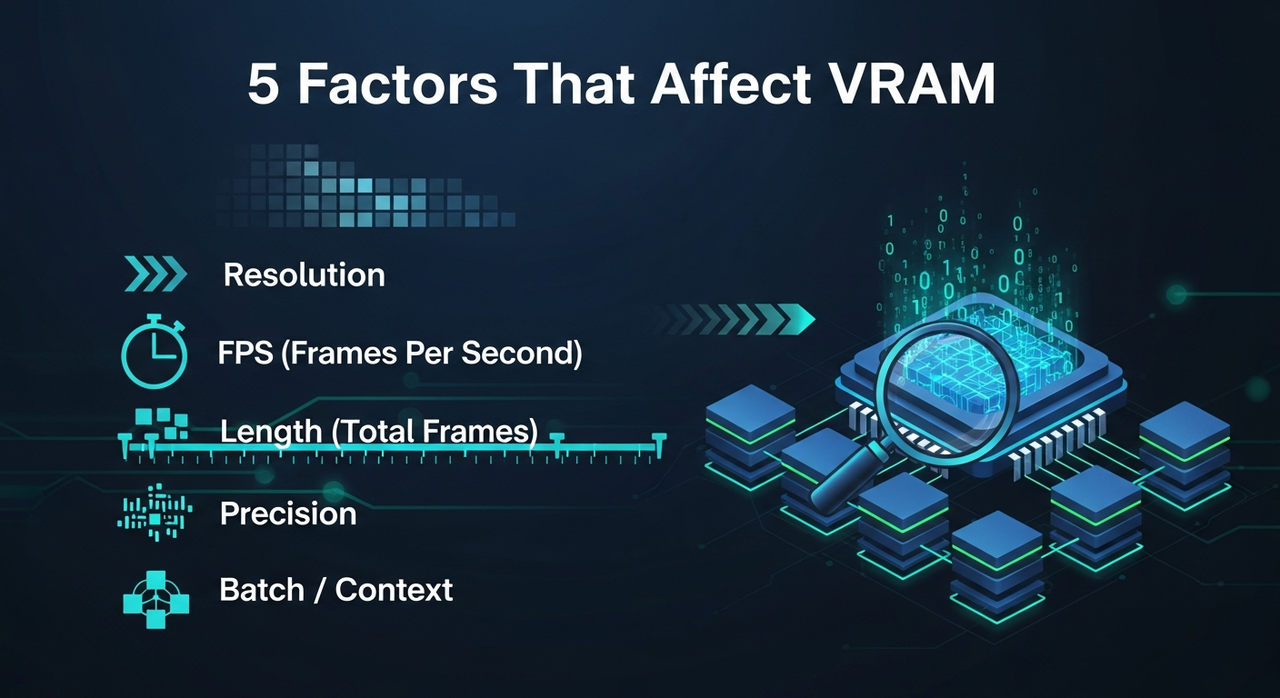

5 Faktoren, die VRAM beeinflussen (Auflösung / fps / Länge / Präzision / Batch)

Hier ist die kurze Liste, die ich in der Praxis gespürt habe, nicht nur aus den Dokumenten.

Hier ist die kurze Liste, die ich in der Praxis gespürt habe, nicht nur aus den Dokumenten.

1. Auflösung

Die Verdoppelung von Breite und Höhe vervierfacht die Pixelanzahl ungefähr. Modelle wie LTX-2 spüren das sofort. 720p zu 1080p ist der Schritt, der einen Durchlauf oft von gut zu fragil kippen lässt. 4K ohne Tricks? Das ist der Punkt, wo das Kartenhaus wackelt.

2. FPS

Mehr Bilder pro Sekunde bedeuten mehr Bilder, die während bestimmter Phasen im Speicher gehalten oder vorbereitet werden. Wenn du nahe am Limit bist, kann ein Rückgang von 25 auf 16 fps eine kleine Änderung sein, die überraschend viel VRAM freisetzt und Puffer für Konsistenz schafft. Sag dir, es hat mehr Durchläufe gerettet, als ich zählen kann.

3. Länge (Gesamtzahl Bilder)

Länge dehnt alles aus. Einige Pipelines unterteilen Bilder, andere versuchen, größere Kontextpools zu halten. In jedem Fall sind 4–6 Sekunden normalerweise entspannt, 10–12 Sekunden wird eng, 20 Sekunden ist der Punkt, wo ich anfange zu planen, nicht zu hoffen.

4. Präzision

fp16 ist der Standard-Sweet-Spot für mich. bf16 war auf der 24GB-Box ähnlich, aber fp32 trieb den Verbrauch in die Höhe und wirkte zwecklos für die Generierung. Falls du einen stabilen 8-Bit- oder quantisierten Pfad siehst, ist er auf Low-VRAM einen Versuch wert, aber ich behandelte ihn als experimentell.

5. Batch / Kontext

Jede Form von Batching, Multi-Seed-Sampling oder langer zeitlicher Kontext wirkt wie ein Multiplikator. Wenn ich den Batch vergaß auf 1 zurückzusetzen, zahlte ich sofort dafür.

Kleine Anmerkung: Aktiviere effiziente Aufmerksamkeit/Backends, falls dein Build diese unterstützt. Ich sah bescheidene Gewinne durch speichereffiziente Aufmerksamkeit und page-locked I/O: nicht Himmel und Erde, aber genug, um einen Durchlauf vom Kippen abzuhalten.

Real-World Configs: 12GB / 16GB / 24GB GPUs

Das sind die Setups, die ich ohne Babysitting wiederholen konnte. Deins wird je nach Treiber, Build und was sonst noch dein System tut, variieren.

12GB (Laptop 3060-Klasse)

- Stabil: 576p–720p, 5–8 Sekunden, 16–24 fps, fp16, batch=1.

- Marginal: 1080p unter 4–6 Sekunden bei 12–16 fps mit konservativen Einstellungen.

- Hinweise: VRAM-Spitzen während der ersten Schritte waren normalerweise der Ausfallpunkt. Vorschau ausschalten und andere GPU-Apps schliessen half.

16GB (Desktop 4080-Klasse)

- Stabil: 1080p, 6–10 Sekunden, 16–24 fps, fp16.

- Marginal: 1080p bei 12–15 Sekunden, wenn ich fps senkte oder Segmentierung nutzte.

- Hinweise: Das ist die erste Stufe, auf der “es funktioniert einfach” für 1080p anfängt zu gelten. Ich vermied immer noch Batching.

24GB (4090-Klasse)

- Stabil: 1080p, 12–20 Sekunden, 24 fps, fp16, Platz für sanfte Guidance-Anpassungen.

- Marginal: 4K via Tiling oder segmentierte Durchläufe: gut für kurze Clips, aber du spürst den Overhead.

- Hinweise: Falls du Platz für Experimente möchtest (Masken, Edits, längere Prompts), fühlte sich 24GB ruhig an. Nicht übertrieben, einfach ruhig.

4K@50fps: Ist es erreichbar und zu welchen Kosten

Kurze Antwort: Ja, aber nicht so, wie ich gehofft habe.

Direktes 4K bei 50 fps von LTX-2 ist der Punkt, wo VRAM und Zeit beide protestieren. Auf 24GB bekam ich nur kurze Bursts zum Laufen, und selbst dann sah ich Qualitätsfluktuationen und OOM-Risiko, sobald ich die Länge ankurbelte.

Was besser funktionierte

- Generiere bei 1080p, 12–16 fps, halten es sauber.

- Hochskaliere auf 4K mit einem dedizierten Upscaler (Topaz-Stil oder ESRGAN-Varianten, falls du auf der Open-Source-Seite lebst).

- Interpoliere Bilder auf 50 fps mit RIFE/Flowframes-ähnlichen Tools.

Kompromisse, die ich bemerkte

- Zeitliche Konsistenz hielt besser, wenn ich zuerst hochskalierte, dann interpolierte.

- Interpolation kann ein weiches Seifenopern-Gefühl hinzufügen. Dreh es herunter oder füge eine winzige Menge Körnung danach hinzu.

- Die “nativ 4K”-Clips, die liefen, sahen nicht wesentlich besser aus als 1080p → hochskaliert für meine Zwecke. Sie nahmen einfach länger Zeit und stürzten mehr ab.

Also: erreichbar, ja. Lokal lohnenswert, normalerweise nicht, es sei denn, dein Clip ist unter ~5 Sekunden oder du brauchst wirklich Single-Pass-Reinheit.

Low-VRAM-Strategien (Tiling / Segmentierung / niedrigere fps)

Das sind die, zu denen ich immer wieder kam.

- Intelligent tilen: Falls die Pipeline Tiled Diffusion/Attention unterstützt, nutze es. Überlappe etwas, um Nähte zu verbergen. Es erhöht die Zeit, spart VRAM und bringt dich auf 16–24GB in 4K-Territorium.

- Nach Zeit segmentieren: Rendere 3–4 Sekunden-Chunks, dann nähe zusammen. Es ist nervig, ja, aber es zähmt VRAM-Spitzen und lässt dich Problem-Segmente neu ausrollen.

- Senke zuerst fps, nicht Auflösung: Ein Rückgang von 24 auf 16 fps bewahrte oft das Aussehen und gab Speicher frei. Zuschauer bemerken Auflösungsrückgänge schneller als Frame-Drops bei kurzen Dauern.

- Halte batch=1: Multi-Seed-Durchläufe sind nett: sie verdoppeln auch deine Probleme.

- Schalte Vorschau aus: Live-Vorschau halten manchmal extra Puffer. Headless-Durchläufe waren für mich stabiler.

- Gemischte Präzision an, exotische Präzision aus: fp16 hielt das Gleichgewicht. Ich behandelte 8-Bit-Pfade als letzte Zuflucht.

- Offload wenn möglich: Falls dein Stack CPU- oder Disk-Offload für KV-Caches unterstützt, kann es dir ein paar zusätzliche Sekunden zum Preis der Geschwindigkeit kaufen.

OOM-Troubleshooting-Ablauf

Mein schneller Reset, wenn der Hausverwalter mich rauswirft:

- Starten Sie den Prozess neu, um VRAM-Residuen zu löschen. Vertraue nicht auf partielle Freigaben.

- Setze batch=1, deaktiviere Vorschau, schliesse andere GPU-Apps.

- Senke fps auf 16. Falls es immer noch fehlschlägt, senke die Auflösung um eine Stufe (1080p → 900p oder 720p).

- Verkürze die Länge um 2–3 Sekunden. Teste nochmal.

- Aktiviere Tiled/segmented Rendering, falls verfügbar.

- Stelle sicher, dass fp16 an ist. Vermeide bf16/fp32, es sei denn, du weisst, dass du sie brauchst.

- Wenn es immer noch am Anfang fehlschlägt, ist dein Peak zu hoch (Auflösung/Kontext). Falls es spät fehlschlägt, ist es wahrscheinlich Länge/Kontextwachstum.

- Letzte Zuflucht: Wechsle zu einer Cloud-GPU mit mehr VRAM, beende das Rendering, komm dann zurück lokal.

GPU-Tier-Empfehlungen

Falls du entscheidest, was du kaufen oder ausleihen sollst:

- 12GB: Fine für Entwürfe, 576p–720p, schnelle Ideenfindung und kurze Social-Cuts. Du wirst viel segmentieren.

- 16GB: Guter täglicher Fahrer für 1080p-Arbeit unter ~10 Sekunden. Weniger Hacks, mehr Fluss.

- 24GB: Komfortabel für längeres 1080p, milde 4K-Experimente und Versuch fortgeschrittener Optionen ohne Babysitting.

- 24GB+ (oder Multi-GPU-Cloud): Nutze, wenn Fristen zählen, oder du drückst 4K-Timelines mit weniger Kompromissen.

Ich würde nicht auf Basis eines einzelnen Modells kaufen. LTX-2 wird sich weiterentwickeln: deine Toleranz für Tiling und Nähen nicht.

Wann man Cloud nutzen sollte (WaveSpeed-Kostenvergleich)

Ich halte einfach ein “WaveSpeed”-Blatt, nicht einen Service, einfach eine Kopf-und-Bauch-Art, Dollar pro fertigem Videominute zu vergleichen.

Wie ich schätze (Jan 2026)

- Notiere das Clip-Ziel (z.B. 4K@50 fps, 10 Sekunden).

- Zeitstempel einen sauberen lokalen Durchlauf bei 1080p, dann addiere meine Hochskalierungs-/Interp-Zeit.

- Preisiere eine vergleichbare Cloud-GPU nach Stunde.

Typische Spot-Raten, die ich kürzlich gesehen habe

(sehr grob: überprüfe deinen Anbieter)

- L4/A10G-Klasse: $0,50–$1,20/Stunde

- A100 40/80GB: $1,50–$3,50/Stunde

- H100: $3–$7/Stunde

Beispiel, meine Zahlen letzte Woche

- Lokale 24GB-Box: eine 10-Sekunden-4K@50-fps-Pipeline (1080p gen → Hochskalierung → Interpolation) dauerte ~14 Minuten insgesamt. Stromverbrauch + Verschleiß sind schwer zu preisen, aber ich nenne es $0,10–$0,20/Durchlauf.

- Cloud A100 80GB: dieselbe Pipeline beendete sich in ~6–8 Minuten. Bei ~$2,50/Stunde ist das etwa $0,25–$0,35 pro Durchlauf.

Also meine “WaveSpeed”-Linie für diesen Fall:

- Lokal: billiger pro Durchlauf, langsamer, aber null Warteschlange.

- Cloud: etwas mehr pro Durchlauf, schneller und weniger kompliziert, wenn ich auf OOM stosse.

Wann ich zur Cloud wechsle

- Ich bin auf eine Frist angewiesen und kann OOM-Fixes nicht betreuen.

- Ich brauche einen längeren 1080p oder irgendwelchen ernsthaften 4K-Durchlauf.

- Ich möchte Einstellungen erkunden, ohne Absturzangst zu haben.

Wann ich lokal bleibe

- Kurze Entwürfe, Look-Tests und Prompt-Exploration.

- Ich bin mit 720p/1080p und 6–10 Sekunden ok.

Das funktionierte für mich, deine Kosten und Timing werden unterschiedlich sein. Falls du auf die gleichen Mauern stösst, auf die ich stiess, lohnt sich ein Blick.

Falls du VRAM-Limits triffst oder OOM-Fixes einfach nicht betreuen möchtest, lässt dich WaveSpeed LTX-2 auf grösseren Cloud-GPUs laufen, ohne deinen Workflow zu ändern. Du behältst deine Prompts und Einstellungen—die Hardware hört einfach auf, der Engpass zu sein.

Die stille Überraschung: Sobald ich Durchläufe auf diese Weise preisierte, hörte ich auf, “nativ 4K@50” lokal zu jagen. Ich bekam einfach das Aussehen bei 1080p richtig und liess die Pipeline die Arbeit tun.

Die stille Überraschung: Sobald ich Durchläufe auf diese Weise preisierte, hörte ich auf, “nativ 4K@50” lokal zu jagen. Ich bekam einfach das Aussehen bei 1080p richtig und liess die Pipeline die Arbeit tun.

Also, was ist mit dir? Was ist der absurdeste OOM-Absturz, den du mit LTX-2 überlebt hast? Lass deine Kriegsgeschichten (oder Siegesrunden) unten—ich lese jeden Kommentar und liebe es, Tricks auszutauschen.