LTX-2 Lokal vs. Cloud: ComfyUI vs. WaveSpeed (Geschwindigkeit, Kosten & Datenschutz)

Ich wurde durch eine kleine Sache zu diesem Artikel bewogen: eine 40-sekündige Wartezeit. Ich hatte einen Batch in der LTX-2 Cloud gestartet und bin weggegangen, um meine Tasse nachzufüllen. Als ich zurückkam, schlug ein Job mit einer vagen Fehlermeldung fehl, und ich konnte nicht feststellen, ob es an mir, der Voreinstellung oder dem Service lag. Diese kleine Pause blieb hängen. Am nächsten Morgen führte ich die gleiche Voreinstellung lokal aus, und sie war fertig, bevor meine E-Mail-App synchronisieren konnte. Dieser Kontrast ist das Thema dieses Artikels: LTX-2 lokal vs. Cloud, nicht als Feature-Liste, sondern das Gewicht, das jede Variante zu einem normalen Tag hinzufügt oder entfernt.

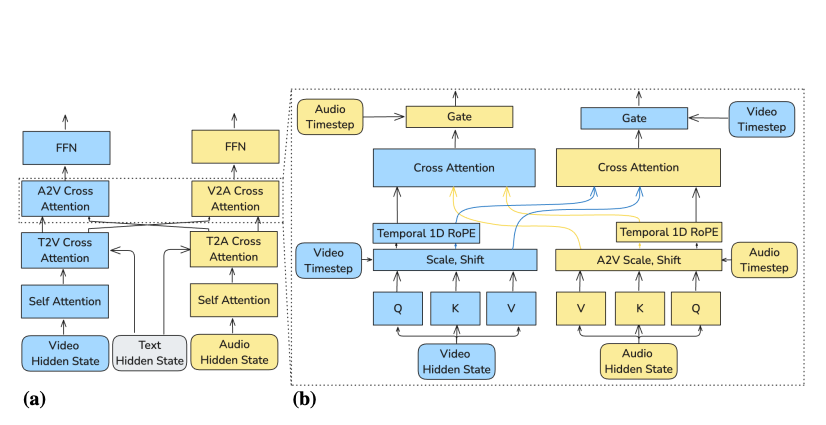

Ich habe beide Setups Anfang Januar 2026 auf meinem 16-Zoll MacBook Pro (M2 Pro, 32 GB RAM) und einem kleinen Ubuntu-Rechner mit RTX 4090 getestet, zusammen mit der LTX-2 Cloud in einer US-Region. Ihre Hardware und Region werden die Zahlen verändern, aber die Kompromisse ordneten sich auf vertraute Weise ein. Für weitere technische Details zum Modell siehe das LTX-2 Research Paper.

Schnelle Entscheidungstabelle (lokal vs. Cloud nach Anwendungsfall)

Hier ist der schnelle Weg, den ich mir gewünscht hätte, bevor ich anfing, hin und her zu wechseln.

| Anwendungsfall | Wählen Sie | Warum es sich richtig anfühlte |

|---|---|---|

| Einzelne Vorschauansichten, enge Feedback-Schleifen | Lokal | Praktisch keine Warteschlangen, schnelle Iteration, einfacheres Debuggen von Voreinstellungen und Prompts. |

| Große Batches mit festen Fristen | Cloud | Parallele Jobs, besserer Durchsatz, weniger Babysitting, sobald es eingestellt ist. |

| Sensible Daten (PII, unveröffentlichte Assets) | Lokal | Keine Uploads: Sie kontrollieren Aufbewahrung und Zugriff standardmäßig. |

| Spitzenlastige Workloads (einige Wochen schwer, andere ruhig) | Cloud | Bezahlen Sie für Spitzen: keine untätige GPU, die auf Ihrem Schreibtisch summt. |

| Offline oder instabile Internetverbindung | Lokal | Offensichtlich, aber es ist wichtig, sobald das WLAN ausfällt. |

| Teamübergreifende Freigabe und Reproduzierbarkeit | Cloud | Zentrale Voreinstellungen, Logs und Berechtigungen reduzieren “Works on my Machine”-Probleme. |

| Experimentelle Operationen (benutzerdefinierte Builds, Edge-Flags) | Lokal | Sie können Versionen fixieren, Branches testen und sofort zurückrollen. |

Ich hätte nicht erwartet, dass dies so aufgeteilt ist. Aber nach einer Woche stellte ich fest, dass ich lokal standardmäßig vorschaue und alles über 200 Elemente in die Cloud sende.

Geschwindigkeit: Lokale Hardware vs. Cloud-Durchsatz

Sicherlich hat die Geschwindigkeit für mich zwei verschiedene Gefühle ausgelöst.

- Lokal fühlte sich schnell an für Einzelfälle. Auf dem M2 Pro startete ein einzelner LTX-2 Job in ~1–2 Sekunden und war schnell genug erledigt, dass ich im Flow blieb. Auf dem 4090-Rechner war es im Grunde sofort, sobald es warm war.

- Cloud fühlte sich gleichmäßig für große Mengen an. Der erste Job musste manchmal 5–15 Sekunden in der Warteschlange warten, aber 50 parallele Jobs glätteten das aus. Durchsatz gewann über Latenz.

Eine kleine Anmerkung aus der Praxis: Kaltstarts sind wichtiger als wir zugeben. Lokale Caches, von Gewichten bis zu Zwischendateien, ließen wiederholte Läufe leichter wirken. Ich bemerkte dies erst, als ich einen Cache löschte und plötzlich alles langsamer wurde. In der Cloud kontrollierte ich diese Schicht nicht, also akzeptierte ich die kleine Start-Gebühr im Austausch für Skalierbarkeit.

Was mich überraschte: Meine schnellste einzelne Vorschauansicht war immer lokal. Meine schnellste Stunde für 1.000 Elemente war immer Cloud. Der Übergangspunkt lag für mich bei etwa 150–250 Elementen. Darüber hinaus sparte das Eingeben eines Befehls und das Überlassen an den Service den Nachmittag. Darunter hielt mich das Starten eines lokalen Laufs in der Arbeit.

Kosten: Strom + Wertminderung vs. Guthaben

Ich versuchte, dies wie ein ruhiger Buchhalter zu bepreisen, nicht wie ein Hype-Person.

Lokale Kosten sehen so aus:

- Hardware-Vorauszahlung (oder monatliche Miete)

- Strom (mein 4090-Rig verbrauchte ~90W im Leerlauf und ~420W unter Last)

- Wertminderung und Wartung (Lüfter, Speicher, gelegentliche Treiber-Kaninchenlöcher)

Cloud-Kosten sehen so aus:

- Pro-Job oder Pro-Token-Guthaben

- Mögliche Ausgangs-/Speicherkosten, wenn Sie Assets behalten

- Überschreitungen, wenn Batches spitzen

Zwei schnelle Skizzen aus meinen Notizen:

- 200-Element-Batch, jeder Job ~1 Minute: Lokal dauerte ~220 Minuten Wanduhrzeit auf meinem Mac (keine GPU), im Grunde kostenlos außer Strom. Cloud verarbeitete es in ~8–12 Minuten mit Parallelisierung und verbrauchte Guthaben, das in der Woche, in der ich unter Druck war, leicht zu rechtfertigen war. Weitere Implementierungstipps sind auf GitHub verfügbar.

- Kontinuierliches Rinnsal (20–30 Elemente/Tag): Lokal gewann. Den Rechner bereit zu halten bedeutete, dass ich die Kosten einmal absorbierte. Cloud-Guthaben verursachte jedes Mal eine kleine kognitive Belastung, wenn ich auf Run drückte. Nicht teuer, nur präsent.

Ich glaube nicht, dass es ein einzelnes “billiger” gibt. Wenn Sie bereits leistungsstarke Hardware besitzen und Ihre Workloads stabil sind, ist lokal sanft zur Geldbörse. Wenn Ihr Volumen spitz ist, lohnt sich das Bezahlen für Burst-Kapazität mehr als das Besitzen eines Heizers mit Lüftern. Ich hatte einen Monat, in dem lokal fast kostenlos war, und einen anderen, in dem Cloud offensichtlich intelligenter war.

Datenschutz: Datenspeicherung & Team-Berechtigungen

Dieser Teil war für mich einfach. Wenn es sensibel ist, führe ich LTX-2 lokal aus. Nicht weil ich der Cloud nicht traue, sondern weil ich nachvollziehen kann, wo Dateien leben.

Lokal:

- Keine Uploads. Artefakte bleiben auf meiner Festplatte oder meiner Netzwerkfreigabe.

- Ich kann mich an meine eigenen Aufbewahrungsregeln halten: automatisches Löschen nach X Tagen, Verschlüsselung im Ruhezustand, und fertig.

Cloud:

- Bessere Team-Kontrollen von vornherein: Rollen, Projektgrenzen und Logs, die nicht von meinem Gedächtnis abhängen.

- Aufbewahrung ist richtlinienbasiert. Das ist gut, aber es ist immer noch eine Vereinbarung mit einem Anbieter. Lesen Sie die Dokumentation und bestätigen Sie die Standardwerte: Einige Dienste behalten Logs und Artefakte länger auf als Sie erwarten.

Für die Zusammenarbeit in einem kleinen Team fühlte sich die Cloud sicherer an, nicht im Sinne des Datenschutzes, sondern im Sinne von “wir werden das kanonische Preset nicht verlieren”. Für alles mit unveröffentlichten Assets oder PII hielt mich lokal entspannt. Beides kann gut gemacht werden. Für allgemeine Open Weights und Benchmarks können Sie sich auf Papers With Code beziehen.

Stabilität: Abhängigkeitsaktualisierungen & Knoten-Abstürze

Ich verlor einen Nachmittag durch eine Treiberaktualisierung. Das ist der ehrliche Teil des lokalen Betriebs. Wenn es funktioniert, ist es großartig. Wenn eine Abhängigkeit aktualisiert und eine andere hinkt, sind Sie der SRE.

Lokale Stabilitätsfeldnotizen:

- Fixieren Sie alles, was Sie können. Container, Env-Dateien, sogar OS-Updates, wenn nötig.

- Halten Sie eine “bekannt gute” Voreinstellung + Versionsliste bereit. Ich behalte eine kurze Textdatei neben dem Projekt mit dem Commit-Hash und wichtigen Flags.

- Erwarten Sie den gelegentlichen Absturz unter schwerer Belastung. Es ist selten katastrophal, aber es bricht den Flow.

Cloud-Stabilitätsfeldnotizen:

- Weniger Überraschungen: mehr Black Boxes. Jobs werden normalerweise abgeschlossen, und wenn nicht, sind die Fehlermeldungen manchmal höflicher als hilfreich.

- Vendor-Upgrades werden ohne Umschweife durchgeführt. Schön, wenn es die Geschwindigkeit verbessert: ärgerlich, wenn eine Änderung die Ausgaben verschiebt.

Weder ist perfekt ruhig. Lokal gibt Ihnen Hebel und zusätzliche Aufgaben. Cloud gibt Ihnen weniger Hebel und weniger Aufgaben. Ich wähle basierend auf welcher Art von Unterbrechung ich diese Woche bereit bin, zu haben.

Bester Hybrid-Ansatz (lokale Vorschau + Cloud-Batch)

Was sich für mich schließlich einstellte, war ein einfacher Rhythmus:

- Entwurf und Vorschau lokal. Ich behalte einen winzigen Beispielsatz, 10–20 Elemente, der Randfälle widerspiegelt. Ich iteriere, bis die Ausgaben zweimal hintereinander richtig aussehen, nicht nur einmal.

- Batch in der Cloud. Ich exportiere die genaue Voreinstellung und führe sie mit einem Zeitstempel-Job-Namen aus. Ich sehe mir die ersten 5% der Logs an, dann gehe ich weg.

Warum sich das richtig anfühlte:

- Lokale Vorschauansichten halten die Latenz nahe Null. Ich kann Prompts, Gewichte oder Parameter anpassen, ohne den Kontext zu wechseln.

- Cloud-Batches halten meinen Rechner frei. Ich kann weiterschreiben, oder ich kann den Deckel schließen und nach draußen gehen.

Zwei kleine Tricks, die halfen:

- Ich fixierte mein “Vorschau-Set”. Am Anfang wechselte ich ständig die Eingaben und verlor den Überblick, was sich änderte. Mit einem festen Set weiß ich, dass Verbesserungen real sind.

- Ich speichere Voreinstellungen vor jedem großen Lauf. Sogar eine kleine Versionsbump kann Ausgaben verschieben: Snapshots machen Unterschiede offensichtlich.

In Wochen mit weniger Jobs behalte ich manchmal alles lokal, besonders wenn ich offline bin oder unterwegs. In Produktionswochen kämpfe ich nicht gegen die Cloud. Der Punkt von LTX-2 lokal vs. Cloud ist nicht Loyalität, sondern die Umgebung zu wählen, die Reibung für die anstehende Aufgabe reduziert. Deshalb haben wir WaveSpeed gebaut — um lokale Vorschauansichten und Cloud-Batch-Läufe ohne Warteschlangen-Babysitting zu handhaben. Es ist das, was unser Team jeden Tag nutzt.

Migrations-Checkliste (Workflow / Voreinstellung-Übertrag)

Der Wechsel zwischen LTX-2 lokal und der Cloud war reibungsloser, sobald ich die Schritte aufschrieb. Das ist die Checkliste, die ich jetzt verwende. Sie ist langweilig, weshalb sie funktioniert.

Voreinstellungs-Parität

- Exportieren/importieren Sie die Voreinstellung statt sie von Hand zu kopieren. Wenn ein direkter Export nicht verfügbar ist, speichern Sie Voreinstellungen in der Versionskontrolle als JSON/YAML.

- Fixieren Sie Versionen. Notieren Sie die Modell-/Build-ID, alle Erweiterungsversionen und relevante Flags.

- Zeichnen Sie Seed/Randomness-Einstellungen auf, wenn Determinismus wichtig ist.

Asset-Pfade

- Normalisieren Sie Pfade. Lokale absolute Pfade existieren nicht in der Cloud: verwenden Sie relative Pfade oder laden Sie Assets vorher in einen bekannten Bucket oder Projektordner hoch.

- Bestätigen Sie Codecs und Formate. Ein Mismatch hier bricht Pipelines auf stille Weise.

Umgebung

- Dokumentieren Sie Umgebungsvariablen und Geheimnisse separat. Baken Sie nie Geheimnisse in Voreinstellungen.

- Stimmen Sie Hardware-Annahmen ab. Wenn Ihre lokale Voreinstellung einen bestimmten Speicher-Fußabdruck erwartet, testen Sie zuerst einen kleineren Batch in der Cloud.

Validierung

- Führen Sie einen winzigen Batch (1–5% der vollständigen Menge) aus und vergleichen Sie Ausgaben Eingang für Eingang.

- Behalten Sie Logs für den ersten erfolgreichen Lauf in jeder Umgebung. Sie werden die Baseline, wenn sich etwas später verschiebt.

Rollback

- Behalten Sie eine “letzte bekannt gute” Voreinstellung auf beiden Seiten. Nennen Sie sie mit einem Datum und einer kurzen Notiz wie “vor CUDA-Update” oder “Seed für Release v1 gesperrt.”

Dies dauert zehn ruhige Minuten und zahlt sich beim ersten Mal aus, wenn sich etwas unter Ihnen verschiebt. Ich vergesse immer noch einen Schritt ab und zu: Die Checkliste verzeiht das.

Dies dauert zehn ruhige Minuten und zahlt sich beim ersten Mal aus, wenn sich etwas unter Ihnen verschiebt. Ich vergesse immer noch einen Schritt ab und zu: Die Checkliste verzeiht das.

Wenn Sie zwischen LTX-2 lokal vs. Cloud abwägen, würde ich ohnehin mit diesem Teil anfangen. Selbst wenn Sie nie wechseln, hilft das Aufschreiben Ihrer Annahmen dabei, die Arbeit zu beruhigen.