LTX-2 ComfyUI Quickstart: Erstes Video in 10 Minuten (Day-0 Native Support)

I’ll translate this article to German. Let me read it carefully and provide an accurate translation while preserving all formatting, links, and technical details.

Hallo, ich bin Dora. Ich hatte nicht geplant, LTX-2 letztes Wochenende in ComfyUI zu testen. Ich bin nur auf ein kleines Problem bei einem Client-Reel gestoßen: Ich brauchte zwei kurze Aufnahmen mit dem gleichen Look, und meine üblichen Tools drifteten ständig ab. Ich sah eine Notiz über „ltx-2 comfyui day-0 support”, holte tief Luft und gab dem Abend eine Chance. Ich testete vom 6.–8. Januar 2026 auf meiner Hauptworkstation und einem Reise-Laptop.

Was folgt, ist keine Rezension, sondern einfach, wie es sich tatsächlich anfühlte, LTX-2 in ComfyUI zum Laufen zu bringen – wo es mir half, wo es mir Schwierigkeiten bereitete, und die Einstellungen, die ich wiederverwenden würde, wenn ich es morgen wieder tun müsste.

Was ist Day-0 Native Support (Veröffentlichung 5.–6. Januar 2026)

Day-0 Support bedeutet hier, dass LTX-2 mit Nodes und einem Referenz-Workflow geliefert wird, die in ComfyUI funktionieren, in der gleichen Woche, in der das Modell veröffentlicht wird. Keine Shim-Skripte, keine Mystery-Forks. Ich zog die Änderungen am 6. Januar und sah:

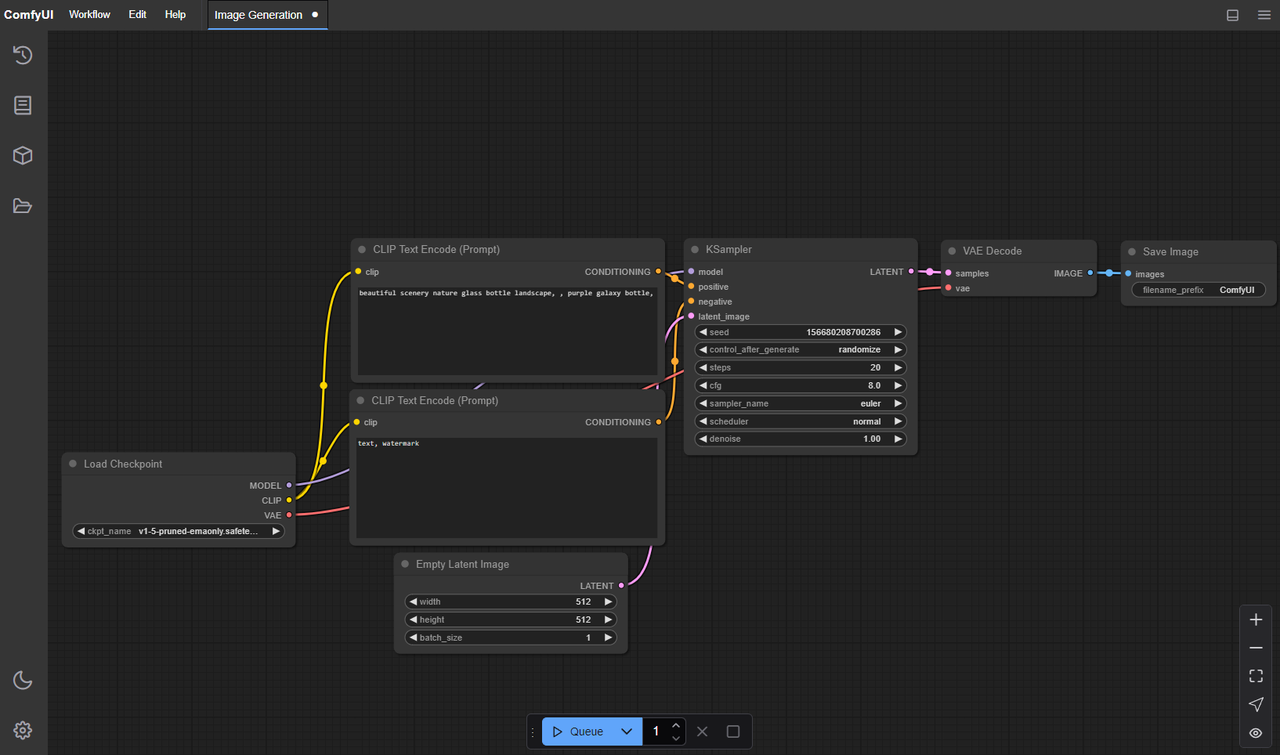

- Eingebaute Nodes mit Bezeichnungen für LTX-2 (Loader, Sampler und ein einfacher Preview-Pfad).

- Ein Beispiel-Workflow, der tatsächlich durchgehend funktioniert, ohne manuelle Verdrahtung. Nicht hübsch, aber funktional.

- Model-Download-Hooks, die auf die offiziellen Gewichte verweisen. Ich musste sie trotzdem in mein Models-Verzeichnis legen, aber zumindest stimmten die Links mit der Dokumentation überein.

Ich erwartete keine Magie, und das ist es auch nicht. Der erste Durchgang wirkte ein wenig spartanisch: begrenzte Voreinstellungen, ein paar kryptische Fehler. Aber er war stabil genug, um 4–6 Sekunden lange Clips zu rendern, und die Farbkonsistenz zwischen den Durchläufen war besser als sonst. Für einen Day-0 ComfyUI-Drop ist das selten.

Wenn dir Reproduzierbarkeit wichtig ist: Seeds funktionierten, und ich konnte die Bewegungsstärke anpassen, ohne dass die Szene zusammenbrach. Das war die kleine Überraschung, die mich zum Weiterforschen bewegte.

Minimale Anforderungen (GPU / VRAM / ComfyUI-Version)

Dies ist von meinen eigenen Maschinen. Dein Setup kann anders sein.

- ComfyUI: ein frischer Pull vom 6. Januar 2026. Ältere Forks gaben mir Node-Importfehler. Wenn du eine langlebige Umgebung beibehältst, erwäge eine saubere venv nur für LTX-2. Folge der offiziellen ComfyUI-Dokumentation.

- GPU/VRAM:

- 12 GB VRAM: handhabbar bei 512×288 bis 512×320, 4–5 s Clips, konservative Bewegung.

- 16 GB VRAM: 512×512 bei 4–6 s fühlte sich angenehm an. Gelegentliche OOM bei aggressiver Bewegung oder vielen Schritten.

- 24 GB+ VRAM: 768×432 bis 768×768 bei 5–8 s liefen reibungslos. Guter Puffer für höheres CFG.

- CPU/RAM: nichts Ungewöhnliches. Ich verwendete 32 GB System-RAM: die Nutzung blieb bescheiden.

- Treiber/Runtime: CUDA 12.x, PyTorch-Build passend zu deinem CUDA. xformers half auf der 12-GB-Karte, war aber auf 24 GB nicht zwingend erforderlich.

Wenn du eine 8-GB-Laptop-GPU hast, würde ich lokales System überspringen und für jetzt einen Cloud-Runner verwenden.

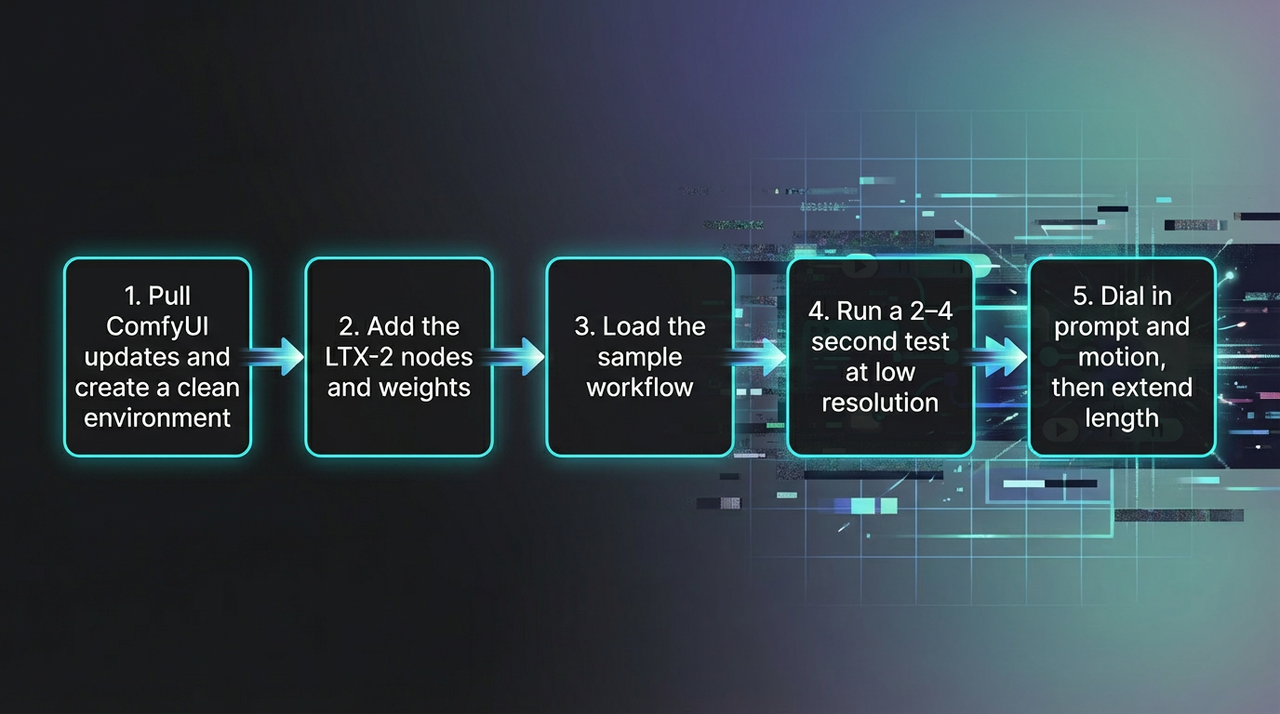

5-Schritte-Workflow für den ersten Durchlauf

Hier ist der exakte Weg, den ich am 6. Januar gegangen bin. Keine zusätzlichen Verzierungen.

Hier ist der exakte Weg, den ich am 6. Januar gegangen bin. Keine zusätzlichen Verzierungen.

-

ComfyUI-Updates abrufen und eine saubere Umgebung erstellen Ich klonte einen frischen ComfyUI-Ordner von GitHub und installierte Requirements aus der enthaltenen Datei. Das Mischen von alten Nodes mit neuen Video-Modellen führt normalerweise zu seltsamen, stillschweigenden Fehlern. Ein sauberes System sparte mir eine Stunde.

-

Füge die LTX-2-Nodes und Gewichte hinzu Ich verwendete die gebündelten LTX-2-Nodes, die mit dem Update vom 5.–6. Januar geliefert wurden. Für Gewichte folgte ich den Links in der Node-Tooltip und platzierte Dateien unter

models/ltx(der vorgeschlagene Pfad). Wenn dein Node die Gewichte nicht finden kann, wird er es dir sagen – überprüfe einfach die exakten Dateinamen. -

Lade den Beispiel-Workflow Das bereitgestellte Beispiel gab mir eine funktionierende Basis: Textprompt rein, Video-Vorschau raus. Ich änderte nur drei Dinge: Seed, Auflösung und Bewegungsstärke. Mit einfachen Anfängen blieben Fehler offensichtlich.

-

Führe einen 2–4-Sekunden-Test mit niedriger Auflösung durch Mein erster Durchlauf war 512×320, 4 Sekunden, 16 Frames, Sampler-Schritte bei 20. Es dauerte ~50–70 Sekunden auf einer 24-GB-4090, ~2–3 Minuten auf einer 12-GB-3060. Das Ziel war nicht Geschwindigkeit: es war die Überprüfung der Pipeline.

-

Stimme den Prompt und die Bewegung ab, dann verlängere die Länge Sobald mir der Basis-Look gefiel, passte ich CFG und Bewegungsstärke an, dann ging ich auf 6–8 Sekunden. Wenn die Szene auseinanderfiel, machte ich einen Schritt zurück: reduziere Bewegung, fixiere den Seed und halte die gleiche Auflösung.

Kleine Notiz: Ich speicherte jeden Test mit Seed und Einstellungen im Dateinamen. Wenn Clips um 1 Uhr morgens verschwimmen, ist dieser Breadcrumb Trail ein Geschenk.

Empfohlene Einstellungen (Auflösung / FPS / Längenstandardwerte)

Diese sind Ausgangspunkte, die sich für mich gut verhielten. Passe nach Belieben an.

-

Auflösung

- 512×320 oder 512×512 für erste Looks. Stabil, schnell genug, leicht für VRAM.

- 768×432 wenn du mehr Details ohne Verpflichtung auf Quadrat möchtest.

-

FPS

- 12–16 fps für Concept-Durchläufe. Du siehst Bewegungsbögen ohne schwere Renderzeiten.

- 24 fps nur wenn du dir des Looks sicher bist: es multipliziert Zeit und Speicher.

-

Länge

- 4–6 Sekunden ist der Sweet Spot für Iteration. Jenseits von 8 Sekunden fängt das Modell an zu wandern, es sei denn, dein Prompt ist sehr verankert.

-

CFG / Schritte

- Starten Sie CFG bei 3–5. Höher fügt Kontrast hinzu, kann aber die Szene überdrehen.

- Schritte bei 18–24 waren in den meisten Fällen ausreichend. Ich sah keinen großen Gewinn über 28 hinaus.

-

Bewegung

- Halten Sie es anfangs konservativ. Wenn Sie große Bewegungen brauchen, bauen Sie in kleinen Erhöhungen auf und halten Sie den Seed fest, während Sie anpassen.

Ich behielt auch eine „sane defaults”-Voreinstellung: 512×512, 16 fps, 6 s, CFG 4, Schritte 22, Bewegung 0.6. Es ist langweilig, aber langweilig ist zuverlässig.

3 Copy-Paste-Prompts, die funktionieren

Dies sind keine Zauberworte, nur Prompts, die vom 6.–8. Januar stabile, wiederholbare Clips erzeugten. Ich füge für jeden eine kurze Setup-Notiz hinzu.

-

Produkt-Makro mit sanftem Parallax

- Prompt:

"a simple ceramic mug on a wooden desk, soft morning window light, shallow depth of field, slow parallax left to right, natural colors, minimal grain" - Notizen: Halten Sie Hintergrundnomen einfach. Wenn du Markensprache hinzufügst, neigt es dazu, Logos zu halluzinieren.

- Prompt:

-

Straßenszene mit gezügelter Bewegung

- Prompt:

"a quiet city street at dusk, neon signs reflecting on wet pavement, light drizzle, camera slowly dollying forward, subtle lens flare, cinematic but understated" - Notizen: Wenn deine Lichter anfangen zu flackern, senken Sie die Bewegung und reduzieren Sie CFG um 1.

- Prompt:

-

Natürliche Textur-Schleife

- Prompt:

"close-up of ripples on a lake, soft breeze, warm sunset tones, camera locked with small micro-movements, gentle highlights, calm mood" - Notizen: Großartig für Hintergründe. Das Seed-Lock hält es schleifennahe, wenn du die Schwänze trimmen.

- Prompt:

Tipp: Wenn du eine straffere Stilkontrolle möchtest, laden Sie Tonwörter vor („understated, natural light, clean composition”) vor Objekten. Es schien die Palette besser zu verankern.

Häufige Fehler beim ersten Durchlauf + schnelle Fixes

Dies waren meine tatsächlichen Probleme und was sie behoben.

-

CUDA außer Speicher beim Start

- Fix: Senke zuerst Auflösung, dann Schritte, dann Bewegung. Wenn du 12 GB hast, bleibe bei 512 Breite und halte Clips unter 6 Sekunden. Schließe Browser, die VRAM verbrauchen (ernsthaft).

-

Node nicht gefunden / fehlende Klasse

- Fix: Aktualisiere ComfyUI auf die Commits vom 5.–6. Januar: Entferne ältere benutzerdefinierte Nodes, die Legacy-Video-Loader bündeln, und starte dann neu. Wenn der Fehler auf einen spezifischen Node-Namen verweist, durchsuche deinen

custom_nodes-Ordner nach Duplikaten.

- Fix: Aktualisiere ComfyUI auf die Commits vom 5.–6. Januar: Entferne ältere benutzerdefinierte Nodes, die Legacy-Video-Loader bündeln, und starte dann neu. Wenn der Fehler auf einen spezifischen Node-Namen verweist, durchsuche deinen

-

Gewichte-Datei nicht erkannt

- Fix: Stimmen Sie den exakten Dateinamen ab, den der Node erwartet. Halten Sie Pfade rein ASCII; vermeiden Sie Symlinks unter Windows, falls möglich. Starten Sie ComfyUI neu, nachdem Sie Dateien verschoben haben.

-

Torch / CUDA-Nichtübereinstimmung

- Fix: Stellen Sie sicher, dass Ihr PyTorch-Build Ihrem CUDA-Toolkit entspricht. Wenn dir das Debuggen nicht wichtig ist, verwende das in der ComfyUI GitHub README

für deine GPU empfohlene pip-Wheel.

für deine GPU empfohlene pip-Wheel.

- Fix: Stellen Sie sicher, dass Ihr PyTorch-Build Ihrem CUDA-Toolkit entspricht. Wenn dir das Debuggen nicht wichtig ist, verwende das in der ComfyUI GitHub README

-

FFmpeg nicht für Export gefunden

- Fix: Installiere FFmpeg und füge es zu PATH hinzu. Als schnelle Ausweichroute exportiere Frames und assembliere mit einem beliebigen Encoder, dem du vertraust.

-

Flackern oder Stil-Drift in der Mitte des Clips

- Fix: Reduzie Bewegung, senke CFG um 1–2, und halte Prompts sauber. Überbesetzung neigt dazu, sich der zeitlichen Konsistenz in den Weg zu stellen.

Pro-Tipp: Wenn nichts funktioniert und du einen engen Termin hast, rendere 12–16 fps und verlangsame es mit Frame-Blending auf 24 fps im Post. Es ist nicht elegant, aber es ist ruhig im Sturm.

Was mir gefallen hat

- Keine Abhängigkeitskämpfe. Ich testete einen Prompt in weniger als fünf Minuten.

- Vernünftige Defaults. Die erste Ausgabe war nicht perfekt, aber auch kein Chaos.

Was stand mir im Weg

- Weniger Kontrolle als ein vollständiger ComfyUI-Graph. Mir fehlte die Möglichkeit, benutzerdefinierte Post-Schritte zu verdrahten.

- Warteschlangen-Zeit. Mein längster Warten war ~6 Minuten während der Stoßzeiten.

Wer passt dazu

- Wenn du Looks erkundest und dich nicht mit Treibern beschäftigen möchtest, ist es einfach.

- Wenn du eine reproduzierbare Pipeline mit Versionen und Seeds brauchst, die über Projekte hinweg verfolgt werden, gewinnt das lokale ComfyUI immer noch.

- Wenn du nur LTX-2 sofort ausführen musst, ohne Setup, lässt dich WaveSpeed im Browser rendern und Prompts überprüfen, bevor du dich auf eine lokale Pipeline verpflichtest.

Dies funktionierte für mich; deine Ergebnisse können variieren. Wenn du reist oder eine 8-GB-GPU hast, lohnt sich ein Blick.

Ein kleiner Gedanke zum Abschluss: LTX-2 in ComfyUI machte mich nicht sofort schneller. Es machte meine Entscheidungen klarer: weniger Regler, die wichtig waren, mehr, die es nicht waren. Das ist mehr als Geschwindigkeit, was ich eine Woche später bemerke.