DeepSeek V4 verwenden: Day-1 Quick Start für API und Chat

Lange nicht gesehen! Meine Freunde. Ich bin Dora. Ich bin am Dienstagmorgen auf ein kleines Problem gestoßen: Ich musste eine ungeordnete Sammlung von Notizen in etwas Produktionsreifes verwandeln, und mein übliches Modell rutschte immer wieder in fröhliche Floskeln ab. Ich wollte klare Antworten, weniger Umschweife. Das hat mich dazu bewogen, DeepSeek V4 auszuprobieren. Ich habe es im Januar 2026 im Web-Chat und über die API getestet. Das Folgende ist keine Feature-Tour. Es ist, wie ich es zum Laufen gebracht habe, wo es sich solide anfühlte, und wo ich immer noch zögere.

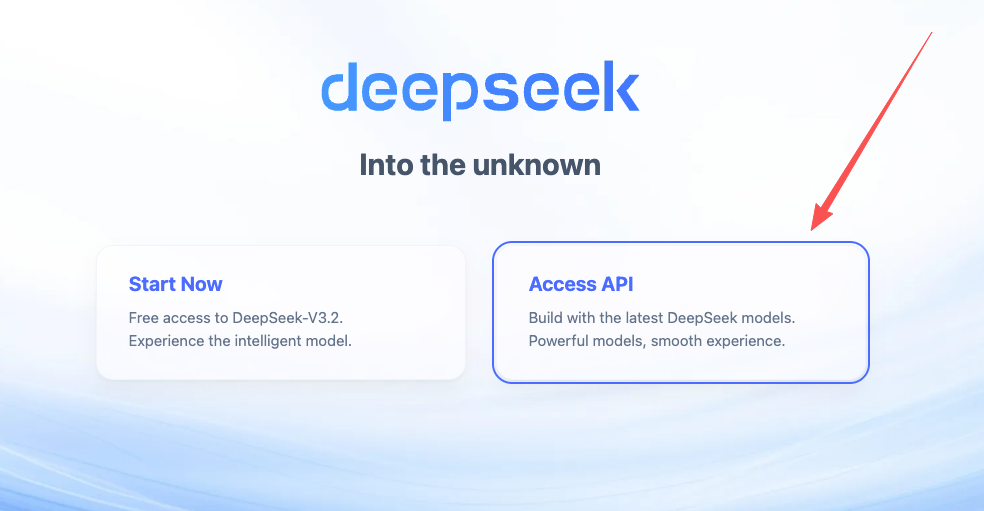

Zugriffsmöglichkeiten beim Start

Ich bin einfach vorgegangen: kein Code, nur der Web-Chat. Dann bin ich zur API übergegangen, als ich wiederholbare Läufe brauchte. Wenn du lieber erst mit Prompts spielen möchtest und die Dinge später verdrahtest, ist dieser Weg stabil und reibungslos.

Web-Chat-Schnittstelle

Ich habe mich über die Hauptseite angemeldet und V4 aus der Modellliste ausgewählt. Wenn du andere Chat-ähnliche Benutzeroberflächen verwendet hast, wird sich das vertraut anfühlen: Systemmeldung oben, Chat-Turns unten, Parameter versteckt.

Was geholfen hat:

- Ich habe eine kurze Systemmeldung geschrieben, die meinem Denken entsprach: “Sei direkt. Zitiere Annahmen. Wenn du rätst, sag es.” Das hat das Modell davon abgehalten, zu viel zu erklären.

- Ich hielt die Temperatur niedrig (etwa 0,2) zum Schreiben von Spezifikationen oder Code-Kommentaren. Wenn ich Alternativen für Wording oder Namensfindung wollte, erhöhte ich sie auf 0,5.

- Ich verwendete ein einfaches Ritual vor jedem neuen Thread: Paste einen kleinen Kontextblock. Zwei Zeilen. “Projekt: internes Dokument-Cleanup. Stimme: einfach, prägnant, keine Metaphern.” Das hielt V4 davon ab, abzuschweifen, und es hielt mich auch ehrlich über das, was ich wirklich brauchte.

Reibungsverluste:

- Lange Chats wurden manchmal vage. Das Zurücksetzen des Threads und das Einfügen eines frischen Kontextes half zuverlässiger als der Versuch, ihn mitten im Strom zu kontrollieren.

- Copy/Paste-Formatierung war in Ordnung, aber ich ziehe es immer noch vor, Ausgaben über die API im Code zu greifen für alles, das ich mehr als einmal ausführen muss.

Wenn du nur gelegentliche Hilfe, saubere Entwürfe, schnelle Refaktorierungen, straffere E-Mails brauchst, ist die Web-Schnittstelle ausreichend. Aber wenn du Konsistenz über Aufgaben hinweg möchtest (gleicher Stil, gleiche Struktur, keine Überraschungen), ist die API der Ort, wo es sich beruhigt.

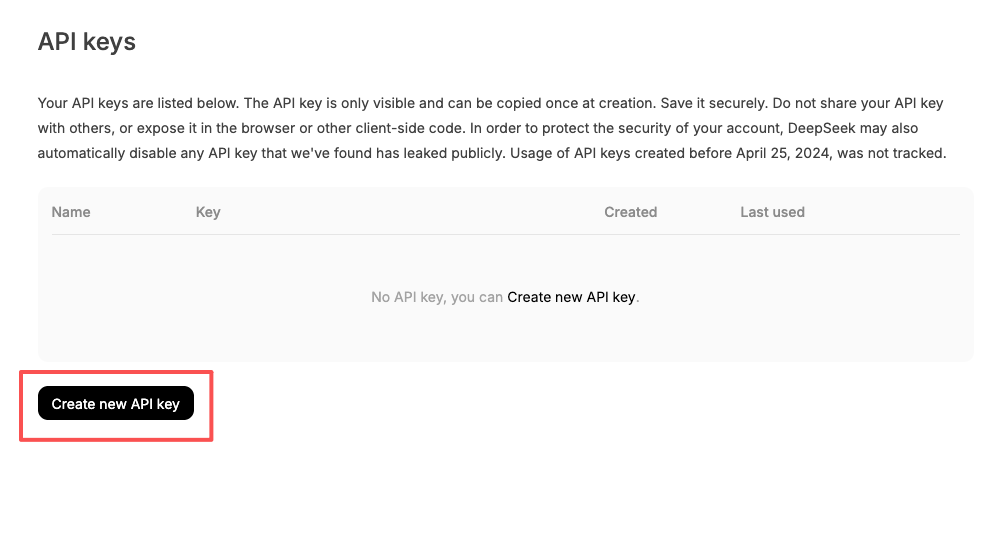

API-Zugriff

Ich habe einen API-Schlüssel aus meinem Konto-Dashboard erstellt und ihn in meine Umgebung eingefügt. Nichts Besonderes:

Ich habe einen API-Schlüssel aus meinem Konto-Dashboard erstellt und ihn in meine Umgebung eingefügt. Nichts Besonderes:

- macOS/Linux: export DEEPSEEK_API_KEY=”…” in deinem Shell-Profil.

- Windows PowerShell: setx DEEPSEEK_API_KEY ”…” und Terminal neu starten.

DeepSeeks API folgt der jetzt vertrauten Chat-Completions-Form. Wenn du OpenAI-kompatible Clients verwendet hast, ist es praktisch Plug-and-Play. Das Wichtigste, auf das du achten musst, ist der Modellname. V4 ist verfügbar, aber die genaue Kennung kann sich ändern. Ich habe den aktuellen Modell-String vor API-Aufrufen im Dashboard überprüft.

Zum Datenschutz: Ich vermeide es, Geheimnisse oder Kundendaten zu senden, es sei denn, ich habe die Aufbewahrungsrichtlinie bestätigt. Ich maskiere auch IDs und verwende Scheinwerte in Prompts. Es dauert 30 Sekunden und verhindert zukünftige Kopfschmerzen.

Wenn du den offiziellen Startpunkt möchtest, ist die sicherste Tür der Dokumentationslink der Hauptseite: DeepSeek. Der Kontobereich hat normalerweise die aktuellen Endpoints, Modellnamen und Rate Limits.

Dein erster API-Aufruf

Ich mache gerne erst eine kleine, langweilige Anfrage. Sie sagt mir, ob die Authentifizierung verdrahtet ist, der Modellname gültig ist und die Antworten so aussehen, wie ich sie erwarte. Danach integriere ich es in ein Skript.

Authentifizierung

Ich habe einen Bearer-Token im Authorization-Header verwendet und den Schlüssel in einer Umgebungsvariablen behalten. Es reduziert die Chance, dass ich ihn versehentlich committe oder in ein gemeinsames Snippet fallen lasse. Hier ist die Form, die ich im Januar 2026 getestet habe:

- Header: Authorization: Bearer $DEEPSEEK_API_KEY

- Endpoint: der Chat-Completions-Pfad, der in deiner Konto-Dokumentation gezeigt wird

- Modell: überprüfe die genaue Zeichenkette für V4 im Dashboard (z. B. “deepseek-v4”), da die Benennung sich ändern kann

Ein kleiner Hinweis: Wenn deine Organisation Anfragen durch einen Proxy leitet, teste zuerst mit curl. Es ist einfacher zu sehen, was tatsächlich über die Leitung geht.

Basis-Anfrage

Mein erster Aufruf fordert das Modell auf, einen kurzen Text mit einem strikten Format zusammenzufassen. Wenn ein Modell die Formatierung beim ersten Versuch befolgt, vertraue ich ihm mehr mit strukturierten Aufgaben später.

Curl (kompakt, einfach zu vergleichen):

curl -s https://api.your-deepseek-endpoint/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $DEEPSEEK_API_KEY" \

-d '{

"model": "deepseek-v4",

"temperature": 0.2,

"messages": [

{"role": "system", "content": "You are concise. Use the requested format exactly."},

{"role": "user", "content": "Text: 'Roadmap shifted to Q2: need a two-sentence summary and three bullet risks.'\nFormat:\nSummary: <two sentences>\nRisks:\n- <risk>\n- <risk>\n- <risk>"}

]

}'Python (mit einem generischen OpenAI-kompatiblen Client):

from os import getenv

import requests

API_KEY = getenv("DEEPSEEK_API_KEY")

URL = "https://api.your-deepseek-endpoint/v1/chat/completions"

payload = {

"model": "deepseek-v4",

"temperature": 0.2,

"messages": [

{"role": "system", "content": "You are concise. Use the requested format exactly."},

{"role": "user", "content": (

"Text: 'Roadmap shifted to Q2: need a two-sentence summary and three bullet risks.'\n"

"Format:\nSummary: <two sentences>\nRisks:\n- <risk>\n- <risk>\n- <risk>"

)},

],

}

resp = requests.post(

URL,

headers={

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json",

},

json=payload,

timeout=30,

)

resp.raise_for_status()

print(resp.json()["choices"][0]["message"]["content"])Worauf ich in der Ausgabe achte:

- Hat es die genaue Struktur behalten (Summary-Zeile, dann Risks-Bullets)?

- Gibt es Vorbehalte oder Füllwörter, die ich nicht angefordert habe?

- Wenn ich bei Temperatur 0 mit demselben Prompt erneut ausführe, bekomme ich das gleiche Format?

Meine Läufe waren sauber: V4 befolgte das Format ohne Abdrift und handhabte kurze Anweisungen gut. Das ist normalerweise ein gutes Zeichen für nachgelagerte Aufgaben wie Changelog-Entwürfe oder Code-Kommentare. Das Hauptproblem war Token-Budgetierung; Antworten, die lange zitierte Eingaben enthalten, können überläufen. Ich habe es behoben, indem ich Eingaben gekürzt und zunächst kürzere Ausgaben angefordert habe, dann je nach Bedarf erweitert.

Erste Coding-Aufgabe zum Ausprobieren

Ich mag kleine Automationen, die sich sofort bezahlt machen. Das erste, das ich versuchte, war ein winziger Helfer, der Screenshot-Dateien in lesbare Titel umbenennt. Nicht glamourös. Sehr nützlich.

Setup, das ich verwendet habe (Januar 2026)

Setup, das ich verwendet habe (Januar 2026)

- Ein Ordner voller Bilder wie Screenshot 2026-01-18 at 11.02.31.png

- Eine YAML-Datei mit ein paar Regeln (Projektname, Datumsformat)

- Ein Prompt, der V4 fragt, ein Skript und einen Trockentest-Plan zu erstellen, bevor man Dateien berührt

Prompt, den ich über die API gesendet habe

You are helping me write a safe file-renamer. Requirements:

- Input: directory of PNG/JPG screenshots.

- Output: dry-run first: then rename.

- Pattern: {project}-{short-title}-{YYYYMMDD}.{ext}

- Short titles: extract from on-screen window titles if present: otherwise infer 2–4 words from file metadata: avoid stop words.

- Constraints: no overwrites: lowercase: hyphens only: log actions.

Return:

1) Risks (3 bullets)

2) Plan (numbered steps)

3) Python script (<= 120 lines)

4) One test case (pytest-style) using a temp directory.Was passiert ist:

Erster Versuch: Das Skript sah gut aus, übersprung aber die dry-run-Flag. Ich bat es, eine “—dry-run”-CLI-Option mit einem Standardwert von true einzufügen. Es stimmte zu und hielt den Code unter dem Limit.

Zweiter Versuch: Es riet bei der EXIF-Analyse. Ich bat es, das hinter einem try/except zu gating und ohne Fehler fortzufahren. Danach lief es sauber.

Warum dies eine gute erste Aufgabe ist:

Es erzwingt sorgfältige Formatierung und einfache Ein-/Ausgabe.

Du kannst die Korrektheit validieren, ohne jede Zeile zu lesen, einfach mit einem Dummy-Ordner ausführen und das Protokoll sehen.

Es exposiert Edge Cases schnell (Leerzeichen, Kollisionen, lange Namen).

Was mir an V4 hier aufgefallen ist:

Es reagiert gut auf Einschränkungen in einfacher Sprache. “No overwrites: lowercase: hyphens only” funktionierte besser als eine lange Vorlage.

Es blieb geerdet, wenn ich um einen Plan vor Code bat. Diese kleine Pause half uns beiden. Ich konnte fehlende Schritte erkennen, bevor es etwas Gefährliches produzierte.

Grenzen und Trade-offs:

Es ist kein Ersatz für das Lesen des Codes. Ich überfliege immer noch auf unsichere Dateivorgänge und unerwartete Importe.

Bei längeren Skripten teile ich die Aufgabe: Plan → Kernfunktionen → CLI-Wrapper → Tests. V4 respektierte die Sequenz mehr als einige Modelle, die ich verwendet habe, aber es kann Schritte immer noch vermischen, wenn ich vage bin.

Wem hilft das:

Maker, die schnelle, sichere Dienstprogramme mögen.

Teams, die konsistente Struktur über Prompts hinweg bevorzugen.

Leute, die vorhersehbare Formatierung über glanzvolle Kreativität schätzen.

Wer könnte frustriert sein:

Jeder, der erwartet, dass ein Modell Geschäftsregeln ohne Aufschreiben erahnt.

Leute, die One-Shot-, Long-Output wollen. Kleinere Schleifen funktionieren hier besser.

Warum das für mich wichtig ist:

Sobald ein Modell die einfachen Dinge zuverlässig richtig macht, Formatierung, kurze Pläne, niedrige Temperatur, wird der Rest meines Workflows leichter. Ich denke über V4 als ein stabiles Paar Hände. Nicht Magie. Nur stabil.

Wenn du neugierig bist, versuche das gleiche Muster morgen mit einer anderen Aufgabe: Erstelle ein Changelog aus Commit-Nachrichten, oder erzeuge Migrationschritte aus einem Schema-Diff. Behalte die Plan-First-Einschränkung bei und sehe, ob deine mentale Last um einen Punkt sinkt. Meine hat.

Ich werde nächste Woche V4 mit längeren Dokumenten weiter testen. Ich frage mich, wie es zitierte Zusammenfassungen handhabt, ohne die Ausgabe aufzublähen. Ruhig hoffnungsvoll, aber ich lasse die Läufe mir sagen.

Häufig gestellte Fragen

Was ist die schnellste Möglichkeit, mit DeepSeek V4 zu beginnen: Web-Chat oder API?

Beginne im Web-Chat, um Prompts mit minimalem Setup zu iterieren, wechsle dann zur API für Konsistenz und wiederholbare Läufe. Der Chat funktioniert gut für saubere Entwürfe oder schnelle Refaktorierungen. Für stabilen Stil, strikte Formatierung und Automatisierung bietet die API stabilere, vorhersehbarere Ausgaben.

Wie verwende ich DeepSeek V4 über die API?

Erstelle einen API-Schlüssel, speichere ihn in einer Umgebungsvariablen und sende eine Chat-Completions-Anfrage mit Authorization: Bearer. Überprüfe den genauen Modellnamen (z. B. deepseek-v4) in deinem Dashboard. Beginne mit einem kleinen, strukturierten Test-Prompt bei niedriger Temperatur, um Authentifizierung, Formatierung und deterministisches Verhalten zu bestätigen.

Wie verwende ich DeepSeek V4, um Antworten prägnant und formatgerecht zu halten?

Stelle eine kurze Systemmeldung ein, die Stilregeln angibt (z. B. sei direkt, nenne Annahmen). Halte die Temperatur niedrig (etwa 0–0,2) für Spezifikationen und strukturierte Ausgaben. Stelle einen winzigen Kontextblock zu Beginn jedes Threads bereit und fordere einen Plan vor dem Code an. Dies reduziert Abdrift und verbessert die Format-Einhaltung.