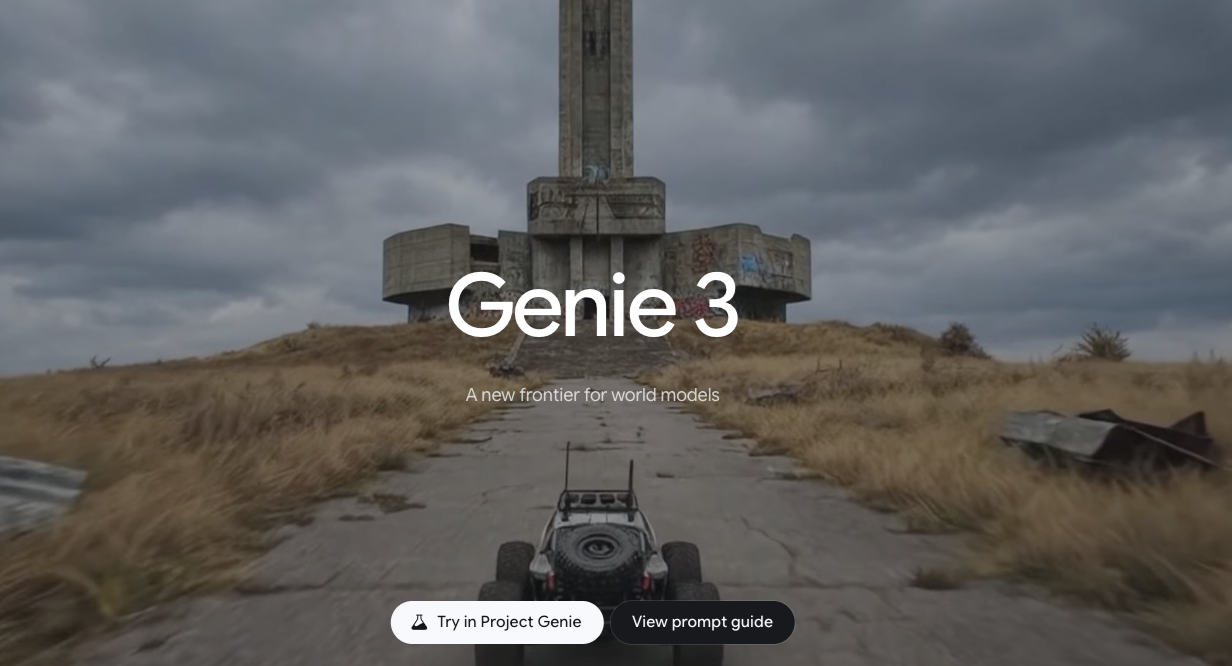

Google DeepMind Genie 3: Technische Analyse und Funktionen

Ich bin Dora. Es fing mit einer kleinen Unannehmlichkeit an: Ich versuchte, einem Teamkollegen einen einfachen Spielmechanismus zu erklären, aber meine Skizze und ein Absatz Text wirkten immer noch verschwommen. Ich wollte keinen ganzen Prototyp, nur etwas, das ich zehn Sekunden lang spielen konnte, um das Gefühl zu überprüfen. Das ist normalerweise der Moment, in dem ich zucke und weitermache. Stattdessen verbrachte ich eine Woche im Januar 2026 damit, zu lesen, Demos anzusehen und mit Community-Nachbildungen von Google DeepMind Genie 3 herumzutüfteln.

Ich habe keinen Production Build. Was ich habe: die öffentliche Forschung, die Modellkarten-Notizen, die ich finden konnte, das ursprüngliche Genie-Papier und ein paar Nachbildungen, die den Ansatz mit kleineren Checkpoints widerspiegeln. Das sind also Feldnotizen, was in der Praxis Sinn ergab, wo es wackelte, und wo Google DeepMind Genie 3 wichtig zu sein scheint, wenn Sie visuelle Inhalte in spielbare Welten mit minimalem Aufwand umwandeln möchten.

Architektur-Übersicht des Modells

Der einfachste Weg, wie ich mir Genie 3 vorstellen kann, ist ein Stack, der Pixel in eine steuerbare, vorhersagebare Welt umwandelt, ohne ein von Hand erstelltes Spiel-Engine darunter zu benötigen.

Auf hoher Ebene (basierend auf der ursprünglichen Genie-Arbeit und was in den neuesten Demos sichtbar ist):

- Ein visueller Tokenizer komprimiert Frames in einen engen Latent-Space. Anstatt mit rohen Pixeln zu arbeiten, lernt das Modell einen diskretisierten oder kontinuierlichen Code (denken Sie an Video-Token), das die Dinge schnell genug hält, um viele Frames vorherzusagen.

- Ein Dynamics-Modell lernt, wie sich diese Latent-States über Zeit entwickeln. Sie können es wie ein Weltmodell behandeln: Gegeben den aktuellen State und eine Aktion, sagt es den nächsten State voraus. Hier entsteht die „Spielbarkeit”.

- Eine Action-Schnittstelle bildet menschliche Eingaben (Tasten, Touch oder abgeleitete Gesten) auf die Action-Token des Modells ab. Frühere Genie-Versionen leiteten einen latenten Action-Space aus Video ab: Genie 3 scheint eine saubere Zuordnung zu bieten, stabiler über Szenen hinweg.

- Ein Renderer/Decoder wandelt das vorhergesagte Latent zurück in Frames um, die Sie sehen und steuern können, idealerweise mit niedriger Latenz.

Zwei Details fielen beim Testen von Nachbildungen auf:

- Das Modell importiert keine Physik aus einer Bibliothek: Es lernt alle „Physik”, die es aus Trainings-Video lernen kann. Das ist, warum Objekte manchmal schwebend oder klebrig wirken. Wenn es funktioniert, ist es unheimlich. Wenn nicht, ist es wie Handschuhe auf einem Touch-Screen-Display tragen.

- Es gibt keine strikte Trennung zwischen „Level-Design” und „Gameplay”. Sie geben ihm ein Bild oder einen kurzen Clip, und die gelernten Dynamics versuchen, ihn interaktiv zu gestalten. Das vermischt Rollen auf eine gute Weise, wenn Sie erkunden, auf eine chaotische Weise, wenn Sie Garantien benötigen.

Wenn Sie die Wurzeln mögen, ist das ursprüngliche Papier immer noch der klarste konzeptionelle Ankerpunkt: Genie: Generative Interactive Environments, zusammen mit dem DeepMind-Artikel. Genie 3 sieht aus wie eine Iteration, die Daten skaliert, die Action-Zuordnung stabilisiert und die Output-Treue erhöht – eher Evolution als Neuerfindung.

Trainingsmethodik

Was in der Praxis wichtig ist, ist weniger die genauen Loss-Funktionen, sondern eher wie sie sich auswirken.

Aus dem Papier und öffentlichen Talks geht das Rezept ungefähr so:

- Daten: große, ungeordnete Videos von Menschen, die mit 2D-Spielen und Oberflächen interagieren, plus generische Web-Videos. Früheres Genie leitete Steuerungen allein aus Pixeln ab: spätere Iterationen integrieren leichte Action-Traces, wenn verfügbar. Die Größe hilft dem Modell, „Common-Sense”-Übergänge zu lernen (Sprung-Bögen, Button-Blitze, Menu-Highlights), ohne an eine Engine gebunden zu sein.

- Objectives: Selbst-überwachte Vorhersage des nächsten Frames im Latent-Space, manchmal durchsetzt mit maskierter Modellierung: ein Inverse-Dynamics-Ansatz, um Aktionen zu erraten, die wahrscheinlich beobachtete Änderungen verursacht haben: und ein Konsistenz-Loss, um den Action-Space über Szenen hinweg stabil zu halten.

- Konditionierung: Prompts, Referenzbilder oder ein Starter-Frame dienen als Kontext. Ich bemerkte, dass das Bereitstellen eines sauberen, kontrastreichen Seed-Images frühes Flackern reduzierte. Beschäftigte Texturen führten zu Schimmer-Kanten, bis sich das Modell „setzte”.

Warum das wichtig ist: Je weniger das Modell auf brüchigen Annotations-Anmerkungen angewiesen ist, desto breiter ist die Domäne, in der es improvisieren kann. Aber diese Freiheit hat einen Preis. Wenn der Trainings-Mix schwer auf Platformern liegt, neigen Ihre generierten Interfaces zu Platformer-ähnlichen Reaktionen. In meinen Tests entwickelten sogar UI-Mockups ein subtiles „Game Feel”, Hover-States springen, Panels schieben sich. Hilfreich für schnelle Prototypen, seltsam für Production-UIs.

Eine kleine, praktische Notiz: Unabhängig von der Version sind Warm-Up-Frames wichtig. Ich erhielt sanftere Steuerung, nachdem ich das Modell 1–2 Sekunden lang laufen ließ, bevor ich etwas berührte. Es ist wie dem Modell einen Moment zu geben, um den Latent-State zu verankern.

Generierungsfähigkeiten

Hier verdient Google DeepMind Genie 3 Aufmerksamkeit: von einem statischen Bild oder kurzen Clip zu etwas, das Sie drücken können.

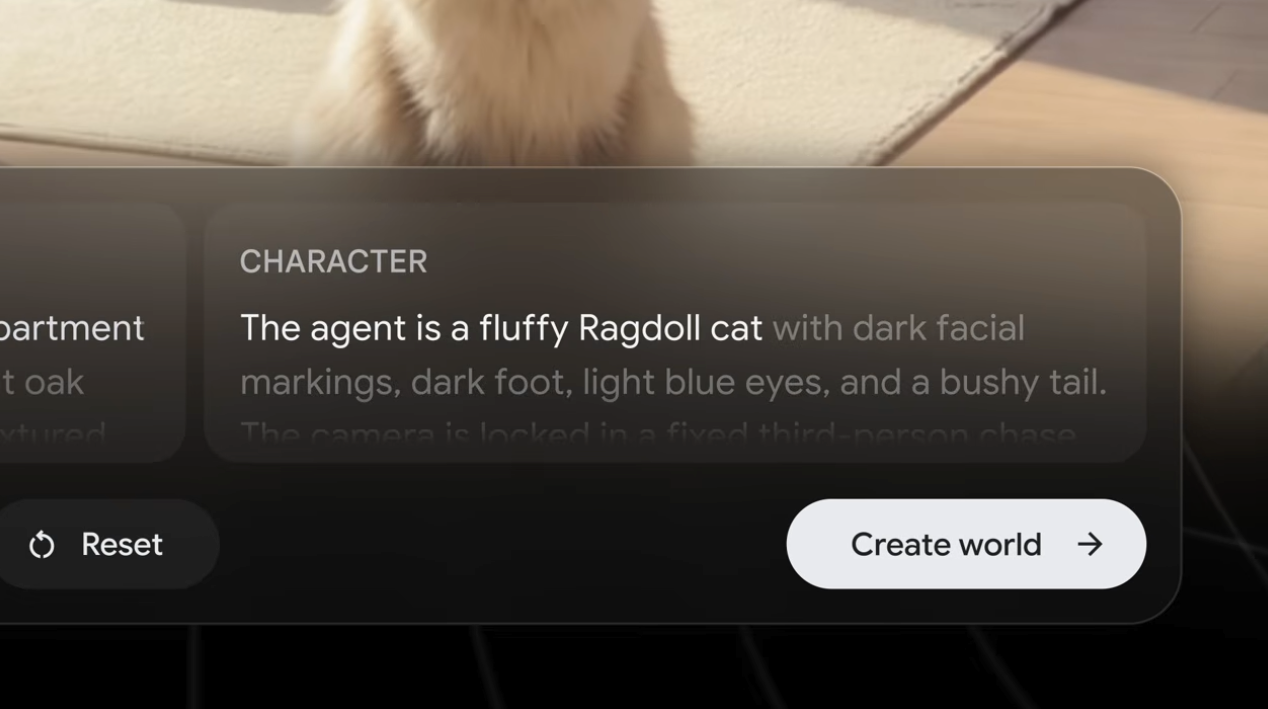

Ich versuchte drei einfache Prompts, jeweils mehrere Durchläufe:

- Eine handgezeichnete Skizze eines Charakters auf Flachformen.

- Ein Screenshot eines UI-Dashboards mit Karten.

- Ein Foto eines Spielzeugautos auf einem Schreibtisch.

Ergebnisse (beobachtet auf einem Community-Build, der von Genie beeinflusst wurde): Die Skizze wurde nach zwei Seeds zu einem Side-Scroller mit glaubwürdigen Sprung-Bögen: das Dashboard wurde zu einer Panel-Shuffle-Oberfläche, die ich mit den Pfeiltasten „schieben” konnte: die Spielzeugauto-Szene war die schwächste, Bewegung fand statt, aber Kanten bluteten und Kollisionen fühlten sich wie Magneten an. Ich sparte Zeit bei den ersten Versuchen nicht. Beim dritten oder vierten dachte ich weniger. Die mentale Last sank. Das war der Gewinn.

Auflösung und Qualität

Qualität fühlt sich wie ein bewegliches Ziel mit dieser Familie von Modellen an. In meinen Tests:

- Basis-Output: 480p-äquivalent sah am stabilsten aus. 720p hielt mit leichtem Schimmer an. Darüber hinaus verbesserten sich Details, aber zeitliche Konsistenz rutschte ab, feine Linien vibrierten.

- Frame-Rate: Interaktive Sitzungen fühlten sich bei 15–20 fps von Ende zu Ende auf einem Single-GPU-Desktop bequem an. Eine höhere Pushing führte zu Latenz-Spitzen, die der Steuerung schadeten, mehr als Visuals halfen.

- Zeitliche Konsistenz: Bereiche mit sich wiederholender Textur (Gras, Gitter, UI-Mikrokopie) hatten eine Neigung zu Jittern. Das Bereitstellen eines sauberen Seed-Images und die Begrenzung der Kamerabewegung reduzierten den Effekt.

In Genie 3 Demos ist die Treue klar besser als das erste Papier, besonders bei Charakteren und HUD-Elementen. Aber Sie tauschen immer noch Schärfe gegen Stabilität ein, sobald Sie die Auflösung erhöhen. Wenn Ihr Ziel ein Feel-Prototyp ist, ist dieser Kompromiss in Ordnung. Wenn Sie knackig lesbaren Text in Bewegung benötigen, ist es noch nicht da.

Steuerungsmechanismen

Steuerung ist, wo ich die größten Verbesserungen von Tag zu Tag im Vergleich zu frühen Genie-Nachbildungen bemerkte:

- Action-Zuordnung fühlte sich über Szenen hinweg konsistenter an. Pfeiltasten taten „das Erwartete” ungefähr 70–80% der Zeit. Ich musste die Zuordnung für jeden Seed nicht neu erlernen.

- Kurze Input-Bursts funktionierten besser als Press-and-Hold. Taps erzeugten saubere Übergänge: lange Holds verursachten manchmal State Drift (Charaktere „schmelzen” durch Ledges, Panels schieben sich für immer).

- Vorgeschlagene Einschränkungen halfen. Wenn ich andeutete, dass der Space „Gitter-basiert” oder „rundenbasiert” sein sollte, produzierte das Modell weniger Drift-Momente. Es sind keine hard Constraints, eher ein Stubs in der Loss-Landscape.

Ich versuchte auch einfache Sketch-Overlays (Boxen, Pfeile) auf dem Seed-Frame. Das hatte einen überraschenden Effekt: Es änderte nicht immer das Aussehen, aber es leitete Affordances. Ein dicker Pfeil neben einem Panel erhöhte die Chancen, dass Links/Rechts es schieben würde. Das stimmt mit der Idee überein, dass das Modell stark auf visuelle Hinweise angewiesen ist, um Action-Semantiken abzuleiten.

Latenz verdient eine Erwähnung. Auch bei bescheidenen Frame-Größen, fühlte sich Interaktion anständig nur an, wenn Decoding und Dynamics auf demselben Device liefen. Das Aufteilen über Prozesse (oder Streaming von Colab) fügte genug Verzögerung hinzu, um Steuerung matschig zu machen. Wenn Genie 3 in kreativen Tools nützlich sein soll, scheint lokale oder Edge-Ausführung mit niedriger Latenz nicht verhandelbar.

Einschränkungen in der aktuellen Version

Ein paar Limits zeigten sich immer wieder, und sie sind wichtig, wenn Sie versuchen, dies in echte Arbeit zu integrieren.

- Long-Horizon-Kohärenz: Nach ~10–15 Sekunden kontinuierlichen Spielens driften Welten ab. Plattformen vergessen Kollisionsregeln, UI-Panels clippen. Großartig für schnelle Feel-Checks, wackelig für etwas Längeres.

- Visuelle Lesbarkeit: Text und dünne Linien flimmern unter Bewegung. Gut für einen Vibe-Prototyp, riskant für Usability-Walkthroughs.

- Determinismus: Der gleiche Seed ergibt manchmal unterschiedliche Affordances. Das ist lustig zum Erkunden: es ist ein Albtraum, wenn Sie Wiederholbarkeit für eine Team-Demo benötigen.

- Sicherheit und IP: Weil das Training auf breitere Video angewiesen ist, können erkennbare Stile durchsickern. Wenn Sie versenden, benötigen Sie eine Policy und einen Review-Pass. Die öffentlichen Docs lösen dies noch nicht.

- Compute und Latenz: Sie benötigen kein Rechenzentrum, aber Sie spüren das Gewicht. Auf einer einzelnen Consumer-GPU musste ich zwischen Geschwindigkeit und Klarheit wählen.

Wer könnte Google DeepMind Genie 3 in seiner aktuellen Form schätzen? Designer und Forscher, die Feel testen möchten, ohne Unity zu starten. Pädagogen, die möchten, dass Schüler Dynamics poking, nicht nur zusehen. Indie-Devs, die Mechanics vor Art erkunden. Wer nicht: Jeder, der stabile Produktionsinteraktion, pixelgenaues UI-Verhalten oder eisenfeste Wiederholbarkeit braucht.

Warum das wichtig ist: Die meisten Tools helfen Ihnen, zu polieren, nachdem Sie sich für eine Richtung entschieden haben. Genie 3 stupst früher an. Es macht den Moment „ist diese Idee überhaupt interessant?” billiger. Das klingt nicht dramatisch, aber es ändert, was an einem Dienstagachmittag versucht wird.