DeepSeek V4 API-Schlüssel: Zugriff erhalten und authentifizieren

Hallo, ich bin Dora. Ich hatte nicht geplant, diese Woche noch ein weiteres Modell zu meiner Liste hinzuzufügen. Ich wollte nur eine Frage beantworten: Könnte ich schnell genug einen DeepSeek V4 API-Schlüssel einrichten, um eine kleine Idee vor dem Mittagessen zu testen? Kein großes Projekt, nur eine schnelle Überprüfung, um zu sehen, wie es sich neben dem verhält, was ich bereits nutze.

Was mich dazu bewegt hat, war eine kleine Reibung: Ich sah ständig „DeepSeek V4” in Repos und Release Notes referenziert, aber die Schritte, um tatsächlich einen API-Schlüssel zu bekommen, wirkten verstreut. Also setzte ich mich hin und ging den Prozess durch. Hier ist, wie es sich in der Praxis anfühlte, was funktionierte, was unklar war, und die kleinen Details, die du wahrscheinlich wissen möchtest, bevor du anfängst.

Kontoregistrierung

Platform-Anmeldung

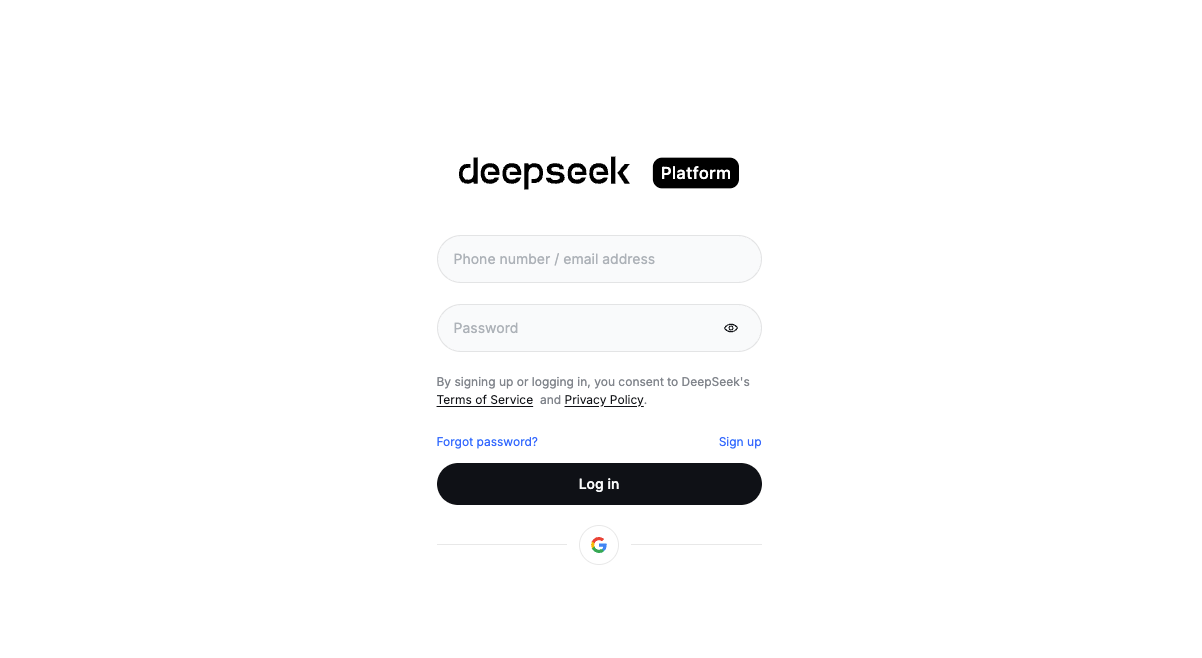

Ich habe mich auf DeepSeeks Plattform mit einer beruflichen E-Mail angemeldet. Nichts Dramatisches hier. Die E-Mail-Bestätigung kam innerhalb einer Minute an. Ich schätzte die Abwesenheit von Verkaufsseiten, nur ein sauberes Dashboard mit Nutzung, Abrechnung und Schlüsseln.

Ich habe mich auf DeepSeeks Plattform mit einer beruflichen E-Mail angemeldet. Nichts Dramatisches hier. Die E-Mail-Bestätigung kam innerhalb einer Minute an. Ich schätzte die Abwesenheit von Verkaufsseiten, nur ein sauberes Dashboard mit Nutzung, Abrechnung und Schlüsseln.

Eine kleine Anmerkung: Ich meide Social Sign-Ins für Entwicklerkonten. Wenn du die Organisation wechselst oder Zugriff auf ein persönliches Konto verlierst, wird es zum Durcheinander. E-Mail + starkes Passwort hielten das ordentlich.

Einmal drin, erstellte ich einen einzelnen Workspace. Wenn du mit Kunden arbeitest oder Nebenprojekte hast, machen separate Workspaces Rate Limits und Abrechnung einfacher zu verstehen. Ich habe das auf die harte Tour bei anderen Anbietern gelernt – ein Token-Spike in einem gemeinsamen Workspace und jeder gerät in Panik.

Kostenlose Token-Guthaben (5M Token erwartet)

Als ich mich registrierte (Januar 2026), zeigte das Dashboard einen kostenlosen Guthaben-Pool, gekennzeichnet mit 5M Token. Ich sah keinen Countdown-Timer oder mutige Promo-Sprache, nur eine stille Zahl im Nutzungs-Panel. Hilfreich und genug, um ein paar echte Tests durchzuführen, ohne eine Karte rauszuholen.

Zwei praktische Hinweise:

- Kostenlose Stufen ändern sich. Ich habe gesehen, dass sie sich ohne Drama ändern, einfach eine Zeile im Changelog. Wenn du einen Build planst, überprüfe die aktuelle Dokumentation und Preisseite, bevor du dich festlegst.

- „5M Token” klingt groß. Das ist es auch, aber wenn du lange Responses streamst oder Batch-Jobs ausführst, kannst du es schneller aufbrauchen, als du denkst. Ich stellte sanfte Warnungen bei 60% und 90% der Nutzung ein. Eine günstige Schutzmaßnahme gegen überraschende Kosten, sobald du kostenpflichtig wirst.

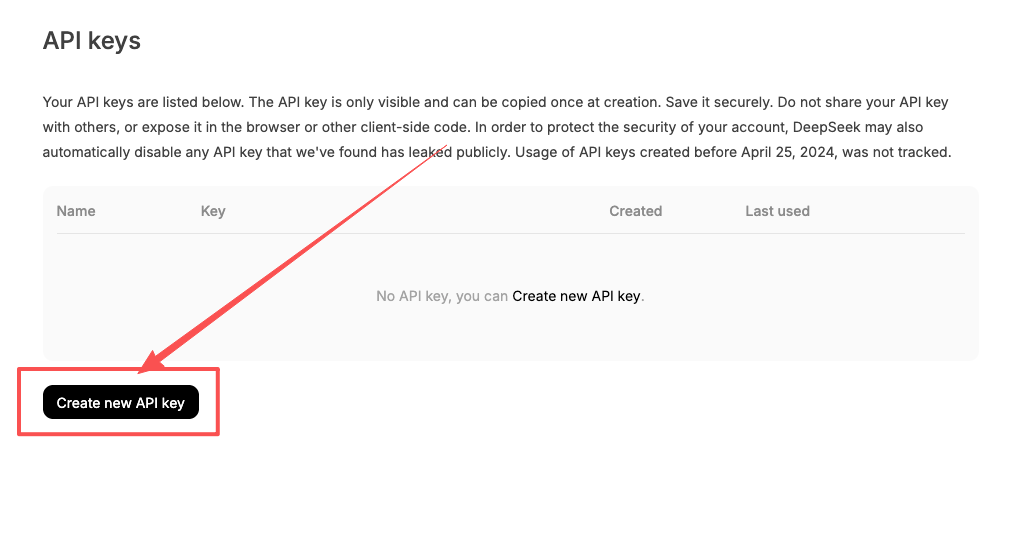

API-Schlüsselerzeugung

Vom Dashboard aus gibt es einen Bereich „Schlüssel” oder „API”, in dem du einen neuen Schlüssel erstellen, ihm ein Label geben und den Umfang wählen kannst, falls vorhanden. Ich nannte meinen „v4-scratchpad-jan26.” Langweilige Namen altern gut.

Meine kleine Erleichterung: Schlüssel waren sofort nach der Erstellung aktiv. Keine Wartezeit, kein zusätzlicher Überprüfungsschritt. Ich kopierte die Zeichenkette und warf sie in meinen Secret Manager. Wenn du versucht bist, ihn in einer .env-Datei ohne Verschlüsselung zu speichern, weil es „nur zum Testen” ist, verstehe ich es. Ich habe es getan. Aber ich habe auch schon Schlüssel um 2 Uhr morgens rotiert, weil ein Demo-Notebook öffentlich gepusht wurde. Also speichere ich diese Tage Schlüssel dort, wo ich sie nicht vergesse, und rotiere nach einem einfachen Zeitplan (monatlich oder nach jeder gemeinsamen Demo).

Meine kleine Erleichterung: Schlüssel waren sofort nach der Erstellung aktiv. Keine Wartezeit, kein zusätzlicher Überprüfungsschritt. Ich kopierte die Zeichenkette und warf sie in meinen Secret Manager. Wenn du versucht bist, ihn in einer .env-Datei ohne Verschlüsselung zu speichern, weil es „nur zum Testen” ist, verstehe ich es. Ich habe es getan. Aber ich habe auch schon Schlüssel um 2 Uhr morgens rotiert, weil ein Demo-Notebook öffentlich gepusht wurde. Also speichere ich diese Tage Schlüssel dort, wo ich sie nicht vergesse, und rotiere nach einem einfachen Zeitplan (monatlich oder nach jeder gemeinsamen Demo).

Eine Sache, die ich aus der Benutzeroberfläche allein nicht bestätigen konnte, waren Rate Limits pro Schlüssel. Einige Plattformen machen das explizit: andere nicht. Wenn du in Produktion gehst, würde ich fragen:

- Gibt es Org-Level vs. Key-Level Rate Caps?

- Kann ich einen Schlüssel auf bestimmte Modelle beschränken (z. B. nur deepseek-v4)?

- Gibt es eine einfache Möglichkeit, einen einzelnen Schlüssel zu widerrufen, ohne den Rest zu berühren?

Ich sah in meiner Sitzung keine granularen Umschalter, was für frühes Testen in Ordnung ist. Für Teamnutzung würde ich eine kurze Rotationsrichtlinie planen und jeden Service als austauschbar behandeln, schneller Widerruf, schneller Austausch.

Authentifizierungsheader

Dieser Teil war unkompliziert. Anfragen erwarten ein Standard-Bearer Token. In einfachen Worten:

- Autorisierungsheader verwendet das Format: Authorization: Bearer YOUR_API_KEY

- Content-Type ist application/json für JSON-Anfragen.

Wenn du mit OpenAI-ähnlichen Endpoints gearbeitet hast, wirkt die Form vertraut. Das half mir, schneller voranzukommen. Ich wiederverwendete meinen existierenden HTTP-Client, wechselte die Basis-URL und den Modellnamen und ließ den Rest unverändert.

Ein paar kleine Details, auf die ich achte:

- Timeouts: Ich stelle einen engeren Client-Timeout für erste Anfragen ein (10–15 Sekunden). Wenn etwas falsch konfiguriert ist, würde ich lieber schnell fehlschlagen, als zu raten.

- Wiederholungen: Ich verwende einen einfachen Backoff (z. B. exponentiell mit Jitter) bei 429 oder 5xx Responses. Der erste Tag mit einer neuen API ist nicht der Tag, um perfekte Verfügbarkeit anzunehmen.

- Modellnamen: Ich verwendete den expliziten Modellbezeichner für V4 (z. B. „deepseek-v4”). Rechtschreibung zählt. Ein Tippfehler kann wie ein Authentifizierungsfehler aussehen, wenn es tatsächlich ein Model-not-found-Fehler ist.

Zur Sicherheit: Ich meide das Versenden von Schlüsseln von Browser-Clients. Wenn du musst, proxy vom Server, füge kurzlebige Token ein oder verwende ein Gateway mit anforderungsgebundenen Regeln. Es ist eine zusätzliche bewegliche Teil, aber es ist billiger als Incident Handling später.

Testen deiner Verbindung

Ich führte unmittelbar nach der Erstellung des Schlüssels einen schnellen Shakeout-Test durch. Nichts Ausgefallenes, nur eine einzelne Anfrage, eine kleine max_token-Einstellung und Logging eingeschaltet. Meine Checkliste sah so aus:

Ich führte unmittelbar nach der Erstellung des Schlüssels einen schnellen Shakeout-Test durch. Nichts Ausgefallenes, nur eine einzelne Anfrage, eine kleine max_token-Einstellung und Logging eingeschaltet. Meine Checkliste sah so aus:

-

Sende eine kleine Anfrage mit einem deterministischen Setup

- Stelle die Temperatur niedrig ein (0–0,3), damit die Outputs über Wiederholungen hinweg stabil sind.

- Halte max_tokens klein (z. B. 128), um zu vermeiden, den kostenlosen Pool beim Testen zu verschwenden.

- Füge eine klare Systemerinnerung ein, damit die Response kurz und prägnant ist.

-

Bestätige die Grundlagen

- 200 Response schnell zurückgegeben? Gut.

- Fehler enthalten lesbare Nachrichten? Noch besser. Ich möchte „ungültige Authentifizierung” oder „Modell nicht gefunden”, nicht einen Mysteriencode.

- Usage-Objekt vorhanden? Ich protokolliere Prompt- und Completion-Token-Zählungen bei jedem Aufruf. Das summiert sich zu einem grundlegenden Kostenledger ohne Tabellenkalkulationen.

-

Verursache absichtlich einen Fehler

- Verwende einen gefälschten Schlüssel, um zu bestätigen, dass der Client einen sauberen Auth-Fehler anzeigt.

- Rufe ein Modell auf, das nicht existiert, um zu sehen, wie sich Fehler unterscheiden.

- Stelle einen winzigen Timeout vorübergehend ein, um sicherzustellen, dass deine Retry-Logik arbeitet.

Wie es sich in der Praxis anfühlte

- Latenz der ersten Anfrage: akzeptabel. Bei einem kalten Start dauerte mein anfänglicher Aufruf etwas länger als mein üblicher Anbieter, aber der zweite und dritte waren stabil. Ich maß dies nicht mit Präzision, das war ein Vibes-Check, kein Benchmark.

- Ausgabequalität: solide. V4 handhabte eine strukturierte Anfrage gut (System + User Messages). Keine seltsame Kürzung, wenn ich max_tokens klein hielt.

- Fehlerklarheit: anständig. Ich erhielt lesbare Nachrichten, wenn ich Fehler erzwang, was während der Einrichtung hilft.

Ein paar Fallstricke, die ich für alle flaggen würde, die dies bald versuchen:

- Endpoints bewegen sich. Wenn du aus einem Gist kopierst, überprüfe den Pfad gegen die aktuelle Dokumentation. Anbieter verschiffen manchmal OpenAI-kompatible Routen neben nativen, und kleine Unterschiede (wie „/chat/completions” vs. „/responses”) können eine Anfrage kaputt machen.

- Streaming fügt Komplexität hinzu. Wenn du es aktivierst, stelle sicher, dass dein Client tatsächlich den Event Stream liest. Ich halte einen Non-Streaming-Test in der Suite für schnelle Gesundheitschecks.

- Rate Limits sind nicht immer offensichtlich am ersten Tag. Ich simuliere einen Ausbruch kleiner Aufrufe (5–10 in schneller Abfolge), um zu sehen, wo die Grenzen sind. Wenn ich 429s treffe, stimme ich meinen Backoff früh ab.

Warum das für mich wichtig war

Ich suchte nicht nach einem neuen Hammer. Ich wollte ein Modell, das ich für alltägliche Aufgaben aufrufen konnte, strukturiertes Schreiben, grobe Analysen und kleine Refaktorierungen, ohne mit einem SDK zu ringen. Das Einrichten des DeepSeek V4 API-Schlüssels fühlte sich erfrischend gewöhnlich an. Das ist ein Kompliment. Ich musste meinen Client nicht überdenken oder mit einem neuen Auth-Muster tanzen.

Ich suchte nicht nach einem neuen Hammer. Ich wollte ein Modell, das ich für alltägliche Aufgaben aufrufen konnte, strukturiertes Schreiben, grobe Analysen und kleine Refaktorierungen, ohne mit einem SDK zu ringen. Das Einrichten des DeepSeek V4 API-Schlüssels fühlte sich erfrischend gewöhnlich an. Das ist ein Kompliment. Ich musste meinen Client nicht überdenken oder mit einem neuen Auth-Muster tanzen.

Wer könnte das mögen

- Builder, die bereits einen OpenAI-ähnlichen Client haben und ein anderes modernes Modell mit minimalem Glue Code wollen.

- Teams, die einen bedeutungsvollen kostenlosen Token-Pool für frühe Erkundung schätzen. Du kannst echte Tests durchführen, ohne eine Abrechnungsklippe zu treffen.

- Neugierige Menschen, die lieber mit ihren eigenen Prompts evaluieren, anstatt durch Beispiele zu blättern.

Wer könnte nicht

- Wenn du vom ersten Tag an strikte Enterprise-Controls brauchst (SAML, Pro-Key-Bereiche, Org-Level Policy Dashboards), überprüfe die aktuellen Enterprise Docs doppelt. Du könntest einen schnellen Anruf mit dem Verkauf benötigen, um zu bestätigen, was jetzt bereit ist.

- Wenn dein Stack sich auf ein bestimmtes SDK stützt, stelle sicher, dass DeepSeeks offizieller oder Community-Client die benötigten Funktionen unterstützt (Streaming, Tools/Funktionen, JSON-Modus). Ich verwendete rohes HTTP für diesen Pass, um Überraschungen zu vermeiden.

Eine letzte praktische Anmerkung

Ich halte ein winziges „first-request”-Skript für jeden Anbieter, den ich nutze. Ein Befehl, ein bekannter Prompt, eine erwartete Form. Es fängt Bruch früh, wenn Anbieter Änderungen verschiffen. Nach dem Hinzufügen von DeepSeek V4 zu dieser Liste führte ich es am nächsten Morgen erneut aus. Immer noch grün.

Das funktionierte für mich, deine Laufleistung kann variieren. Wenn du ein paar Modelle jonglierst und sauberes Setup mit verständigen Standardwerten magst, lohnt es sich, einen Blick zu werfen.

Ich hinterlasse es hier: Der Teil, den ich am meisten schätzte, war keine Schlagzeilen-Funktion. Es war das stille, vorhersehbare Setup. Die Art, die in den Hintergrund verblasst, damit du dich zur eigentlichen Arbeit zurück begeben kannst.

Häufig gestellte Fragen

Wie bekomme ich schnell einen DeepSeek V4 API-Schlüssel?

Melde dich auf der DeepSeek-Plattform mit E-Mail an, bestätige und öffne dann den Bereich „Schlüssel/API” des Dashboards, um einen beschrifteten Schlüssel zu erstellen (z. B. „v4-scratchpad-jan26”). Schlüssel werden sofort aktiviert. Speichere ihn in einem Secret Manager, nicht in einer einfachen .env-Datei, und plane regelmäßige Rotationen für Sicherheit.

Enthält DeepSeek V4 eine kostenlose Token-Zuweisung und wie sollte ich sie verwalten?

Bei Tests im Januar 2026 zeigte das Dashboard 5M kostenlose Token an, aber kostenlose Stufen können sich ändern. Überprüfe aktuelle Preise/Dokumentation, bevor du baust. Stelle sanfte Warnungen bei 60% und 90% Nutzung ein, um Überraschungen zu vermeiden, besonders wenn du streamst oder Batch-Jobs ausführst, die Token schnell verbrauchen.

Wie authentifiziere ich Anfragen mit einem DeepSeek V4 API-Schlüssel?

Verwende Authorization: Bearer YOUR_API_KEY und Content-Type: application/json. Die API wirkt OpenAI-ähnlich: Wechsle die Basis-URL und gib den korrekten Modellnamen an (z. B. „deepseek-v4”). Vermeide das Verfügbarmachen von Schlüsseln in Browsern; Proxy durch deinen Server oder verwende kurzlebige Token, um Risiken zu reduzieren.