ComfyUI-LTXVideo Extension: LoRA-Unterstützung, Workflows & Wann Sie Es Brauchen

Beim ersten Versuch mit ComfyUI LTXVideo war ich nicht auf der Suche nach neuen Funktionen. Ich wollte nur eine zuverlässige Möglichkeit, um ein grob skizziertes Storyboard in Bewegung umzuwandeln, ohne dabei jeden Frame überwachen zu müssen. Mein kleines Problem: noch ein “fehlender Knoten”-Fehler nach einem langen Tag. Ich wäre fast aus dem Fenster gefahren. Stattdessen gab ich ihm die Woche (Anfang Januar 2026) und ließ es durch ein paar echte Projekte laufen: eine 12-Sekunden-Produktschleife, ein Unterrichtsschnipsel für einen Kurs und eines dieser Texture-to-Motion-Experimente, das entweder clever oder verflucht aussieht. Was ich fand, war keine Magie. Aber es machte die Arbeit an ein paar stillen Stellen leichter. Das ist normalerweise das Signal, das ich suche.

Kern eingebaut vs. Erweiterung: Was ist der Unterschied?

Ich sah ständig Leute über “LTXVideo-Unterstützung in ComfyUI” sprechen, aber es war nicht klar, was nativ war und was zusätzliche Teile brauchte. Hier ist, was ich in der Praxis bemerkt habe.

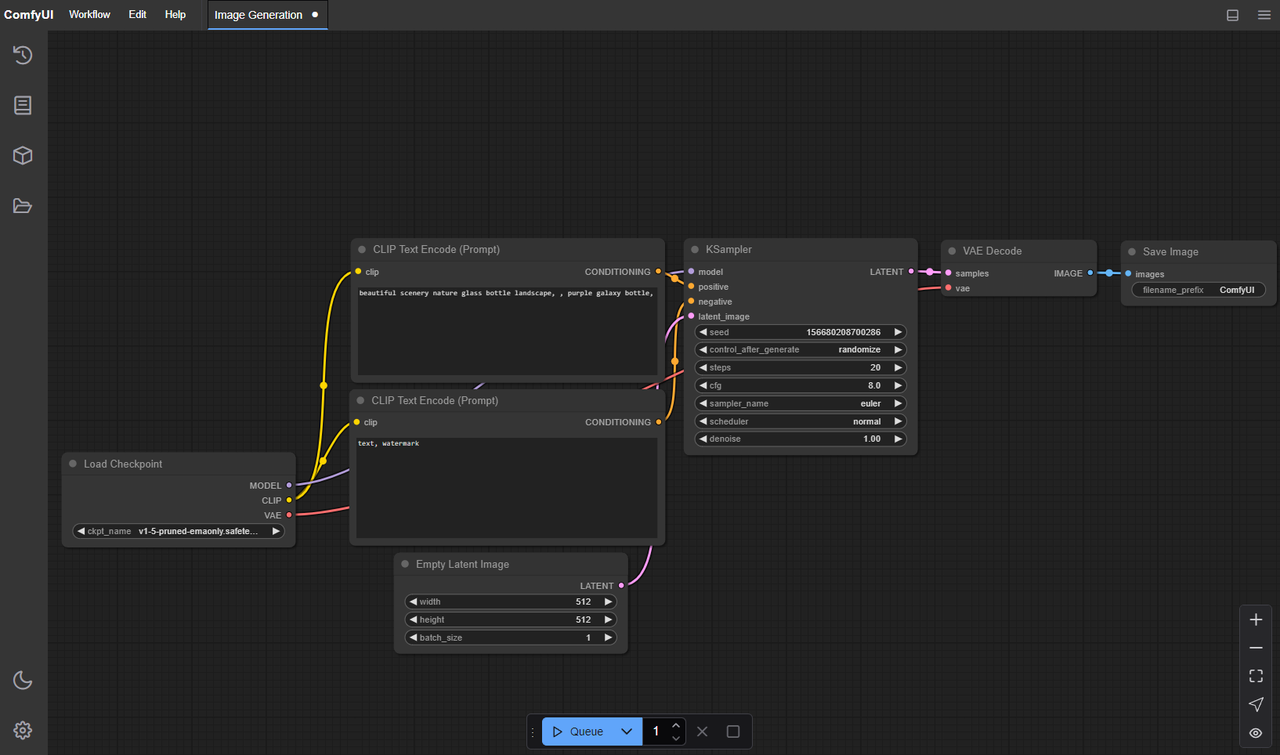

- Kern (ComfyUI Basis): Sie können allgemeine Text-zu-Bild/Video-Flows verdrahten, Sampler planen und Konditionierung verwalten. Die Basis-App ist robust für das Routing von Daten, die Vorschau von Frames und die Aufrechterhaltung reproduzierbarer Läufe. Aber es bringt standardmäßig keine spezialisierten LTX-Video-Knoten mit sich.

- Erweiterung (benutzerdefinierte LTXVideo-Knoten): Dies fügt modellabhängige Knoten (Loaders, Sampler, Conditioning-Blöcke) hinzu, die um die LTX-Video-Architektur herum gebaut sind. Die Erweiterung versteht die Bewegungslänge des Modells, die Kontextfenster und die kleinen Einschränkungen, die nicht sauber zu generischen Knoten passen.

Der Unterschied zeigt sich, wenn man versucht, weniger manuelle Verklebung zu tun. Mit nur Kernknoten jonglierte ich mit Tensorformen, riet zu Defaults und traf auf Formfehler. Mit installierter Erweiterung wurde der Graph kürzer und Fehler sanken. Ich musste immer noch denken, nur nicht über Rohre.

Ein kleines Beispiel: Ich baute eine 8–12 Sekunden lange Schleife mit konsistentem Licht. Nur-Kern dauerte mir ~45 Minuten zum Stabilisieren: Glauben Sie mir, die Erweiterungsversion lief beim zweiten Versuch sauber (etwa 15 Minuten), weil der vorverkabelte Sampler und Video-Assembler die Frame-Ausrichtung ohne mein Herumfummeln handhabten.

Also, wenn Sie evaluieren: Der Kern reicht aus, wenn Sie volle Kontrolle mögen und sich nicht um Verdrahtung kümmern. Die Erweiterung ist für den Fall, dass Ihnen wiederholbare Läufe mehr am Herzen liegen als handgestimmte Rohre.

Was die Erweiterung hinzufügt (Workflows / Knoten / LoRA)

Ich erwartete nicht viel, als ich in die Beispielgraphen klickte, ich habe zu viele “Anfänger”-Workflows gesehen, die grundsätzlich Screenshots sind. Diese waren besser als das.

Was mir geholfen hat:

- Zweckgebaute Knoten: Modell-Loader für LTX-Video, ein Motion-Längen-Selektor, der ungerade Frame-Zahlen vermeidet, und ein Sampler, der die Timing-Sweet-Spots des Modells respektiert. Sie entfernen ein paar Fallstricke, die normalerweise erst nach einem fehlgeschlagenen Render auftauchen.

- Beispiel-Workflows: Drei, zu denen ich immer wieder zurückgegriffen habe, Text-zu-Video-Basis, Bild-zu-Video mit Motion-Injektion und Style-Transfer mit LoRA. Jede ist klar genug, um zu beginnen, aber nicht so starr, dass man Teile nicht austauschen kann.

- LoRA-Hooks: Die Erweiterung macht LoRA-Stärke und -Kombination sauber verfügbar. Ich könnte einen Style-LoRA mit einem leichten Identity-LoRA stapeln und die Motion trotzdem stabil halten. Ich muss sagen, das ist selten bei frühen Video-Setups.

Eine kleine Überraschung: Die Standard-Farbbehandlung fühlte sich ruhiger an als die meisten anderen Open-Video-Modelle, die ich versucht habe. Blautöne explodierten nicht. Die Haut blieb in einem glaubwürdigen Bereich. Ich musste die Belichtung immer noch anpassen, aber ich war nicht am Kämpfen mit der Sättigung.

Grenzen, auf die ich gestoßen bin:

- Lange Sequenzen (über ~12–16 Sekunden) drifteten, es sei denn, ich führte Anker-Keyframes ein oder teilte den Lauf auf. Das ist in diesem Stadium normal, aber erwähnenswert.

- Starkes LoRA-Stapeln kann Motion wackeln lassen. Zwei sind in Ordnung, drei sind riskant, es sei denn, Sie unterdrücken die Stärke.

Installations- und Update-Schritte

Vorbereitung

- Aktualisieren Sie ComfyUI auf einen neueren Build. Ich habe die Januar-2026-Nightly auf beiden Maschinen verwendet.

- Python 3.10–3.11 funktionierte am besten. Ich hielt eine frische venv pro Maschine.

Installieren Sie die LTXVideo-Erweiterung

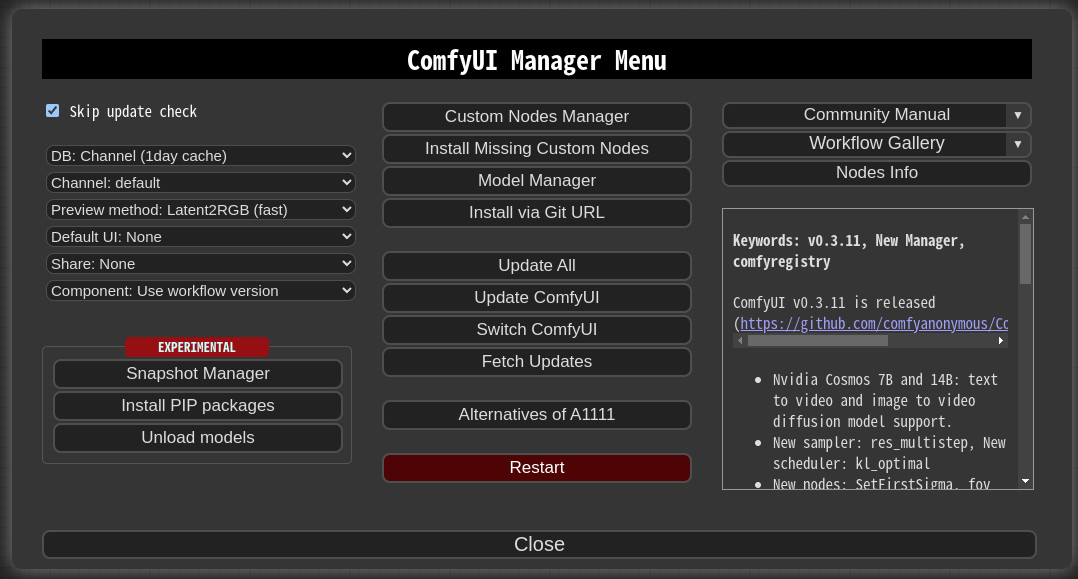

- Nutzen Sie ComfyUI-Manager, wenn Sie ihn haben: Suchen Sie nach “LTXVideo” oder “ComfyUI-LTXVideo” und installieren Sie.

- Manuelle Route: Klonen Sie das Repo in ComfyUI/custom_nodes. Dann installieren Sie Anforderungen (

pip install -r requirements.txt) in Ihrer Umgebung.

Modelle

- Legen Sie die LTX-Video-Checkpoint(s) dort ab, wo die Erweiterung sie erwartet. Die meisten Versionen sehen unter

models/ltxvideoodermodels/checkpointsnach: der Knoten sagt Ihnen normalerweise beim Überfahren den genauen Pfad an. - Wenn Sie LoRA verwenden, legen Sie diese unter

models/lorasab (oder was der Knoten als Standard auflistet).

CUDA und Runtimes

- Linux mit CUDA 12.x und PyTorch 2.3+ funktionierte reibungslos. Auf macOS funktionierte Metal, aber ich hielt die Batch-Größen klein.

- Wenn Sie Speicherspitzen beim ersten Lauf sehen, reduzieren Sie die Motion-Länge oder stellen Sie eine niedrigere Dekodierungspräzision ein, wenn der Knoten sie offenlegt.

Updates

- Ziehen Sie das Neueste aus dem Erweiterungs-Repo. Installieren Sie Anforderungen neu, wenn große Commits landen (Ich bin auf einen torch-vision-Mismatch und einen protobuf-Bump gestoßen: beide wurden mit einer sauberen Neuinstallation behoben).

- Löschen Sie den ComfyUI-Cache, wenn Knoten nach einem Update nicht erscheinen. Ein schneller Neustart behebt oft veraltete Importe.

Zeitaufwand: Die erste Installation dauerte mich ~20 Minuten auf einer sauberen Linux-Box, ~30 Minuten auf macOS, weil ich ein paar Metal-Builds neu verlinken musste. Updates waren Minuten, es sei denn, Abhängigkeiten ändern sich.

Beispiel-Workflows Durchgang

Ich lief drei Workflows mehrmals durch, tunkte gerade genug, um zu sehen, wie stabil sie sind.

Ich lief drei Workflows mehrmals durch, tunkte gerade genug, um zu sehen, wie stabil sie sind.

1. Text-zu-Video (Basis)

- Setup: Prompt, negativer Prompt, der LTX-Video-Loader, der Sampler des Modells und ein Video-Writer bei 512–768 auf der kurzen Kante. Ich hielt die Motion-Länge auf 8–12 Sekunden.

- Beobachtungen: Der erste Durchgang traf fast nie das genaue Timing, aber er gab mir einen stabilen “Basis-Take”. Der zweite Durchgang mit kleinen Prompt-Edits behoben die meisten Probleme. Jeder Render war 2–4 Minuten auf der A6000, ~6–8 auf dem M3 Max.

- Kleiner Tipp: Wenn Motion schwammig aussieht, straffen Sie die zeitliche Anleitung an oder reduzieren Sie die CFG um eine Stufe. Für mich war 4,5–6,5 das verwendbare Band.

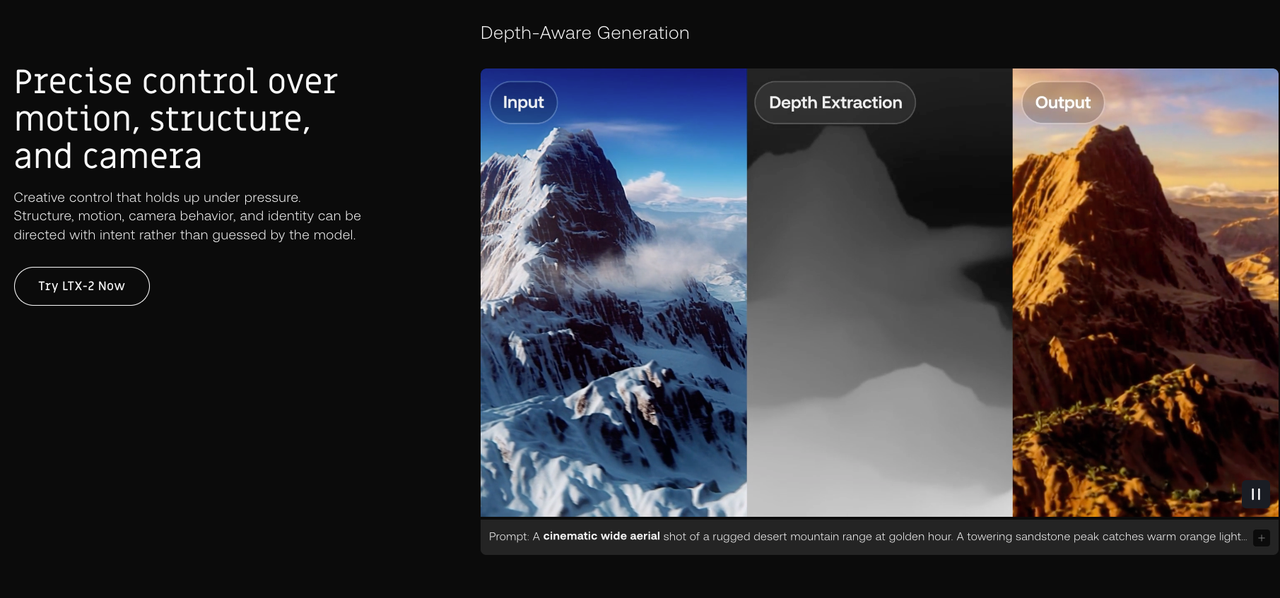

2. Bild-zu-Video mit Motion-Injektion

- Setup: Ein einzelnes Referenzbild plus ein schwaches Style-LoRA, um die Textur konsistent zu halten. Ich nutzte den Motion-Knoten der Erweiterung, um die Kameradrift zu lenken, anstatt sie die Bewegung erfinden zu lassen.

- Beobachtungen: Dies sparte beim ersten Versuch keine Zeit, ich überabstimmte. Beim dritten Lauf erkannte ich, dass es die mentale Last senkte: weniger Artefakte zum Sortieren, weniger “Was ist denn da in der Ecke?”-Überraschungen.

- Praktischer Hinweis: Wenn sich das Motiv um Frame 3–5 verformt, fügen Sie ein Bild oder Anker-Frame in der Mitte hinzu. Ich nutzte zwei Anker für einen 10-Sekunden-Clip und es fühlte sich gesperrt an.

3. Style mit LoRA (plus leichte Identity)

- Setup: Basis-Prompt, ein Style-LoRA bei 0,6–0,8, Identity-LoRA bei 0,2–0,3, und konservative Motion.

- Beobachtungen: Die Kombination hielt besser, als ich erwartet hatte. Stärker als 0,8 im Style begann die Texturen zu “glänzen”, schön für Poster, seltsam für Motion. Das Halten der Identity niedrig vermied unheimliche Verschiebungen.

- Export: Ich schrieb zu ProRes für Grading. H.264 ist in Ordnung für schnelle Checks, aber die Farben sahen besser aus, wenn ich einen leichten Pass in Resolve machte.

In den Läufen sparte ich vielleicht 15–20 Minuten pro Clip gegenüber dem Nähen von generischen Knoten. Der größere Gewinn war weniger Neustarts. Weniger Herumfummeln, mehr Entscheiden.

LoRA & IC-LoRA Basics

Ich neige dazu, LoRA nur dann zu erreichen, wenn ich sie brauche. Mit LTXVideo sind sie den zusätzlichen Schritt wert, besonders für Konsistenz.

Ich neige dazu, LoRA nur dann zu erreichen, wenn ich sie brauche. Mit LTXVideo sind sie den zusätzlichen Schritt wert, besonders für Konsistenz.

- LoRA: Stellen Sie sich es als einen leichten stilistischen Fingerabdruck vor. Im Video sanft drücken. Stärken über ~0,8 sehen spröde aus, da sich die Motion ansammelt.

- Identity-LoRA: Hilfreich, um einen Charakter oder ein Produkt über Frames hinweg stabil zu halten. Ich mochte Werte im Bereich 0,15–0,35.

- IC-LoRA (bildgesteuerte LoRA): Hier fand ich den meisten praktischen Wert. Das Eingeben eines sauberen Referenzbildes in IC-LoRA stabilisierte Details (Logos, Gesichter), ohne die Szene einzufrieren. Ich nutzte ein klares frontal ausgerichtetes Bild und manchmal einen Seitenwinkel als sekundären Hinweis.

Was in der Praxis zählt:

- Saubere Referenzen schlagen clevere Prompts. Garbage in, garbage out, und es zeigt sich mehr in Motion.

- Weniger mischen, leichter abstimmen. Zwei LoRAs leicht angewendet funktionierte besser als drei, die miteinander kämpfen.

- Neu-seeden, wenn Mikro-Zittern auftaucht. Ein neuer Seed plus die gleichen Anker lösten oft winziges Flackern des Gesichts.

”Fehlender Knoten”-Fixes

Ich traf auf drei Arten von “fehlender Knoten” beim Testen. Keine waren dramatisch, aber sie unterbrechen den Flow.

- Erweiterung nicht geladen: Stellen Sie sicher, dass der LTXVideo-Ordner unter

ComfyUI/custom_nodessitzt und dass er eine__init__.pyhat. Starten Sie ComfyUI neu. Wenn das Log Import-Fehler zeigt, installieren Sie Anforderungen für diesen Knoten neu. - Abhängigkeits-Drift: Torch/CUDA-Mismatches zeigen sich als Import-Fehler. Richten Sie PyTorch- und CUDA-Versionen aus, die in der README der Erweiterung aufgelistet sind. Eine frische venv ist schneller als das Debuggen einer verworrenen.

- Alte Workflows, neue Knoten: Einige Graphen referenzieren umbenannte Knoten. Öffnen Sie die JSON, suchen Sie nach der Knotenklasse und ordnen Sie sie dem neuen Namen zu. Erweiterungs-CHANGELOGs notieren normalerweise diese.

Schnelle Sanity Checks:

- Aktualisieren Sie ComfyUI-Manager, dann “auf Updates scannen”.

- Löschen Sie den ComfyUI-Cache und starten neu.

- Bestätigen Sie Modellpfade im Load-Knoten, ein fehlender Checkpoint sieht genauso aus wie ein fehlender Knoten aus Sicht der UI.

Wenden Sie diese Workflows auf WaveSpeed an

Ich habe einen Cloud-Run versucht, um zu sehen, wie sich dies weg von meinem Schreibtisch übersetzt. Auf WaveSpeed drehte ich einen ComfyUI-Arbeitsbereich mit einer RTX-Klasse-GPU und ließ die LTXVideo-Erweiterung auf die gleiche Weise fallen.

Zwei Hinweise, wenn Sie diesen Weg gehen:

Zwei Hinweise, wenn Sie diesen Weg gehen:

- Halten Sie Ihre Modelle organisiert: Ich habe LTX-Video-Checkpoints und LoRAs zuerst in die erwarteten Ordner synchronisiert (

models/ltxvideo,models/loras), dann die Beispielgraphen geöffnet. Glauben Sie mir, keine Überraschungen, sobald die Pfade passten. - Lauf-Längen: Eine Cloud-GPU ließ mich 12–16 Sekunden lange Clips in höherer Auflösung testen, ohne mir Sorgen um VRAM zu machen. Es fixierte Drift nicht von selbst, aber es machte die Iteration schneller, ich könnte drei Takes parallel rendern und den Keeper aussuchen.

Wenn Sie auf einem Laptop arbeiten, ist dies ein stressfreier Weg, um Ideen zu testen, bevor Sie sich lokalen Installationen widmen. Ihr Kilometerstand kann unterschiedlich sein, aber es sparte mir ein paar nächtliche Kompilierungsschleifen.

Der kleine, verbleibende Gedanke: LTXVideo in ComfyUI versucht nicht, Sie gleich begeistern zu wollen. Es reduziert einfach die Anzahl der Dinge, die Sie auf einmal im Kopf behalten müssen. An beschäftigten Tagen reicht das.