As Replicate is joining Cloudflare, Builders Need Stability More Than Ever — Why Thousands Are Moving Their Multimodal Workloads to WaveSpeedAI

Die KI-Welt bewegt sich schnell — aber manchmal in Richtungen, die Produktteams nicht voraussehen.

Wenn eine große multimodale KI-Plattform akquiriert wird, treten schnell Ripple-Effekte auf: unsichere Preisgestaltung, sich verschiebende Prioritäten, neu eingeführte Beschränkungen und ein Roadmap, der möglicherweise nicht mehr den Entwicklern dient, die darauf aufgebaut haben.

Für Teams, die multimodale Workloads ausführen — besonders Image- und Videogenerierung — ist Unsicherheit nicht nur unpraktisch. Sie ist teuer. Sie ist riskant. Und sie wirkt sich direkt auf die Produktzuverlässigkeit aus.

Dies ist der Moment, in dem sich viele Teams selbst fragen: „Ist meine KI-Infrastruktur auf das ausgerichtet, wohin sich mein Produkt als nächstes entwickeln muss?”

Eine wachsende Anzahl beantwortet diese Frage, indem sie zu WaveSpeedAI wechselt.

Ein neuer Standard entsteht: Hochgeschwindigkeit, hohe Stabilität Multimodale Inferenz

WaveSpeedAI wurde nicht als allgemeine Modell-Hosting-Plattform entwickelt. Es wurde als Multimodale Beschleunigungsmaschine konzipiert, von Grund auf optimiert für Produktions-Workloads, vorhersehbare Latenz und reale Skalierung.

Teams, die zu WaveSpeedAI wechseln, weisen konsistent auf drei Unterschiede hin, die sie sofort bemerken:

1. Blitzschnelle Geschwindigkeit — angetrieben durch unsere benutzerdefinierte Inference-Engine

Unsere Architektur verbindet mehrere Inference-Schritte und plant GPU-Workloads dynamisch, was Folgendes ermöglicht:

- Bis zu 3× schneller als typische Plattformen

- Hochstabile Leistung, auch unter hoher Nebenläufigkeit

- Branchenführender Durchsatz für anspruchsvolle Video-Workloads

Für videogesteuerte Produkte ändert dies allein, was möglich ist.

2. Vorhersagbarkeit — die am meisten unterschätzte Anforderung in der KI-Infrastruktur

Sie brauchen Zuversicht, dass die Leistung von morgen der Leistung von heute entspricht.

WaveSpeedAI sorgt dafür durch:

- Konsistente, niedrige Latenz-Leistung über Modelle hinweg

- Schnelle Updates, die mit den neuesten Multimodal-Releases abgestimmt sind

- Produktionsreife-Verfügbarkeit und Leistungsgarantien

Ihre Benutzer sollten niemals Instabilität erleben, die durch Ihren KI-Stack verursacht wird.

3. Ein Modell-Ökosystem, das für Builder konzipiert ist, nicht gesperrte Plattformen

WaveSpeedAI integriert führende Image- und Video-Modelle — einschließlich WAN, Veo, Seedance, Hunyuan, Kling, MiniMax, HiDream und mehr — die alle direkt auf unserer Engine optimiert sind.

Sie erhalten nicht nur Zugriff. Sie erhalten die schnellsten, produktionsreifen Versionen dieser Modelle.

Ein reibungsloses Migrationspfad — Weil kein Team Reibung möchte

Plattformen wie Replicate haben die API-first-Entwicklung vereinfacht.

WaveSpeedAI setzt diese Einfachheit fort — mit deutlich höherer Leistung darunter.

Teams, die zu WaveSpeedAI migrieren, profitieren von:

- Eine einheitliche API, die bestehende Endpoints mit minimalen Code-Änderungen ersetzt

- Automatische GPU-Optimierung, die die Auslastung um bis zu 300% verbessern kann

- Öffentliche API- und Private-Cluster-Deployment-Optionen für sicherheitsempfindliche Workloads

- Praktische Unterstützung, um bestehende Workflows nahtlos zu spiegeln

Migration sollte nicht Ihr Roadmap verlangsamen. Wir sorgen dafür, dass sie nicht verlangsamt wird.

Warum Teams jetzt umziehen

Überall bei Startups, Plattformen und Enterprise-KI-Teams klingen die Motivationen bemerkenswert konsistent:

- Bedarf an langfristiger Plattformstabilität

- Anforderungen für schnellere Inference und besseren Durchsatz

- Druck, Kosten zu kontrollieren, ohne die Leistung zu beeinträchtigen

- Wunsch nach einem Partner, der sich rein auf multimodale Generierung konzentriert

WaveSpeedAI ist mehr als ein Tool — es ist eine Richtung. Ein Engagement für Geschwindigkeit, Transparenz, Leistungstechnik und langfristige Unterstützung für multimodale Builder.

Wenn die KI-Welt in ihre „Inference-first-Ära” eintritt, glauben viele, dass WaveSpeedAI der Ort ist, an dem die nächste Generation multimodaler Produkte gebaut wird.

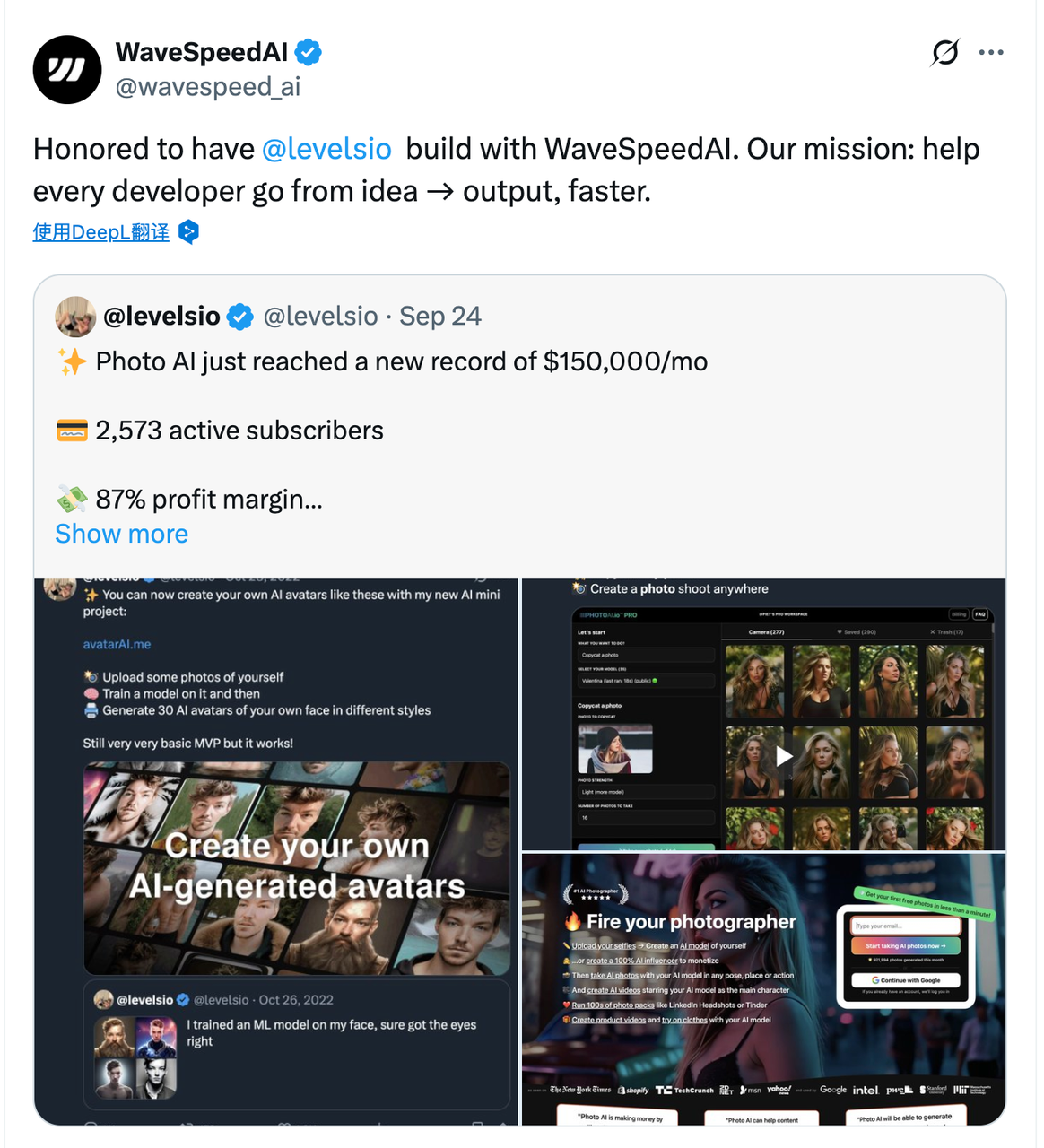

Fallbeispiel: Vertraut von der Community

Selbst die anspruchsvollsten Builder machen den Wechsel. Pieter Levels — eine bekannte Persönlichkeit in der Indie-Hacker- und Digital-Nomad-Welt — hat diesen Wandel selbst erlebt.

Auf der Suche nach der besten Mischung aus Geschwindigkeit und Stabilität versuchte er Replicate, dann Fal, und entschied sich schließlich für WaveSpeedAI. Wenn unabhängige Schöpfer, denen Effizienz wichtig ist, eine Plattform wählen, wählen sie diejenige, die einfach am besten funktioniert.

Bauen Sie ein Fundament, das Sie kontrollieren

Wenn Sie Alternativen evaluieren, eine Migration planen oder einfach nur Ihre Workload bewerten möchten, kann unser Team Sie durch die beste Einrichtung für Ihr Produkt führen.

Egal ob Sie proaktiv umziehen oder auf Plattformverschiebungen reagieren, WaveSpeedAI gibt Ihrem Multimodal-Stack die Geschwindigkeit, Stabilität und Klarheit, die er verdient.

Ihre Benutzer sollten nicht warten müssen — und Sie auch nicht.