Freepik 如何透過 DataCrunch 和 WaveSpeed 將 FLUX 媒體生成擴展至每日數百萬個請求

Freepik 如何通过 DataCrunch 和 WaveSpeed 将 FLUX 媒体生成扩展到每天数百万个请求

摘要

Freepik 自 2024 年初以来一直与 DataCrunch 合作,将最先进的媒体生成整合到其 AI Suite 中,并将推理请求扩展到每天数百万个。 DataCrunch 为 Freepik 提供了尖端的 GPU 基础设施和托管推理服务,提供以下功能:

- 托管 GPU 编排

- 弹性扩展和近零冷启动

- 通过 WaveSpeed 进行高速模型服务

- 直接技术支持和战略合作 Freepik 的客户每月生成超过 6000 万张图像,其中很大一部分请求得益于 DataCrunch 基础设施和服务。

1. 客户简介

Freepik 是一个领先的 AI 驱动的创意套件,它结合了先进的生成式 AI 工具和 2.5 亿多个精选库存资产,以简化高质量内容创作。

2024 年初,Freepik 重新定义了其商业模式,以利用生成式 AI 创建高质量媒体内容。Freepik 开始了其图像生成之旅,采用了 Stable Diffusion XL 等模型和实验性端点。到 2025 年,Freepik 已优化其方法以采用 FLUX 等模型,并扩展到生产级基础设施,同时容纳快速增长的用户群。

Freepik 的 AI Suite 提供了一个 AI 图像生成器,该生成器使用 FLUX 等模型从文本提示 (T2I) 或图像 (I2I) 生成逼真的图像,以及一个 AI 视频生成器,由 Google DeepMind Veo 2 等模型驱动,用于从文本或图像创建视频。这些功能的设计目标是直观易用,同时优先考虑风格自定义和引导工作流。

- 每月 8000 万访客

- 60 万订阅用户

- 每月生成 6000 万张图像

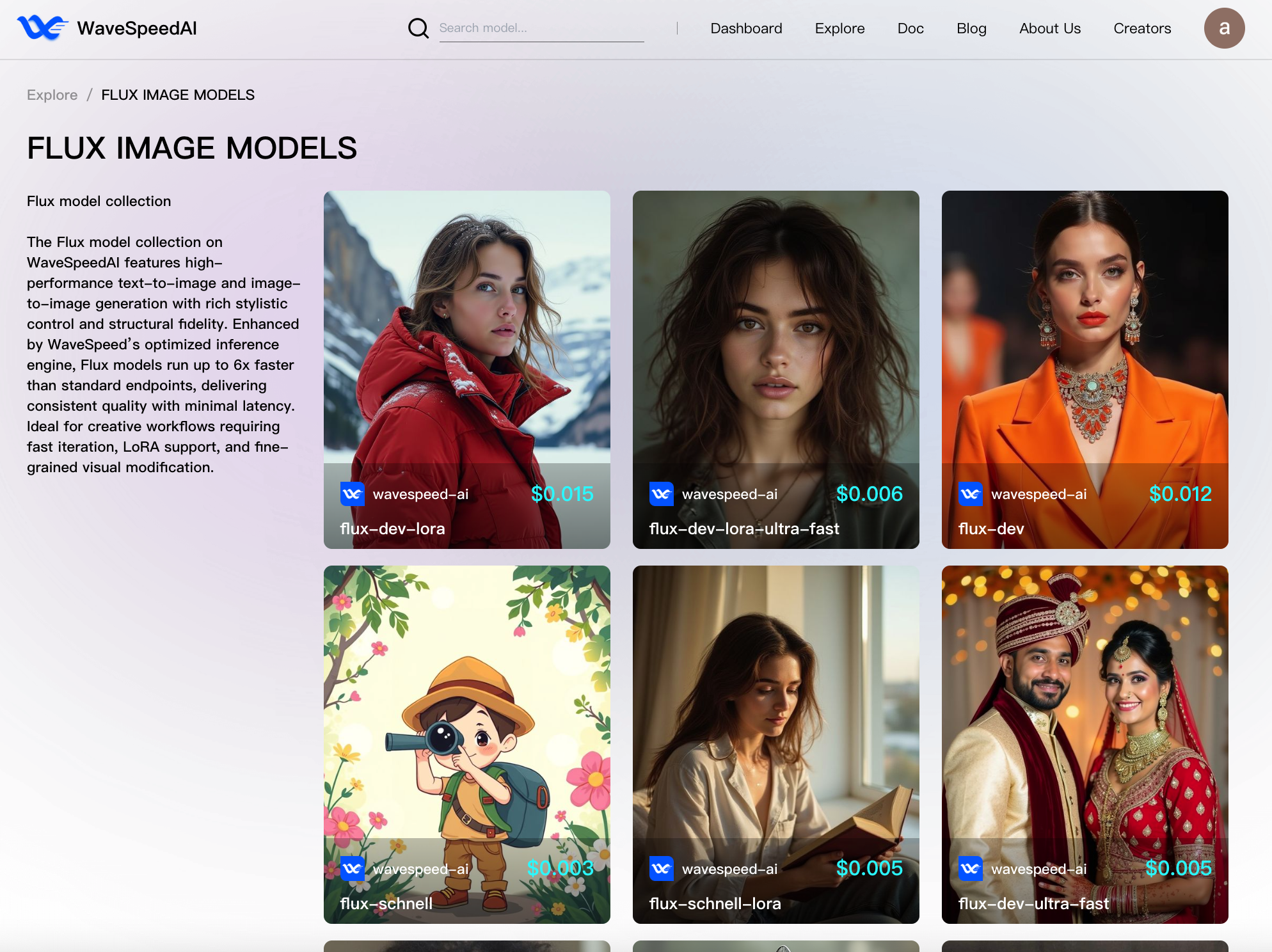

其中很大一部分推理请求涉及 FLUX 模型套件,其推理端点由 DataCrunch 管理,并利用 WaveSpeed 的推理引擎:

- FLUX Dev

- FLUX Tools(例如内绘)

2. 成本高效的媒体生成:FLUX Dev

2.1. 初期挑战

扩展基础设施很少是一件容易的事。在容纳指数级增长的用户群、应对日常使用峰值、优化推理成本和速度的同时扩展基础设施,几乎是不可能的。 当 Freepik 开始构建世界级产品和客户体验时,其图像生成基础设施必须处于性能前沿,同时满足以下要求:

- 将延迟保持在 2-6 秒范围以下 (p50)

- 优化吞吐量/成本效率(每计算小时的图像数)

- 避免相比官方未优化基线出现任何可感知的质量下降

为了满足这些要求,Freepik 必须在效率的最前沿运作,因为即使是几分钱的节省和更优化的每代 GPU 使用也会在如此规模上转化为显著的成本节省。

2.2. 技术方案

通过与 DataCrunch 合作建设和扩展其推理基础设施,Freepik 可以将所有精力集中在提高产品质量和提供世界级用户体验上。DataCrunch 还使 Freepik 能够适应图像生成领域的快速进步。 DataCrunch 不断在其工程师和 Freepik 之间提供直接沟通,实现快速协作和调整。这种直接沟通对于支持 Freepik 经历的规模和增长是必需的,并消除了任何延迟或沟通错误的可能性。

“我们工程团队之间的直接联系使我们能够以令人难以置信的速度前进。能够在规模上部署任何模型正是我们在这个快速发展的行业中所需的。DataCrunch 使我们能够快速轻松地部署定制模型。” – Iván de Prado,Freepik AI 负责人

因此,Freepik 在其 AI Suite 中受益于成本高效的模型服务,同时实现了目标吞吐量/成本效率和延迟。我们在 DataCrunch 的工作重点是避免”以任何代价实现推理速度”的陷阱,这通常伴随着输出质量下降和扩展不稳定等权衡。 为了实现这一目标,我们进行了深入研究以找到保留模型能力的无损优化,随后进行了严格的评估:

- 多指标评估:使用 DreamSim、FID、CLIP、ImageReward 和 Aesthetic 的组合

- 人工评估:Freepik 通过 A/B 竞技场进行了广泛评估,与基线和其他推理提供商进行了比较。

- 提示多样性:评估了多样化的提示类别,重点关注对象、场景和抽象概念。

从 2025 年开始,DataCrunch-WaveSpeed 硬件-软件协同设计研究使我们能够进一步推进提供给 Freepik 的最大实际推理效率,同时利用每个组织的核心优势:

- DataCrunch GPU 基础设施和无服务器容器,具有内部 Kubernetes 集群上的自动扩展、高吞吐量网络和低延迟对象存储。

- WaveSpeed 推理引擎,配备内部 ML 编译器、自定义调整和融合 CUDA 内核、高级无损量化、DiT 激活缓存(例如 AdaCache)和开销可忽略的轻量级推理服务器。

3. 推理基准测试:方法论与结果

关键指标:平均推理时间和延迟 (p99)、每次生成的成本和每小时吞吐量。

所有以下结果都通过 1 个设备的世界大小实现。优化每个端点以提高效率使我们能够根据 Freepik 在给定时间点的流量和要求(例如用户层级)动态分配可用资源。

| 端点 | 输入参数 | GPU 推理时间 (秒) | 每 GPU/小时吞吐量 |

|---|---|---|---|

| flux-dev | 大小 = 1024x1024,步数 = 28,可选缓存 = 0.1 | 4.4 | 818.2 |

| flux-dev-fast | 大小 = 1024x1024,步数 = 28,可选缓存 = None | 3.3 | 1091 |

| flux-dev-fast | 大小 = 1024x1024,步数 = 28,可选缓存 = 0.1 | 2.2 | 1636 |

| flux-dev-fast | 大小 = 1024x1024,步数 = 28,可选缓存 = None | 1.64 | 2184 |

| flux-dev-ultra | 大小 = 1024x1024,步数 = 28,可选缓存 = None | 1.648 | 2184 |

| flux-dev-ultra | 大小 = 1024x1024,步数 = 28,可选缓存 = 0.1 | 1.045 | 3445 |

| flux-dev-ultra | 大小 = 1024x1024,步数 = 28,可选缓存 = 0.16 | 0.768 | 4688 |

4. 技术解决方案:生产级 GPU 基础设施

DataCrunch GPU 基础设施为大规模生成式 AI 系统提供了生产级基础,WaveSpeed 优化引擎进一步推进了效率的边界。

- 托管 GPU 编排:GPU 细粒度资源管理通过内部 Kubernetes 集群提供,允许 WaveSpeed 控制推理的资源分配,而无需担心基础设施管理或深入研究基础设施即代码。

- 弹性扩展:无服务器容器经过自定义以根据传入请求的数量从零自动扩展到 500 多个 GPU 实例。这种能力对于吸收日常流量峰值而不排队或丢弃请求以及在空闲时扩展到零以避免不必要的成本至关重要。

- 近零冷启动:通过预热编译、更快的镜像拉取时间和容器缓存显著降低了冷启动延迟,接近 GPU 工作负载的真正 lambda 性能。

- 高速模型服务:优化的存储和网络架构显著减少了加载模型权重和拉取 Docker 镜像所花费的时间。这对于 FLUX LoRA 部署尤其关键,因为 LoRA 权重需要被缓存并移动到每个 GPU 实例。此外,DataCrunch 共享文件系统进一步提高了模型服务速度,并通过让多个实例读写同一个集中式文件存储库来减少数据传输开销。

5. 业务成果:成本节省与战略优势

DataCrunch 与 WaveSpeed 联合合作,使 Freepik 能够使用 FLUX Dev 模型扩展图像生成,同时最小化推理成本。 除了直接成本节省外,战略伙伴关系还使 Freepik 的大部分用户能够以更高的生成配额访问 FLUX 模型。 DataCrunch 团队严格评估并确保了输出质量,同时通过应用硬件感知优化来利用异构计算基础设施。 关键要点之一是可持续和可扩展的推理需要从不同角度理解 ML 系统:

- GPU 感知优化(例如 B200 自定义 CUDA 内核)

- 严格的测试和评估

- 基础设施集成(即自动扩展、零冷启动、网络调优) 当 Freepik 的新企业计划目标是更高的流量和推理量时,DataCrunch 将继续应用这一成功方法来实现持续的扩展性能。

6. 未来预测:媒体生成的下一步

从文本提示或图像条件的图像生成已不足以满足专业环境中对控制和编辑功能日益增长的需求,正如数字艺术家和广告公司所使用的那样。 通过 FLUX 的发布,Black Forest Labs 在图像生成质量上取得了巨大飞跃。我们预计 FLUX.1 Kontext [dev] 将为图像编辑创造类似的拐点,其采用率将超过 FLUX 模型。 诸如 OpenAI 4o 图像生成等故事确认了对具有高度可操纵性、轻松的输入图像条件、字符一致性和强大提示遵循能力的模型的高需求。 通过发布 FLUX.1 Kontext [max] 和 [pro],Black Forest Labs 已证明他们能够再现这些功能,同时更具成本效益。 展望未来,DataCrunch 计划超越图像生成,走向端到端工作流。持续的研究和开发项目一直专注于:

- 与 Alibaba WAN 2.1 和 VACE 等模型集成可扩展且成本有效的先进视频生成

- 图像和视频上采样模型

- 降低构建代理媒体产品的复杂性

- 在 DataCrunch Cloud Platform 中发布 FLUX Dev(基础模型、LoRA、工具)推理端点 – 敬请期待

立即尝试 FLUX Dev 和更多模型!

🔗FLUX-dev

🔗FLUX-dev-ultra-fast

🔗FLUX-dev-lora

🔗FLUX 模型集合

🔗Wan-2.1-14b-vace

🔗Seedance 1.0