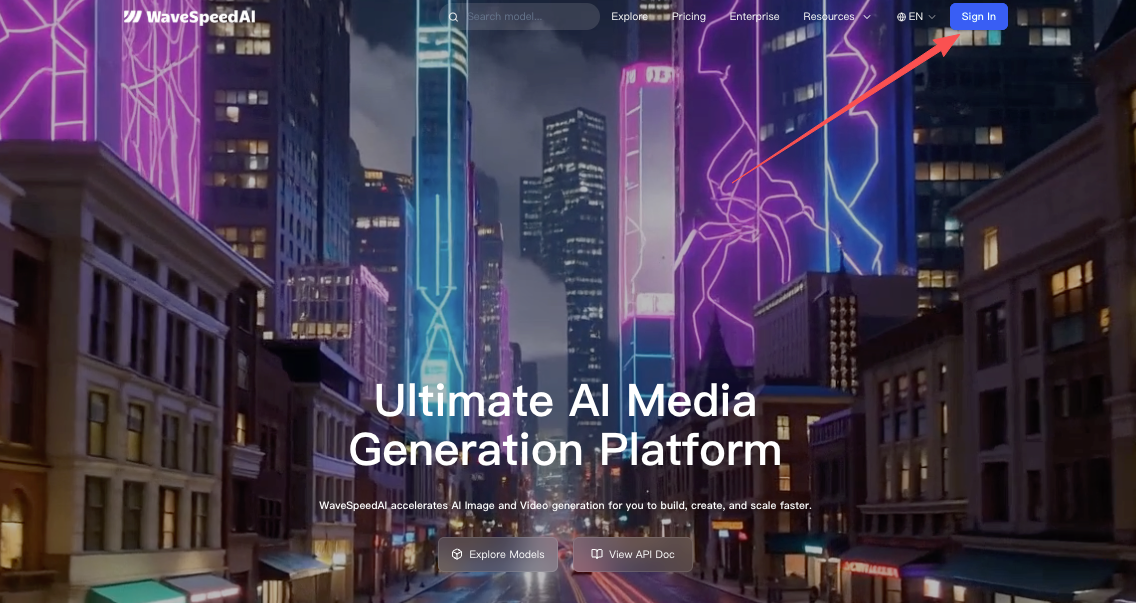

通过WaveSpeed API访问GLM-4.7-Flash

嗨各位,我是Dora。这个想法来自一个小烦恼:又一个项目,又一个API密钥,又一个SDK有自己的token和重试观点。我想试试GLM-4.7-Flash,因为人们一直在提它在日常起草和快速研究中的速度。但我不想为了运行几个测试就改造我的整个技术栈。

所以我选择了一条更安静的路:通过WaveSpeed API访问GLM-4.7-Flash。相同的客户端模式,一个密钥,切换模型。我在2026年1月期间在几个脚本中测试了这个,并做了记录。这些都不是什么大事。但它确实让我的日常工作轻松了一点。老实说,这就是现在的标准——轻松比浮夸更好。

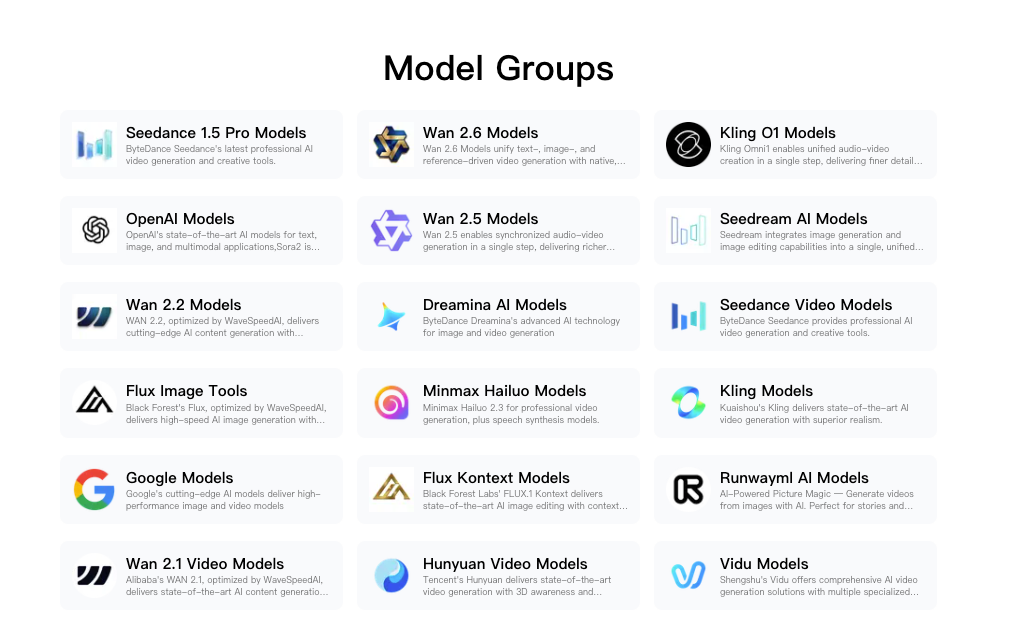

为什么使用WaveSpeed

我不会假装WaveSpeed是魔法。它更像一个可靠的适配器抽屉:不令人兴奋,但它是你想快速完成工作时会伸手去拿的东西。

对我来说重要的不是模型数量,而是摩擦力的缺失。我可以把相同的代码指向不同的模型,切换一行,然后继续前进。就这样,没有复杂性。

一个API密钥,600多个模型

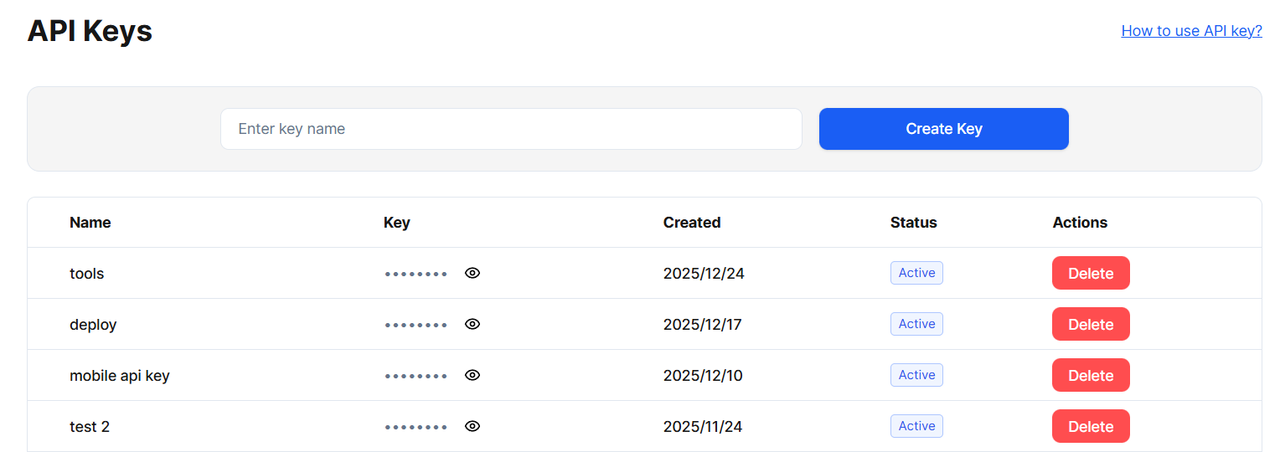

我真正的胜利是心理上的。我不用在提供商仪表板之间翻来覆去轮换密钥或限制支出。一个密钥在我的秘密管理器中,我可以路由到GLM-4.7-Flash进行快速草稿,然后在提示需要更深入时跳到更强大的模型。我仍然设置按项目的限制,但开销下降了。

实际上:我保留了现有的环境变量(在我的情况下是WAVESPEED_API_KEY),只改变了模型名称。这个小决定——保持名称对齐,不要耍聪明——让我避免了破坏CI。

无需切换SDK

我坚持使用我已经在用的OpenAI兼容客户端。没有新的方法名称,没有重新学习流标志。如果你围绕聊天完成、流和工具调用构建了小实用程序,它们大多可以直接转移。我喜欢WaveSpeed不要求我在返回token之前采纳它的世界观,如果这有意义的话。

我注意到两个警告:

- 模型名称在提供商之间有所不同。在提交代码之前,我会仔细检查WaveSpeed官方文档中的确切标识符。

- 特定于提供商的功能(如特殊响应格式或函数调用的怪癖)仍然可能不同。保留一个小适配器文件来规范化有效负载。我的是60行,每周都派上用场。

快速入门代码

我使用了WaveSpeed公开的OpenAI风格端点。如果你的代码已经访问聊天完成API,这应该感觉很熟悉。唯一真正的改变是基础URL和模型名称。

我在2026年1月12-15日用小批量提示测试了这个。短提示在我的连接上在一秒内开始流式传输。显然,你的结果会因网络、提示大小和服务器负载而异。

直接替换示例

这是我使用的形式。查看WaveSpeed官方文档了解最新的模型标识符(我见过它列为glm-4.7-flash)。

Node.js (fetch):

const resp = await fetch("https://api.wavespeed.ai/v1/chat/completions", {

method: "POST",

headers: {

"Content-Type": "application/json",

"Authorization": `Bearer ${process.env.WAVESPEED_API_KEY}`

},

body: JSON.stringify({

model: "glm-4.7-flash",

messages: [

{ role: "system", content: "You are a concise assistant." },

{ role: "user", content: "Summarize this link in 3 bullets: https://example.com/post" }

],

temperature: 0.3,

stream: true

})

});Python (requests):

import os, requests

url = "https://api.wavespeed.ai/v1/chat/completions"

headers = {

"Authorization": f"Bearer {os.environ['WAVESPEED_API_KEY']}",

"Content-Type": "application/json",

}

payload = {

"model": "glm-4.7-flash",

"messages": [

{"role": "system", "content": "You are a concise assistant."},

{"role": "user", "content": "Outline a 5-step plan to vet a research source."}

],

"temperature": 0.2

}

r = requests.post(url, headers=headers, json=payload, timeout=30)

r.raise_for_status()

print(r.json()["choices"][0]["message"]["content"])我发现的一些小建议很有用:

- 如果你的应用流式传输token,进行相同的SSE解析:WaveSpeed的流标志在我的测试中表现如预期。

- 在不确定模型负载时,我将按请求超时设置得略高于平时。

- 在响应中记录模型名称。当输出漂移时,未来的你会感谢你,你需要确认什么运行了。

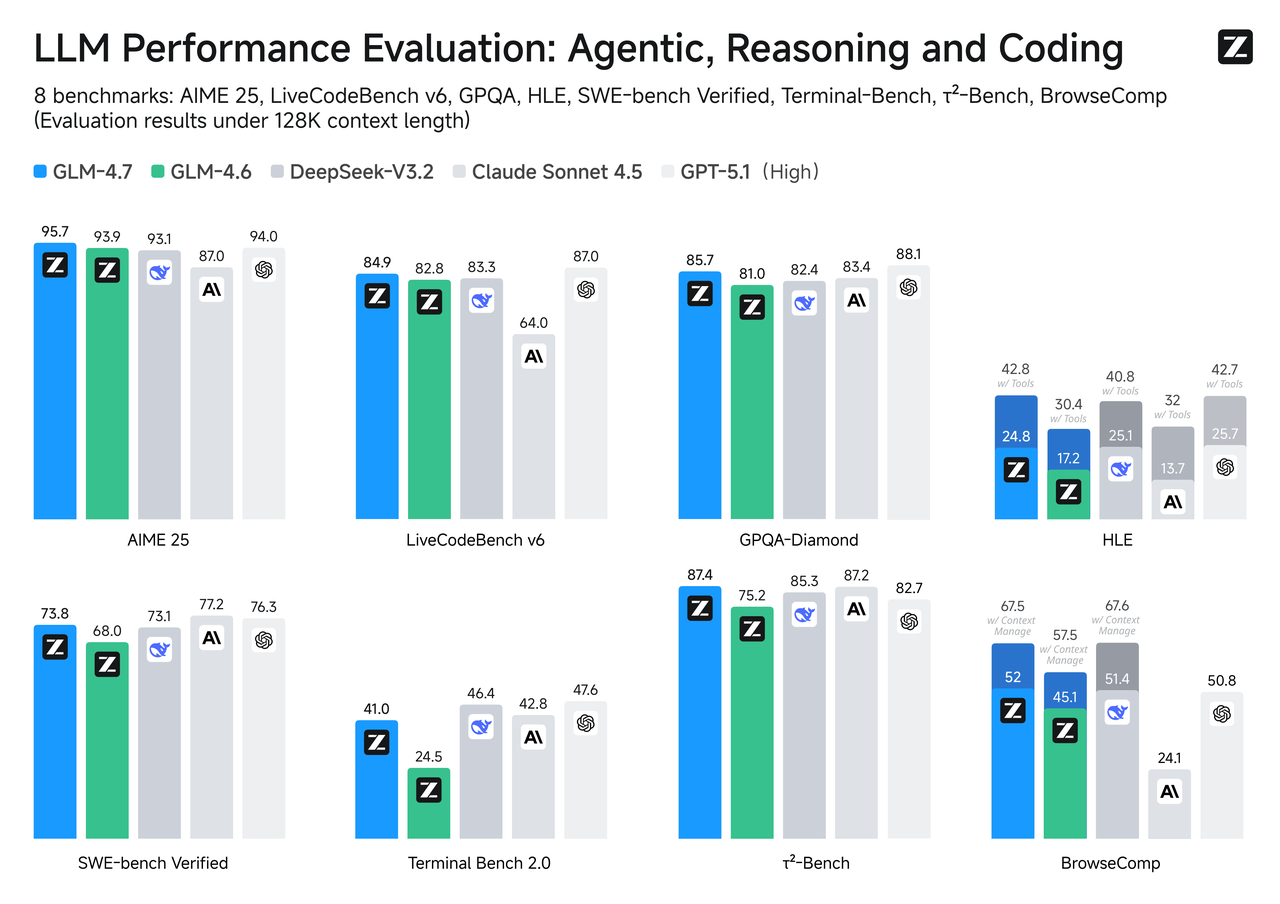

与其他模型结合

我的大部分工作混合使用模型。GLM-4.7-Flash对第一遍、起草、总结、基本问答很快。当我需要更强的推理或特定功能(如强大的代码解释器或某个视觉功能)时,我将路由到其他地方。WaveSpeed让我在一个地方保持这种路由。

让我有点惊讶的是:我原以为在运行中切换模型会感觉很混乱。它没有。提示保持相同的形状,所以我可以比较输出而无需扭曲代码。

文本+图像工作流

我尝试了一个小例程:从用户报告中收集屏幕截图,运行轻量级OCR或视觉标题,然后要求GLM-4.7-Flash用纯语言生成操作摘要。

我的步骤:

- 使用可视化功能的模型从图像中提取文本/标签。保持输出紧凑,考虑键值对或简短要点。

- 使用稳定的系统提示(两行)将该文本交给GLM-4.7-Flash,并要求提供简短摘要和决策。

- 如果图像有表格,我添加一个快速规则:“精确保留数字和单位。“这减少了后来的清理。

现场笔记:

- 在1.2MB的PNG上,混合UI+文本,视觉处理对我来说花了约2-4秒:GLM-4.7-Flash总结在一秒内返回。这种分离使流程感觉敏捷。

- 成本可预测,因为我在移交前将视觉输出限制在几百个token。

- 如果你不需要视觉细微差别,先运行基本OCR(Tesseract或付费OCR API),然后将文本传递给GLM-4.7-Flash。更便宜,通常足够好。

文本+视频工作流

视频更重,显然。我没有向任何模型发送完整视频。我先提取了转录本(whisper或付费ASR),然后将片段路由到GLM-4.7-Flash进行快速总结。

一个有效的循环:

- 转录视频一次。如果可以,保留时间戳。

- 按说话者转弯或3-5分钟片段分块(以更清晰的方式)。

- 要求GLM-4.7-Flash进行片段总结和决策。保持系统提示锚定:“你只返回结构化JSON,包含字段A/B/C。”

- 用第二遍从片段缝合顶级大纲。

在实际中,GLM-4.7-Flash对片段总结感觉是对的:快速、低摩擦、规划的准确性足够好。对于最终大纲,我有时会为了语气或细微差别切换模型。我在WaveSpeed中保持了所有东西,所以我的代码没有改变形状。

定价

定价是我放慢脚步的地方。不是因为它很复杂,而是因为惊喜出现在日志中,而不是仪表板中。

WaveSpeed上的GLM-4.7-Flash

截至2026年1月,GLM-4.7-Flash可通过WaveSpeed获得,具有自己的按token费率。确切数字可能会变化,所以我不会在这里固定。在推送任何东西到生产之前,我会检查官方定价页面,并在我的环境配置中设置软限制。

我如何估算:

- 对典型的提示+响应进行采样。乘以每日运行次数。这让我得到每日token。

- 为不好的日子或新提示增加20-30%的余量。

- 比较同样任务的较慢但更便宜的模型。如果较慢的模型不增加人工编辑时间,它可能总体上会赢。

一个实用技巧:按功能标志记录token。我为一部分用户打开GLM-4.7-Flash,并比较编辑时间和投诉。这告诉我比价格表更多的信息。

批量折扣

WaveSpeed提供基于数量的定价。如果你批量处理工作或运行数据回填,层级很重要。在激增周之前,我曾经伸出来确认阈值:答案很直接,节省了我在尴尬窗口中限制工作的麻烦。

我的规则:如果我预期10倍的激增、营销活动、迁移或研究冲刺,我会先给支持部门发电子邮件。重点不是特殊交易:它是一个明确的天花板,所以我不必整晚照看工作,因为没有人想要那样。

我们正是为了这种工作流程而构建WaveSpeed的:更少的密钥,更少的SDK切换,更少的时间用于思考基础设施。如果你在不断切换模型,只是想要它们在单个、可预测的API后面表现一致,那就是我们试图解决的问题。

➡️ 你可以在这里探索它。

现在轮到你了:你最近处理过的最荒谬的API密钥循环是什么?在评论中发布——我会在喝咖啡时阅读所有评论,感觉会少一些孤独。