GLM-4.7-Flash API: 聊天完成和流式输出快速入门

嘿,我是Dora。上周我遇到了一个小问题:一个草稿摘要任务感觉比它应该的要沉重得多。我通常使用的工具要么太慢,要么太聪明了。我想要的是快速且可预测的东西,即使不是很花哨。

所以我对GLM-4.7-Flash API进行了一次彻底的测试(2026年1月)。我不是在寻找”哇”的效果。我想要干净的请求、快速的响应和按照说明进行工作的设置。以下是我的设置内容、什么有帮助、哪里出现了问题,以及为什么当我需要快速且没有麻烦时我会再次使用它。

获取您的API密钥

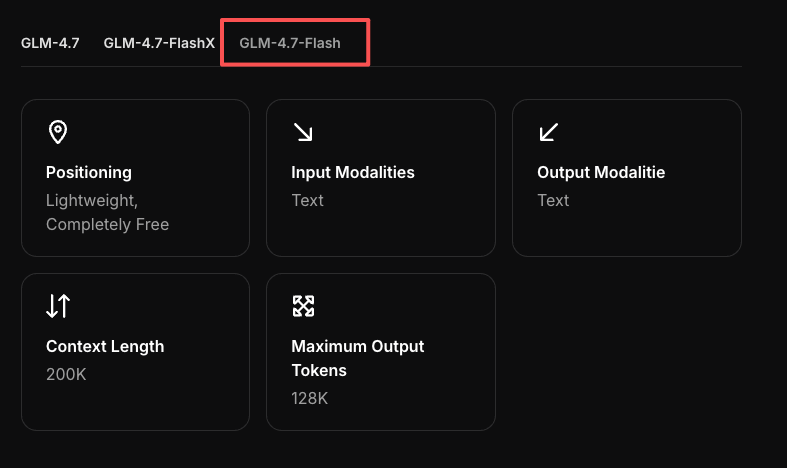

我从简单开始:获取密钥、发出请求、查看基础是否合理。我欣赏不隐藏控制杆的API。作为背景,GLM-4.7-Flash是由智谱AI提供的更广泛的GLM模型家族的一部分,这影响了围绕速度和可预测性的许多设计决策。

WaveSpeed仪表板演示

我使用了WaveSpeed仪表板,它提供了对GLM-4.7-Flash API的访问。流程很简单:

- 创建一个项目(我将我的项目命名为”flash-notes”)。

- 生成服务器密钥和轻量级客户端令牌。我只在本地脚本中使用了服务器密钥。

- 浏览使用情况面板以发现默认速率限制。我的显示了适度的突发上限和每分钟配额,足以进行测试但不足以应对生产高峰。

我喜欢的一个小细节:仪表板显示最近的4xx/5xx错误及其时间戳。当我稍后触及限制时,我不必猜测。如果你进行团队工作,基于角色的密钥可见性有所帮助:我将具有写入权限的密钥保存在.env文件中,并在周内轮换一次以检查撤销是否正常工作(确实正常)。

基本请求

我的第一个检查点与我对任何新模型使用的相同:短提示、短答案,JSON中没有意外。

API架构遵循官方GLM-4.7 API指南中列出的相同聊天完成模式,这意味着我不需要重新学习请求语义。

curl示例

这是对我最有效的最简单的调用。端点名称可能因提供商而异:这是我在测试中使用的模式。

curl https://api.wavespeed.ai/v1/chat/completions \

-H "Authorization: Bearer $WAVESPEED_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "GLM-4.7-Flash",

"messages": [

{"role": "system", "content": "You are concise and helpful."},

{"role": "user", "content": "Summarize this in one sentence: GLM-4.7-Flash API quick test."}

],

"temperature": 0.2,

"max_tokens": 120

}'测试中的注意事项

- 延迟: 我在上午(美国时间)看到短提示上的首个令牌约200–400毫秒。短回复的端到端完成不到一秒。

- 稳定性: 当流式传输关闭时,响应每次都是格式良好的JSON。

- 成本: 我无法就您的计划发表意见,但令牌在使用日志中被清晰地报告。当你进行快速迭代时,这很重要。

Python示例

对于小脚本,我更喜欢使用环境加载的密钥的单个函数。

import os

import requests

API_KEY = os.getenv("WAVESPEED_API_KEY")

BASE_URL = "https://api.wavespeed.ai/v1/chat/completions"

payload = {

"model": "GLM-4.7-Flash",

"messages": [

{"role": "system", "content": "You are concise and helpful."},

{

"role": "user",

"content": "Give me 3 bullet points on maintaining a calm writing workflow."

}

],

"temperature": 0.3,

"max_tokens": 180

}

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

resp = requests.post(BASE_URL, json=payload, headers=headers, timeout=30)

resp.raise_for_status()

data = resp.json()

print(data["choices"][0]["message"]["content"]) # typical OpenAI-style schema两个小反应:

- 宽慰: 架构与通常的聊天完成格式相匹配,这意味着没有适配层。我将其放入预先存在的工具中,只需进行最小的更改。

- 一个限制: 在较高温度下较长的输出有时会曲折。这对于”Flash”类型的模型是正常的:我用

max_tokens进行了裁剪,并通过更紧的系统提示调整了语气。

启用流式传输

只有当我实时塑造文本或延迟比完整性更重要时,我才会打开流式传输。GLM-4.7-Flash感觉就是为此而生的:快速的首个令牌、稳定的分块,一旦参数设置正确。

流参数设置

要启用服务器发送的事件(SSE),我设置了stream: true。就这样。其余的是维护:确保你的客户端读取事件行并在[DONE]处停止。

我使用的curl版本:

curl https://api.wavespeed.ai/v1/chat/completions \

-H "Authorization: Bearer $WAVESPEED_API_KEY" \

-H "Content-Type: application/json" \

-N \

-d '{

"model": "GLM-4.7-Flash",

"messages": [

{"role": "user", "content": "Draft a two-sentence intro about quiet tools."}

],

"stream": true,

"temperature": 0.2,

"max_tokens": 120

}'两个字段注释:

- 如果你忘记了curl中的

-N(无缓冲),流可能看起来卡住了。 - 如果你得到一个普通的JSON blob而不是事件,请仔细检查

stream是布尔值true而不是字符串。

在代码中处理块

在Python中,我逐行读取、解析data:帧,并在哨兵处停止。这个模式工作得很顺畅。

import os, json, requests

API_KEY = os.getenv("WAVESPEED_API_KEY")

BASE_URL = "https://api.wavespeed.ai/v1/chat/completions"

payload = {

"model": "GLM-4.7-Flash",

"messages": [{"role": "user", "content": "Write a calm closing paragraph."}],

"stream": True,

"temperature": 0.2,

}

with requests.post(

BASE_URL,

json=payload,

headers={

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

},

stream=True,

timeout=60

) as r:

r.raise_for_status()

for line in r.iter_lines(decode_unicode=True):

if not line or not line.startswith("data:"):

continue

data = line[len("data:"):].strip()

if data == "[DONE]":

break

try:

delta = json.loads(data)["choices"][0]["delta"].get("content", "")

print(delta, end="", flush=True)

except (KeyError, json.JSONDecodeError):

# Skip malformed or heartbeat frames gracefully

continue

print() # newline让我有点惊讶的是:块时间是稳定的。我尝试了一些较长的提示,仍然得到了可预测的步调。流式传输在非常短的回复上没有节省挂钟时间,但它减少了我的等待感,当我在终端中直接编辑时,这算数。

参数参考

我每天只调整几个旋钮。使用GLM-4.7-Flash API,这些行为如预期。

temperature / top_p / max_tokens

- temperature:我将其保持在0.1至0.4之间进行生产类任务。较低的数字给出了更紧凑、较少富有想象力的措辞,这对摘要和支持文本很好。如果你漂移到0.7以上,预期会有切线。

- top_p:我将top_p保持在0.9左右。当我用低温将其收紧到0.6时,输出感觉被剪裁了,对于项目符号很有用,对于细微的写作则较少。

- max_tokens:这是我的防护栏。对于短格式任务,150–250保持成本整洁并防止冗长。对于轮廓,600–800就足够了。如果模型提前停止,通常是这个,不是错误。

当我需要清晰、事实的答案时,对我来说效果很好的一个小设置:

{

"model": "GLM-4.7-Flash",

"temperature": 0.2,

"top_p": 0.9,

"max_tokens": 200

}这在实践中为什么重要:当你想要速度时,你不想要重写。保守的温度与慷慨但不无限的max_tokens为我节省了只是为了修剪措辞而必须运行同一个调用两次的时间。

常见错误

我在测试时在身边放了一个小笔记本。两个错误频繁出现足以值得明确提及。

429速率限制

我看到的:

- 并行请求的突发(一次5–10个)有时会触发429。在新密钥的第一分钟内它发生得更多。

什么有帮助:

- 退避: 抖动指数延迟(例如200毫秒、400毫秒、800毫秒、最高~3秒)清除了峰值,无需我监管。

- 队列: 将近似的提示合并到短批处理窗口(100–200毫秒)中约减少了我的峰值速率~30%,而不改变UX。

- 仪表板检查: 使用面板确认何时我是问题。没有神秘之处,我很感激。

谁会触发这个: 团队同时将GLM-4.7-Flash连接到UI预览和服务器钩子。如果它重要,请向你的提供商询问更高的每分钟上限或使用轻量级的内存中队列。

无效的JSON响应

我看到的:

- 当流式传输打开时,某些客户端尝试将每个

data:帧解析为完整的JSON。这不是SSE的工作方式。帧是部分的。 - 一次,通过嘈杂的连接,我得到了一个被截断的事件行,它打破了严格的解析器。

什么有帮助:

- 保护你的解析器: 只解析

data:之后的JSON并期望它包含一个小增量,而不是完整的消息。在[DONE]处停止。 - 超时: 保持合理的读取超时,但避免因单个格式错误的帧而杀死流。

- 如果你需要非流JSON:关闭流,你通常会得到一个干净的单一JSON对象。在我的运行中,非流模式从未产生过格式错误的JSON。

还有一个小问题:如果你的代理或服务器将日志注入到stdout中,它可能会污染流。将日志与响应管道分开。

在所有这些测试之后,我坚持使用WaveSpeed的原因非常简单:我不想考虑管道问题。

我们构建WaveSpeed是为了成为你的代码和像GLM-4.7-Flash这样的快速模型之间的无聊、可靠的层。干净的端点、可预测的行为和一个仪表板,它告诉你实际发生了什么,当出现问题时——速率限制、错误、使用——没有猜测。

如果你将Flash连接到摘要、草稿、UI预览或后台工作,只是想让它远离你的工作,那正是我们试图填补的空白。→ 点击这里!