WAN 2.2 LoRA 训练设置:最佳学习率、步数和触发词

嘿,朋友们。你知道吗?我喜欢 WAN 2.2 处理皮肤和光线的方式,但我通常的 LoRA 训练习惯没有干净地转化。面部看起来太有光泽了,模型总是把背景拉进同样柔软的工作室外观。这没什么”错”的,只是不是我的风格。所以在 2026 年 1 月初,我进行了一些短实验,找到了感觉合理的 WAN 2.2 特定 LoRA 训练设置。没什么花哨的。只是足够降低塑料光泽,保持主体稳定,同时让基础模型呼吸。

如果你在寻找快速模板:这不是。我分享的是在多次运行中坚持下来的东西、我犹豫的地方,以及我如何调整的。这里的目标关键词很清楚,WAN 2.2 LoRA 训练设置,但目标是更平静的工作,而不是新的兔子洞。

为什么 WAN LoRA 有所不同

我注意到 WAN 2.2 的行为像一个非常固执的 SDXL 检查点:它针对清晰肖像、光滑渐变和电影光进行了调整。当我用我在普通 SDXL 基础上训练 LoRA 的方式训练时,WAN 不断将我的结果推回那种抛光的工作室氛围。

田间笔记:

- 提示重力很强。即使权重很轻(0.4-0.6),也会拉向干净的皮肤和对称的框架。

- 颜色聚类早期出现。如果你的数据集偏暖,WAN 会放大它。

- 背景同质化。没有推动,它默认为浅景深和柔和散景,无论你给了它什么。

实践中改变的内容:我降低了学习率,使用了比平常更多的正则化图像,并故意保持标题无聊。WAN 2.2 奖励克制。当我试图同时”教”风格和主体时,过度拟合迅速蔓延。

如果你来自 SD 1.5 LoRA 习惯,想:更少的聪明技巧,更多受控的基线。如果你习惯于 SDXL,比正常情况下慢一点,更早地融入正则化。

数据集大小指南

我用精选肖像集进行了四次传递(2026 年 1 月 5-12 日),每次都有整洁的标题和混合光线。以下是坚持下来的东西:

- 8-12 张图像:足以锚定特定人物或产品轮廓。使用强正则化。保持构图多样化。

- 15-30 张图像:单一主体身份与温和风格的最佳位置。如果你想要背景泛化,添加 20-40% 非肖像照片。

- 40-80 张图像:当你编码一致的品牌外观或多角度对象线时很有用。你需要仔细的标题和更多步骤。

比原始计数更重要的事项:

- 姿态多样性而不是位置多样性。WAN 很好地概括位置:当每张照片都是同一角度时,它会苦恼。

- 曝光平衡。如果你的集合中一半曝光不足,WAN 后来会使一切变暗。我在训练前标准化了直方图。

- 标题简洁性。描述性的,不是诗意的。“subject_token, denim jacket, window light, medium close-up” 胜过 “moody candid portrait near a rainy window.”

对于身份 LoRA,我选择了 12-20 张图像作为可靠的下限。对于风格 LoRA,30-50 给了我呼吸空间,而不会陷入 WAN 的默认肖像光泽。

LR/步骤基线

对我来说感觉稳定的 WAN 2.2 LoRA 训练设置(Kohya-ss 和 SDXL 基础):

- 秩(dim):16-32。我默认为身份 16,风格 32。

- Alpha:匹配 dim(例如 16/16)。较低的 Alpha 使结果变脆。

- 优化器:带权重衰减 0.01 的 AdamW。

- 学习率:身份 5e-5,风格 7e-5 到 1e-4。WAN 用塑料皮肤和损失峰值惩罚高 LR。

- 调度器:带预热的余弦。预热总步骤的 5%。

- 批大小:2-4(A100/4090)。梯度累积可根据需要模拟 8。

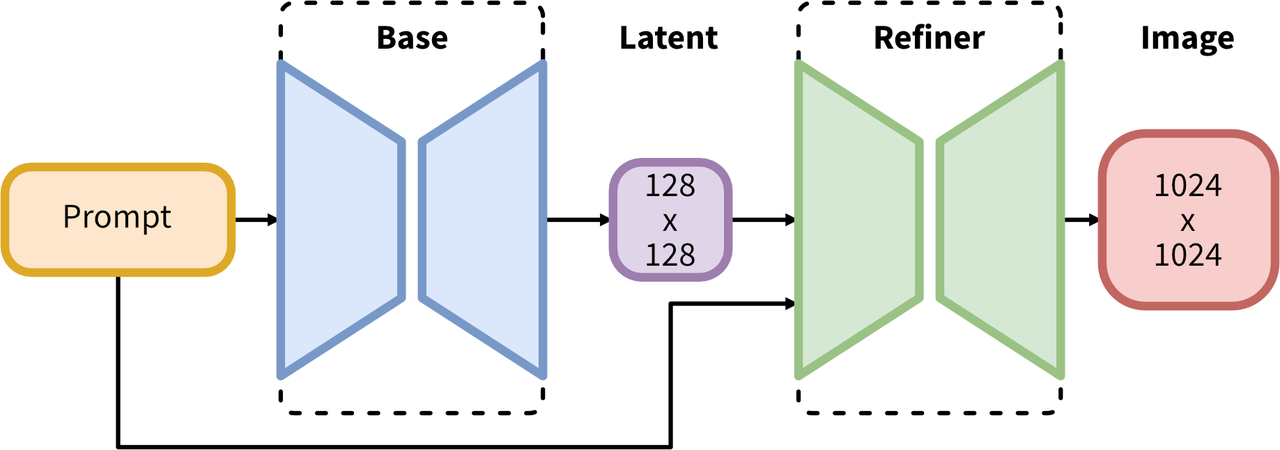

- 分辨率:长边 SDXL 原生 1024 带桶装(例如 1024×768, 1024×1024)。不要放大:它只会记忆噪音。

- 周期/步骤:我按步骤停止,而不是周期。

- 12-20 张图像:1,200-2,000 步

- 30-50 张图像:2,000-3,500 步

- 60-80 张图像:3,500-5,000 步

我使用的理智检查:

- 每 200-400 步保存一次,并使用固定提示 + 种子预览。

- 如果样本在步骤 600 之前锐化太快,LR 太高。

- 如果在 20 张图像集上约 1,400 步时身份未锁定,标题或正则化的偏差比 LR 更大。

这些数字不会赢得排行榜,但它们抵抗 WAN 将一切打磨光滑的倾向。

触发词策略

我保持触发器最少。WAN 已经有了强大的先验:堆叠可爱的令牌只会增加噪音。

我做的是:

- 一个实例令牌 + 一个类令牌。例如:“sora_person” 作为实例,“person” 或 “woman/man” 作为标题中的类。

- 将实例令牌放在每个标题的开头。保持小写,如果可以的话一个词。

- 避免在同一 LoRA 中混合风格令牌,除非你真的想要风格 LoRA。在 WAN 2.2 中混合身份和风格变得混乱很快。

在提示中,我只调用 LoRA 和实例令牌,然后层柔和的转向:

- lora: 名称在 0.5-0.8

- 提示中早期的实例令牌

- 风格词汇晚且轻(“natural light, clean color, minimal retouch”)

我出于好奇尝试了发明的”WAN-style”触发器。它们没有帮助。基础已经可以做那部分,LoRA 应该切出你需要的东西,而不是重新宣布 WAN 2.2 擅长的东西。

正则化图像

这是安静的英雄。我使用了每个训练图像 1-3 倍的正则化图像,与标题类匹配。

- 对于身份 LoRA:20-60 个标记为相同类别的正则图像(“person”)。我用简单提示从 WAN 2.2 本身生成它们:“photo of a person, neutral background, medium close-up, natural light.”

- 对于对象 LoRA:每个产品类的正则图像(“shoe,” “bottle,” “chair”)。保持准确:不要混合类别。

为什么重要:WAN 2.2 喜欢在所有东西上刻上肖像美学。正则图像给了它保持基础范围的权限,同时让 LoRA 保持身份。没有它们,我的 LoRA 过度强调皮肤平滑和散景,然后拒绝离开。

感觉正确的设置:

感觉正确的设置:

- 保持正则化图像视觉上无聊且曝光良好。

- 不要用实例令牌标记正则化图像的标题:只有类。

- 在整个过程中混合 10-20% 的训练批次与正则图像(不仅仅在开始时)。

如果你时间紧张,在调整优化器之前添加正则化图像。这是更大的杠杆。

过度拟合检测

我不仅依赖损失。WAN 用漂亮的样本隐藏过度拟合。这些是我的迹象:

- 提示惯性:改变提示几乎不改变输出。一切都漂移回同一个镜头和背景。

- 皮肤塑性:毛孔均匀消失,尤其是在颧骨和前额周围,即使有粗糙的光线提示。

- 姿态回声:跨越不同种子的重复肩膀/颈部角度。

- 颜色锁定:一个温暖的色调,它会跨越不同的白平衡提示。

我每 200-400 步运行的快速检查:

- 对抗性提示:切换到”harsh overhead office light, fluorescent, unflattering”,看纹理是否返回。

- 背景翻转:强制”busy street, cluttered shelves”以测试组合灵活性。

- 负提示压力:添加”over-smooth skin, plastic texture, heavy retouch”,看它是否听取。

如果这两个测试连续失败,我回滚到上一个检查点,要么添加更多正则化图像,要么将 LR 降低一个档次。

修复崩溃

我遇到了两种崩溃:身份融化和风格锁定。

当身份融化时(面部漂移,眼睛错位):

- 将 LR 降低一步(例如 7e-5 → 5e-5)。

- 只有当数据集有足够的角度时,才将秩从 16 增加到 32:否则它会记忆姿态,而不是身份。

- 紧化标题:切割形容词,保持焦距提示,保持实例令牌第一。

- 添加 10-20 个更多相同类别的正则化图像。

当风格锁定时(一切看起来都像 WAN 的默认工作室肖像):

- 将非肖像照片添加到数据集(环境、手、部分身体)。

- 用余弦计划增加 400-800 步:不要尖峰 LR。

- 在推理时降低 LoRA 权重(0.8 → 0.5),并降低指导(CFG 5-6 → 3.5-4.5)。WAN 对较低的 CFG 反应良好。

- 如果使用噪声偏移或大量颜色增强,将其调回。WAN 已经稳定色彩:额外的增强使我的输出变得混乱。

其他有帮助的旋钮:

- 梯度剪裁到 1.0 以避免突然峰值。

- 小运行中的 EMA 关闭:对于小数据集,EMA 使身份落后于预览。

- 种子规律:每次用固定种子预览。当其他一切都静止时,小的改变更容易判断。

导出和重用

一些习惯后来为我节省了时间:

- 用清晰的名称保存增量检查点:模型、秩、LR、步骤和日期。例如:wan22_lora_id_r16_lr5e-5_s1800_2026-01-09.safetensors。

- 如果你的工具支持,在 LoRA 元数据中保留训练提示、验证提示和种子。未来的我总是感谢过去的我。

- 版本粘性使用:在 WAN 2.2 上训练的 LoRA 在 WAN 2.2 和亲密兄弟上效果最佳。它们可在其他 SDXL 基础上使用,但颜色和皮肤处理转移了。我把它们当作”WAN-first”。

- 感觉很好的推理默认值:

- LoRA 权重 0.5-0.8(身份),0.3-0.6(风格叠加)

- CFG 3.5-5.5

- 30-40 步带稳定采样器(DPM++ 2M Karras 工作很好)

- 保持提示简短:WAN 听到细微的推动

如果你想合并 LoRA:我用堆叠小的、单一目的的 LoRA(身份为 0.6 + 温和颜色外观为 0.3)取得了更好的成功,而不是训练一个大的”一切”LoRA。WAN 尊重模块性。

更多详细的 WAN 2.2 工作流和示例,请查看 官方 ComfyUI 文档。

对于训练,我仍然喜欢在本地运行,这样我可以看到每一个旋钮。但当涉及到推理、模型路由或在不摆弄 API 的情况下在基础模型之间切换时,你可以尝试我们的 WaveSpeed。它在一个一致的端点后面保留不同的模型,所以我可以专注于提示和输出,而不是基础设施。

对于训练,我仍然喜欢在本地运行,这样我可以看到每一个旋钮。但当涉及到推理、模型路由或在不摆弄 API 的情况下在基础模型之间切换时,你可以尝试我们的 WaveSpeed。它在一个一致的端点后面保留不同的模型,所以我可以专注于提示和输出,而不是基础设施。