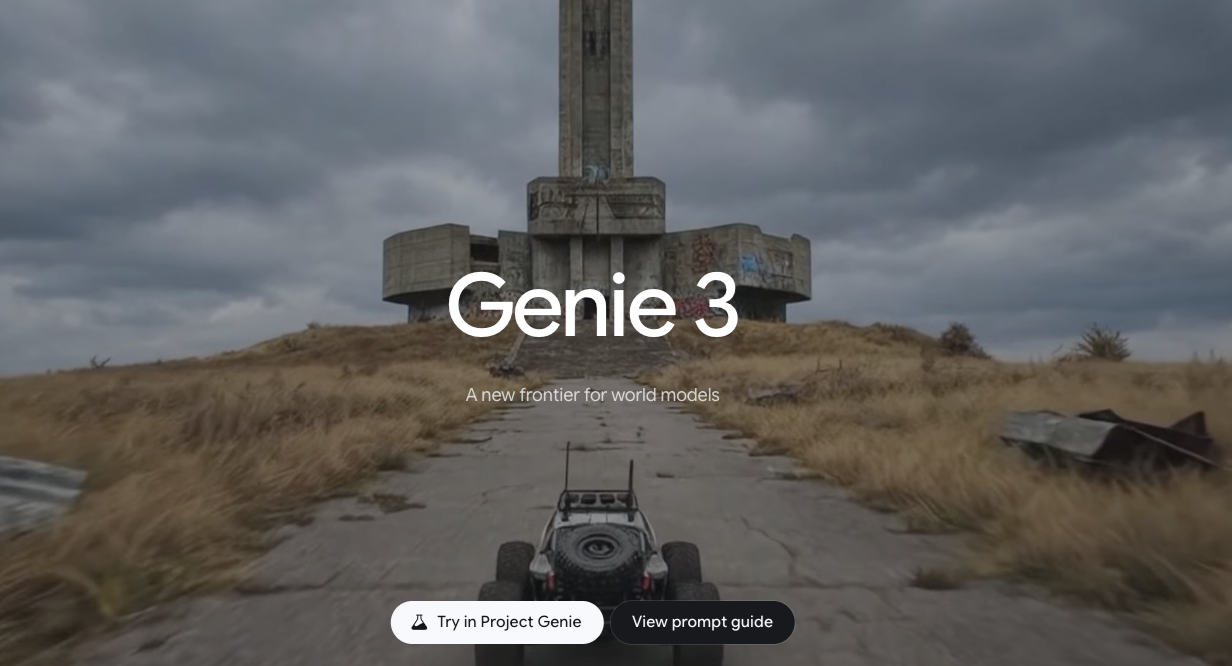

Google DeepMind Genie 3:技术详解与能力分析

我是 Dora。这一切始于一个小烦恼:我试图向一位队友解释一个简单的游戏机制,但我的草图加上一段文字描述仍然显得模糊不清。我不想要整个原型,只想要一个能玩十秒钟的东西来检验感受。在这种时刻,我通常会耸耸肩就算了。但在 2026 年 1 月,我花了一周时间阅读、观看演示,并尝试改造社区对 Google DeepMind Genie 3 的复现。

我没有生产版本。我拥有的是:公开研究论文、我能找到的模型卡笔记、原始 Genie 论文,以及几个用更小检查点镜像该方法的复现。所以这些是田间笔记,是在实践中有效的方法、遇到的问题,以及 Google DeepMind Genie 3 在哪些方面看起来重要——如果你关心以最少的仪式将视觉转化为可玩世界的话。

模型架构概览

我找到的最简单的思考 Genie 3 的方式是把它看作一个堆栈,它将像素转化为可控的、预测性的世界,而无需在其下面运行一个手工编写的游戏引擎。

在高层次上(基于原始 Genie 工作和最新演示中可见的内容):

- 一个视觉标记器将帧压缩到紧凑的潜在空间。与其在原始像素上工作,模型学习离散或连续代码(想象视频标记),这使得预测多个帧快速进行。

- 一个动力学模型学习那些潜在状态如何随时间演变。你可以把它看作一个世界模型:给定当前状态和一个动作,它预测下一个状态。这就是”可玩性”的来源。

- 一个动作界面将人类输入(键盘、触摸或推断的手势)映射到模型的动作标记。早期 Genie 版本从视频推断潜在动作空间:Genie 3 似乎提供了更清晰的映射,在场景间更稳定。

- 一个渲染器/解码器将预测的潜在转换回你能看到和控制的帧,最好以低延迟。

测试复现时有两个细节突出:

- 模型不从库导入物理:它从训练视频中学习它能学到的任何”物理”。这就是为什么物体有时感觉飘飘然或粘糊糊的。当它有效时,令人不安。当它无效时,就像在触摸屏世界上戴着手套。

- “关卡设计”和”游戏玩法”之间没有严格的分离。你给它一张图像或短片,学到的动力学试图让它互动。这模糊了角色,如果你在探索中这很好,如果你需要保证这就很混乱。

如果你想追根溯源,原始论文仍然是最清晰的概念锚点:Genie: Generative Interactive Environments,以及 DeepMind 撰文。Genie 3 看起来像是一个迭代,扩展了数据,稳定了动作映射,提高了输出保真度,更多是演进而非重新发明。

训练方法

在实践中重要的不是确切的损失函数,而是它们如何影响感受。

从论文和公开讲话,配方看起来像这样:

- 数据:大量、杂乱的人们与 2D 游戏和界面互动的视频,加上通用网络视频。早期 Genie 仅从像素推断控制:后来的迭代在可用时折入轻量级动作痕迹。规模帮助模型学习”常识”转换(跳跃弧线、按钮闪烁、菜单高亮),而不与一个引擎相关。

- 目标:潜在空间中的自监督下一帧预测,有时与掩蔽建模交织:一种反向动力学风格来猜测可能导致观察到的变化的动作:以及一致性损失来保持动作空间在场景间的稳定性。

- 调节:提示、参考图像或启动帧充当背景。我注意到提供一个干净、高对比度的种子图像减少了早期闪烁。繁忙的纹理导致闪烁边缘,直到模型”安定”下来。

为什么这重要:模型依赖脆弱注释越少,它能即兴演奏的领域越广。但这种自由有一个代价。如果训练组合在平台游戏上很重,你生成的界面倾向于类似平台游戏的反应。在我的测试中,即使 UI 模型也发展出了淡淡的”游戏感”,悬停状态反弹,面板滑动。对于快速原型很有帮助,对于生产 UI 很奇怪。

一个小的实用注意:无论版本如何,热身帧很重要。在我接触任何东西之前让模型运行 1-2 秒后,我得到了更平稳的控制。这就像给它一个呼吸来锚定潜在状态。

生成能力

这是 Google DeepMind Genie 3 赚取关注的地方:从静止图像或短片到你能戳的东西。

这是 Google DeepMind Genie 3 赚取关注的地方:从静止图像或短片到你能戳的东西。

我尝试了三个简单的提示,每个进行了几次运行:

- 一个角色在岩架上的手绘草图。

- UI 仪表板的截图,带有卡片。

- 书桌上玩具汽车的照片。

结果(在受 Genie 影响的社区构建上观察到):草图在两个种子后成为一个有可信跳跃弧线的侧面卷轴;仪表板变成了一个我可以用箭头键”推”动的面板改组界面;玩具汽车场景最弱,发生了运动,但边缘流血,碰撞感觉像磁铁。我在第一次尝试时没有节省时间。到第三或第四次,我不是更快,但我思考更少。心理负荷下降。那是胜利。

分辨率和质量

质量感觉像是这个模型系列的移动目标。在我的测试中:

- 基础输出:480p 等效看起来最稳定。720p 用温和的闪烁保持。超过那个,细节改进但时间一致性下降,细线振动。

- 帧率:交互会话在单个 GPU 桌面上以每秒 15-20 帧的端对端感到舒适。推高引入了延迟峰值,这对控制的伤害比视觉帮助更多。

- 时间一致性:具有重复纹理的区域(草、网格、UI 微字)倾向于抖动。提供一个更干净的种子图像和限制相机运动减少了效果。

在 Genie 3 演示 中,保真度明显比第一篇论文更好,特别是对于角色和 HUD 元素。但一旦你轻推分辨率,你仍然在锐度和稳定性之间权衡。如果你的目标是一个感受原型,那个权衡很好。如果你需要清晰、可读的在运动中的文本,它还没有在那里。

控制机制

控制是我注意到与早期 Genie 复现比较的最大日常改进的地方:

- 动作映射在场景间感觉更一致。箭头键做”预期的事”大约 70-80% 的时间。我不必为每个种子重新学习映射。

- 短输入爆发比按住更好。轻敲创建更清晰的过渡:长按有时导致状态漂移(角色通过岩架”融化”,面板永远滑动)。

- 提示的约束有帮助。如果我暗示空间应该是”基于网格的”或”轮流的”,模型产生较少的漂移时刻。这不是硬约束,更像是损失景观中的一个推动。

我也尝试了种子帧上的简单草图叠加(框、箭头)。这有一个令人惊讶的效果:它并不总是改变外观,但它操控着可交互性。面板旁边的粗箭头增加了左/右会滑动它的几率。这符合模型大量依赖视觉线索来推断动作语义的想法。

延迟值得一提。即使以适度的帧大小,交互感觉体面只有当解码和动力学在同一设备上运行时。跨过程分割(或从 Colab 流)添加足够的延迟以使控制软弱。如果 Genie 3 将在创意工具中有用,低延迟本地或边缘执行似乎是不可商量的。

当前版本的限制

一些限制不断出现,如果你试图将其融入真实工作,它们很重要。

- 长视野连贯性:在约 10-15 秒的持续游戏后,世界漂移。平台忘记碰撞规则,UI 面板剪裁。对于快速感受检查很好,对于任何更长的东西摇摇欲坠。

- 视觉清晰度:文本和细线在运动下闪烁。对于氛围原型很好,对于可用性演示有风险。

- 确定性:相同的种子有时产生不同的可交互性。这对于探索很有趣:当你需要团队演示的重复性时这是个麻烦。

- 安全和知识产权:因为训练倾向于广泛视频,可识别的风格可以泄露。如果你在发货,你需要一个政策和一个审查通过。公开文档还没有解决这个问题。

- 计算和延迟:你不需要数据中心,但你感受到了重量。在单个消费者 GPU 上,我必须在速度和清晰度之间选择。

谁可能会欣赏现有的 Google DeepMind Genie 3?设计师和研究人员想要测试感受而不启动 Unity。想要学生戳动力学而不是仅仅观看它们的教育工作者。独立开发者在艺术之前探索机制。谁不会:任何需要生产稳定交互、像素精确 UI 行为或铁血可重复性的人。

为什么这重要:大多数工具在你选择方向后帮助你打磨。Genie 3 更早地推动。它使”这个想法甚至有趣吗?“的时刻更便宜。这听起来不戏剧化,但它改变了周二下午尝试什么。