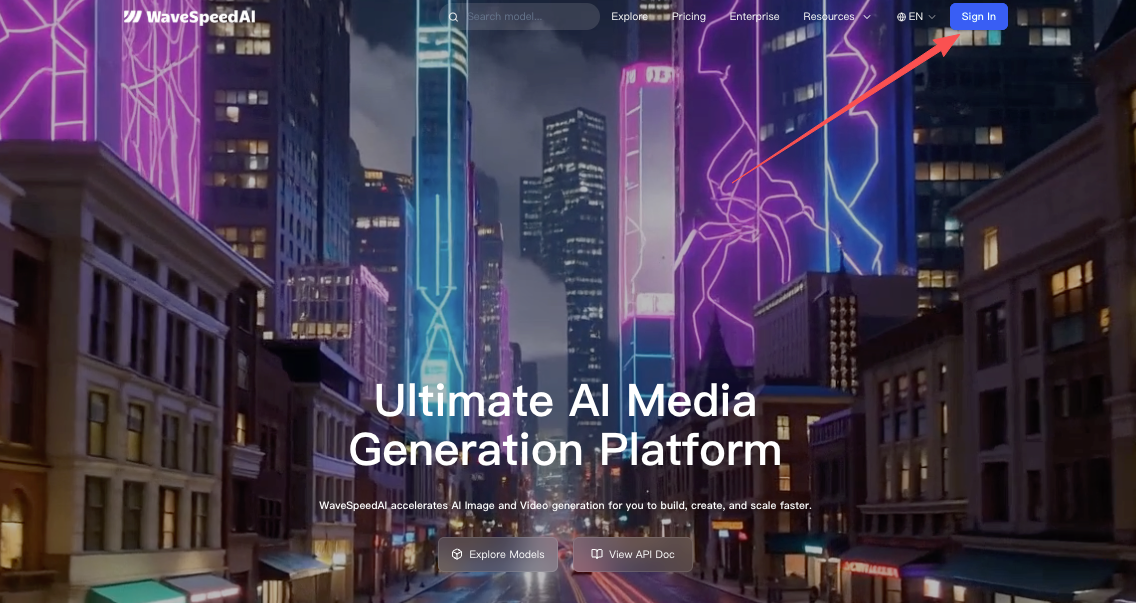

Доступ к GLM-4.7-Flash через WaveSpeed API

Привет, я Дора. Толчок пришёл из маленького раздражения: очередной проект, очередной API-ключ и ещё один SDK со своими идеями о токенах и повторах. Я хотела попробовать GLM-4.7-Flash, потому что люди постоянно говорили о его скорости для повседневного написания черновиков и быстрых исследований. Но я не хотела переделывать весь свой стек только для нескольких тестов.

Поэтому я выбрала более спокойный путь: доступ к GLM-4.7-Flash через WaveSpeed API. Те же паттерны клиента, один ключ, модель переключается. Я тестировала это на нескольких скриптах в январе 2026 года и вела заметки. Ничего драматичного. Но это сделало мой день-за-днём немного легче. И честно, это планка сейчас — лёгче лучше, чем громче.

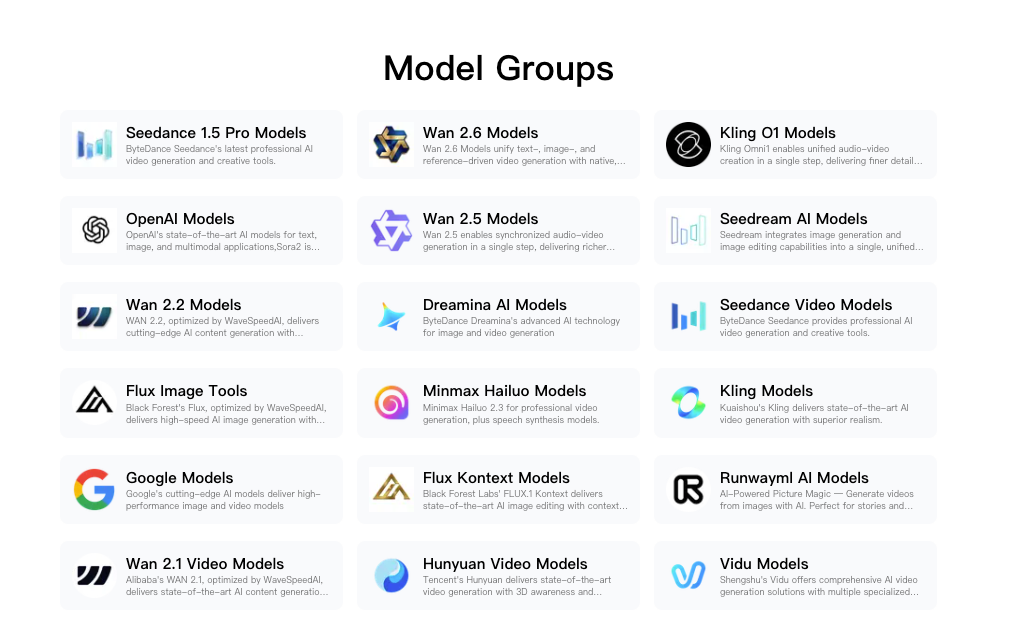

Почему использовать WaveSpeed

Я не буду притворяться, что WaveSpeed — волшебство. Это больше похоже на надёжный ящик с адаптерами: не захватывающе, но то, к чему ты тянешься, когда хочешь просто заняться своей работой.

Для меня было важно не количество моделей, а отсутствие трений. Я могла указать одинаковый код на разные модели, переключить одну строку и двигаться дальше. Вот и всё, без драмы.

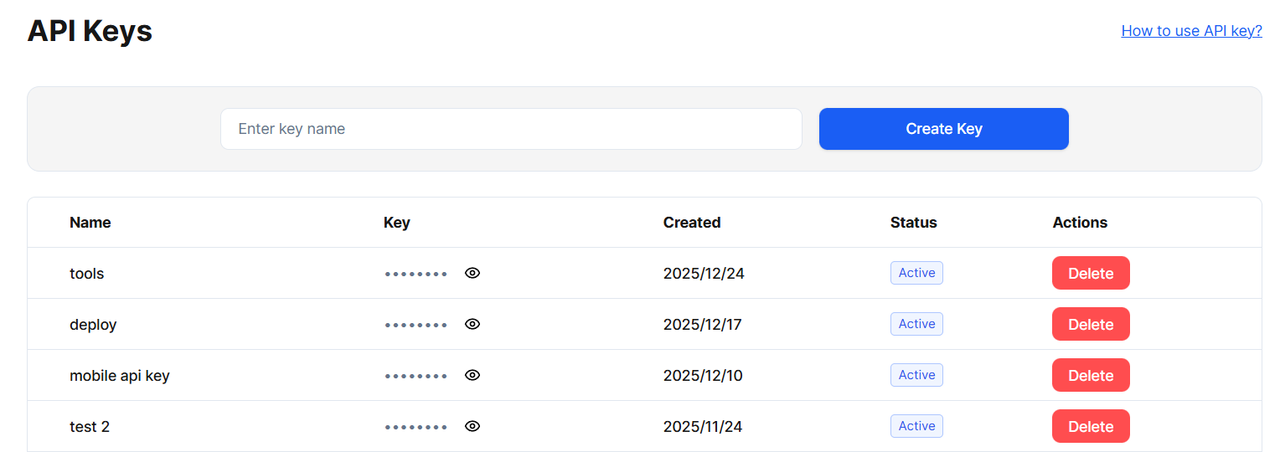

Один API-ключ, 600+ моделей

Моя настоящая победа была умственной. Я не рыскаю по панелям провайдеров, чтобы ротировать ключи или ограничивать расходы. Один ключ в моём менеджере секретов, и я могу маршрутизировать к GLM-4.7-Flash для быстрых черновиков, затем переходить к более мощной модели, когда запрос требует большей глубины. Я по-прежнему устанавливаю ограничения для каждого проекта, но накладные расходы снижаются.

Моя настоящая победа была умственной. Я не рыскаю по панелям провайдеров, чтобы ротировать ключи или ограничивать расходы. Один ключ в моём менеджере секретов, и я могу маршрутизировать к GLM-4.7-Flash для быстрых черновиков, затем переходить к более мощной модели, когда запрос требует большей глубины. Я по-прежнему устанавливаю ограничения для каждого проекта, но накладные расходы снижаются.

На практике: я сохранила свою существующую переменную окружения (в моём случае WAVESPEED_API_KEY), и изменила только имя модели. Это маленькое решение — держать имена согласованными, а не умными — спасло меня от нарушения CI.

Без переключения SDK

Я остановилась на OpenAI-совместимом клиенте, который уже использую. Нет новых имён методов, нет переучивания флагов потоковой передачи. Если вы создавали маленькие утилиты вокруг завершений чата, потоковой передачи и вызовов инструментов, они в основном переносятся. Мне нравится, что WaveSpeed не просит меня принять его мировоззрение, прежде чем вернуть токен, если это имеет смысл.

Два предостережения, которые я заметила:

- Имена моделей различаются у разных провайдеров. Я дважды проверяю точный идентификатор в официальной документации WaveSpeed перед фиксацией кода.

- Функции, специфичные для провайдера (как специальные форматы ответов или особенности вызовов функций), всё ещё могут отличаться. Держите небольшой файл адаптера, где вы нормализуете полезные нагрузки. Мой составляет 60 строк и окупается каждую неделю.

Быстрый старт код

Я использовала совместимые с OpenAI конечные точки, которые предоставляет WaveSpeed. Если ваш код уже обращается к Chat Completions API, это должно быть вам знакомо. Единственное реальное изменение — это базовый URL и имя модели.

Я тестировала это с 12 по 15 января 2026 года с небольшими пакетными запросами. Короткие запросы начинали потоковую передачу менее чем за секунду на моём соединении. Очевидно, ваши результаты будут варьироваться в зависимости от сети, размера запроса и нагрузки на сервер.

Я тестировала это с 12 по 15 января 2026 года с небольшими пакетными запросами. Короткие запросы начинали потоковую передачу менее чем за секунду на моём соединении. Очевидно, ваши результаты будут варьироваться в зависимости от сети, размера запроса и нагрузки на сервер.

Пример как замена на месте

Вот форма, которую я использовала. Проверьте официальную документацию WaveSpeed для последнего идентификатора модели (я видела его в списке как glm-4.7-flash).

Node.js (fetch):

const resp = await fetch("https://api.wavespeed.ai/v1/chat/completions", {

method: "POST",

headers: {

"Content-Type": "application/json",

"Authorization": `Bearer ${process.env.WAVESPEED_API_KEY}`

},

body: JSON.stringify({

model: "glm-4.7-flash",

messages: [

{ role: "system", content: "You are a concise assistant." },

{ role: "user", content: "Summarize this link in 3 bullets: https://example.com/post" }

],

temperature: 0.3,

stream: true

})

});Python (requests):

import os, requests

url = "https://api.wavespeed.ai/v1/chat/completions"

headers = {

"Authorization": f"Bearer {os.environ['WAVESPEED_API_KEY']}",

"Content-Type": "application/json",

}

payload = {

"model": "glm-4.7-flash",

"messages": [

{"role": "system", "content": "You are a concise assistant."},

{"role": "user", "content": "Outline a 5-step plan to vet a research source."}

],

"temperature": 0.2

}

r = requests.post(url, headers=headers, json=payload, timeout=30)

r.raise_for_status()

print(r.json()["choices"][0]["message"]["content"])Небольшие заметки, которые я нашла полезными:

- Если ваше приложение потоком передаёт токены, переносит то же самое SSE парсирование: флаг потока WaveSpeed вёл себя ожидаемо в моих тестах.

- Я установила тайм-аут для каждого запроса немного выше обычного, когда я не уверена в нагрузке модели.

- Логируйте имя модели в ответах. Будущее-вы благодарит вас, когда выводы смещаются и вам нужно подтвердить, что запустилось.

Комбинируйте с другими моделями

Большинство моей работы смешивает модели. GLM-4.7-Flash быстр для первых проходов, написания черновиков, суммирования, ответов на базовые вопросы. Когда мне нужны более тяжёлые рассуждения или специфическая способность (как сильный интерпретатор кода или определённая функция зрения), я маршрутизирую в другое место. WaveSpeed позволяет мне хранить эту маршрутизацию в одном месте.

Большинство моей работы смешивает модели. GLM-4.7-Flash быстр для первых проходов, написания черновиков, суммирования, ответов на базовые вопросы. Когда мне нужны более тяжёлые рассуждения или специфическая способность (как сильный интерпретатор кода или определённая функция зрения), я маршрутизирую в другое место. WaveSpeed позволяет мне хранить эту маршрутизацию в одном месте.

Что меня немного удивило: я ожидала, что переключение моделей во время выполнения будет беспорядочным. Это не было. Запросы сохранили ту же форму, так что я могла сравнивать выводы без искажения кода.

Рабочий процесс текста + изображения

Я попробовала маленькую рутину: собрать снимок экрана из отчёта пользователя, запустить лёгкое OCR или подпись зрения, затем попросить GLM-4.7-Flash создать краткое резюме действия на простом языке.

Мои шаги:

- Используйте модель с возможностью зрения для извлечения текста/ярлыков из изображения. Держите выход компактным, думайте пары ключ-значение или короткие маркеры.

- Передайте этот текст GLM-4.7-Flash со стабильным системным запросом (две строки), и попросите краткое резюме с решениями.

- Если изображение содержит таблицы, я добавляю быстрое правило: “Сохраняйте числа и единицы точно.” Это снизило очистку позже.

Заметки с поля:

- На 1,2 МБ PNG со смешанным пользовательским интерфейсом + текстом, проход зрения занял ~2–4 секунды для меня: суммирование GLM-4.7-Flash вернулось менее чем за секунду. Это разделение держало поток ощущаемым быстрым.

- Стоимость была предсказуемой, потому что я ограничила выход зрения несколькими сотнями токенов перед передачей.

- Если вам не нужна точность зрения, сначала запустите базовое OCR (Tesseract или платный OCR API), затем передайте текст GLM-4.7-Flash. Дешевле, часто достаточно хорошо.

Рабочий процесс текста + видео

Видео тяжелее, очевидно. Я не отправляла полное видео ни одной модели. Я сначала извлекла транскрипцию (whisper или платный ASR), затем маршрутизировала разделы GLM-4.7-Flash для быстрого суммирования.

Цикл, который сработал:

- Транскрибируйте видео один раз. Если можете, держите временные метки.

- Разбейте по очередям говорящих или сегментам 3–5 минут (что чище).

- Попросите GLM-4.7-Flash резюме сегментов и решения. Держите системный запрос закреплённым: “Вы возвращаете только структурированный JSON с полями A/B/C.”

- Сшейте план верхнего уровня из сегментов со вторым проходом.

На практике GLM-4.7-Flash казался подходящим для резюме сегментов: быстр, низкое трение, достаточная точность для планирования. Для финального плана я иногда переключал модели для тона или нюанса. Я держала всё внутри WaveSpeed, поэтому мой код не изменил форму.

Цены

Цены — это где я замедляюсь. Не потому, что это сложно, а потому что сюрпризы появляются в логах, а не в панелях управления.

GLM-4.7-Flash на WaveSpeed

По состоянию на январь 2026 года, GLM-4.7-Flash доступен через WaveSpeed со своей собственной ставкой за токен. Точные числа могут смещаться, поэтому я не буду их здесь привязывать. Я проверяю официальную страницу цен перед тем, как что-либо отправить в продакшн, и устанавливаю мягкие ограничения в моём конфиге окружения.

По состоянию на январь 2026 года, GLM-4.7-Flash доступен через WaveSpeed со своей собственной ставкой за токен. Точные числа могут смещаться, поэтому я не буду их здесь привязывать. Я проверяю официальную страницу цен перед тем, как что-либо отправить в продакшн, и устанавливаю мягкие ограничения в моём конфиге окружения.

Как я делаю прогнозы:

- Образец типичного запроса + ответа. Умножьте на количество ежедневных запусков. Это приводит меня к ежедневным токенам.

- Добавьте 20–30% буфер для плохих дней или новых запросов.

- Сравните это с более медленной, но дешёвой моделью для той же задачи. Если медленная модель не увеличивает время редактирования человеком, она в целом может победить.

Один практический трюк: логируйте токены по флагу функции. Я переключаю GLM-4.7-Flash для части пользователей и сравниваю время редактирования и жалобы. Это говорит мне больше, чем таблица цен.

Скидки на объём

WaveSpeed предлагает ценообразование на основе объёма. Уровни имеют значение, если вы пакетировали задачи или выполняли восполнения данных. Я связалась один раз, чтобы подтвердить пороги перед неделей пика: ответ был прямолинейным и спасил меня от регулирования работы в неудобные окна.

Моё правило: если я ожидаю 10-кратный скачок, кампанию, миграцию или исследовательский спринт, я сначала напишу в поддержку. Дело не в специальной сделке: это ясный потолок, чтобы я не нянчилась с работой всю ночь, потому что никто этого не хочет.

Мы создали WaveSpeed именно для такого рабочего процесса: меньше ключей, меньше переключений SDK и меньше времени, потраченного на размышления об инфраструктуре. Если вы жонглируете моделями и просто хотите, чтобы они вели себя за единым, предсказуемым API, это проблема, которую мы пытаемся решить.

➡️Вы можете исследовать это здесь.

Теперь ваша очередь: какой самый смешной цирк с API-ключами вы недавно испытали? Напишите в комментариях — я прочитаю их все, пока пью кофе и чувствую себя немного менее одинокой.