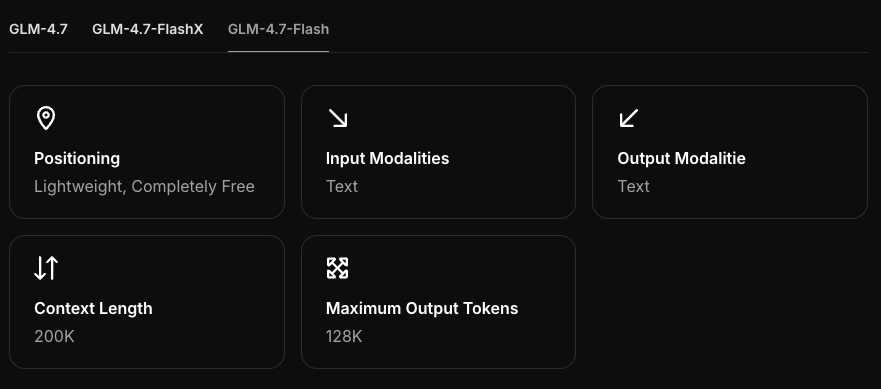

Запуск GLM-4.7-Flash локально: настройка Ollama, Mac и Windows

Привет, я Дора. Несколько дней назад небольшое неудобство подтолкнуло меня к этому: я всё время ждал завершения удалённых вычислений для небольших задач черновика. Не минут, просто достаточно задержки, чтобы я отвлёкся на письма и потерял нить мысли. На прошлой неделе (январь 2026) я попробовал запустить GLM-4.7-Flash локально, чтобы посмотреть, поможет ли экономия этих секунд мне думать яснее.

Коротко: помогло, но не по громким причинам. GLM-4.7-Flash казался больше стабильным помощником, чем звёздным моделем. Он достаточно быстр, чтобы держать меня в потоке работы, и лёгкий достаточно, чтобы запуститься на ноутбуке без перегрева. Я поделюсь тем, что сработало, где подвело, и настройкой, которая поддерживала скучность, но в хорошем смысле.

Требования к оборудованию

Минимальный GPU / ОЗУ

Я запускал GLM-4.7-Flash на трёх машинах:

- MacBook Pro M3 Pro (12-ядерный CPU / 18-ядерный GPU, 36 ГБ ОЗУ)

- Mac mini M2 (24 ГБ унифицированной памяти)

- Windows-компьютер с RTX 4090 (24 ГБ VRAM)

Из этих тестов практический минимум:

- Только CPU (Mac/Windows/Linux): 16 ГБ системной памяти работают, 32 ГБ удобнее. Ожидайте более медленных первых токенов.

- Apple Silicon (Metal): 16 ГБ унифицированной памяти пригодны с квантизацией 4-5 бит и скромным контекстом (2–4K). 8 ГБ было тесновато.

- NVIDIA: 8–12 ГБ VRAM — это минимум, что я бы попробовал для 4-битной квантизации. 16 ГБ+ комфортнее.

GLM-4.7-Flash похож на модель среднего размера (примерно под 10–12B параметров). В 4-битной квантизации обычно требуется ~5–6 ГБ памяти устройства плюс KV-кэш. Если вы используете длинные контексты или много параллельных запросов, память растёт.

Рекомендуемые спецификации

Если вы хотите почувствовать “всегда отзывчивость”:

- Apple Silicon: M3 или новее с 24–36 ГБ унифицированной памяти: контекст 4–8K.

- NVIDIA: 24 ГБ VRAM (например, 3090/4090) даёт свободу для большего контекста и параллелизма.

- Хранилище: быстрый SSD: модели загружаются быстрее и меньше перезаписей.

Я заметил, что модель перестаёт быть “блестящей”, когда давление памяти возрастает; выгрузка в подкачку или переполнение VRAM добавляет лёгкое заикание, которое нарушает плавность работы. Немного дополнительной памяти имеет большое значение.

Ollama Setup

Я использовал Ollama, потому что она делает локальные запуски простыми и согласованными на разных машинах. Версия важна.

Установите Ollama 0.14.3+

- macOS: brew install ollama (или обновите с brew upgrade ollama).

- Windows: используйте официальный установщик с сайта Ollama.

- Linux: следуйте скрипту curl из документации.

Я на версии 0.14.3 на момент этого теста (январь 2026). Более новые версии иногда меняют бэкенды по умолчанию или поведение квантизации, поэтому я придерживаюсь версии, которая стабильна для меня, пока у меня нет причины обновляться.

Загрузите и запустите GLM-4.7-Flash

Два пути сработали для меня:

-

Если ваша библиотека Ollama включает официальную сборку GLM-4.7-Flash:

- ollama pull glm-4.7-flash

- ollama run glm-4.7-flash

-

Если она не отображается (это произошло на одной машине):

- Создайте Modelfile, который указывает на известный GGUF или совместимый артефакт для GLM-4.7-Flash.

- Пример Modelfile (упрощённый):

- FROM ./glm-4.7-flash-q4.gguf

- Добавляйте шаблоны подсказок только если вы уверены, что они нужны: я оставил минимум.

- Затем: ollama create glm-4.7-flash-local -f Modelfile

- Запустите: ollama run glm-4.7-flash-local

Заметки из использования:

- Первая загрузка медленнее, так как кэши прогреваются.

- Я держу num_ctx консервативным (4K или 8K), пока не суммирую черновик книги. Большие контексты хороши выглядят, но они требуют много памяти и не всегда помогают качеству для ежедневных черновиков.

- Если генерации выглядят нерешительно, попробуйте снизить температуру до 0.6–0.7 и немного поднять top_p: это сделало выходы более жёсткими для меня без потери скорости.

Справка: документация Ollama хороша для специфичных флагов платформы и текущих бэкендов.

Производительность на Mac

Бенчмарки M4 / M3 / M2

Это не лабораторного уровня, просто стабильные запуски на письме и лёгких кодовых запросах, температура 0.7, контекст 4K, квантизация 4-бит:

- M4 (заимствованная машина, 48 ГБ): 60–85 токен/сек после прогрева. Первый токен примерно за 350–500 мс.

- M3 Pro (36 ГБ): 35–55 токен/сек. Первый токен примерно за 500–800 мс.

- M2 (24 ГБ): 20–30 токен/сек. Первый токен примерно за 900–1200 мс.

Рассматривайте диапазоны как проверку ощущений. Я попробовал несколько контекстов 8K на M3 Pro: скорость упала ~20–30%, но осталась пригодной для черновиков. На M2 длинные контексты пересекли мою линию “ощущается липким”. Я держал это на 2–4K там.

Оптимизация памяти

Что помогло больше всего на macOS:

- Держите меньше вкладок терминала с работающими моделями. Очевидно, да, но я забываю.

- Подгоните контекст размер. 4K — сладкое пятно для меня.

- Используйте 4-битную квантизацию когда можете. 5-битная казалась похожей по качеству для меня, но медленнее.

- Закройте приложения, которые берут GPU-время (видеоредакторы, некоторые вкладки браузера с WebGL).

Я также заметил, что использование стабильного системного промпта снижает переделки. Не быстрее на бумаге, но меньше повторов означает лучшую “ощущаемую скорость”. Небольшой промпт вроде: “Будьте лаконичны, используйте простой английский, без маркетингового тона.” Это соответствует сильным сторонам модели.

Windows + NVIDIA

Конфигурация RTX 3090 / 4090

На 4090 (24 ГБ) GLM-4.7-Flash был постоянно быстр:

- 4-битная квантизация, контекст 4–8K: 120–220 токен/сек после прогрева.

- Первый токен: ~250–400 мс.

- Параллельные запросы: 2–3 потока перед заиканием.

Друг запустил это на 3090 (24 ГБ) и видел ~15–25% ниже пропускную способность с похожими настройками. Если вы выходите за пределы 8K контекста или держите много ответов одновременно, вы попадёте в ограничение VRAM. Я обычно отступаю к 4–6K и держу пакеты малыми.

CUDA Setup

Что имело значение на практике:

- Свежий драйвер NVIDIA (чистая установка помогла одной машине, которая заикалась).

- CUDA 12.x и совпадающий runtime если вы выходите за пределы Ollama (vLLM/SGLang). Для самой Ollama, вам не всегда нужен полный Toolkit, но обновлённые драйверы неизбежны.

- Настройки питания: установите ваш GPU на “Prefer maximum performance”. Это звучит как совет для геймеров, но это остановило дросселирование тактовой частоты во время длинных запусков.

Если вы получаете ошибки загрузки или жёсткий откат на CPU, я проверил бы:

- Совпадение версии драйвера с CUDA runtime.

- Сканирует ли антивирус ваш каталог модели (это произошло: это было глупо: это было медленно).

Справка: таблица совместимости драйвер–CUDA NVIDIA стоит быстрой проверки перед часовым отладком.

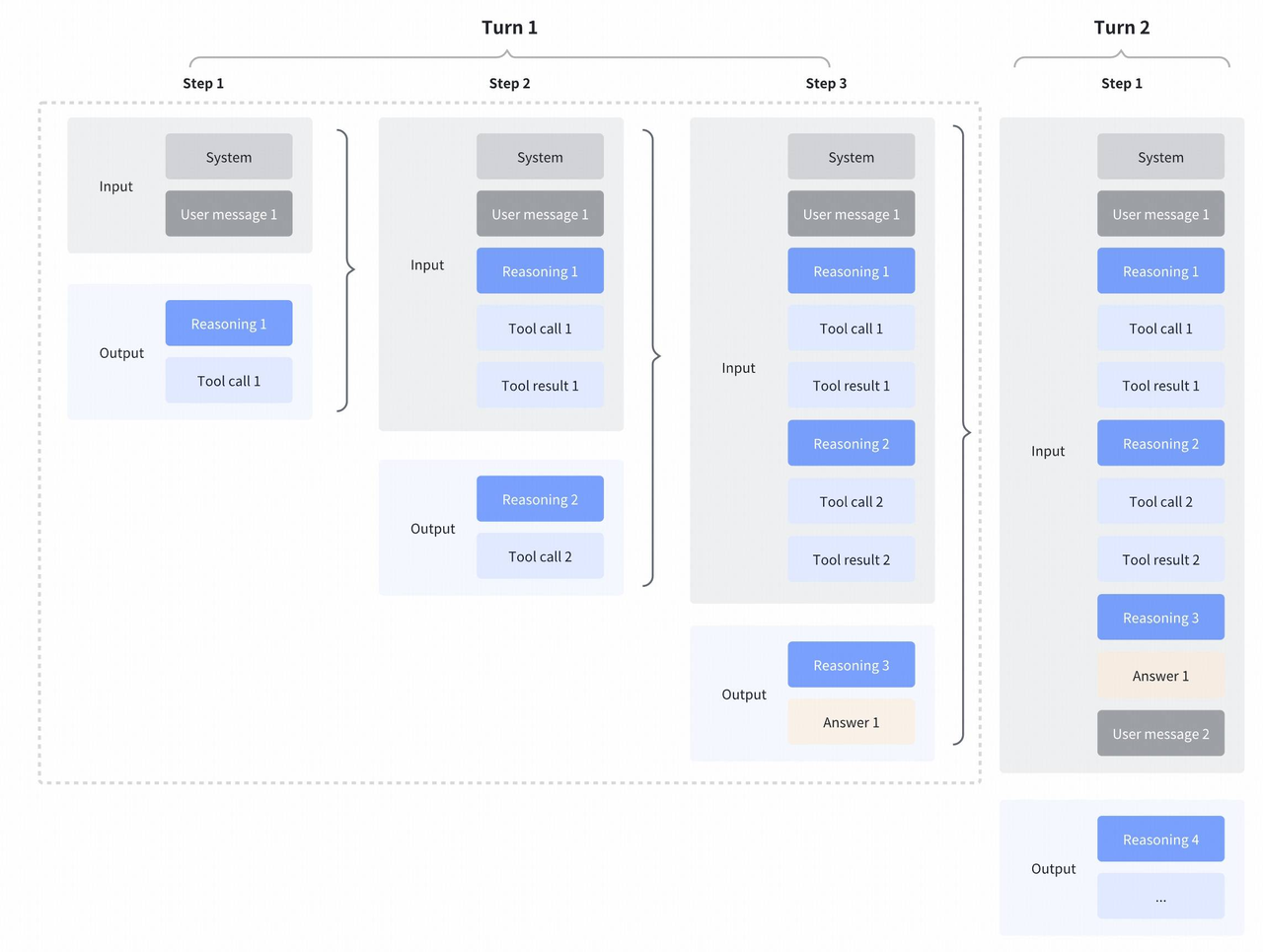

vLLM / SGLang

Я попробовал GLM-4.7-Flash с vLLM и SGLang, когда хотел больше контроля над пакетированием и серверными конечными точками.

vLLM

- Установка: недавний Python, совместимый с CUDA PyTorch, затем pip install vllm.

- Запуск:

python -m vllm.entrypoints.openai.api_server --model <your_glm_flash_id> --dtype auto --max-model-len 4096 - Почему я это использовал: стабильный OpenAI-совместимый API, твёрдая пропускная способность для многопользовательских или многовкладочных рабочих потоков.

SGLang

- Установка: pip install sglang

- Запуск:

python -m sglang.launch_server --model <your_glm_flash_id> --context-length 4096 - Почему я это использовал: потоковая трансляция низкой задержки ощущалась энергично, и она хорошо работала с маленькими маршрутизирующими задачами.

Обоим нужен правильный путь модели или HF repo ID. Если GLM-4.7-Flash не в вашем индексе по умолчанию, вам нужно указать на локальный GGUF или совместимый формат весов. Также: совпадайте CUDA и версии драйверов, или вы будете ловить неясные ошибки ядра. Я держал dtype на auto и только заставлял fp16, когда я знал, что у меня есть VRAM в запасе.

Для моих одиночных пользовательских сеансов письма Ollama остался проще. vLLM/SGLang имели смысл, когда я тестировал инструменты, которым нужна OpenAI-подобная конечная точка.

Устранение неполадок

Ошибки загрузки модели

Что я видел:

- “out of memory” при загрузке. Исправление: переключитесь на меньшую квантизацию (например, 4-бит), понизьте num_ctx или закройте GPU-тяжёлые приложения.

- “no compatible backend” на Windows. Исправление: обновите драйвер GPU: убедитесь, что вы не установили CPU-только PyTorch если вы используете vLLM/SGLang: перезагрузитесь после обновлений драйверов.

- Модель не найдена в Ollama. Исправление: создайте Modelfile и ollama create: или загрузите с точного тега репо если он существует.

Если модель молча откатывается на CPU, признак — шум вентилятора (или его отсутствие) плюс намного более медленные токены/сек. Я научился проверять использование устройства перед тем, как предположить, что модель “ухудшилась”.

Исправления медленного вывода

Небольшие изменения, которые имели значение больше, чем я ожидал:

- Подгоните контекст размер. Половина контекста часто ускоряет вещи больше, чем возня с сэмплингом.

- Прогрейте кэш. Быстрый короткий запуск улучшает следующий.

- Снизьте параллельные потоки. Параллелизм выглядит эффективным, пока KV-кэш вас не споткнёт.

- Для NVIDIA: установите режим High Performance, закройте приложения оверлея и остановите фоновые кодировщики.

- На macOS: держите зарядное устройство в: некоторые ноутбуки уменьшают скорость на батарее.

Ещё одно: я перестал гнаться за макс токенов/сек. Лучшая метрика для меня была “первая пригодная мысль”. GLM-4.7-Flash дал мне это быстро, когда я держал запросы сосредоточенными и контексты разумными.

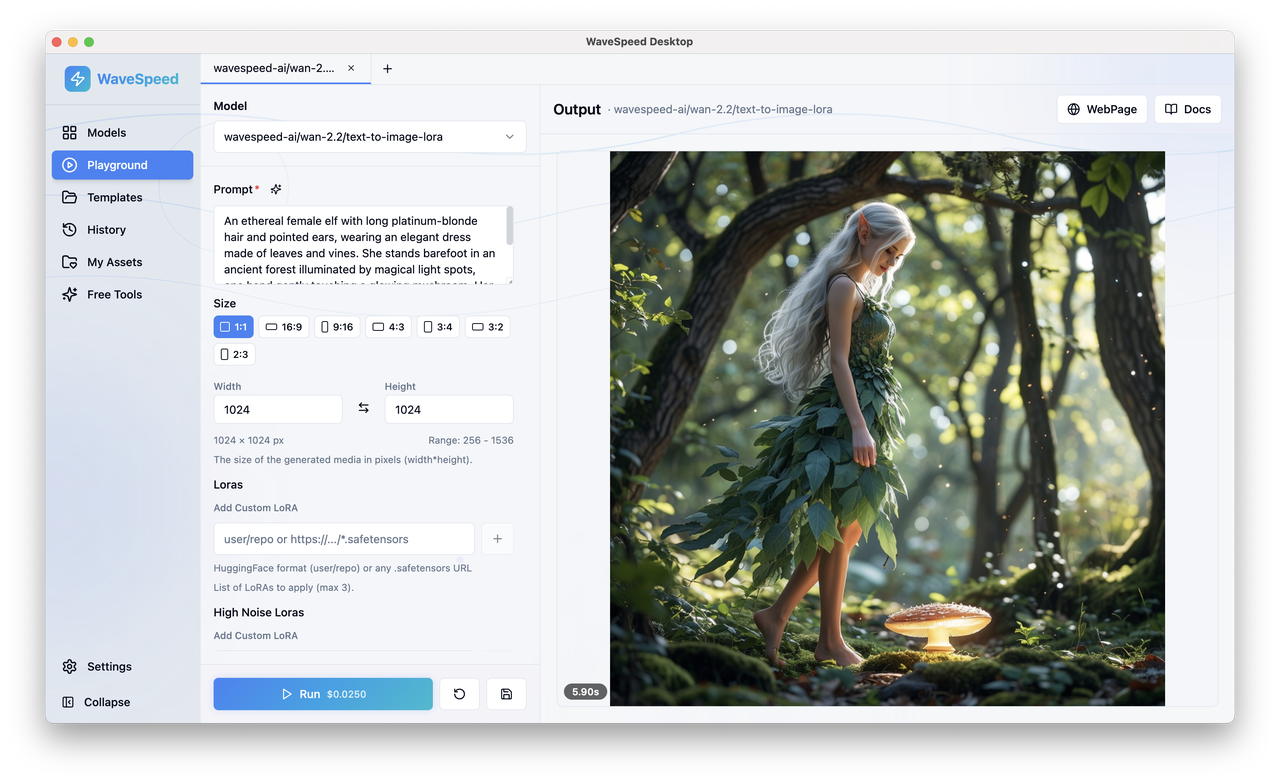

Если вам нравится скорость GLM-4.7-Flash, но вы не любите присматривать за драйверами, версиями CUDA или причудами бэкенда, попробуйте WaveSpeed — нашу собственную платформу, сосредоточенную на стабильном и быстром выводе без низкоуровневой настройки. Вы получаете предсказуемую задержку без беспокойства о файлах моделей, форматах квантизации или совместимости GPU.

Если вам нравится скорость GLM-4.7-Flash, но вы не любите присматривать за драйверами, версиями CUDA или причудами бэкенда, попробуйте WaveSpeed — нашу собственную платформу, сосредоточенную на стабильном и быстром выводе без низкоуровневой настройки. Вы получаете предсказуемую задержку без беспокойства о файлах моделей, форматах квантизации или совместимости GPU.