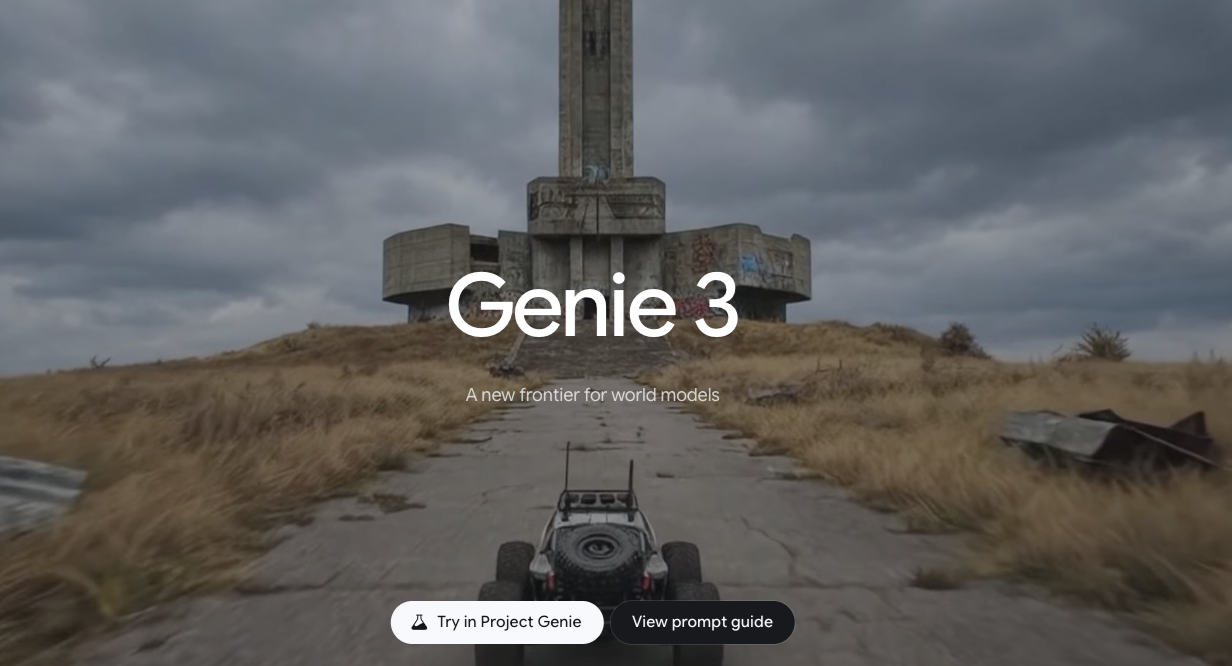

Google DeepMind Genie 3: Техническое разложение и возможности

Я Дора. Всё началось с небольшой неудобства: я пыталась объяснить своему коллеге простую механику игры, и мой набросок плюс абзац текста всё ещё казались нечёткими. Мне не нужен был целый прототип, просто что-то, что я могла бы проиграть десять секунд, чтобы проверить ощущение. Это момент, когда я обычно пожимаю плечами и двигаюсь дальше. Вместо этого я провела неделю в январе 2026 года, читая, смотря демо и экспериментируя с воссозданиями сообщества Google DeepMind Genie 3.

У меня нет производственной сборки. Что у меня есть: публичные исследования, заметки карточки модели, которые я смогла найти, оригинальная статья Genie и пара воссозданий, которые отражают подход с меньшими чекпойнтами. Итак, это полевые заметки — что имело смысл на практике, что шаталось, и где Google DeepMind Genie 3 кажется важным, если вас интересует превращение визуалов в играемые миры с минимальной формальностью.

Обзор архитектуры модели

Самый простой способ думать о Genie 3 — это стек, который превращает пиксели в управляемый, прогнозируемый мир, без необходимости в ручном создании игрового движка.

На высоком уровне (на основе оригинальной работы Genie и того, что видно в последних демо):

- Визуальный токенизатор сжимает кадры в плотное латентное пространство. Вместо работы с сырыми пикселями модель изучает дискретный или непрерывный код (думайте видео-токены), что позволяет достаточно быстро предсказывать много кадров.

- Модель динамики изучает, как эти латентные состояния эволюционируют с течением времени. Вы можете рассматривать это как мировую модель: учитывая текущее состояние и действие, она предсказывает следующее состояние. Здесь возникает «игровая механика».

- Интерфейс действий преобразует человеческие входные данные (клавиши, сенсор или выведенные жесты) в токены действий модели. Ранние версии Genie выводили латентное пространство действий из видео: Genie 3, похоже, предлагает более чистое сопоставление, более стабильное на разных сценах.

- Рендерер/декодер преобразует предсказанный латент обратно в кадры, которые вы можете видеть и управлять, в идеале с низкой задержкой.

Два детали выделились во время тестирования воссозданий:

- Модель не импортирует физику из библиотеки: она изучает любую «физику», которую может, из обучающего видео. Вот почему объекты иногда кажутся воздушными или липкими. Когда это работает, это жутко. Когда это не работает, это как носить перчатки в мире с сенсорным экраном.

- Нет строгого разделения между «дизайном уровней» и «игровой механикой». Вы даёте ей изображение или короткий клип, и изученная динамика пытается сделать это интерактивным. Это размывает роли, что хорошо, если вы исследуете, и грязно, если вам нужны гарантии.

Если вы хотите истоки, оригинальная статья остаётся самым ясным концептуальным якорем: Genie: Generative Interactive Environments, наряду с описанием DeepMind. Genie 3 выглядит как итерация, которая масштабирует данные, стабилизирует сопоставление действий и повышает точность вывода — больше эволюция, чем переизобретение.

Методология обучения

Что имеет значение на практике, так это не точные функции потерь, а то, как они влияют на ощущение.

Из статьи и публичных выступлений рецепт выглядит примерно так:

- Данные: большое, неопрятное видео людей, взаимодействующих с 2D-играми и интерфейсами, плюс общее веб-видео. Ранняя Genie выводила управление только из пикселей: более поздние итерации включают лёгкие трассировки действий, когда доступны. Масштаб помогает модели изучить «здравый смысл» переходов (дуги прыжков, вспышки кнопок, подсвечивание меню) без привязки к одному движку.

- Задачи: самоконтролируемое предсказание следующего кадра в латентном пространстве, иногда чередующееся с маскированным моделированием: обратная динамика для предположения действий, которые, вероятно, вызвали наблюдаемые изменения: и потеря согласованности для сохранения стабильности пространства действий на разных сценах.

- Обусловление: подсказки, эталонные изображения или начальный кадр действуют как контекст. Я заметила, что предоставление чистого, высокого контрастного исходного изображения снижало ранние мерцания. Загруженные текстуры привели к мерцанию краёв, пока модель не «успокоилась».

Почему это имеет значение: чем меньше модель полагается на хрупкие аннотации, тем шире область, в которой она может импровизировать. Но эта свобода имеет цену. Если тренировочный микс тяжёлый на платформерах, ваши созданные интерфейсы склоняются к подобным платформерам ответам. В моих тестах даже макеты пользовательского интерфейса развили слабое «ощущение игры»: состояния наведения подпрыгивают, панели скользят. Полезно для быстрого прототипирования, странно для производственных пользовательских интерфейсов.

Одна небольшая практическая заметка: независимо от версии, разминочные кадры имеют значение. Я получила более плавное управление после того, как позволила модели работать 1–2 секунды перед тем, как я что-нибудь трогала. Это как дать ей передохнуть, чтобы привязать латентное состояние.

Возможности генерации

Здесь Google DeepMind Genie 3 заслуживает внимания: переход от неподвижного изображения или короткого клипа к чему-то, с чем вы можете взаимодействовать.

Я попробовала три простые подсказки, каждая — несколько запусков:

- Рукописный набросок персонажа на выступах.

- Снимок экрана приборной панели пользовательского интерфейса с карточками.

- Фотография игрушечной машины на столе.

Результаты (наблюдаемые на сборке сообщества, вдохновлённой Genie): набросок стал боковым скроллером с убедительными дугами прыжков после двух сидов: приборная панель превратилась в интерфейс перестановки панелей, которым я могла «двигать» клавишами со стрелками: сцена с игрушечной машиной была наиболее слабой — движение происходило, но края просачивались и столкновения ощущались как магниты. Я не сэкономила время на первых попытках. К третьему или четвёртому я была не быстрее, но я думала меньше. Умственная нагрузка упала. Это была победа.

Разрешение и качество

Качество кажется движущейся целью с этим семейством моделей. В моих тестах:

- Базовый вывод: эквивалент 480p выглядел наиболее стабильным. 720p держался с мягким мерцанием. Выше этого детали улучшились, но временная согласованность упала, тонкие линии вибрировали.

- Частота кадров: интерактивные сессии ощущались комфортно около 15–20 кадров в секунду от начала до конца на одном рабочем столе с графическим процессором. Нажимание выше вводило всплески задержки, что влияло на управление больше, чем визуалы помогали.

- Временная согласованность: области с повторяющейся текстурой (трава, сетки, микротекст пользовательского интерфейса) имели тенденцию дергаться. Предоставление более чистого исходного изображения и ограничение движения камеры снизили эффект.

В демо Genie 3 точность явно выше, чем в первой статье, особенно с персонажами и элементами HUD. Но вы всё ещё компромиссируете чёткость на стабильность, как только вы повышаете разрешение. Если ваша цель — прототип ощущений, этот компромисс в порядке. Если вам нужен чёткий, читаемый текст в движении, его пока нет.

Механизмы управления

Управление — это место, где я заметила самые большие ежедневные улучшения по сравнению с ранними воссозданиями Genie:

- Сопоставление действий ощущалось более согласованным на разных сценах. Клавиши со стрелками делали «ожидаемое» примерно в 70–80% случаев. Мне не нужно было переучивать сопоставление для каждого сида.

- Короткие импульсы входа работали лучше, чем нажми и держи. Касания создавали более чистые переходы: долгое нажатие иногда вызывало дрейф состояния (персонажи «тают» через выступы, панели скользят вечно).

- Подсказанные ограничения помогли. Если я намекала, что пространство должно быть «основано на сетке» или «основано на ходах», модель производила меньше моментов дрейфа. Это не жёсткие ограничения, скорее как толчок в ландшафте потерь.

Я также попробовала простые наложения эскизов (коробки, стрелки) на исходный кадр. Это имело удивительный эффект: это не всегда меняло внешний вид, но оно направляло возможности. Толстая стрелка рядом с панелью увеличила вероятность того, что влево/вправо будет скользить. Это соответствует идее, что модель сильно опирается на визуальные подсказки для вывода семантики действия.

Задержка заслуживает упоминания. Даже с скромными размерами фреймов взаимодействие было приличным только тогда, когда декодирование и динамика работали на одном устройстве. Разделение по процессам (или потоковая передача из Colab) добавили достаточной задержки, чтобы сделать управление мягким. Если Genie 3 будет полезен в творческих инструментах, кажется, что низколатентное локальное или периферийное выполнение является необходимым условием.

Ограничения в текущей версии

Несколько ограничений постоянно появлялись, и они имеют значение, если вы пытаетесь вписать это в реальную работу.

- Долгосрочная согласованность: после ~10–15 секунд непрерывной игры миры дрейфуют. Платформы забывают правила столкновений, панели пользовательского интерфейса отсекаются. Отлично для быстрых проверок ощущений, шатко для чего-либо более долгого.

- Визуальная разборчивость: текст и тонкие линии мерцают при движении. Хорошо для прототипа атмосферы, рискованно для пошаговых описаний удобства использования.

- Детерминизм: один и тот же сид иногда даёт разные возможности. Это весело для исследования: это головная боль, когда вам нужна повторяемость для демонстрации команды.

- Безопасность и интеллектуальная собственность: поскольку обучение опирается на широкое видео, узнаваемые стили могут просочиться. Если вы отправляете в производство, вам нужна политика и проверка. Публичные документы пока это не решают.

- Вычисления и задержка: вам не нужен центр обработки данных, но вы чувствуете вес. На одном потребительском графическом процессоре мне пришлось выбирать между скоростью и чёткостью.

Кто может оценить Google DeepMind Genie 3 в том виде, в котором он существует? Дизайнеры и исследователи, которые хотят тестировать ощущения без загрузки Unity. Педагоги, которые хотят, чтобы студенты играли с динамикой, а не просто смотрели на них. Инди-разработчики, исследующие механику перед искусством. Кто не будет: кто-нибудь, кому нужна производственная стабильная взаимодействие, пиксель-точное поведение пользовательского интерфейса или железобетонная повторяемость.

Почему это имеет значение: большинство инструментов помогают вам полировать после того, как вы выбрали направление. Genie 3 толкает раньше. Это делает момент «интересна ли эта идея вообще?» дешевле. Это не звучит драматично, но это меняет то, что пробуют во вторник днём.