DeepSeek V4 Цены: В 20-50 раз дешевле, чем OpenAI (Анализ затрат)

Недавно я искал более тихую модель, что-то, что можно было бы вызывать часто, не глядя на счетчик каждый час. DeepSeek V4 постоянно всплывал в беседах с другими разработчиками, обычно с поднятой бровью: “Это… действительно дешево.”

Дора здесь. Я потратил вторую половину января 2026 года на интеграцию этого в несколько небольших рабочих потоков: резюме исследований, переписыватель заметок о продуктах и еженедельный гроумер логов работ. Ничего сложного. Меня интересовало, как токены переводились в реальные доллары за обычную неделю. Вот что я узнал о стоимости DeepSeek V4 API, о скидках, которые имеют значение, и о простом способе планирования бюджета перед запуском.

Текущие цены DeepSeek

Я не буду утверждать, что цифры стабильны. Цены меняются, и они различаются в зависимости от того, откуда вы берете доступ (прямой или через посредника, например OpenRouter). Итак, два якоря:

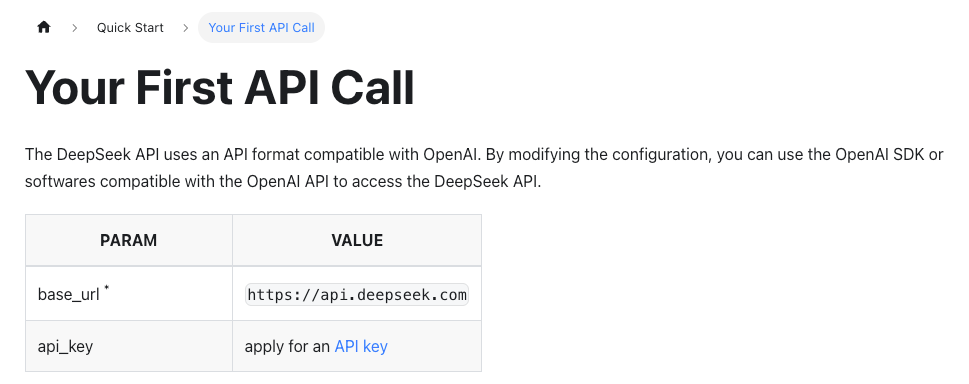

- Проверьте источник: официальная документация API DeepSeek и страница цен. Это каноническая ставка при прямом подключении.

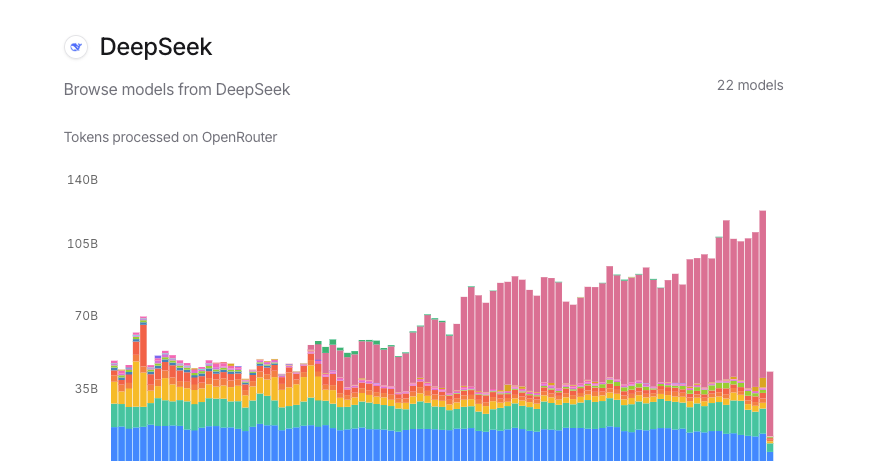

- Если вы маршрутизируете через маркетплейс, откройте карточку модели. Например, модели DeepSeek на OpenRouter указывают ставки за миллион токенов и любые временные скидки.

То, что я видел в конце января 2026 года у разных поставщиков, было логично: DeepSeek V4 значительно ниже передовых моделей как для входящих, так и для выходящих токенов. Точные суммы варьируются. Я делюсь тем, как я работаю с ценообразованием, а не замораживаю его на месте.

То, что я видел в конце января 2026 года у разных поставщиков, было логично: DeepSeek V4 значительно ниже передовых моделей как для входящих, так и для выходящих токенов. Точные суммы варьируются. Я делюсь тем, как я работаю с ценообразованием, а не замораживаю его на месте.

Стандартные ставки

Если вы новичок в модели выставления счетов на основе использования, имеют значение две строки:

- Входящие токены (что вы отправляете): взимается за 1 млн токенов.

- Выходящие токены (что вы получаете обратно): также взимается за 1 млн токенов, обычно выше входящего.

В моих запусках необработанные ставки V4 были достаточно низкими, чтобы небольшие ежедневные всплески не причиняли вреда. Это наиболее ярко проявляется в пакетных работах. Например, мой еженедельный гроумер логов отправляет ~20 подсказок по ~3–5K входящих токенов каждая и получает ~1–2K выходящих токенов. Даже с консервативными примерными ставками общая сумма за весь запуск оставалась в зоне “денег на кофе”.

Две практические заметки:

- Инфляция выходящих токенов подкрадывается незаметно. Если ваши подсказки поощряют длинные размышления, выходящая строка может удвоить ваш счет. Я ограничил max_tokens и сделал стиль более сжатым. Сэкономил деньги, лучшие результаты.

- Размер фрагмента имеет значение. Если вы суммируете длинные документы, вы будете платить за каждый перекрывающийся токен. Я перешел с перекрытия из 1600 токенов на 400 и не потерял качество.

Скидки при попадании в кэш (скидка 90%)

Это изменило мою ментальную математику. Некоторые платформы и поставщики моделей поддерживают кэширование подсказок для повторяющихся префиксов. Если первые N токенов вашей подсказки не изменяются (системное сообщение, общие инструкции, схема), попадания в кэш могут быть выставлены с крутой скидкой. 90% скидка — это цифра, которую я видел задокументированной у нескольких поставщиков, реализующих кэширование (доступность варьируется: подтвердите на странице цен вашего поставщика).

Как это выглядело на практике:

- Мой резюме исследований использует длинное, фиксированное системное сообщение и стабильную схему инструмента. Только исходный текст меняется.

- После первого вызова последующие вызовы попадают в кэш для этого общего префикса.

- На платформах, почитающих кэширование при выставлении счетов, повторно используемые токены упали до сниженной ставки.

Два предостережения от тестирования:

- “Закрытый” не кэшируется. Измените одну строку в общем префиксе, и вы пропустите попадание.

- Большие фиксированные схемы окупаются сами. Если вы можете консолидировать инструкции и инструменты в стабильный префикс, сделайте это один раз и используйте кэш.

Если ваш поставщик не предоставляет кэширование, вы все равно можете имитировать часть сбережений, переместив повторяющееся руководство в более короткое, консистентное системное сообщение и убрав избыточность из сообщений пользователя.

Скидки вне пиковых часов (скидка 75%)

Несколько маркетплейсов начали предлагать временные скидки для сглаживания спроса. Я видел окна вне пиковых часов со значительными сокращениями (цифры вроде 50–75% скидки показываются, но это зависит от перепродавца и модели). Модели DeepSeek, как правило, участвуют, потому что их экономика уже наклоняется в сторону эффективности.

Два способа, которыми это мне помогло:

- Я запланировал свою еженедельную работу логов на окно вне пиковых часов. Одна и та же рабочая нагрузка, более низкая строка позиции.

- Я пакетировал сводки исследований ночью. Задержка не имела значения, а скидка имела.

Это не универсально. Если вы подключаетесь к DeepSeek напрямую, проверьте, публикуют ли они какое-либо время суток цены. Если вы идете через брокера, прочитайте мелкий шрифт карточки модели. Разброс может быть достаточно большим, чтобы изменить время запуска вещей.

Почему DeepSeek такой дешевый

Я хотел понять, была ли низкая цена промо-вещью или архитектура действительно ее поддерживает. Из того, что известно публике, выделялись два момента.

Я хотел понять, была ли низкая цена промо-вещью или архитектура действительно ее поддерживает. Из того, что известно публике, выделялись два момента.

Архитектура MoE

Новые крупные модели DeepSeek полагаются на Mixture-of-Experts (MoE). Проще говоря: вместо пробуждения всего мозга для каждого токена, маршрутизатор выбирает несколько подсетей экспертов для его обработки. Вы все еще получаете способную модель, но только часть параметров работает за каждый шаг, что сокращает вычисления и затраты.

Почему это имеет значение на практике:

- Пропускная способность масштабируется лучше. С моей стороны, p95 задержка оставалась разумной даже при нажатии параллельных работ.

- Затраты не возрастают линейно с усложнением. Длинные подсказки не наказывали так жестко, как они это делают на плотных, всегда включенных моделях.

Я использовал другие модели MoE, которые казались хрупкими на нишевых задачах: V4 обрабатывал структурно-тяжелые подсказки (выходные данные JSON, использование инструментов) без колебаний. Эта стабильность — часть истории затрат: меньше повторов, меньше переделок.

Engram Efficiency

В документах DeepSeek упоминается работа над эффективностью обработки контекста и памяти (они отмечают такие вещи, как улучшенная маршрутизация внимания и обработка кэша KV в некоторых выпусках). Я не могу проверить внутренние работы, но я могу поделиться тем, что я наблюдал:

- Подсказки с длинным контекстом не уменьшали пропускную способность в моих тестах в январе 2026 года. Я запустил контексты с 32K токенами без ощущения “все становится медленнее”.

- Детерминированное форматирование выдержало при более высокой температуре, чем я ожидал, что означало, что я мог сохранить выходные данные короче без падения качества.

Мое понимание: цена — это не маркетинговый трюк. Это результат архитектуры, построенной для поддержания низких вычислений на токен, плюс готовность передать это в коэффициент цены. Если вы любопытны по поводу технических заметок, начните с официальной документации DeepSeek и любых связанных статей из карточек их моделей.

Шаблон калькулятора затрат

Я больше не блокирую бюджеты на точные центы. Я планирую диапазоны, а затем корректирую, когда реальное использование стабилизируется. Вот шаблон, который я использовал для DeepSeek V4. Он простой ровно настолько, чтобы его можно было пересоздать в электронной таблице.

Входные данные, которые вы будете заполнять для каждой рабочей нагрузки:

- Вызовы в день (или за пакет)

- Среднее входящее токены на вызов

- Среднее выходящие токены на вызов

- Входящая ставка за 1M токенов (от вашего поставщика)

- Выходящая ставка за 1M токенов (от вашего поставщика)

- Кэшируемые токены префикса на вызов (0 если их нет)

- Скидка при попадании в кэш (например, 0,90 при скидке 90%)

- Множитель вне пиковых часов (например, 0,25 при скидке 75%, иначе 1)

Шаги:

-

Разделите кэшируемые и некэшируемые входящие токены.

- cacheable_input = cacheable_prefix_tokens

- variable_input = max(avg_input_tokens - cacheable_prefix_tokens, 0)

-

Установите цену кэшируемой части по сниженной ставке.

- cacheable_cost = (cacheable_input / 1,000,000) × input_rate × (1 − cache_hit_discount)

-

Установите цену переменного входящего по полной входящей ставке.

- variable_input_cost = (variable_input / 1,000,000) × input_rate

-

Установите цену выходящего по выходящей ставке.

- output_cost = (avg_output_tokens / 1,000,000) × output_rate

-

Сложите их за вызов, а затем примените любой множитель вне пиковых часов.

- raw_cost_per_call = cacheable_cost + variable_input_cost + output_cost

- cost_per_call = raw_cost_per_call × off_peak_multiplier

-

Масштабируйте по объему.

- daily_cost = cost_per_call × calls_per_day

- monthly_cost ≈ daily_cost × 30

Небольшой реальный пример из моей недели тестирования (23–30 января 2026 г.):

- 120 вызовов/день

- 3200 входящих токенов/вызов, из них 1800 — фиксированный, кэшируемый префикс

- 1100 выходящих токенов/вызов

- Примеры ставок: $0,40 за 1M входящего, $1,60 за 1M выходящего (замените на ваши фактические)

- Скидка при попадании в кэш: 90%

- Множитель вне пиковых часов: 0,5 (окно скидки 50%, использованное через перепродавца)

Расчет (округленный):

- Стоимость кэша за вызов = (1800/1,000,000) × $0,40 × (1 − 0,90) ≈ $0,0000072

- Стоимость переменного входящего за вызов = (1400/1,000,000) × $0,40 ≈ $0,00056

- Стоимость выходящего за вызов = (1100/1,000,000) × $1,60 ≈ $0,00176

- Необработанная стоимость за вызов ≈ $0,0023272

- Корректировка вне пиковых часов ≈ $0,0011636

- Ежедневно ≈ $0,14

- Ежемесячно ≈ $4,20

Это не опечатка. Низкие ставки за миллион плюс кэширование и время вне пиковых часов превратили услугу “следи за счетчиком” в то, что я могу забыть. Сначала это не сэкономило время, я потратил час, чтобы сделать кэшируемый префикс действительно фиксированным, но каждый вызов после этого стал дешевле.

Несколько ограждений, которые я держу в листе:

- Установите жесткие ограничения на max_tokens. Раздувание выходящего — это тихий убийца бюджета.

- Отслеживайте повторы отдельно. Повторы — это реальные затраты.

- Логируйте средние токены еженедельно. Дрейф токенов происходит по мере развития подсказок.

Кому это подходит:

- Команды, запускающие много маленьких, похожих вызовов (ETL, резюме, QA).

- Создатели с пакетными работами, которые могут переместиться в окно вне пиковых часов.

Кому это может не понравиться:

- Приложения, которые нуждаются в длинных, потоковых выходных данных весь день, в пиковое время. Сбережения сужаются.

- Установки без поддержки кэширования. Вы все равно будете платить низкие ставки, но не такие смешно низкие.

Если вы хотите отправную точку, пересоздайте шаблон выше в инструменте по вашему выбору. Это 10 минут настройки и экономит часы гадания позже.

Последняя заметка: если вы смешиваете поставщиков, нормализируйте все на “стоимость за 1K токенов” в вашем листе. Это облегчает быстрые сравнения рядом, когда вы решаете, сохранить ли V4 в цикле или переключить задачу на передовую модель по причинам качества.

Я все еще слежу за тем, как смещаются окна вне пиковых часов. В последнее время они сместились ранее вечером. Не проблема для пакетных работ, просто то, на что я слежу.