Demo Online do TranslateGemma + Guia de Início Rápido

Olá, eu sou a Dora. Você já ouviu falar de “TranslateGemma”?

O impulso para isso foi pequeno: um cliente enviou conteúdo com inglês e espanhol misturados, além de alguns placeholders sorrateiros, e eu não queria ficar supervisionando um modelo de tradução linha por linha. Você sabe como é: um passo em falso e os placeholders desabam. Continuei vendo “TranslateGemma” aparecer em threads, então experimentei, não porque fosse novo, mas porque queria uma forma mais tranquila de obter traduções fiéis sem estragar a formatação. Spoiler: funcionou bem na maioria das vezes. Testei em janeiro de 2026 em alguns demos online e em uma configuração local. Aqui está o que realmente ajudou, onde teve dificuldades e como acabei estruturando os prompts para mantê-lo estável.

Teste TranslateGemma Online (Sem Configuração)

Eu não gosto de instalar coisas apenas para ver se são úteis. Então comecei com TranslateGemma online. Se você procurar “TranslateGemma online”, encontrará vários playgrounds hospedados: Hugging Face Spaces, demos do Replicate e algumas UIs web leves que envolvem checkpoints baseados em Gemma ajustados para tradução. Alguns precisam de login gratuito: alguns não. De qualquer forma, você geralmente pode colar texto e selecionar idiomas.

O que me surpreendeu: a velocidade foi boa mesmo em demos compartilhados. Parágrafos curtos retornaram em um ou dois segundos: páginas mais longas levaram um pouco mais, mas não o suficiente para me levar a tomar café. Continuei olhando para a tela de qualquer forma. Velho hábito, suponho. A diferença maior não era a velocidade, era como eu estruturava o prompt.

Um simples “Traduzir para Francês” funcionava, mas os outputs derivavam quando o texto misturava tons, continha código inline ou usava variáveis como {{first_name}}. A solução foi um conjunto de instruções curto e explícito. Quando o demo expunha um campo “system prompt”, eu o usava. Quando não, eu colocava a instrução no topo da mensagem do usuário.

Aqui está o prompt mínimo que consistentemente reduziu a limpeza para mim:

- Nomeie os idiomas de origem e destino.

- Diga ao modelo o que manter inalterado (placeholders, blocos de código, tags).

- Cerque o texto para que o modelo saiba onde começa e termina.

- Peça tradução pura sem comentários.

Exemplo que usei online:

Exemplo que usei online:

Traduza o seguinte de inglês para espanhol. Mantenha placeholders como {{first_name}}, {{price}} e tags HTML inalterados. Preserve quebras de linha e pontuação. Retorne apenas o texto traduzido, nada mais.

<

Assunto: Bem-vindo, {{first_name}}.

Seu total é {{price}}.

Clique <a href="/start">aqui</a> para começar.

>>>Isso não economizou tempo na primeira vez. Após duas execuções, economizou, principalmente porque parei de corrigir placeholders quebrados. Se você está apenas fazendo uma verificação rápida do TranslateGemma online, tente uma passagem curta com e sem essa estrutura. A diferença aparece rapidamente.

Formato de Template de Chat Que Você Deve Seguir

Modelos de chat estilo Gemma respondem melhor quando você respeita marcadores de turno. Algumas UIs os adicionam para você. Outras esperam texto bruto. Se você estiver enviando prompts diretamente (API, Python ou uma UI barebone), um template claro e repetível ajuda.

Modelos de chat estilo Gemma respondem melhor quando você respeita marcadores de turno. Algumas UIs os adicionam para você. Outras esperam texto bruto. Se você estiver enviando prompts diretamente (API, Python ou uma UI barebone), um template claro e repetível ajuda.

Dois padrões confiáveis funcionaram para mim:

1. Template de texto simples (funciona na maioria dos demos web)

Você é um assistente de tradução preciso.

- Idioma de origem: inglês

- Idioma de destino: espanhol

- Mantenha placeholders como {{...}}, backticks markdown e tags HTML inalterados.

- Preserve pontuação e quebras de linha. Não adicione explicações.

Texto para traduzir:

<

[COLE SEU TEXTO]

>>>2. Estilo de turno de chat Gemma (útil em bibliotecas que expõem o template de chat)

<start_of_turn>user

Você é um assistente de tradução preciso.

Origem: inglês

Destino: espanhol

Regras: mantenha {{placeholders}}, blocos de código e HTML intactos: preserve quebras de linha: saída apenas a tradução.

Texto:

<

[COLE SEU TEXTO]

>>>

<end_of_turn>

<start_of_turn>modelEu não esperava que os marcadores de turno importassem tanto, mas importam. Sem eles, vi mais “paráfrases” úteis (o modelo tentando melhorar a redação). Com eles e com entrada cercada, o modelo ficou mais próximo da atribuição.

Pequenos detalhes que fizeram uma grande diferença:

- Nomeie os idiomas explicitamente. “De inglês para espanhol” funcionou melhor que “Traduzir para espanhol”.

- Coloque as regras antes do texto. Se você deixar as regras após o texto, elas são mais fáceis de ignorar.

- Cerque o texto com um início/parada distinto (

<<<e>>>ou backticks triplos). Isso reduziu o corte acidental no início ou no fim.

Execute TranslateGemma Localmente (Python)

Gosto de ter um fallback local para trabalhos mais longos ou rascunhos sensíveis. Chame-me de paranóico, mas às vezes a nuvem apenas se sente muito… comunicativa. Na minha máquina (32 GB RAM, GPU de consumo), um checkpoint de tradução menor baseado em Gemma funcionava confortavelmente: os maiores precisavam de mais VRAM ou quantização. Se você for apenas CPU, é lento mas viável com configurações cuidadosas.

Gosto de ter um fallback local para trabalhos mais longos ou rascunhos sensíveis. Chame-me de paranóico, mas às vezes a nuvem apenas se sente muito… comunicativa. Na minha máquina (32 GB RAM, GPU de consumo), um checkpoint de tradução menor baseado em Gemma funcionava confortavelmente: os maiores precisavam de mais VRAM ou quantização. Se você for apenas CPU, é lento mas viável com configurações cuidadosas.

Aqui está um padrão simples com Hugging Face Transformers. Mantive o model_id genérico de propósito, escolha um modelo de tradução Gemma ou derivado de Gemma em que você confie no Hub, idealmente um documentado para tradução. O template abaixo espelha os prompts online.

# Testado em janeiro de 2026 com transformers >= 4.40

from transformers import AutoTokenizer, AutoModelForCausalLM, TextStreamer

import torch

model_id = "<seu-checkpoint-de-traducao-gemma>" # ex., um modelo chat Gemma ou ajustado para tradução

device = "cuda" if torch.cuda.is_available() else "cpu"

dtype = torch.float16 if device == "cuda" else torch.float32

# Carregar

tokenizer = AutoTokenizer.from_pretrained(model_id, use_fast=True)

model = AutoModelForCausalLM.from_pretrained(

model_id,

torch_dtype=dtype,

device_map="auto" if device == "cuda" else None

)

# Template de prompt (texto simples). Troque por turnos de chat se seu modelo exigir.

prompt = (

"Você é um assistente de tradução preciso.\n"

"Idioma de origem: inglês\n"

"Idioma de destino: espanhol\n"

"Regras: mantenha placeholders como {{...}}, blocos de código e tags HTML inalterados: "

"preserve pontuação e quebras de linha: saída apenas a tradução.\n\n"

"Texto:\n<<<\n"

"Assunto: Bem-vindo, {{first_name}}.\nSeu total é {{price}}.\n"

"<p>Clique <a href=\"/start\">aqui</a> para começar.</p>\n"

">>>\n"

)

inputs = tokenizer(prompt, return_tensors="pt").to(model.device)

gen = model.generate(

**inputs,

max_new_tokens=300,

temperature=0.3,

top_p=0.9,

repetition_penalty=1.02,

do_sample=True,

eos_token_id=tokenizer.eos_token_id,

)

output = tokenizer.decode(gen[0][inputs["input_ids"].shape[1]:], skip_special_tokens=True)

print(output)Algumas notas do teste

- Se seu checkpoint inclui um template de chat, use a utilidade

apply_chat_template()da biblioteca em vez de strings manuais. Reduz comportamentos estranhos pela metade. - Para inputs longos, defina

max_new_tokensalto o suficiente e mantenhatemperaturebaixa (0,2–0,4). Amostragem mais quente convidou “melhorias”. Algumas úteis, algumas… não tanto. - Quantização ajuda em GPUs menores. 4-bit (bitsandbytes) se manteve bem para tradução direta.

- Se você precisar de tradução em lote, envolva o prompt em uma pequena função e transmita linhas. Descobri que chunking por parágrafo era mais seguro do que blocos gigantes, menos chance de perder estrutura.

Precisa executar workloads de tradução sem gerenciar infraestrutura de GPU ou configurações locais?

Construímos WaveSpeed para que nosso time possa chamar modelos via uma API unificada e lidar com tarefas em lote sem girar servidores ou lutar contra drivers → Tente!

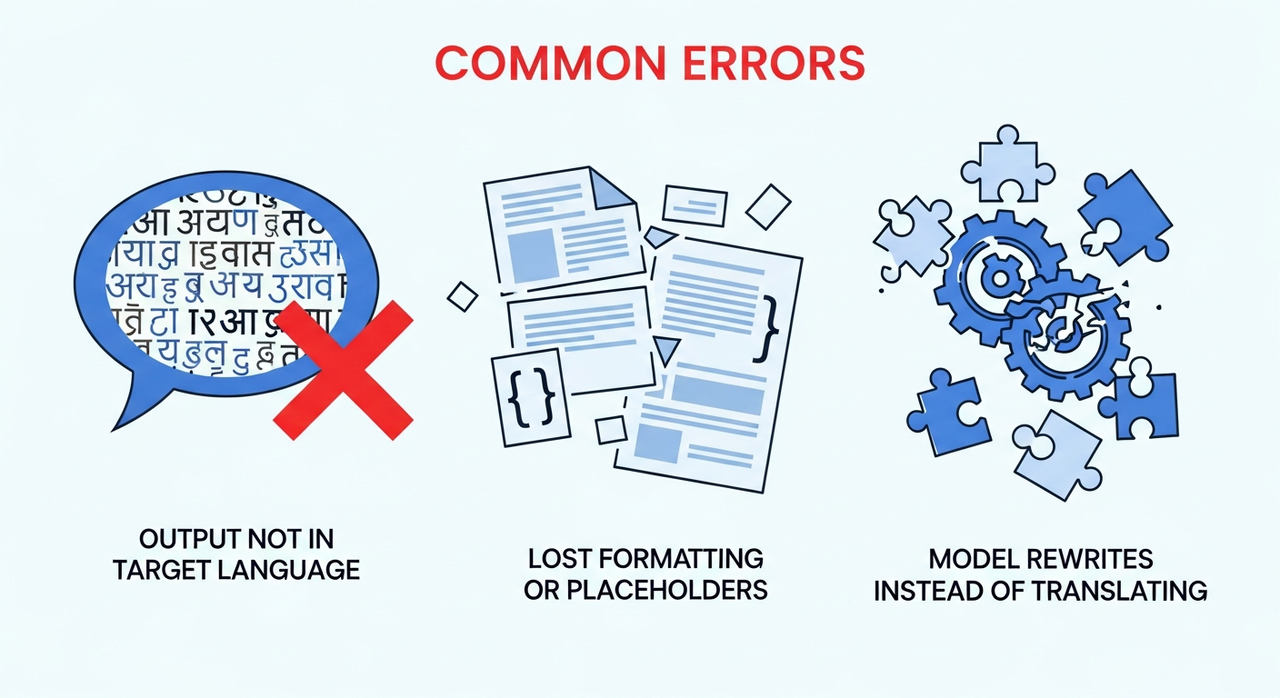

Erros Comuns e Correções

Estes foram os padrões que encontrei mais enquanto testava TranslateGemma online e localmente, mais o que realmente reduziu o atrito para mim.

Estes foram os padrões que encontrei mais enquanto testava TranslateGemma online e localmente, mais o que realmente reduziu o atrito para mim.

Saída Não no Idioma de Destino

Vi isso principalmente quando não declarei o idioma de origem. Inputs de idioma misto confundiram o suficiente para manter frases em inglês por perto. Correções que funcionaram:

- Nomeie ambos os idiomas: “Traduzir de inglês para espanhol.” Não dependa da detecção quando a precisão importa.

- Abaixe a temperatura (0,2–0,4) e use um leve

repetition_penalty(cerca de 1,02). Afastou o modelo de reescritas criativas. - Adicione uma linha de guarda final: “Se o texto já está em espanhol, retorne-o inalterado.” Isso reduziu a tradução excessiva em snippets bilíngues.

Formatação ou Placeholders Perdidos

Este foi o grande problema com emails de marketing e strings de produtos. As primeiras execuções quebraram {{variables}} ou reordenaram HTML. O que ajudou:

- Seja explícito: “Mantenha placeholders como

{{...}}e tags HTML inalterados. Não traduza dentro de cercas de código.” - Cerque a entrada e preserve quebras de linha. O padrão

<<<e>>>funcionou melhor que depender de linhas em branco. - Para conteúdo frágil, cerque placeholders com marcadores no prompt: “Placeholders são protegidos com chaves duplas como

{{isso}}. Não as altere.” Se um demo continuasse soltando chaves, eu as substituía temporariamente por{{com[[[e}}com]]]antes da tradução, então trocava de volta. Não é elegante, mas é mais seguro para jobs em lote.

Modelo Reescreve em Vez de Traduzir

Às vezes a saída parecia uma reescrita do editor, não uma tradução. Útil em alguns contextos, chato na maioria. Minhas correções práticas:

- Declare o papel e a restrição no topo: “Você é um assistente de tradução. Saída apenas uma tradução fiel. Sem resumos, sem explicações.”

- Abaixe a temperatura e evite longos

max_new_tokensem inputs curtos: espaço extra encorajou comentários em alguns checkpoints. - Se o modelo ainda se embeleza, tente o template de turno de chat com parada clara. No código local, defina sequências de parada para seus marcadores de turno (ex.,

<end_of_turn>). Em demos hospedados sem suporte de parada, adicionar “Retorne apenas o texto traduzido” reduziu fluff cerca de 80% das vezes.

Uma nota mais tranquila: alguns checkpoints da comunidade rotulados para tradução são na verdade modelos gerais ajustados por instruções. Eles vão traduzir, mas são mais comunicativos. Se você estiver atingindo todos os três problemas de uma vez, tente um checkpoint diferente ou um menor, mais rigoroso. Menos inteligente geralmente significa mais fiel nesta área. E honestamente, era tudo que eu precisava.

Você já tentou TranslateGemma? Qual é seu prompt preferido para manter placeholders intactos, ou o texto mais difícil que o confundiu? Compartilhe seus sucessos, falhas ou truques favoritos abaixo!