Como o Freepik dimensionou a geração de mídia FLUX para milhões de requisições por dia com DataCrunch e WaveSpeed

Como a Freepik dimensionou a geração de mídia FLUX para milhões de requisições por dia com DataCrunch e WaveSpeed

Resumo

A Freepik tem trabalhado com a DataCrunch desde o início de 2024 para integrar geração de mídia de última geração em sua Suite de IA e dimensionar para além de milhões de requisições de inferência por dia. A DataCrunch forneceu à Freepik sua infraestrutura GPU de ponta e serviços de inferência gerenciados, entregando as seguintes capacidades:

- Orquestração de GPU gerenciada

- Dimensionamento elástico e inicializações a frio quase zero

- Entrega de modelo de alta velocidade com WaveSpeed

- Contato direto para suporte especializado e colaboração estratégica Os clientes da Freepik geram mais de 60 milhões de imagens por mês, com uma parcela significativa dessas requisições tornada possível pela infraestrutura e serviços da DataCrunch.

1. Perfil do Cliente

A Freepik é uma suite criativa líder alimentada por IA que combina ferramentas avançadas de IA generativa com mais de 250 milhões de ativos de estoque curados para simplificar a criação de conteúdo de alta qualidade.

No início de 2024, a Freepik redefiniu seu modelo de negócios para alavancar IA generativa na criação de conteúdo de mídia de alta qualidade. A Freepik iniciou sua jornada na geração de imagens com modelos como Stable Diffusion XL e endpoints experimentais. Entrando em 2025, a Freepik refinou sua abordagem para adotar modelos como FLUX e dimensionar para infraestrutura de grau de produção, ao mesmo tempo em que acomoda uma base de usuários em rápido crescimento.

A Suite de IA da Freepik apresenta um Gerador de Imagem de IA, que utiliza modelos como FLUX para produzir imagens fotorrealistas a partir de prompts de texto (T2I) ou imagens (I2I), e um Gerador de Vídeo de IA, alimentado por modelos como Google DeepMind Veo 2, para criar vídeos a partir de texto ou imagens. Esses recursos foram projetados para ser intuitivos, ao mesmo tempo em que priorizam personalização de estilo e fluxos de trabalho guiados.

A Suite de IA da Freepik desfrutou de mais de:

- 80 milhões de visitantes por mês

- 600 mil usuários inscritos

- 60 milhões de imagens geradas por mês

Uma parcela significativa dessas requisições de inferência envolve a suite de modelos FLUX com os endpoints de inferência gerenciados pela DataCrunch e utilizando o mecanismo de inferência da WaveSpeed:

- FLUX Dev

- FLUX Tools (por exemplo, inpainting)

2. Geração de Mídia Eficiente em Custos: FLUX Dev

2.1. Desafios Iniciais

Dimensionar infraestrutura raramente é uma tarefa fácil. Dimensionar infraestrutura enquanto acomoda uma base de usuários crescendo exponencialmente, atende a picos de uso diário e otimiza para custo e velocidade de inferência é praticamente impossível. Conforme a Freepik se propôs a construir um produto de classe mundial e experiência do cliente, sua infraestrutura de geração de imagens tinha que estar na fronteira do desempenho enquanto atende aos seguintes requisitos:

- Sustentar latência abaixo da faixa de 2-6 segundos (p50)

- Otimizar para throughput/$ (imagem por hora por computação)

- Evitar qualquer regressão de qualidade perceptível comparado à linha de base oficial não otimizada

Para atender a esses requisitos, a Freepik deve operar na vanguarda da eficiência, pois até mesmo frações de centavos e utilização de GPU mais otimizada por geração se traduziriam em economias de custo significativas nessa escala.

2.2. Abordagem Técnica

Ao trabalhar com a DataCrunch na construção e dimensionamento de sua infraestrutura de inferência, a Freepik pode focar todos os seus esforços em melhorar a qualidade do produto e oferecer uma experiência de usuário de classe mundial. A DataCrunch também permitiu que a Freepik se adaptasse aos avanços rápidos na geração de imagens. A DataCrunch forneceu comunicação direta contínua entre seus engenheiros e a Freepik, permitindo colaboração rápida e ajustes. Essa comunicação direta foi necessária para suportar a escala e o crescimento que a Freepik experimentou, e para remover qualquer atraso ou possibilidade de falta de comunicação.

“Ter contato direto entre nossas equipes de engenharia nos permite nos mover incrivelmente rápido. Ser capaz de implantar qualquer modelo em escala é exatamente o que precisamos nesta indústria em rápida mudança. A DataCrunch nos permite implantar modelos personalizados de forma rápida e sem esforço.” – Iván de Prado, Head of AI na Freepik

Como resultado, a Freepik se beneficiou de um entrega de modelo eficiente em custos em sua Suite de IA, ao mesmo tempo em que alcançou o throughput/$ e latência alvo. Nossos esforços na DataCrunch foram direcionados para evitar a armadilha de “velocidade de inferência a qualquer custo”, que geralmente vem com compensações como degradação de saída e dimensionamento instável. Para realizar isso, realizamos pesquisa aprofundada em otimizações lossless que preservam as capacidades do modelo, seguidas por avaliação rigorosa:

- Avaliação Multi-Métrica: Usando a combinação de DreamSim, FID, CLIP, ImageReward, e Aesthetic

- Avaliação Humana: A Freepik realizou avaliação extensiva via arenas A/B, comparando contra a linha de base e outros provedores de inferência.

- Diversidade de Prompts: Avaliado categorias diversas de prompts focando em objetos, cenas e conceitos abstratos.

A partir de 2025, a pesquisa de co-design HW-SW da DataCrunch-WaveSpeed nos permitiu empurrar ainda mais a eficiência máxima prática de inferência oferecida à Freepik enquanto utiliza os pontos fortes principais de cada organização:

- A Infraestrutura de GPU da DataCrunch e Serverless Containers com auto-scaling em cluster Kubernetes interno, networking de alto throughput e armazenamento de objetos de baixa latência.

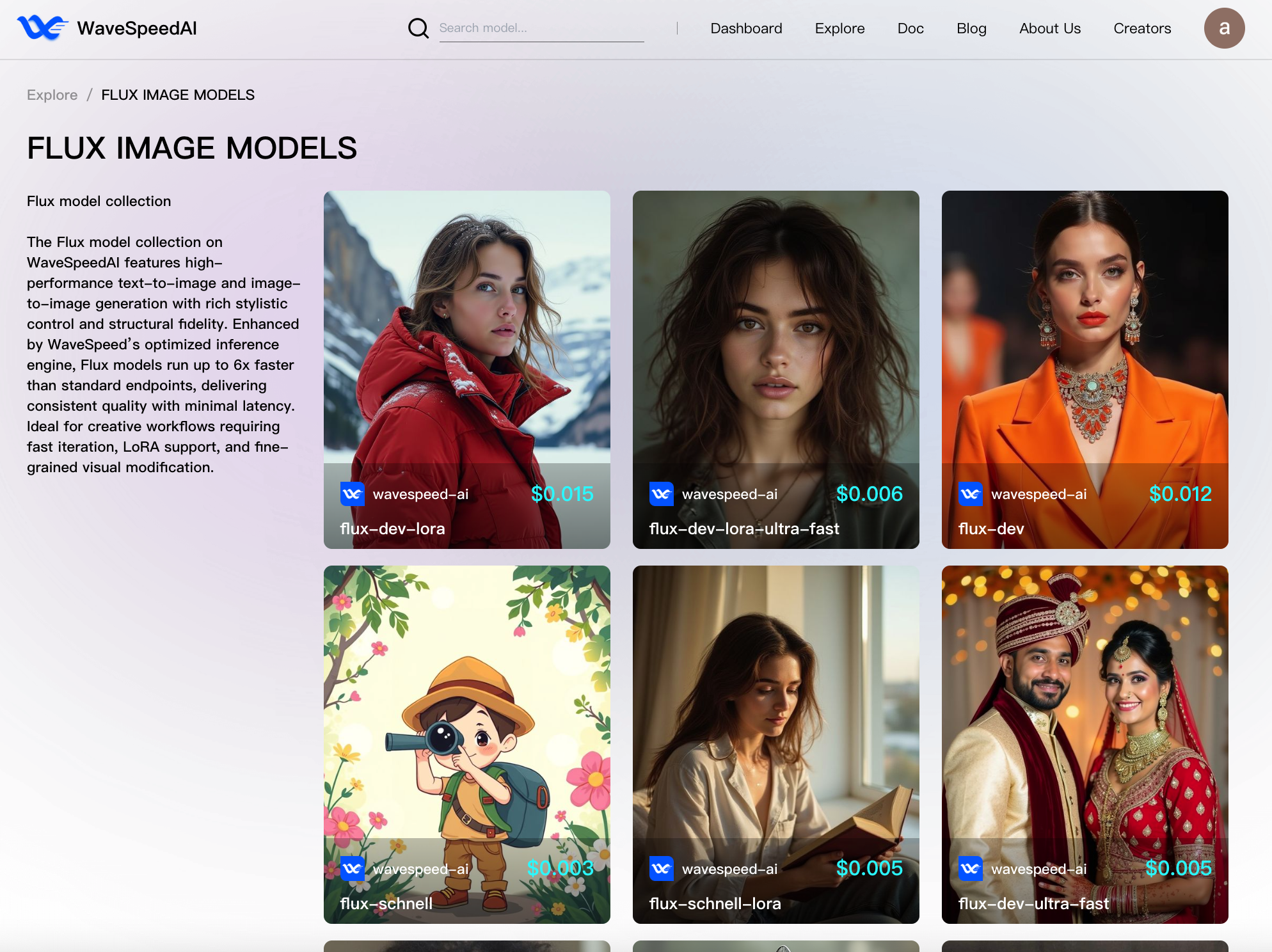

- O Mecanismo de Inferência WaveSpeed com compilador de ML interno, kernels CUDA customizados e fundidos, quantização lossless avançada, caching de ativação DiT (por exemplo, AdaCache), e servidores de inferência leves com overhead negligenciável.

3. Benchmarking de Inferência: Metodologia & Resultados

Métricas-chave: Tempo médio de inferência e latência (p99), custo por geração e throughput por hora.

Todos os resultados a seguir foram alcançados com um tamanho de mundo de 1 dispositivo. Otimizar cada endpoint para eficiência nos permitiu alocar dinamicamente recursos disponíveis com base no tráfego da Freepik em um determinado momento e requisitos (por exemplo, camadas de usuário).

| Endpoint | Parâmetros de Entrada | Tempo de inferência GPU (seg) | throughput por GPU/h |

|---|---|---|---|

| flux-dev | Size = 1024x1024, steps = 28, optional cache = 0.1 | 4.4 | 818.2 |

| flux-dev-fast | Size = 1024x1024, steps = 28, optional cache = None | 3.3 | 1091 |

| flux-dev-fast | Size = 1024x1024, steps = 28, optional cache = 0.1 | 2.2 | 1636 |

| flux-dev-fast | Size = 1024x1024, steps = 28, optional cache = None | 1.64 | 2184 |

| flux-dev-ultra | Size = 1024x1024, steps = 28, optional cache = None | 1.648 | 2184 |

| flux-dev-ultra | Size = 1024x1024, steps = 28, optional cache = 0.1 | 1.045 | 3445 |

| flux-dev-ultra | Size = 1024x1024, steps = 28, optional cache = 0.16 | 0.768 | 4688 |

4. Solução Técnica: Infraestrutura de GPU de Grau de Produção

A infraestrutura de GPU da DataCrunch fornece uma base de grau de produção para sistemas grandes de IA generativa, com o mecanismo de otimização WaveSpeed empurrando ainda mais o envelope da eficiência.

- Orquestração de GPU Gerenciada: O gerenciamento de recursos GPU de granularidade fina é entregue via cluster Kubernetes interno, permitindo que o WaveSpeed controle a alocação de recursos para inferência sem se preocupar com gerenciamento de infraestrutura ou se aprofundar em Infrastructure-as-Code.

- Dimensionamento Elástico: Os Serverless Containers foram customizados para auto-scale de zero para mais de 500 instâncias de GPU com base no número de requisições recebidas. Essa capacidade é crucial para absorver os picos diários de tráfego sem enfileiração ou queda de requisições, bem como dimensionar para zero quando ocioso para evitar custos desnecessários.

- Inicializações a Frio Quase Zero: A latência de cold-start foi significativamente reduzida através de pré-aquecimento de compilações, tempos mais rápidos de pulling de imagem e caching de container, aproximando o verdadeiro desempenho lambda para cargas de trabalho de GPU.

- Entrega de Modelo de Alta Velocidade: Armazenamento otimizado e fabrics de rede reduziram significativamente o tempo gasto carregando os pesos do modelo e pulling das imagens Docker. Isso é especialmente crucial para as implantações de LoRA FLUX, pois os pesos de LoRA precisam ser armazenados em cache e movidos para cada instância de GPU. Além disso, o Sistema de Arquivos Compartilhado da DataCrunch aumenta ainda mais a velocidade de entrega de modelo e reduz os overheads de transferência de dados ao permitir que múltiplas instâncias leiam e escrevam para o mesmo repositório de arquivo centralizado.

5. Resultados de Negócios: Economias de Custo & Vantagens Estratégicas

DataCrunch, trabalhando em conjunto com WaveSpeed, permitiu que a Freepik dimensionasse a geração de imagens com os modelos FLUX Dev enquanto minimizava custos de inferência. Além das economias de custo direto, a parceria estratégica permitiu que uma grande fração dos usuários da Freepik acessasse os modelos FLUX com cotas de geração mais altas. A equipe da DataCrunch avaliou rigorosamente e garantiu a qualidade de saída enquanto aproveitava infraestrutura de computação heterogênea aplicando otimizações cientes de HW. Um dos principais aprendizados foi que a inferência sustentável e escalável requer uma compreensão dos sistemas de ML de diferentes perspectivas:

- Otimizações cientes de GPU (por exemplo, kernels CUDA customizados B200)

- Testes e avaliação rigorosos

- Integração de infraestrutura (ou seja, auto-scaling, cold starts zero, tuning de rede) Conforme a Freepik visa tráfego mais alto e volumes de inferência com seu novo plano enterprise, a DataCrunch continuará a aplicar essa abordagem bem-sucedida para alcançar desempenho de dimensionamento contínuo.

6. Previsões Futuras: O Que Vem Depois para Geração de Mídia

A geração de imagem a partir de prompts de texto ou condicionamento de imagem tornou-se insuficiente para atender à demanda crescente de capacidades de controle e edição em ambientes profissionais, como usado por artistas digitais e agências de publicidade. Com o lançamento do FLUX, Black Forest Labs deu um salto gigantesco na qualidade da geração de imagem. Esperamos que FLUX.1 Kontext [dev] crie um ponto de inflexão similar para edição de imagem, com suas taxas de adoção excedendo as do modelo FLUX. As histórias, como geração de imagem OpenAI 4o, confirmam que há alta demanda por modelos com um alto grau de steerability, fácil condicionamento com imagens de entrada, consistência de personagem e forte aderência de prompt. Com o lançamento de FLUX.1 Kontext [max] e [pro], Black Forest Labs demonstraram que são capazes de reproduzir tais capacidades enquanto sendo mais eficientes em custos. Olhando para frente, a DataCrunch planeja ir além da geração de imagem e em direção a fluxos de trabalho de ponta a ponta. Projetos contínuos de pesquisa e desenvolvimento têm se focado em:

- Integração escalável e eficiente em custos de geração de vídeo SOTA com modelos como Alibaba WAN 2.1 e VACE

- Modelos de upscaling de imagem e vídeo

- Reduzir a complexidade de construir produtos de mídia agentic

- Lançar endpoints de inferência FLUX Dev (modelo base, LoRA, tools) na Plataforma Cloud da DataCrunch – fique ligado

Experimente FLUX Dev e mais modelos agora!

🔗FLUX-dev

🔗FLUX-dev-ultra-fast

🔗FLUX-dev-lora

🔗Coleção de modelos FLUX

🔗Wan-2.1-14b-vace

🔗Seedance 1.0