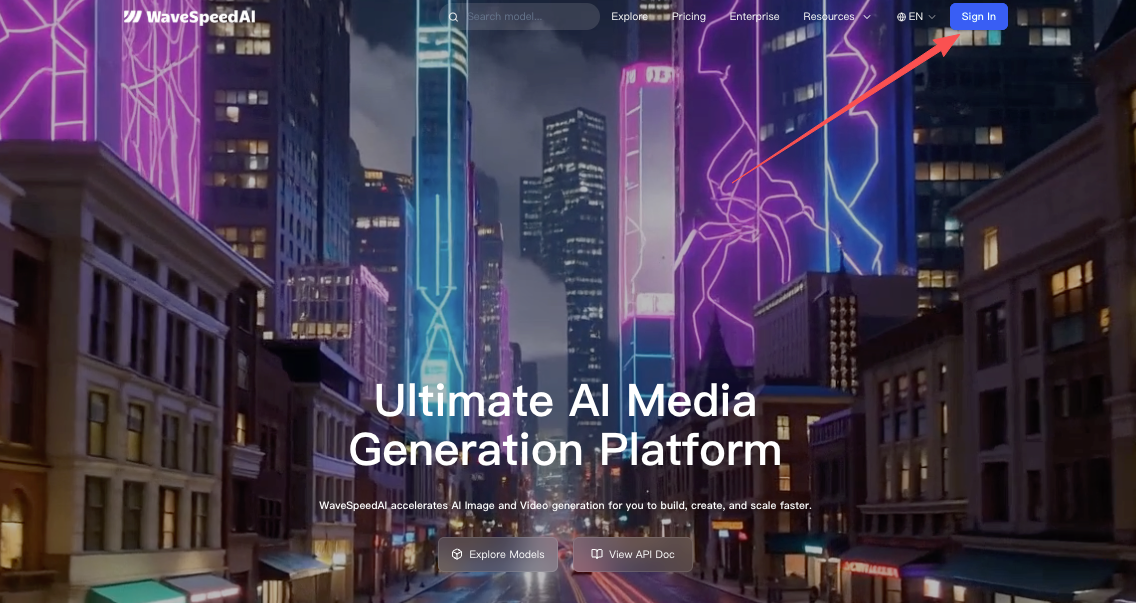

Acesse GLM-4.7-Flash via WaveSpeed API

Ei pessoal, sou a Dora. O impulso veio de um pequeno incômodo: mais um projeto, mais uma chave de API e outro SDK com suas próprias ideias sobre tokens e tentativas. Queria testar GLM-4.7-Flash porque as pessoas continuavam mencionando sua velocidade para rascunhos do dia a dia e pesquisas rápidas. Mas não queria refazer minha stack apenas para rodar alguns testes.

Então escolhi um caminho mais silencioso: acessar GLM-4.7-Flash via WaveSpeed API. Os mesmos padrões de cliente, uma chave, modelo alterado. Testei isso em alguns scripts em janeiro de 2026 e fiz anotações. Nada disso é dramático. Mas tornou meu dia a dia um pouco mais leve. E honestamente, esse é o padrão agora—mais leve vence mais alto.

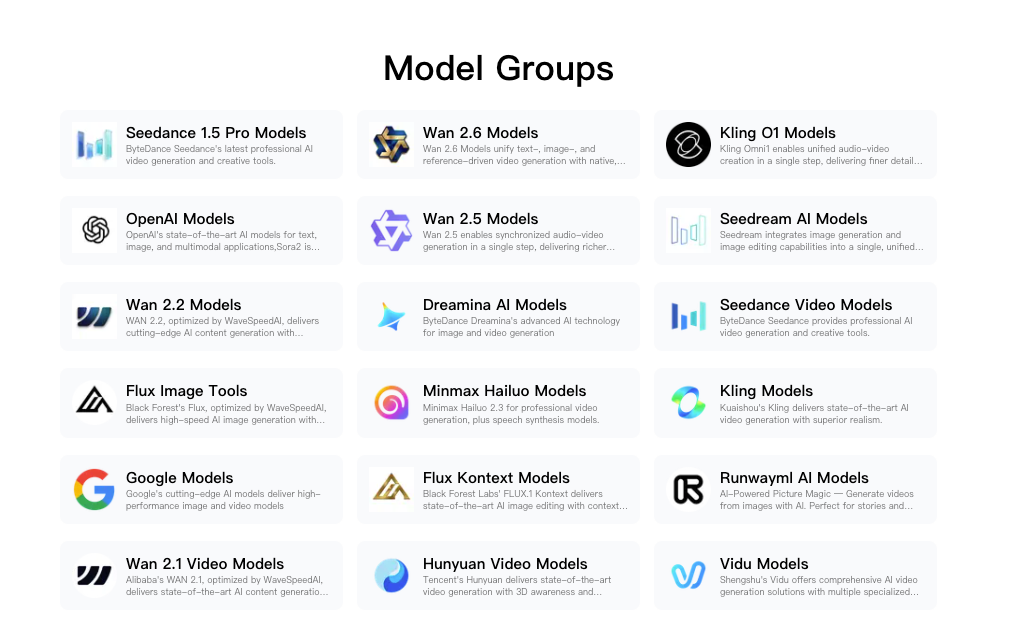

Por Que Usar WaveSpeed

Não vou fingir que WaveSpeed é mágica. É mais como uma gaveta confiável de adaptadores: não é emocionante, mas é a coisa em que você recorre quando quer continuar com seu trabalho.

O que importava para mim não era a contagem de modelos, era a falta de atrito. Eu podia apontar o mesmo código para diferentes modelos, trocar uma linha e seguir em frente. É isso, sem drama.

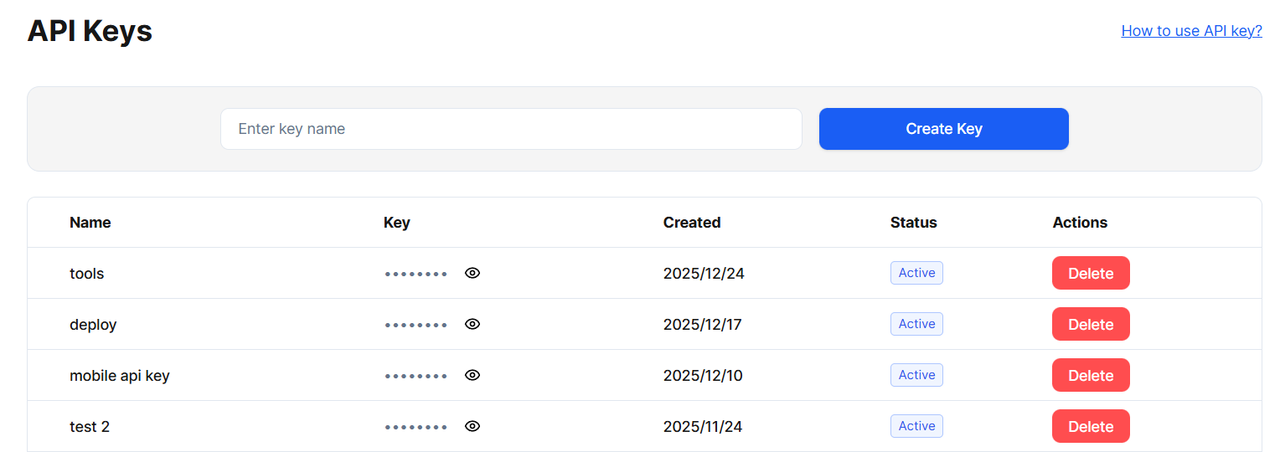

Uma Chave de API, 600+ Modelos

Minha verdadeira vitória foi mental. Não estou procurando através dos painéis de provedores para rotacionar chaves ou limitar gastos. Uma chave no meu gerenciador de segredos e posso rotear para GLM-4.7-Flash para rascunhos rápidos, depois pular para um modelo mais pesado quando um prompt precisa de mais profundidade. Ainda defino limites por projeto, mas o overhead cai.

Na prática: mantive minha variável de ambiente existente (WAVESPEED_API_KEY no meu caso) e apenas alterei o nome do modelo. Essa pequena decisão—manter nomes alinhados, não ser criativo—me salvou de quebrar o CI.

Sem Troca de SDK

Fiquei com o cliente compatível com OpenAI que já uso. Sem novos nomes de métodos, sem reaprender flags de streaming. Se você construiu pequenos utilitários em torno de conclusões de chat, streaming e chamadas de ferramentas, eles se transferem em sua maioria. Gosto que o WaveSpeed não me peça para adotar sua visão de mundo antes de retornar um token, se isso faz sentido.

Dois avisos que notei:

- Nomes de modelos variam entre provedores. Eu duplo-verifico o identificador exato na documentação oficial do WaveSpeed antes de confirmar o código.

- Recursos específicos do provedor (como formatos de resposta especiais ou peculiaridades de chamadas de função) ainda podem diferir. Mantenha um pequeno arquivo de adaptador onde você normaliza cargas. O meu tem 60 linhas e paga aluguel toda semana.

Código de Início Rápido

Usei os endpoints de estilo OpenAI que o WaveSpeed expõe. Se seu código já acessa uma Chat Completions API, isso deve parecer familiar. A única mudança real é a URL base e o nome do modelo.

Testei isso de 12 a 15 de janeiro de 2026 com pequenos prompts em lote. Prompts curtos começaram a fazer streaming em menos de um segundo na minha conexão. Obviamente, seus resultados variarão com a rede, tamanho do prompt e carga do servidor.

Exemplo de Substituição Imediata

Aqui está a forma que usei. Verifique a documentação oficial do WaveSpeed para o identificador de modelo mais recente (vi listado como glm-4.7-flash).

Node.js (fetch):

const resp = await fetch("https://api.wavespeed.ai/v1/chat/completions", {

method: "POST",

headers: {

"Content-Type": "application/json",

"Authorization": `Bearer ${process.env.WAVESPEED_API_KEY}`

},

body: JSON.stringify({

model: "glm-4.7-flash",

messages: [

{ role: "system", content: "You are a concise assistant." },

{ role: "user", content: "Summarize this link in 3 bullets: https://example.com/post" }

],

temperature: 0.3,

stream: true

})

});Python (requests):

import os, requests

url = "https://api.wavespeed.ai/v1/chat/completions"

headers = {

"Authorization": f"Bearer {os.environ['WAVESPEED_API_KEY']}",

"Content-Type": "application/json",

}

payload = {

"model": "glm-4.7-flash",

"messages": [

{"role": "system", "content": "You are a concise assistant."},

{"role": "user", "content": "Outline a 5-step plan to vet a research source."}

],

"temperature": 0.2

}

r = requests.post(url, headers=headers, json=payload, timeout=30)

r.raise_for_status()

print(r.json()["choices"][0]["message"]["content"])Pequenas observações que achei úteis:

- Se seu aplicativo faz streaming de tokens, mantenha o mesmo parsing de SSE: a flag de stream do WaveSpeed se comportou conforme esperado em meus testes.

- Defini o tempo limite por solicitação um pouco mais alto do que o usual quando não tenho certeza sobre a carga do modelo.

- Registre o nome do modelo nas respostas. O você do futuro agradecerá quando os outputs se desviarem e você precisar confirmar o que foi executado.

Combine com Outros Modelos

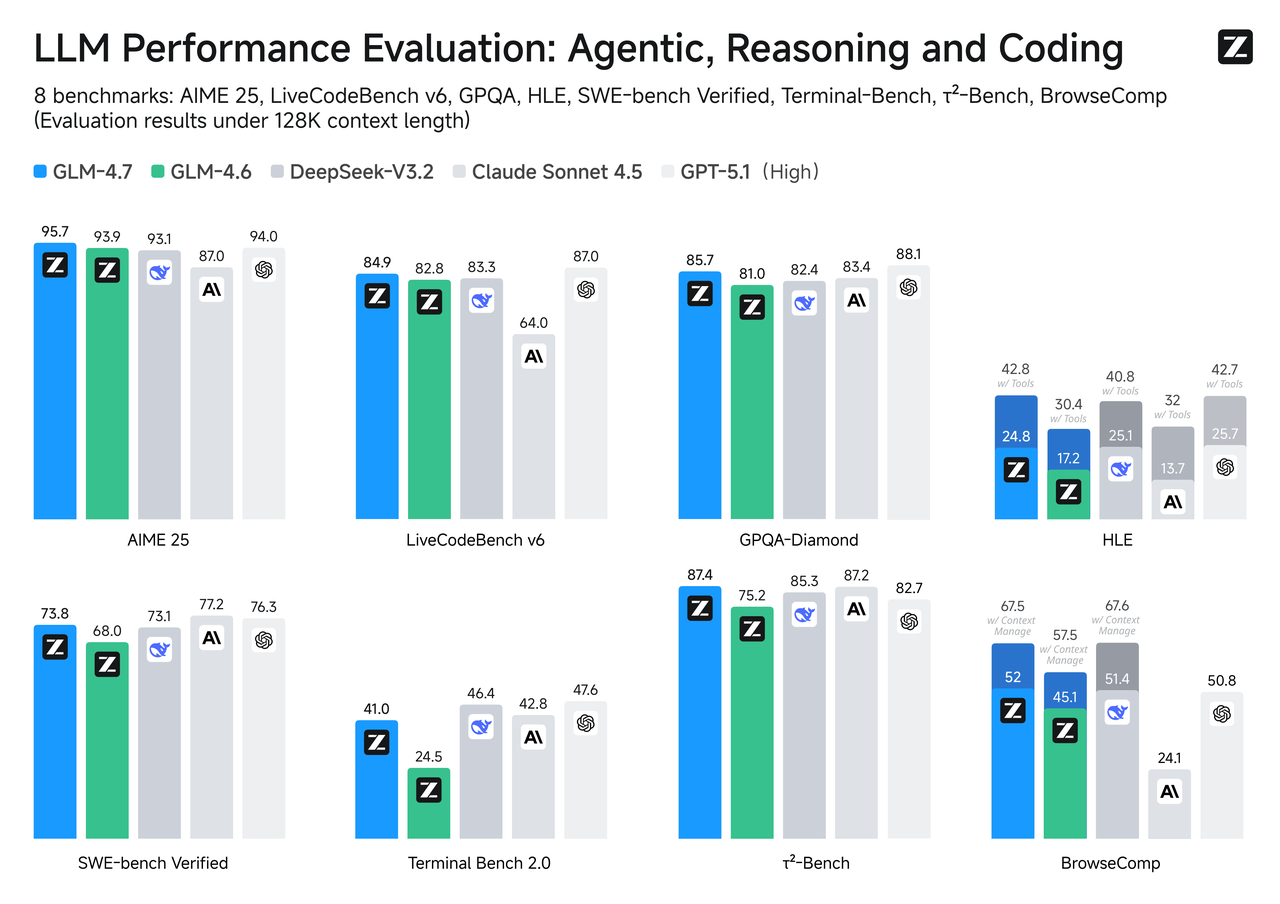

A maior parte do meu trabalho mistura modelos. GLM-4.7-Flash é rápido para primeiras passagens, rascunhos, resumos, respostas a perguntas básicas. Quando preciso de raciocínio mais pesado ou uma capacidade específica (como um intérprete de código forte ou um determinado recurso de visão), rotearei para outro lugar. WaveSpeed me permite manter esse roteamento em um só lugar.

O que me surpreendeu um pouco: esperava que trocar modelos no meio da execução se sentisse bagunçado. Não se sentiu. Os prompts mantinham a mesma forma, então eu podia comparar outputs sem contorcer o código.

Fluxo de Texto + Imagem

Tentei uma pequena rotina: coletar uma captura de tela de um relatório do usuário, executar OCR leve ou uma legenda de visão, depois pedir ao GLM-4.7-Flash para produzir um resumo de ação em linguagem simples.

Minhas etapas:

- Use um modelo capaz de visão para extrair texto/rótulos da imagem. Mantenha a saída compacta, pense em pares chave-valor ou pequenos pontos.

- Passe esse texto para GLM-4.7-Flash com um prompt de sistema estável (duas linhas) e peça um resumo curto com decisões.

- Se a imagem tiver tabelas, adiciono uma regra rápida: “Preserve números e unidades exatamente.” Isso reduziu o trabalho de limpeza depois.

Notas de campo:

- Em um PNG de 1,2MB com IU mista + texto, a passagem de visão levou ~2–4 segundos para mim: a sumarização GLM-4.7-Flash voltou em menos de um segundo. Essa divisão manteve o fluxo se sentindo ágil.

- O custo era previsível porque restringi a saída de visão a alguns centenas de tokens antes de repassá-la.

- Se você não precisar de nuance de visão, execute OCR básico primeiro (Tesseract ou uma API OCR paga), depois passe o texto para GLM-4.7-Flash. Mais barato, frequentemente bom o suficiente.

Fluxo de Texto + Vídeo

Vídeo é mais pesado, obviamente. Não enviei vídeo completo para nenhum modelo. Puxei a transcrição primeiro (whisper ou um ASR pago), depois rotei seções para GLM-4.7-Flash para rápida sumarização.

Um loop que funcionou:

- Transcreva o vídeo uma vez. Se conseguir, mantenha timestamps.

- Divida por turnos de orador ou segmentos de 3–5 minutos (o que for mais limpo).

- Peça ao GLM-4.7-Flash para resumos de segmento e decisões. Mantenha o prompt do sistema ancorado: “Você retorna apenas JSON estruturado com campos A/B/C.”

- Costure um esboço de nível superior dos segmentos com uma segunda passagem.

Na prática, GLM-4.7-Flash se sentiu certo para os resumos de segmento: rápido, sem atrito, precisão boa o suficiente para planejamento. Para o esboço final, às vezes troquei modelos por tom ou nuance. Mantive tudo dentro do WaveSpeed para que meu código não mudasse de forma.

Preços

Preços é onde eu desacelero. Não porque seja complicado, mas porque surpresas aparecem em logs, não em painéis.

GLM-4.7-Flash no WaveSpeed

A partir de janeiro de 2026, GLM-4.7-Flash está disponível através do WaveSpeed com sua própria taxa por token. Os números exatos podem mudar, então não vou fixá-los aqui. Verifico a página de preços oficial antes de enviar algo para produção e defino limites suaves na minha config de ambiente.

Como estimo:

- Amostra um prompt e resposta típicos. Multiplique pelo número de execuções diárias. Isso me leva aos tokens diários.

- Adicione 20–30% de espaço livre para dias ruins ou novos prompts.

- Compare isso com um modelo mais lento mas mais barato para a mesma tarefa. Se o modelo mais lento não aumentar o tempo de edição humana, pode vencer no geral.

Um truque prático: registre tokens por flag de feature. Ligo GLM-4.7-Flash para uma fatia de usuários e comparo tempo de edição e reclamações. Isso me diz mais do que uma tabela de preços.

Descontos por Volume

WaveSpeed oferece preços baseados em volume. Os níveis importam se você processa trabalhos em lote ou executa backfills de dados. Entrei em contato uma vez para confirmar limites antes de uma semana de pico: a resposta foi direta e me salvou de estrangular trabalho em janelas desconfortáveis.

Minha regra: se espero um pico 10x, campanha, migração ou sprint de pesquisa, envio um email ao suporte primeiro. O ponto não é um acordo especial: é um limite claro para que eu não cuide de trabalhos à noite, porque ninguém quer isso.

Construímos o WaveSpeed exatamente para esse tipo de fluxo de trabalho: menos chaves, menos trocas de SDK e menos tempo pensando em infraestrutura. Se você está malabarismo com modelos e apenas quer que eles se comportem atrás de uma única API previsível, esse é o problema que estamos tentando resolver.

➡️Você pode explorar aqui.

Agora é a sua vez: qual é o circo de chaves de API mais ridículo com que você já lidou ultimamente? Deixe nos comentários—vou ler todos enquanto tomo um café e me sinto um pouco menos sozinho.