Configurações de Treinamento LoRA WAN 2.2: Melhor Taxa de Aprendizado, Etapas e Palavras-Chave

Oi amigos. Vocês sabem? Gostei de como o WAN 2.2 lidam com pele e iluminação, mas meus hábitos usuais de treinamento LoRA não se traduziram bem. Os rostos ficavam muito brilhosos, e o modelo continuava puxando os planos de fundo para o mesmo visual macio de estúdio. Não estava “errado”, apenas não era o meu estilo. Então no início de janeiro de 2026, executei alguns experimentos curtos para encontrar configurações de treinamento LoRA específicas do WAN 2.2 que parecessem sensatas. Nada extravagante. Apenas o suficiente para reduzir o brilho plástico, manter um objeto estável e ainda deixar o modelo base respirar.

Se você procura um modelo rápido: este não é. Estou compartilhando o que se manteve firme em múltiplas execuções, onde hesitei e como ajustei. A palavra-chave alvo aqui é clara, configurações de treinamento LoRA do WAN 2.2, mas o objetivo é um trabalho mais calmo, não um novo coelho para perseguir.

Por que o LoRA do WAN é Diferente

Notei que o WAN 2.2 se comporta como um checkpoint SDXL muito opinativo: é ajustado para retratos nítidos, gradientes suaves e luz cinematográfica. Quando treinei LoRAs da forma que faço em bases SDXL mais simples, o WAN continuava empurrando meus resultados de volta para aquele visual de estúdio polido.

Notas de campo:

- A gravidade do prompt é forte. Mesmo pesos leves (0,4–0,6) puxam para pele limpa e enquadramento simétrico.

- O agrupamento de cores aparece cedo. Se seu conjunto de dados tende ao quente, o WAN o amplifica.

- Os planos de fundo se homogeneízam. Sem ajustes, ele padrão para profundidade de campo rasa e bokeh macio, não importa o que você alimentou.

O que mudou na prática: reduzi as taxas de aprendizado, usei mais imagens de regularização do que o usual e mantive as legendas propositalmente chatas. O WAN 2.2 recompensa a contenção. Quando tentei “ensinar” estilo e assunto ao mesmo tempo, o sobreajuste surgiu rapidamente.

Se você vem de hábitos LoRA do SD 1.5, pense: menos truques inteligentes, mais linhas de base controladas. Se você está acostumado com SDXL, vá um pouco mais devagar do que o normal e incorpore a regularização mais cedo.

Guia de Tamanho do Conjunto de Dados

Executei quatro passagens com conjuntos de retratos curados (5–12 de janeiro de 2026), cada uma com legendas arrumadas e iluminação mista. Aqui está o que se manteve firme:

- 8–12 imagens: O suficiente para ancorar uma silhueta específica de pessoa ou produto. Use regularização forte. Mantenha composições variadas.

- 15–30 imagens: Ponto ideal para identidade de assunto único com estilo leve. Adicione 20–40% de imagens não-retratos se quiser que os planos de fundo se generalizem.

- 40–80 imagens: Útil quando você está codificando um visual de marca consistente ou uma linha de objetos multi-ângulo. Você precisará de legendas cuidadosas e mais passos.

As coisas que importaram mais do que a contagem bruta:

- Diversidade de pose sobre diversidade de localização. O WAN generaliza localizações bem: ele tem dificuldade quando cada foto está no mesmo ângulo.

- Equilíbrio de exposição. Se metade do seu conjunto está subexposto, o WAN escurece tudo depois. Padronizei histogramas antes do treinamento.

- Simplicidade de legenda. Descritiva, não poética. “token_assunto, jaqueta jeans, luz de janela, close médio” é melhor que “retrato candido melancólico perto de uma janela chuvosa.”

Para LoRAs de identidade, cheguei a 12–20 imagens como um piso dependável. Para LoRAs de estilo, 30–50 me deu espaço para respirar sem colapsar no brilho de retrato padrão do WAN.

Taxa de Aprendizado / Passos Baseline

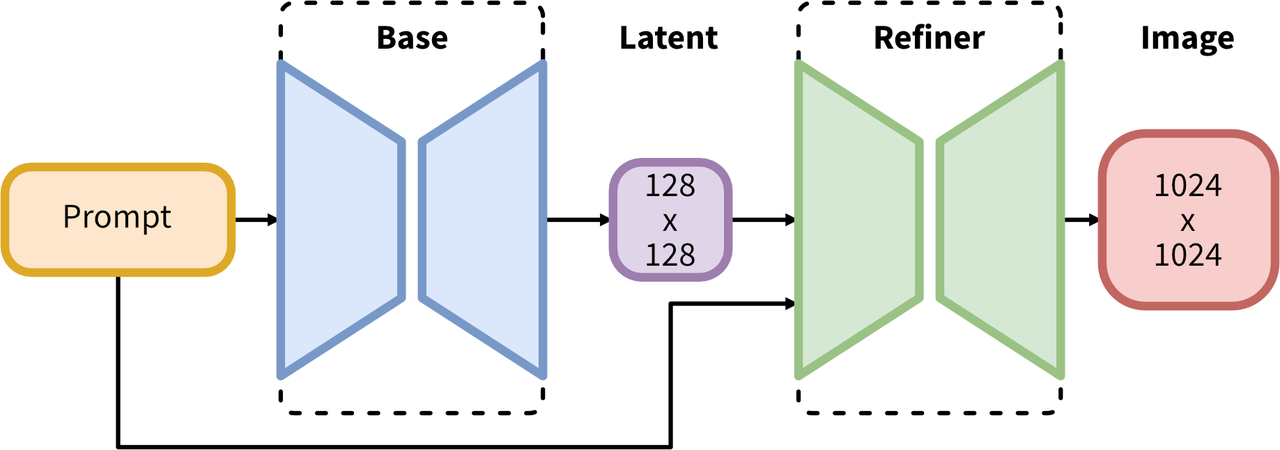

As configurações de treinamento LoRA do WAN 2.2 que pareceram estáveis para mim (Kohya-ss e base SDXL):

- Rank (dim): 16–32. Padrão em 16 para identidade, 32 para estilo.

- Alpha: corresponder ao dim (ex: 16/16). Alfa mais baixa tornou os resultados frágeis.

- Otimizador: AdamW com weight_decay 0.01.

- Taxa de aprendizado: 5e-5 para identidade, 7e-5 a 1e-4 para estilo. O WAN pune LR alto com pele plástica e picos de perda.

- Scheduler: cosine com warmup. Aquecimento 5% do total de passos.

- Tamanho do lote: 2–4 (A100/4090). Acumulação de gradiente para simular 8 se necessário.

- Resolução: SDXL-nativa 1024 no lado longo com bucketing (ex: 1024×768, 1024×1024). Não amplie: apenas memoriza ruído.

- Epochs/passos: Paro por passos, não por epochs.

- 12–20 imagens: 1.200–2.000 passos

- 30–50 imagens: 2.000–3.500 passos

- 60–80 imagens: 3.500–5.000 passos

Verificações de sanidade que usei:

- Salve a cada 200–400 passos e visualize com um prompt fixo + seed.

- Se as amostras afiarem muito rápido antes do passo 600, o LR é alto.

- Se a identidade não bloquear por ~1.400 passos em um conjunto de 20 imagens, as legendas ou regularização estão mais desligadas do que o LR.

Esses números não vencerão uma competição, mas resistem à tendência do WAN de suavizar tudo.

Estratégia de Palavra-Chave de Acionamento

Mantive gatilhos mínimos. O WAN já tem um prior forte: empilhar tokens bonitos apenas adiciona ruído.

O que fiz:

- Um token de instância + um token de classe. Exemplo: “sora_pessoa” como instância, “pessoa” ou “mulher/homem” como classe nas legendas.

- Coloque o token de instância no início de cada legenda. Mantenha-o em minúsculas, uma palavra se puder.

- Evite tokens de estilo na mesma LoRA a menos que você realmente queira uma LoRA de estilo. Misturar identidade e estilo no WAN 2.2 ficou confuso rápido.

Nos prompts, apenas chamo a LoRA e o token de instância, depois camadas de direcionamento suave:

- lora: nome em 0,5–0,8

- token de instância no início do prompt

- palavras de estilo no final e leve (“luz natural, cor limpa, retoque mínimo”)

Tentei gatilhos “estilo WAN” inventados por curiosidade. Não ajudaram. A base já faz essa parte, a LoRA deve esculpir o que você precisa, não re-anunciar no que o WAN 2.2 é bom.

Imagens de Regularização

Este foi o herói silencioso. Usei 1–3x imagens de regularização por imagem de treinamento, classe-combinadas com legendas.

- Para LoRAs de identidade: 20–60 imagens reg rotuladas como a mesma classe (“pessoa”). Gerei-as a partir do WAN 2.2 em si com prompts simples: “foto de uma pessoa, fundo neutro, close médio, luz natural.”

- Para LoRAs de objeto: imagens reg por classe de produto (“sapato,” “garrafa,” “cadeira”). Mantenha-as precisas: não misture classes.

Por que importou: WAN 2.2 gosta de imprimir sua estética de retrato em tudo. Imagens reg deram-lhe permissão para manter o alcance da base enquanto deixavam a LoRA manter a identidade. Sem elas, minhas LoRAs sobre-acentuavam suavidade da pele e bokeh, depois recusavam-se a sair.

As configurações que pareceram certas:

As configurações que pareceram certas:

- Mantenha imagens reg visualmente chatas e bem-expostas.

- Não coloque legendas em imagens reg com tokens de instância: apenas a classe.

- Misture 10–20% de lotes de treinamento com imagens reg durante (não apenas no início).

Se você está com falta de tempo, adicione imagens reg antes de ajustar o otimizador. É a alavanca maior aqui.

Detecção de Sobreajuste

Não confiei apenas na perda. O WAN esconde sobreajuste atrás de amostras bonitas. Estes eram meus sinais:

- Inércia de prompt: mudar o prompt mal muda a saída. Tudo flutua de volta para a mesma lente e fundo.

- Plasticidade da pele: poros desaparecem uniformemente, especialmente ao redor das bochechas e testa, mesmo com prompts de iluminação áspera.

- Eco de pose: ângulos de ombro/pescoço repetidos em diferentes sementes.

- Bloqueio de cor: um matiz quente que se agarra em diferentes pistas de balanço de branco.

Verificações rápidas que executei a cada 200–400 passos:

- Prompt adversarial: mude para “luz dura de escritório aéreo, fluorescente, pouco lisonjeiro” e veja se a textura retorna.

- Virada de fundo: force “rua movimentada, prateleiras desordenadas” para testar flexibilidade de composição.

- Pressão de prompt negativo: adicione “pele super suave, textura plástica, retoque pesado” e veja se ela escuta.

Se dois desses testes falhassem seguidos, voltei para o checkpoint anterior e adicionei mais imagens reg ou deixei o LR cair um pouco.

Colapsos de Correção

Atingi dois tipos de colapso: derretimento de identidade e bloqueio de estilo.

Quando a identidade derreteu (rostos derivaram, olhos desalinhados):

- Baixe o LR um passo (ex: 7e-5 → 5e-5).

- Aumentar rank de 16 para 32 apenas se o conjunto de dados tiver ângulos suficientes: caso contrário, memoriza poses, não identidade.

- Aperte legendas: corte adjetivos, mantenha dicas de distância focal, mantenha token de instância primeiro.

- Adicione 10–20 mais imagens reg da mesma classe.

Quando o estilo travou (tudo parecia um retrato de estúdio padrão do WAN):

- Adicione imagens não-retratos ao conjunto de dados (ambiental, mãos, corpo parcial).

- Aumente passos por 400–800 com agendamento cosine: não aumente pico de LR.

- Reduza peso da LoRA na inferência (0,8 → 0,5) e reduza guidance (CFG 5–6 → 3,5–4,5). O WAN responde bem a CFG mais baixo.

- Se usar deslocamento de ruído ou augmentação de cor pesada, reduza. O WAN já estabiliza cor: aug extra tornou minhas saídas confusas.

Outros botões que ajudaram:

- Clipping de gradiente em 1,0 para evitar picos repentinos.

- EMA desligado para pequenas execuções: com conjuntos de dados minúsculos, EMA fez a identidade ficar para trás das visualizações.

- Disciplina de seed: visualize com uma seed fixa a cada vez. Pequenas mudanças são mais fáceis de julgar quando tudo mais fica imóvel.

Exportar e Reutilizar

Alguns hábitos me economizaram tempo depois:

- Salve checkpoints incrementais com nomes claros: modelo, rank, LR, passos e data. Exemplo: wan22_lora_id_r16_lr5e-5_s1800_2026-01-09.safetensors.

- Mantenha o prompt de treinamento, prompt de validação e seed nos metadados da LoRA se sua ferramenta suportar. O meu “eu” futuro sempre agradece ao meu “eu” passado.

- Uso version-sticky: LoRAs treinadas no WAN 2.2 funcionaram melhor no WAN 2.2 e irmãos próximos. Eram utilizáveis em outras bases SDXL, mas o manuseio de cor e pele mudou. Trato-as como “WAN-first.”

- Padrões de inferência que pareceram bons:

- Peso da LoRA 0,5–0,8 (identidade), 0,3–0,6 (sobreposição de estilo)

- CFG 3,5–5,5

- 30–40 passos com um sampler estável (DPM++ 2M Karras funcionou bem)

- Mantenha prompts curtos: o WAN escuta nudges sutis

Se você quiser mesclar LoRAs: tive melhor sorte empilhando LoRAs pequenas e com propósito único (identidade em 0,6 + aparência de cor leve em 0,3) do que treinando uma LoRA grande “tudo”. O WAN respeita modularidade.

Para workflows mais detalhados do WAN 2.2 e exemplos, confira a documentação oficial do ComfyUI.

Para treinamento, ainda prefiro executar as coisas localmente onde posso ver cada botão. Mas quando se trata de inferência, roteamento de modelo ou alternância entre modelos base sem malabarismo de APIs, você pode experimentar nosso WaveSpeed. Mantém diferentes modelos atrás de um ponto de extremidade consistente para que eu possa me concentrar em prompts e saídas em vez de infraestrutura.

Para treinamento, ainda prefiro executar as coisas localmente onde posso ver cada botão. Mas quando se trata de inferência, roteamento de modelo ou alternância entre modelos base sem malabarismo de APIs, você pode experimentar nosso WaveSpeed. Mantém diferentes modelos atrás de um ponto de extremidade consistente para que eu possa me concentrar em prompts e saídas em vez de infraestrutura.