Requisitos de VRAM do LTX-2: Verificação de Realidade 12GB vs 24GB (4K@50fps Testado)

Oi, sou aquele cara que personificou a VRAM da GPU como um senhorio carrancudo que me expulsa no momento em que eu organizo uma festa um pouco mais ambiciosa. Prazer em conhecer—estou aqui para compartilhar as cicatrizes de uma semana de guerra de OOM em janeiro de 2026.

A primeira vez que LTX-2 travou comigo, não foi dramático. Apenas uma silenciosa caixa “fora de memória” e aquele tipo de suspiro que você guarda para um travamento de impressora. Eu não estava tentando nada selvagem, um clipe curto, prompt básico, mas a matemática de VRAM não se importa com intenções. O senhorio carrancudo não estava aceitando. … acredite em mim.

Ao longo da última semana (jan 2026), fiz anotações enquanto rodava LTX-2 em uma GPU de laptop com 12GB, uma placa de desktop com 16GB e uma máquina emprestada com 24GB. Nada científico. Apenas execuções, reinicializações e uma pergunta simples: até onde posso ir antes que a VRAM me toque no ombro? Isto é o que importou consistentemente.

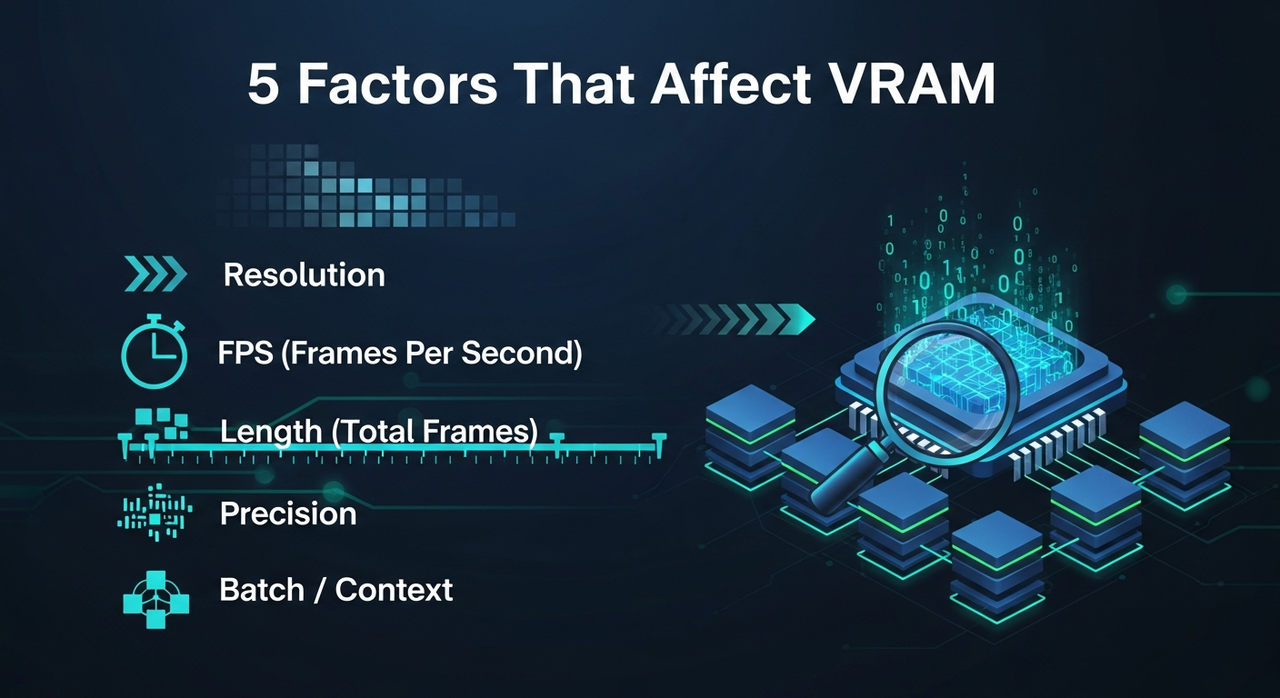

5 Fatores Que Afetam a VRAM (resolução / fps / comprimento / precisão / lote)

Aqui está a lista curta que senti na prática, não apenas nos docs.

Aqui está a lista curta que senti na prática, não apenas nos docs.

1. Resolução

Dobrar a largura e altura aproximadamente quadruplica os pixels. Modelos como LTX-2 sentem isso imediatamente. 720p para 1080p é o passo que frequentemente transforma uma execução de boa para frágil. 4K sem truques? É aí que a casa de cartas balança.

2. FPS

Mais quadros por segundo significa mais quadros mantidos ou preparados na memória durante certos estágios. Se você está perto do limite, reduzir de 25 para 16 fps é uma pequena mudança que libera uma quantidade surpreendente de VRAM e espaço para consistência. Deixe-me dizer, poupou mais execuções do que consigo contar.

3. Comprimento (quadros totais)

O comprimento estica tudo. Alguns pipelines dividem quadros, outros tentam manter pools de contexto maiores. De qualquer forma, 4–6 segundos é geralmente tranquilo, 10–12 segundos fica apertado, 20 segundos é onde começar a planejar, não a esperar.

4. Precisão

fp16 é o ponto doce padrão para mim. bf16 foi similar na caixa de 24GB, mas fp32 aumentou o uso e pareceu inútil para geração. Se você vir um caminho de 8 bits ou quantizado que seja estável, vale a pena tentar em VRAM baixa, mas tratei como experimental.

5. Lote / contexto

Qualquer forma de loteamento, amostragem multi-seed ou contexto temporal longo funciona como um multiplicador. Quando esqueci de resetar lote para 1, paguei por isso instantaneamente.

Pequena nota: Ative atenção eficiente/backends se sua compilação suportar. Consegui ganhos modestos com atenção eficiente de memória e I/O com páginas bloqueadas: não é a noite e o dia, mas o suficiente para manter uma execução de virar.

Configurações do Mundo Real: GPUs de 12GB / 16GB / 24GB

Estas são as configurações que consegui repetir sem necessidade de monitoramento constante. A sua variará de acordo com driver, compilação e o que mais seu sistema estiver fazendo.

12GB (laptop classe 3060)

- Estável: 576p–720p, 5–8 segundos, 16–24 fps, fp16, batch=1.

- Marginal: 1080p em menos de 4–6 segundos a 12–16 fps com configurações conservadoras.

- Notas: Picos de VRAM durante os primeiros passos eram o ponto de falha usual. Manter visualizações desativadas e fechar outros aplicativos GPU ajudou.

16GB (desktop classe 4080)

- Estável: 1080p, 6–10 segundos, 16–24 fps, fp16.

- Marginal: 1080p em 12–15 segundos se eu reduzisse fps ou usasse segmentação.

- Notas: Este é o primeiro nível onde “simplesmente funciona” começa a se aplicar para 1080p. Ainda evitava loteamento.

24GB (classe 4090)

- Estável: 1080p, 12–20 segundos, 24 fps, fp16, espaço para ajustes de orientação leve.

- Marginal: 4K via mosaico ou passadas segmentadas: fino para clipes curtos, mas você sente a sobrecarga.

- Notas: Se você quer espaço para experimentos (máscaras, edições, prompts mais longos), 24GB parecia calmo. Não excessivo, apenas calmo.

4K@50fps: É Alcançável & A Que Custo

Resposta curta: sim, mas não do jeito que esperava.

4K direto a 50 fps do LTX-2 é onde a VRAM e o tempo ambos protestam. Em 24GB, consegui apenas rajadas curtas para rodar, e mesmo assim, vi qualidade balançar e risco de OOM no momento em que eu mexia no comprimento.

O que funcionou melhor

- Gerar a 1080p, 12–16 fps, manter limpo.

- Fazer upscale para 4K com um upscaler dedicado (variantes estilo Topaz ou ESRGAN se você vive no lado aberto).

- Interpolar quadros para 50 fps com ferramentas estilo RIFE/Flowframes.

Compensações que notei

- A consistência temporal se manteve melhor quando fiz upscale primeiro, depois interpolei.

- A interpolação pode adicionar uma sensação soft de ópera de sabão. Reduza ou adicione um pouquinho de grão depois.

- Os clipes “4K nativo” que funcionaram não pareceram significativamente melhores que 1080p → upscale para meu uso. Apenas demoraram mais e travaram mais.

Então: alcançável, sim. Vale a pena localmente, geralmente não, a menos que seu clipe seja menos de ~5 segundos ou você realmente precise de pureza em passada única.

Estratégias de VRAM Baixa (mosaico / segmento / fps mais baixo)

Estas são as que continuei voltando.

- Mosaico inteligentemente: Se o pipeline suporta difusão/atenção mosaicada, use. Sobreponha um pouco para esconder costuras. Adiciona tempo, economiza VRAM e te coloca em território 4K em 16–24GB.

- Segmente por tempo: Renderize blocos de 3–4 segundos, depois costure. É chato, sim, mas domestica picos de VRAM e deixa você re-rolar segmentos problemáticos.

- Reduza fps primeiro, não resolução: Ir de 24 para 16 fps frequentemente preservava a aparência e liberava memória. Espectadores notam quedas de resolução mais rápido que quedas de quadros em durações curtas.

- Mantenha batch=1: Execuções multi-seed são legais: elas também dobram seus problemas.

- Desligue visualizações: Visualizações ao vivo às vezes mantêm buffers extras. Execuções headless eram mais estáveis para mim.

- Precisão mista ativada, precisão exótica desativada: fp16 mantinha equilíbrio. Tratei caminhos de 8 bits como último recurso.

- Descarregue quando possível: Se sua pilha suporta descarregamento de CPU ou disco para caches KV, pode comprar alguns segundos extras ao custo de velocidade.

Fluxo de Solução de Problemas de OOM

Meu rápido reset quando o senhorio me expulsa:

- Reinicie o processo para limpar resíduos de VRAM. Não confie em liberações parciais.

- Configure batch=1, desative visualizações, feche outros aplicativos GPU.

- Reduza fps para 16. Se ainda falhar, reduza resolução um passo (1080p → 900p ou 720p).

- Encurte comprimento em 2–3 segundos. Teste novamente.

- Ative renderização mosaicada/segmentada se disponível.

- Certifique-se de que fp16 está ativado. Evite bf16/fp32 a menos que você saiba que precisa.

- Se continuar falhando no início, seu pico é muito alto (resolução/contexto). Se falhar no final, provavelmente é crescimento de comprimento/contexto.

- Último recurso: mude para uma GPU de nuvem com mais VRAM, termine a renderização, depois volte localmente.

Recomendações de Nível de GPU

Se você está decidindo o que comprar ou pedir emprestado:

- 12GB: Bom para rascunhos, 576p–720p, ideação rápida e clipes sociais curtos. Você segmentará muito.

- 16GB: Bom motorista diário para trabalho em 1080p sob ~10 segundos. Menos hacks, mais fluxo.

- 24GB: Confortável para 1080p mais longo, leves experimentos 4K e tentando opções avançadas sem monitoramento.

- 24GB+ (ou GPU multi-nuvem): Use quando prazos importam ou você está empurrando linhas do tempo 4K com menos compromissos.

Eu não compraria com base em um modelo único. LTX-2 evoluirá: sua tolerância para mosaico e costura não.

Quando Usar Nuvem (comparação de custo WaveSpeed)

Mantenho uma simples folha “WaveSpeed”, não um serviço, apenas uma forma de costas de envelope para comparar dólares por minuto terminado de vídeo.

Como estimar (jan 2026)

- Anote o alvo de clipe (por ex., 4K@50 fps, 10 segundos).

- Cronometre uma execução local limpa a 1080p, depois adicione meu tempo de upscale/interp.

- Preço uma GPU de nuvem comparável por hora.

Taxas spot típicas que vi ultimamente

(muito aproximado: verifique seu provedor)

- L4/A10G-class: $0.50–$1.20/hr

- A100 40/80GB: $1.50–$3.50/hr

- H100: $3–$7/hr

Exemplo, meus números semana passada

- Caixa local 24GB: um pipeline de 10 segundos 4K@50 fps (gen 1080p → upscale → interpolar) levou ~14 minutos de ponta a ponta. Potência + desgaste é difícil de precificar, mas chamo de $0.10–$0.20/execução.

- Nuvem A100 80GB: o mesmo pipeline terminou em ~6–8 minutos. A ~$2.50/hr, são cerca de $0.25–$0.35 por execução.

Então minha linha “WaveSpeed” para aquele caso:

- Local: mais barato por execução, mais lento, mas sem fila.

- Nuvem: um pouco mais por execução, mais rápido e menos complicado quando eu bato em OOM.

Quando eu mudo para nuvem

- Estou em um prazo e não consigo cuidar de correções de OOM.

- Preciso de uma passada 1080p mais longa ou qualquer passada 4K séria.

- Quero explorar configurações sem medo de travar.

Quando eu fico localmente

- Rascunhos curtos, testes de aparência e exploração de prompt.

- Fico bem com 720p/1080p e 6–10 segundos.

Isto funcionou para mim, seus custos e cronograma diferirão. Se você está batendo nas mesmas paredes que eu, vale a pena uma olhada.

Se você está batendo nos limites de VRAM ou simplesmente não quer cuidar de correções de OOM, WaveSpeed permite executar LTX-2 em GPUs de nuvem maiores sem mudar seu fluxo de trabalho. Você mantém seus prompts e configurações — o hardware apenas deixa de ser o gargalo.

A surpresa silenciosa: uma vez que precifiquei execuções desta forma, parei de perseguir “4K nativo@50” localmente. Apenas acertei a aparência a 1080p e deixei o pipeline fazer o trabalho pesado.

A surpresa silenciosa: uma vez que precifiquei execuções desta forma, parei de perseguir “4K nativo@50” localmente. Apenas acertei a aparência a 1080p e deixei o pipeline fazer o trabalho pesado.

E você? Qual é o crash de OOM mais ridículo que você sobreviveu com LTX-2? Solte suas histórias de guerra (ou voltas de vitória) abaixo—leio todos os comentários e adoro trocar dicas.