LTX-2 ComfyUI Quickstart: Primeiro Vídeo em 10 Minutos (Suporte Nativo no Dia 0)

Olá, sou a Dora. Não planejava testar o LTX-2 no ComfyUI no fim de semana passado. Apenas enfrentei um pequeno problema em um reel de cliente: precisava de dois clipes curtos com o mesmo visual, e minhas ferramentas usuais continuavam se afastando. Vi uma nota sobre “suporte ltx-2 comfyui day-0”, respirei fundo e dediquei uma noite. Testei entre 6 e 8 de janeiro de 2026, em minha estação de trabalho principal e em um laptop portátil.

O que segue não é uma análise, apenas como foi realmente colocar o LTX-2 funcionando dentro do ComfyUI, onde ajudou, onde me causou dificuldades, e as configurações que reutilizaria se tivesse que fazer tudo novamente amanhã.

O que é Suporte Nativo Day-0 (lançamento de 5 a 6 de janeiro de 2026)

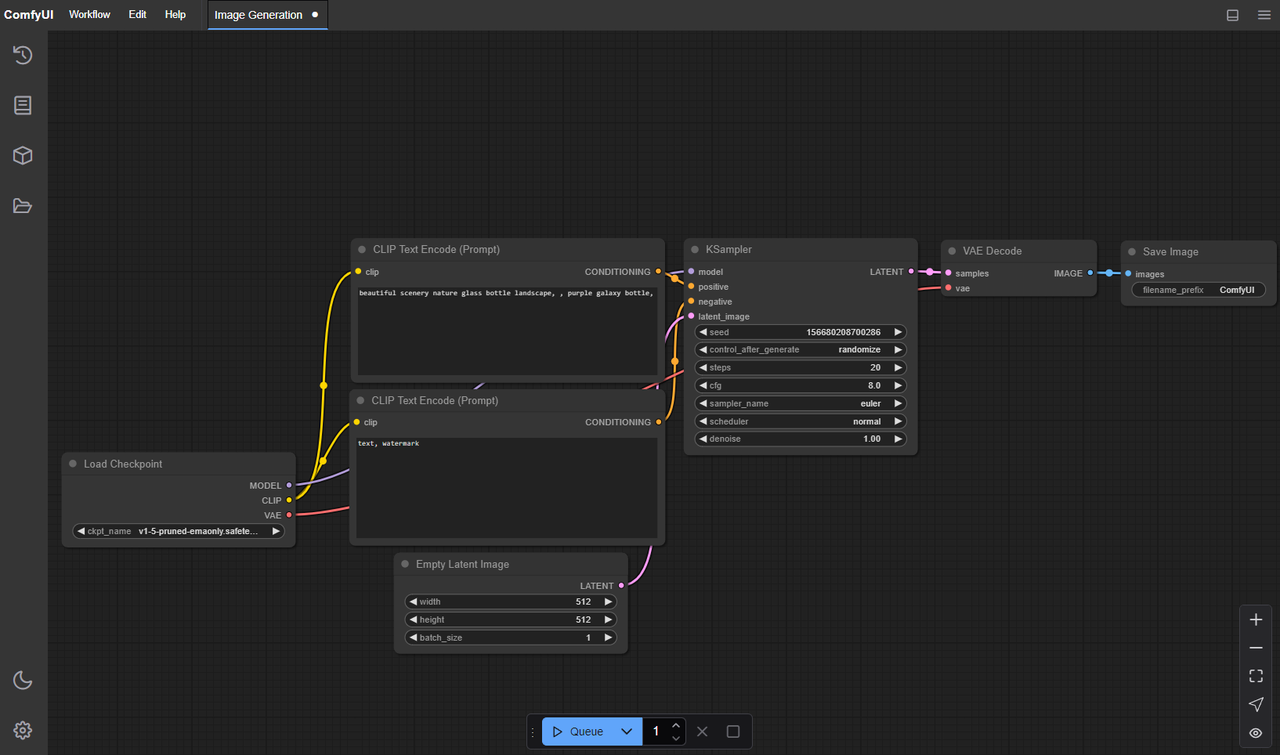

Suporte day-0 aqui significa que o LTX-2 é entregue com nós e um fluxo de trabalho de referência que funcionam dentro do ComfyUI na mesma semana em que o modelo é lançado. Sem scripts de contorno, sem forks misteriosos. Puxei as alterações em 6 de janeiro e vi:

- Nós integrados rotulados para o LTX-2 (carregador, amostrador e um caminho de visualização simples).

- Um fluxo de trabalho de exemplo que realmente funciona do início ao fim sem fiação manual. Não é bonito, mas funcional.

- Ganchos de download de modelo que apontam para os pesos oficiais. Ainda tive que colocá-los em meu diretório de modelos, mas pelo menos os links correspondiam aos documentos.

Não esperava magia, e não é. A primeira passagem se sentiu um pouco crua: presets limitados, alguns erros crípticos. Mas foi estável o suficiente para renderizar clipes de 4 a 6 segundos, e a consistência de cores entre as execuções foi melhor do que estou acostumado. Para um lançamento ComfyUI day-0, isso é raro.

Se você se importa com reprodutibilidade: as sementes funcionaram, e eu podia ajustar a força do movimento sem que a cena desabasse. Essa foi a pequena surpresa que me manteve explorando.

Requisitos Mínimos (GPU / VRAM / versão do ComfyUI)

Isso é das minhas próprias máquinas. Sua configuração pode variar.

- ComfyUI: uma pull fresca a partir de 6 de janeiro de 2026. Forks antigos me deram erros de importação de nós. Se você mantém um ambiente de longa duração, considere um venv limpo apenas para o LTX-2. Siga a documentação oficial do ComfyUI.

- GPU/VRAM:

- 12 GB VRAM: viável em 512×288 a 512×320, clipes de 4–5 s, movimento conservador.

- 16 GB VRAM: 512×512 em 4–6 s se sentiu confortável. OOM ocasional em movimento agressivo ou muitos passos.

- 24 GB+ VRAM: 768×432 a 768×768 em 5–8 s funcionaram suavemente. Bom espaço para CFG mais alto.

- CPU/RAM: nada incomum. Usei 32 GB de RAM do sistema: o uso permaneceu modesto.

- Drivers/Runtime: CUDA 12.x, compilação PyTorch correspondente ao seu CUDA. xformers ajudou na placa de 12 GB, mas não era obrigatório em 24 GB.

Se você estiver em uma GPU de laptop de 8 GB, eu pularia local e usaria um executor em nuvem por enquanto.

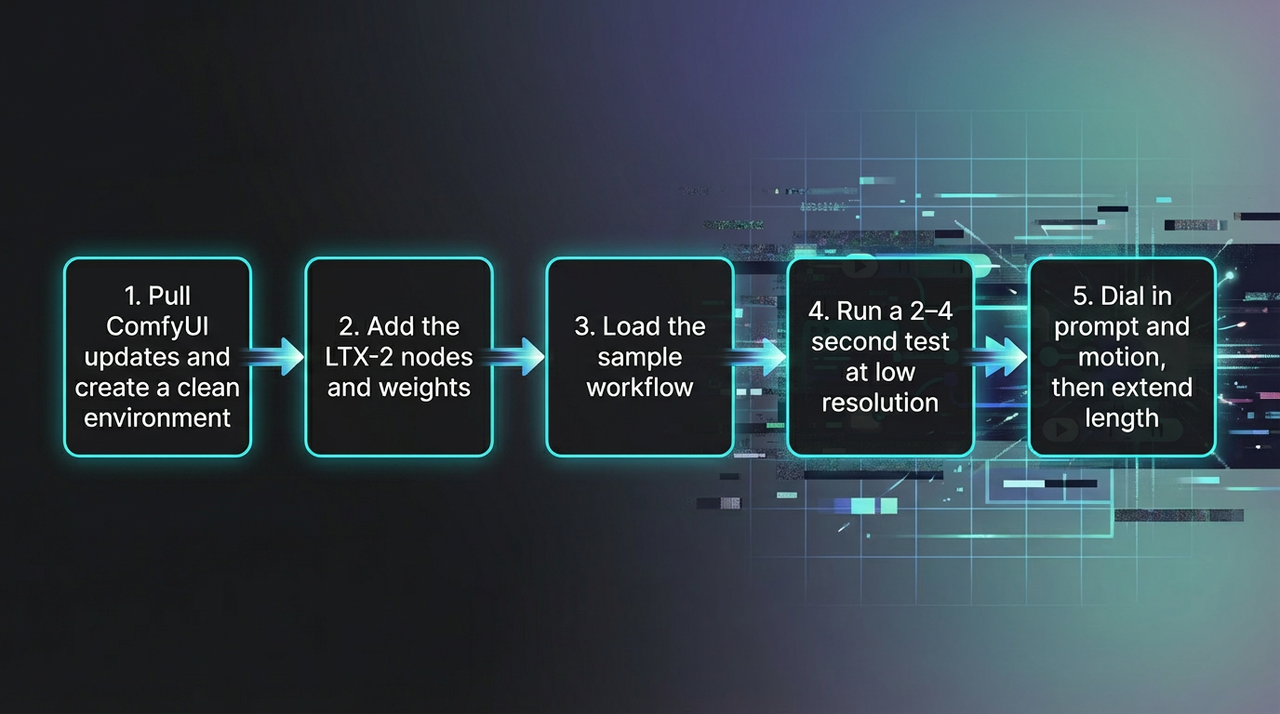

Fluxo de Trabalho de Primeira Execução em 5 Passos

Aqui está o caminho exato que segui em 6 de janeiro. Sem floreios extras.

Aqui está o caminho exato que segui em 6 de janeiro. Sem floreios extras.

-

Atualize o ComfyUI e crie um ambiente limpo Clonei uma pasta ComfyUI fresca do GitHub e instalei os requisitos do arquivo incluído. Misturar nós antigos com novos modelos de vídeo geralmente causa falhas estranhas e silenciosas. Fresco me salvou uma hora.

-

Adicione os nós e pesos do LTX-2 Usei os nós LTX-2 agrupados que foram entregues com a atualização de 5–6 de janeiro. Para os pesos, segui os links na dica de ferramenta do nó e coloquei arquivos em

models/ltx(o caminho sugerido). Se seu nó não conseguir encontrar pesos, ele dirá, apenas verifique os nomes exatos dos arquivos. -

Carregue o fluxo de trabalho de exemplo O exemplo fornecido me deu uma linha de base funcional: entrada de prompt de texto, saída de visualização de vídeo. Alterei apenas três coisas: seed, resolução e força do movimento. Começar simples mantinha os erros óbvios.

-

Execute um teste de 2–4 segundos em baixa resolução Minha primeira execução foi 512×320, 4 segundos, 16 quadros, passos do amostrador em 20. Levou ~50–70 segundos em uma 4090 de 24 GB, ~2–3 minutos em uma 3060 de 12 GB. O objetivo não era velocidade: era verificar o pipeline.

-

Ajuste o prompt e o movimento, depois estenda o comprimento Depois que gostei da aparência básica, ajustei CFG e força do movimento, depois passei para 6–8 segundos. Se a cena desabasse, eu recuava: reduzia o movimento, bloqueava a seed e mantinha a mesma resolução.

Pequena nota: Salvei cada teste com seed e configurações no nome do arquivo. Quando os clipes começam a ficar confusos às 1 da manhã, esse rastro de migalhas é um presente.

Configurações Recomendadas (padrões de resolução / fps / comprimento)

Estes são pontos de partida que funcionaram bem para mim. Ajuste conforme sua preferência.

-

Resolução

- 512×320 ou 512×512 para primeiras aparências. Estável, rápido o suficiente, fácil na VRAM.

- 768×432 quando você quer mais detalhes sem se comprometer com quadrado.

-

FPS

- 12–16 fps para passes de conceito. Você verá arcos de movimento sem tempos de renderização pesados.

- 24 fps apenas quando você tem confiança no visual: isso aumenta o tempo e a memória.

-

Comprimento

- 4–6 segundos é o ponto ideal para iteração. Passados 8 segundos, o modelo começa a vagar a menos que seu prompt seja muito ancorado.

-

CFG / Steps

- Comece CFG em 3–5. Mais alto adiciona contraste, mas pode bloquear demais a cena.

- Passos em 18–24 foram suficientes na maioria dos casos. Não vi grandes ganhos acima de 28.

-

Movimento

- Mantenha-o conservador no início. Se você precisa de movimentos grandes, construa em pequenos aumentos e mantenha a seed fixa conforme você ajusta.

Também mantive um preset de “padrões sãos”: 512×512, 16 fps, 6 s, CFG 4, passos 22, movimento 0.6. É chato, mas chato é confiável.

3 Prompts Copy-Paste Que Funcionam

Estes não são palavras mágicas, apenas prompts que produziram clipes constantes e repetíveis entre 6–8 de janeiro. Incluo uma nota de configuração curta para cada.

-

Macro de produto com paralaxe suave

- Prompt:

"a simple ceramic mug on a wooden desk, soft morning window light, shallow depth of field, slow parallax left to right, natural colors, minimal grain" - Notas: Mantenha os nomes dos fundos simples. Se você adicionar linguagem de marca, tende a alucinar logos.

- Prompt:

-

Cena de rua com movimento comedido

- Prompt:

"a quiet city street at dusk, neon signs reflecting on wet pavement, light drizzle, camera slowly dollying forward, subtle lens flare, cinematic but understated" - Notas: Se suas luzes começarem a piscar, reduza o movimento e diminua CFG em 1.

- Prompt:

-

Loop de textura natural

- Prompt:

"close-up of ripples on a lake, soft breeze, warm sunset tones, camera locked with small micro-movements, gentle highlights, calm mood" - Notas: Ótimo para fundos. O travamento de seed o mantém próximo de um loop se você aparar as caudas.

- Prompt:

Dica: Se você quer controle de estilo mais apertado, coloque palavras de tom na frente (“understated, natural light, clean composition”) antes dos objetos. Parecia ancorar melhor a paleta.

Erros Comuns de Primeira Execução + Correções Rápidas

Estes foram meus problemas reais e o que os corrigiu.

-

CUDA fora de memória no início

- Correção: reduza a resolução primeiro, depois os passos, depois o movimento. Se você está em 12 GB, fique em 512 de largura e mantenha clipes com menos de 6 segundos. Feche navegadores que consomem VRAM (sério).

-

Nó não encontrado / classe ausente

- Correção: atualize o ComfyUI para os commits de 5–6 de janeiro: remova nós customizados antigos que agrupem carregadores de vídeo legados, depois reinicie. Se o erro apontar para um nome de nó específico, pesquise sua pasta

custom_nodespor duplicatas.

- Correção: atualize o ComfyUI para os commits de 5–6 de janeiro: remova nós customizados antigos que agrupem carregadores de vídeo legados, depois reinicie. Se o erro apontar para um nome de nó específico, pesquise sua pasta

-

Arquivo de pesos não detectado

- Correção: corresponda ao nome exato do arquivo que o nó espera. Mantenha os caminhos apenas ASCII; evite symlinks no Windows se possível. Reinicie o ComfyUI após mover arquivos.

-

Torch / CUDA incompatível

- Correção: garanta que sua compilação PyTorch corresponda ao seu kit de ferramentas CUDA. Se você não se importa em depurar, use a roda pip sugerida no ComfyUI GitHub README

para sua GPU.

para sua GPU.

- Correção: garanta que sua compilação PyTorch corresponda ao seu kit de ferramentas CUDA. Se você não se importa em depurar, use a roda pip sugerida no ComfyUI GitHub README

-

FFmpeg não encontrado para exportar

- Correção: instale o FFmpeg e adicione-o ao PATH. Como um fallback rápido, exporte quadros e monte com qualquer codificador em que você confie.

-

Cintilação ou desvio de estilo no meio do clipe

- Correção: reduza o movimento, diminua CFG em 1–2, e mantenha prompts limpos. Overdescribing tende a lutar contra a consistência temporal.

Dica profissional: Se nada funcionar e você estiver em um prazo apertado, renderize 12–16 fps e desacelere para 24 fps na pós-produção com mistura de quadros. Não é elegante, mas é calmo em uma tempestade.

O que gostei

- Sem disputa de dependências. Estava testando um prompt em menos de cinco minutos.

- Padrões razoáveis. A primeira saída não era perfeita, mas não era caos.

O que me atrapalhava

- Menos controle do que um gráfico ComfyUI completo. Sentia falta de poder conectar passos de pós-processamento personalizados.

- Tempo de fila. Minha espera mais longa foi ~6 minutos durante horários de pico.

Quem se encaixa

- Se você está explorando aparências e não quer mexer em drivers, é fácil.

- Se você precisa de um pipeline reproduzível com versões e seeds rastreadas em projetos, o ComfyUI local ainda vence.

- Se você apenas precisa executar o LTX-2 imediatamente sem configuração, WaveSpeed permite renderizar em um navegador e verificar prompts antes de se comprometer com um pipeline local.

Isso funcionou para mim; seus resultados podem variar. Se você está viajando ou em uma GPU de 8 GB, vale a pena olhar.

Um pequeno pensamento para terminar: LTX-2 dentro do ComfyUI não me tornou mais rápido imediatamente. Mas tornou minhas escolhas mais claras: menos botões que importavam, mais que não importavam. Isso, mais do que velocidade, é o que noto uma semana depois.