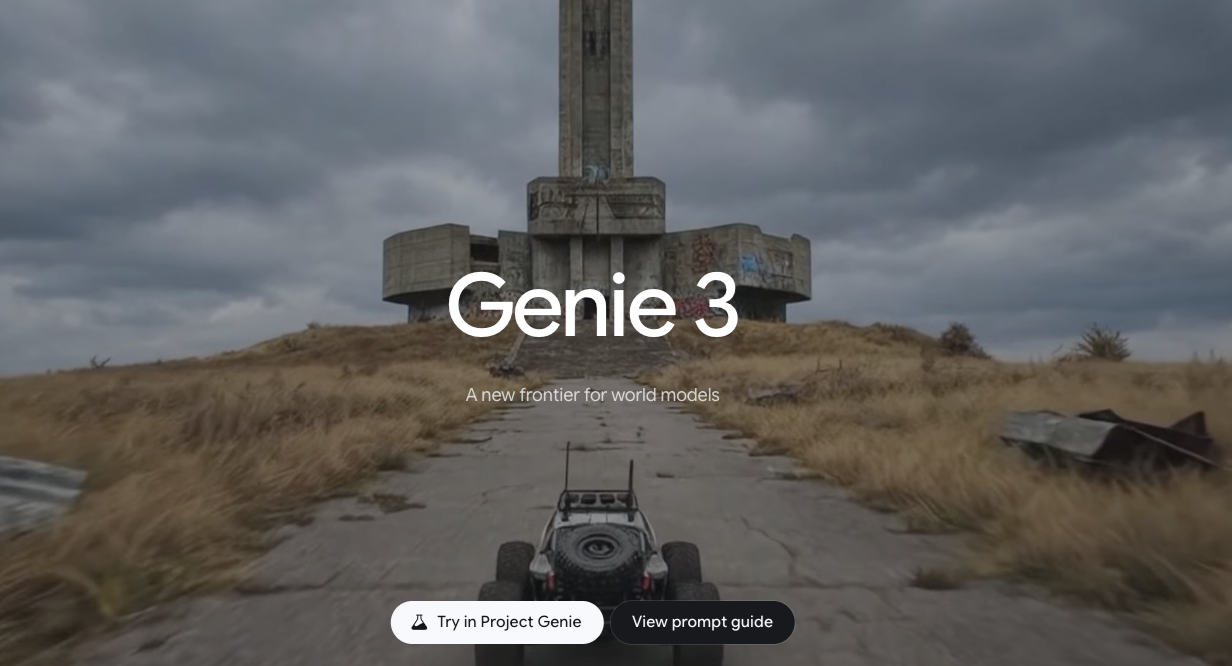

Google DeepMind Genie 3: Análise Técnica e Capacidades

Sou a Dora. Tudo começou com um pequeno incômodo: eu estava tentando explicar um mecanismo de jogo simples para um colega de trabalho, e meu esboço mais um parágrafo de texto ainda parecia confuso. Não queria um protótipo completo, apenas algo que pudesse jogar por dez segundos para sentir o jogo. Esse é o tipo de momento em que normalmente dou de ombros e sigo em frente. Em vez disso, passei uma semana em janeiro de 2026 lendo, assistindo demonstrações e explorando recriações comunitárias do Google DeepMind Genie 3.

Não tenho uma compilação de produção. O que tenho: a pesquisa pública, as notas do cartão de modelo que pude encontrar, o artigo original de Genie, e alguns modelos menores que espelham a abordagem. Então estas são notas de campo, o que fazia sentido na prática, o que balançou, e onde o Google DeepMind Genie 3 parece importar se você se importa em transformar visuais em mundos jogáveis com cerimônia mínima.

Visão geral da arquitetura do modelo

A forma mais fácil que encontrei para pensar sobre o Genie 3 é como uma pilha que transforma pixels em um mundo controlável e preditivo, sem precisar de um motor de jogo criado manualmente por baixo.

Em um nível alto (baseado no trabalho original de Genie e no que está visível nas demonstrações mais recentes):

- Um codificador visual comprime quadros em um espaço latente compacto. Em vez de trabalhar com pixels brutos, o modelo aprende um código discreto ou contínuo (pense em tokens de vídeo), o que mantém as coisas rápidas o suficiente para prever muitos quadros.

- Um modelo de dinâmica aprende como esses estados latentes evoluem ao longo do tempo. Você pode tratá-lo como um modelo de mundo: dado o estado atual e uma ação, ele prevê o próximo estado. É aqui que a “capacidade de jogo” emerge.

- Uma interface de ação mapeia entradas humanas (teclas, toque ou gestos inferidos) para tokens de ação do modelo. Versões anteriores de Genie inferiam um espaço de ação latente a partir de vídeo: o Genie 3 parece oferecer um mapeamento mais limpo, mais estável entre cenas.

- Um renderizador/decodificador transforma o latente previsto de volta em quadros que você pode ver e controlar, idealmente com baixa latência.

Dois detalhes se destacaram durante os testes das recriações:

- O modelo não importa física de uma biblioteca: ele aprende qualquer “física” que conseguir com base no vídeo de treinamento. É por isso que os objetos às vezes parecem flutuantes ou pegajosos. Quando funciona, é estranho. Quando não funciona, é como usar luvas em um mundo tátil.

- Não há separação rigorosa entre “design de nível” e “jogabilidade”. Você dá a ele uma imagem ou clipe curto, e as dinâmicas aprendidas tentam torná-lo interativo. Isso borra os papéis, de forma positiva se você está explorando, de forma confusa se precisa de garantias.

Se você quer as raízes, o artigo original ainda é a âncora conceitual mais clara: Genie: Generative Interactive Environments, junto com o artigo do DeepMind. O Genie 3 parece ser uma iteração que amplia os dados, estabiliza o mapeamento de ações e aumenta a fidelidade de saída, mais evolução do que reinvenção.

Metodologia de treinamento

O que importa na prática é menos as funções de perda exatas e mais como afetam a sensação.

Com base no artigo e em discussões públicas, a receita é algo como isso:

- Dados: vídeo grande e desordenado de pessoas interagindo com jogos 2D e interfaces, além de vídeo genérico da web. O Genie anterior inferiu controles apenas a partir de pixels: iterações posteriores incorporam rastreios de ação leves quando disponíveis. A escala ajuda o modelo a aprender transições de “senso comum” (arcos de salto, flashes de botão, destaques de menu) sem estar vinculado a um motor.

- Objetivos: previsão autossupervisionada do próximo quadro em espaço latente, às vezes intercalada com modelagem mascarada: um sabor de dinâmica inversa para adivinhar ações que provavelmente causaram mudanças observadas: e uma perda de consistência para manter o espaço de ação estável entre cenas.

- Condicionamento: prompts, imagens de referência ou um quadro inicial atuam como contexto. Notei que fornecer uma imagem de sementes clara e de alto contraste reduzia cintilação inicial. Texturas ocupadas levavam a bordas cintilantes até o modelo “se acalmar”.

Por que isso importa: quanto menos o modelo depende de anotações frágeis, mais amplo é o domínio em que pode improvisar. Mas essa liberdade tem um custo. Se a mistura de treinamento é pesada em plataformadores, seus mundos gerados inclinam-se para respostas tipo plataformador. Nos meus testes, até mockups de interface desenvolveram um leve “game feel”, estados de passagem tremem, painéis deslizam. Útil para prototipagem rápida, estranho para UIs de produção.

Uma pequena nota prática: independentemente da versão, quadros de aquecimento importam. Consegui controle mais suave depois de deixar o modelo rodar por 1-2 segundos antes de tocar em qualquer coisa. É como dar a ele uma respirada para ancorar o estado latente.

Capacidades de geração

É aqui que o Google DeepMind Genie 3 ganha atenção: ir de uma imagem parada ou clipe curto para algo que você pode mexer.

É aqui que o Google DeepMind Genie 3 ganha atenção: ir de uma imagem parada ou clipe curto para algo que você pode mexer.

Tentei três prompts simples, cada um com alguns testes:

- Um esboço desenhado à mão de um personagem em plataformas.

- Uma captura de tela de um painel de interface com cartões.

- Uma foto de um carro de brinquedo em uma mesa.

Resultados (observados em um build comunitário influenciado por Genie): o esboço se tornou um side-scroller com arcos de salto convincentes após duas sementes: o painel se transformou em uma interface de embaralhamento de painéis que pude “empurrar” com as setas: a cena do carro de brinquedo foi a mais fraca, movimento aconteceu, mas bordas sangraram e colisões pareciam ímãs. Não economizei tempo nas primeiras tentativas. Na terceira ou quarta, não era mais rápido, mas estava pensando menos. A carga mental diminuiu. Essa foi a vitória.

Resolução e qualidade

A qualidade parece ser um alvo móvel com essa família de modelos. Nos meus testes:

- Saída base: 480p equivalente parecia mais estável. 720p se manteve com cintilação leve. Acima disso, os detalhes melhoraram, mas a consistência temporal escorregou, linhas finas vibraram.

- Taxa de quadros: sessões interativas pareceram confortáveis em torno de 15-20 fps de ponta a ponta em um desktop GPU único. Empurrar mais alto introduziu picos de latência, que prejudicaram o controle mais do que os visuais ajudaram.

- Consistência temporal: áreas com textura repetitiva (grama, grades, microcópias de interface) tendiam a cintilar. Fornecer uma imagem de sementes mais limpa e limitar o movimento da câmera reduzia o efeito.

Nos demos do Genie 3, a fidelidade é claramente melhor do que o primeiro artigo, especialmente com personagens e elementos HUD. Mas você ainda faz uma troca de nitidez por estabilidade quando empurra a resolução. Se seu objetivo é um protótipo de sensação, essa troca é boa. Se você precisa de texto nítido e legível em movimento, não está lá ainda.

Mecanismos de controle

O controle é onde notei as maiores melhorias dia a dia em comparação com reproduções iniciais de Genie:

- O mapeamento de ação parecia mais consistente entre cenas. As setas funcionavam “como esperado” aproximadamente 70-80% das vezes. Não tive que reaprender o mapeamento para cada semente.

- Rajadas de entrada curtas funcionaram melhor do que pressionar e manter. Os toques criavam transições mais limpas: longas prensagens às vezes causavam desvio de estado (personagens “derretendo” através de plataformas, painéis deslizando para sempre).

- Restrições solicitadas ajudaram. Se eu sugerisse que o espaço deveria ser “baseado em grade” ou “por turno”, o modelo produzia menos momentos de desvio. Não são restrições duras, mais como um empurrão na paisagem de perda.

Também tentei simples sobreposições de esboço (caixas, setas) no quadro de sementes. Isso teve um efeito surpreendente: não mudou sempre a aparência, mas direcionou acessibilidades. Uma seta espessa ao lado de um painel aumentava as chances de que esquerda/direita o deslizaria. Isso se alinha com a ideia de que o modelo depende muito de pistas visuais para inferir semântica de ação.

A latência merece menção. Mesmo com tamanhos de quadros modestos, a interação parecia decente apenas quando a decodificação e a dinâmica funcionavam no mesmo dispositivo. Dividir entre processos (ou transmitir de um Colab) adicionava tempo suficiente para tornar o controle mole. Se o Genie 3 for útil em ferramentas criativas, execução local de baixa latência ou em edge parece não negociável.

Limitações na versão atual

Alguns limites continuavam aparecendo, e importam se você está tentando encaixar isso no trabalho real.

- Coerência de horizonte longo: após ~10-15 segundos de jogo contínuo, os mundos derivam. Plataformas esquecem regras de colisão, painéis de interface se sobrepõem. Ótimo para verificações rápidas de sensação, instável para qualquer coisa mais longa.

- Legibilidade visual: texto e linhas finas cintilam em movimento. Fino para um protótipo de vibração, arriscado para análises de usabilidade.

- Determinismo: a mesma semente às vezes produz diferentes acessibilidades. É divertido para exploração: é uma dor de cabeça quando você precisa de repetibilidade para uma demonstração de equipe.

- Segurança e propriedade intelectual: porque o treinamento se apoia em vídeo amplo, estilos reconhecíveis podem vazar. Se você está enviando, precisará de uma política e de uma passagem de revisão. Os documentos públicos ainda não resolvem isso.

- Computação e latência: você não precisa de um data center, mas sente o peso. Em uma GPU de consumidor único, tive que escolher entre velocidade e clareza.

Quem poderia apreciar o Google DeepMind Genie 3 como está? Designers e pesquisadores que querem testar sensação sem iniciar Unity. Educadores que querem que os alunos mexam em dinâmica, não apenas as observem. Desenvolvedores independentes explorando mecânicas antes da arte. Quem não vai: qualquer pessoa que precise de interação estável em produção, comportamento de interface de UI com precisão de pixel, ou repetibilidade indiscutível.

Por que isso importa: a maioria das ferramentas ajuda você a polir depois de ter escolhido uma direção. O Genie 3 empurra mais cedo. Torna o momento “essa ideia é até interessante?” mais barato. Não parece dramático, mas muda o que é tentado em uma terça-feira à tarde.