Extensão ComfyUI-LTXVideo: Suporte LoRA, Workflows e Quando Você Precisa

title: “Extensão ComfyUI-LTXVideo: Suporte LoRA, Fluxos de Trabalho e Quando Você Precisa Deles” date: “2026-01-13” author: “Dora” description: “Uma olhada prática no LTXVideo no ComfyUI—o que é nativo, o que a extensão adiciona, e como muda fluxos de trabalho reais com vídeo.” cover: “https://d8r3hf7cxo9nn.cloudfront.net/cms/2026-01-13/20260113024313_tipbhf0t.png”

Na primeira vez que experimentei ComfyUI LTXVideo, eu não estava atrás de novos recursos. Eu só queria uma maneira estável de transformar um storyboard áspero em movimento sem ficar de olho em cada quadro. Minha pequena fricção: mais um erro “nó faltando” após um dia longo. Quase fechei a janela. Em vez disso, dediquei a semana (início de janeiro de 2026) e testei em alguns projetos reais: um loop de produto de 12 segundos, um snippet de ensino para um curso, e um daqueles experimentos de textura-para-movimento que parecem ou muito inteligentes ou amaldiçoados.

O que descobri não foi mágica. Mas tornou o trabalho mais leve em alguns momentos tranquilos. Esse é geralmente o sinal que procuro.

Core Nativo vs Extensão: Qual é a Diferença

Eu mantinha vendo pessoas falarem sobre “suporte LTXVideo no ComfyUI”, mas não era claro o que era nativo e o que precisava de partes extras. Aqui está o que notei na prática.

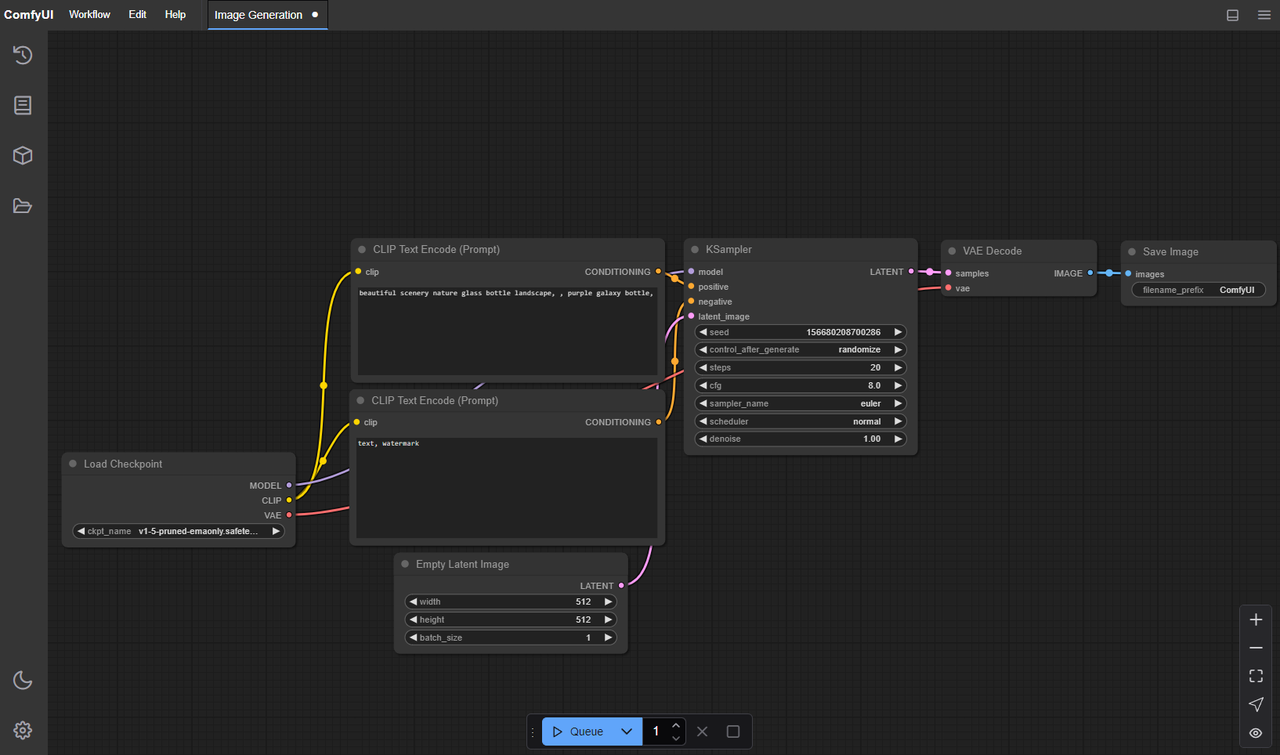

- Core (base ComfyUI): Você pode conectar fluxos gerais de texto-para-imagem/vídeo, agendar amostradores e gerenciar condicionamento. O app base é sólido para roteamento de dados, pré-visualização de quadros e manutenção de execuções reproduzíveis. Mas ele não vem com nós especializados de LTX-Video por padrão.

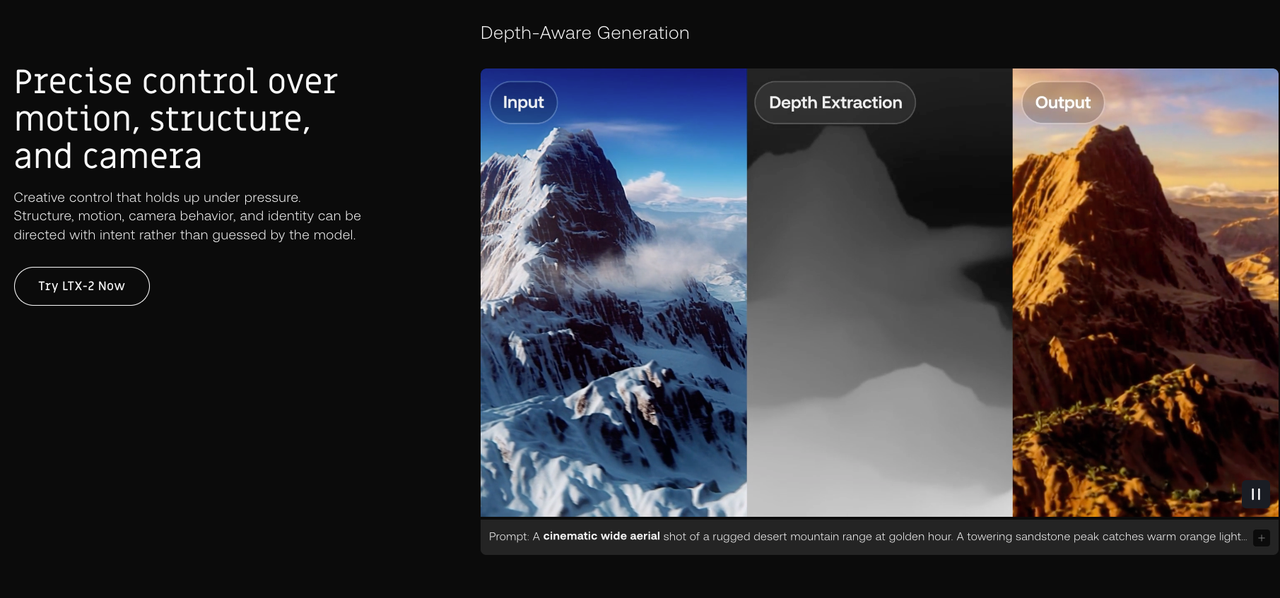

- Extensão (nós customizados LTXVideo): Isso adiciona nós cientes do modelo (carregadores, amostradores, blocos de condicionamento) construídos em torno da arquitetura LTX-Video. A extensão entende o comprimento de movimento do modelo, janelas de contexto, e as pequenas restrições que não mapeiam de forma limpa para nós genéricos.

A diferença aparece quando você tenta fazer menos colagem manual. Com apenas nós core, eu estava malabarando formas de tensor, adivinhando padrões, e batendo em incompatibilidades de forma. Com a extensão instalada, o gráfico ficou mais curto e erros diminuíram. Eu ainda tinha que pensar, só não sobre encanamento.

Um pequeno exemplo: construí um loop de 8–12 segundos com iluminação consistente de cena. Apenas core levou ~45 minutos para se estabilizar: deixe-me contar, a versão de extensão funcionou limpo na segunda tentativa (cerca de 15 minutos), porque o amostrador pré-conectado e o montador de vídeo lidaram com alinhamento de quadro sem eu mexer nisso.

Então, se você está avaliando: core é suficiente se você gosta de controle total e não se importa com conexões. A extensão é para quando você se importa mais com execuções repetíveis do que com pipes ajustados manualmente.

O Que a Extensão Adiciona (fluxos de trabalho / nós / LoRA)

Eu não esperava muito quando cliquei nos gráficos de exemplo, eu vi muitos fluxos de trabalho “iniciantes” que são basicamente screenshots. Estes foram melhores que isso.

O que me ajudou:

- Nós construídos para propósito: Carregador de modelo para LTX-Video, um seletor de comprimento de movimento que evita contagens de quadro estranhas, e um amostrador que respeita os momentos ideais de tempo do modelo. Eles removem algumas pegadinhas que geralmente aparecem apenas após uma renderização falhada.

- Fluxos de trabalho exemplo: Três aos quais continuo voltando, base texto-para-vídeo, imagem-para-vídeo com injeção de movimento, e transferência de estilo usando LoRA. Cada um é claro o suficiente para começar, mas não tão rígido que você não possa trocar partes.

- Ganchos LoRA: A extensão expõe força de LoRA e combinação de forma limpa. Eu poderia empilhar um LoRA de estilo com um LoRA de identidade leve e ainda manter o movimento estável. Tenho que dizer, isso é raro em configurações de vídeo iniciais.

Uma pequena surpresa: o tratamento de cor padrão parecia mais calmo do que a maioria dos modelos de vídeo abertos que tentei. Azuis não explodiram. A pele permaneceu dentro de um intervalo credível. Eu ainda tinha que ajustar a exposição, mas não estava combatendo saturação.

Limites que encontrei:

- Sequências longas (mais de ~12–16 segundos) derivavam a menos que eu introduzisse keyframes de âncora ou dividisse a execução. Isso é normal nesta fase, mas vale a pena notar.

- Empilhamento pesado de LoRA pode fazer o movimento bambolear. Dois está bem, três é arriscado a menos que você reduza as forças.

Passos de Instalação e Atualização

Preparação

- Atualize ComfyUI para uma build recente. Usei a noturna de janeiro de 2026 em ambas as máquinas.

- Python 3.10–3.11 funcionou melhor. Mantive um venv fresco por máquina.

Instale a extensão LTXVideo

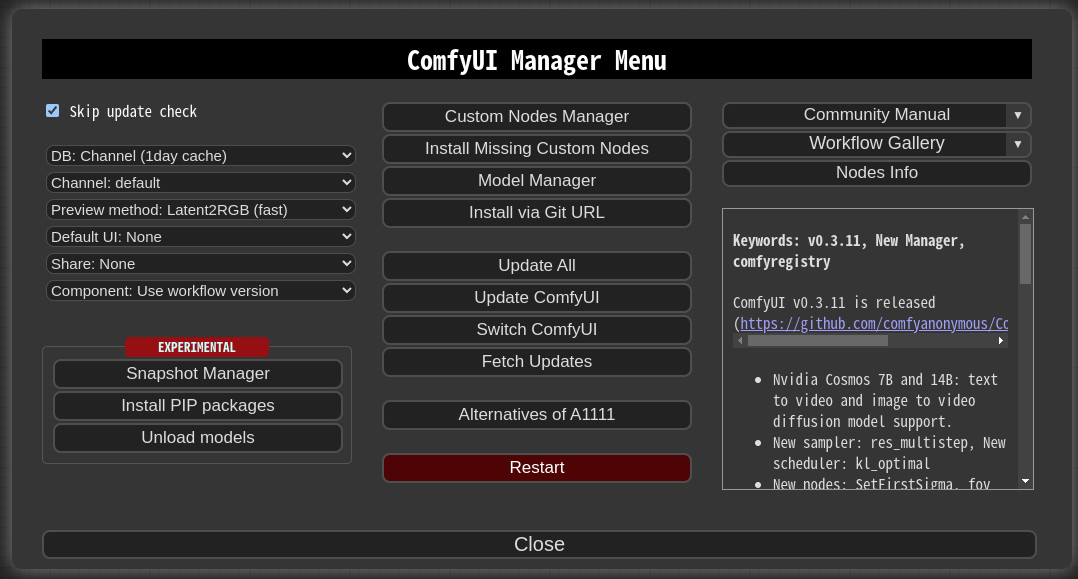

- Use ComfyUI-Manager se tiver: Procure por “LTXVideo” ou “ComfyUI-LTXVideo” e instale.

- Rota manual: clone o repo em ComfyUI/custom_nodes. Então instale requisitos (

pip install -r requirements.txt) dentro do seu ambiente.

Modelos

- Coloque o(s) checkpoint(s) LTX-Video onde a extensão espera. A maioria das versões procura em

models/ltxvideooumodels/checkpoints: o nó geralmente lhe diz o caminho exato ao passar o mouse. - Se você estiver usando LoRA, coloque-os em

models/loras(ou o que o nó lista como padrão).

CUDA e runtimes

- Linux com CUDA 12.x e PyTorch 2.3+ funcionou sem problemas. No macOS, Metal funcionou, mas mantive tamanhos de lote pequenos.

- Se você ver picos de memória na primeira execução, reduza o comprimento de movimento ou defina precisão de decodificação mais baixa se o nó expor.

Atualizações

- Puxe o mais recente do repo da extensão. Reinstale requisitos quando commits principais chegarem (encontrei uma incompatibilidade de torch-vision e um bump de protobuf: ambos corrigidos com reinstalação limpa).

- Limpe o cache de ComfyUI se os nós não aparecerem após uma atualização. Um reinício rápido geralmente resolve importações obsoletas.

Custo de tempo: A primeira instalação levou ~20 minutos em uma caixa Linux limpa, ~30 minutos no macOS porque tive que re-linkar alguns builds de metal. Atualizações foram minutos a menos que dependências mudassem.

Walkthrough de Fluxos de Trabalho Exemplo

Executei três fluxos de trabalho várias vezes cada, ajustando o suficiente para ver como são estáveis.

Executei três fluxos de trabalho várias vezes cada, ajustando o suficiente para ver como são estáveis.

1. Texto-para-vídeo (baseline)

- Configuração: Prompt, prompt negativo, o carregador LTX-Video, o amostrador do modelo, e um escritor de vídeo em 512–768 na borda curta. Mantive o comprimento de movimento em 8–12 segundos.

- Observações: A primeira passagem raramente acertava o ritmo exato, mas me dava uma “tomada base” estável. Segunda passagem com edições de prompt menores corrigiu a maioria dos problemas. Cada renderização era 2–4 minutos no A6000, ~6–8 no M3 Max.

- Dica pequena: Se o movimento parecer flutuante, aperte a orientação temporal ou reduza CFG um pouco. Para mim, 4.5–6.5 era a banda usável.

2. Imagem-para-vídeo com injeção de movimento

- Configuração: Uma única imagem de referência, mais um LoRA de estilo de baixa força para manter a textura consistente. Usei o nó de movimento da extensão para ajustar a deriva de câmera em vez de deixar ela inventar movimento.

- Observações: Isto não economizou tempo na primeira tentativa, eu sobre-ajustei. Na terceira execução, realizei que reduziu a carga mental: menos artefatos para revisar, menos surpresas de “o que é aquilo no canto?”

- Nota prática: Se o assunto se deforma em torno do quadro 3–5, adicione uma imagem de dica de meio de sequência ou quadro de âncora. Usei duas âncoras para um clipe de 10 segundos e pareceu travado.

3. Estilo com LoRA (mais identidade leve)

- Configuração: Prompt base, um LoRA de estilo em 0.6–0.8, LoRA de identidade em 0.2–0.3, e movimento conservador.

- Observações: A combinação se manteve melhor do que esperava. Mais forte que 0.8 em estilo começou a “brilhar” as texturas, legal para pôsteres, estranho para movimento. Manter identidade baixa evitou mudanças inquietantes.

- Exportação: Escrevi para ProRes para grading. H.264 é bom para verificações rápidas, mas as cores pareciam melhores quando fiz uma passagem leve em Resolve.

Entre as execuções, economizei talvez 15–20 minutos por clipe em comparação com costurar nós genéricos. A maior vitória foi menos reinicializações. Menos mexer, mais decidir.

Noções Básicas de LoRA e IC-LoRA

Tendo a alcançar LoRA apenas quando preciso deles. Com LTXVideo, eles valem o passo extra, especialmente para consistência.

Tendo a alcançar LoRA apenas quando preciso deles. Com LTXVideo, eles valem o passo extra, especialmente para consistência.

- LoRA: Pense nisto como uma impressão digital estilística leve. Em vídeo, empurre suavemente. Forças acima de ~0.8 parecem frágeis conforme o movimento se acumula.

- LoRA de Identidade: Útil para manter um personagem ou produto estável entre quadros. Gostei de valores no intervalo de 0.15–0.35.

- IC-LoRA (LoRA condicionado por imagem): É aqui que encontrei o valor mais prático. Alimentar uma imagem de referência limpa em IC-LoRA estabilizou detalhes (logos, rostos) sem congelar a cena. Usei uma imagem frontal nítida e às vezes um ângulo lateral como uma dica secundária.

O que importa na prática:

- Referências limpas vencem prompts inteligentes. Lixo dentro, lixo fora, e mostra mais em movimento.

- Misture menos, ajuste mais leve. Dois LoRAs levemente aplicados funcionaram melhor do que três em conflito um com o outro.

- Re-semear se tremulação micro aparecer. Uma nova semente mais as mesmas âncoras frequentemente resolviam tremulação facial minúscula.

Correções de “Nó Faltando”

Encontrei três tipos de “nó faltando” durante os testes. Nenhum foi dramático, mas quebraram o fluxo.

- Extensão não carregada: Certifique-se de que a pasta LTXVideo fica em

ComfyUI/custom_nodese que tem um__init__.py. Reinicie ComfyUI. Se o log mostrar erros de importação, reinstale requisitos para aquele nó. - Deriva de dependência: Incompatibilidades de Torch/CUDA aparecem como erros de importação. Alinhe versões de PyTorch e CUDA listadas no README da extensão. Um venv fresco é mais rápido do que depurar um emaranhado.

- Fluxos de trabalho antigos, nós novos: Alguns gráficos referenciam nós renomeados. Abra o JSON, procure pela classe de nó, e mapeie para o novo nome. CHANGELOGs da extensão geralmente anotam estes.

Verificações rápidas de sanidade:

- Atualize ComfyUI-Manager, depois “scan for updates.”

- Limpe o cache de ComfyUI e reinicie.

- Confirme caminhos de modelo no nó de carregamento, um checkpoint faltando parece exatamente como um nó faltando do ponto de vista da UI.

Aplique Estes Fluxos de Trabalho no WaveSpeed

Tentei uma execução em nuvem para ver como isso se traduz longe da minha mesa. No WaveSpeed, criei um workspace ComfyUI com uma GPU classe RTX e deixei cair a extensão LTXVideo do mesmo jeito.

Duas notas se você seguir esta rota:

Duas notas se você seguir esta rota:

- Mantenha seus modelos organizados: Sincronizei checkpoints LTX-Video e LoRAs nas pastas esperadas (

models/ltxvideo,models/loras) primeiro, depois abri os gráficos de exemplo. Confie em mim, sem surpresas uma vez que os caminhos coincidiram. - Comprimentos de execução: Uma GPU em nuvem me deixou testar clipes de 12–16 segundos em resolução mais alta sem suar VRAM. Não corrigiu a deriva por si só, mas tornou a iteração mais rápida, eu poderia renderizar três tomadas em paralelo e escolher a vencedora.

Se você está trabalhando em um laptop, esta é uma maneira sem estresse de testar ideias antes de se comprometer com instalações locais. Sua quilometragem pode variar, mas me poupou alguns loops de compilação da madrugada.

O pequeno pensamento persistente: LTXVideo dentro de ComfyUI não tenta impressioná-lo desde o início. Apenas reduz o número de coisas que você tem que manter em sua mente de uma vez. Em dias ocupados, isso é o suficiente.