WaveSpeedAI X DataCrunch: B200에서 FLUX 실시간 이미지 추론

WaveSpeedAI X DataCrunch: B200에서 FLUX 실시간 이미지 추론

WaveSpeedAI는 유럽의 GPU 클라우드 제공업체 DataCrunch와 협력하여 생성형 이미지 및 비디오 모델 배포에서 획기적인 성과를 달성했습니다. DataCrunch의 최첨단 NVIDIA B200 GPU에서 오픈 소스 FLUX-dev 모델을 최적화하여, 우리의 협력은 업계 표준 기준과 비교했을 때 최대 6배 빠른 이미지 추론을 제공합니다.

이 게시물에서는 FLUX-dev 모델과 B200 GPU의 기술적 개요를 제공하고, 표준 추론 스택으로 FLUX-dev를 확장할 때의 과제를 논의하며, WaveSpeedAI의 독점 프레임워크가 지연 시간과 비용 효율성을 크게 개선하는 방법을 보여주는 벤치마크 결과를 공유합니다. 엔터프라이즈 ML 팀은 이 WaveSpeedAI + DataCrunch 솔루션이 더 빠른 API 응답과 이미지당 비용 대폭 절감으로 어떻게 이어지는지 알게 될 것입니다 – 실제 AI 애플리케이션을 강화합니다. (WaveSpeedAI는 생성형 AI 추론 가속화를 주도하는 Zeyi Cheng이 설립했습니다.)

이 블로그는 DataCrunch 블로그에도 게시되었습니다.

FLUX-Dev: 최고 수준의 이미지 생성 모델

FLUX-dev는 텍스트-이미지 및 이미지-이미지 생성이 가능한 최고 수준의 오픈 소스 이미지 생성 모델입니다. 이 모델의 기능은 뛰어난 세계 이해도 및 프롬프트 준수(감사하게도 T5 텍스트 인코더 덕분), 스타일 다양성, 복잡한 장면 의미론 및 구성 이해를 포함합니다. 모델 출력 품질은 Midjourney v6.0, DALL·E 3 (HD), SD3-Ultra 같은 인기 있는 폐쇄 소스 모델과 비교했을 때 동등하거나 초과할 수 있습니다. FLUX-dev는 오픈 소스 커뮤니티에서 가장 인기 있는 이미지 생성 모델로 빠르게 성장했으며, 품질, 다재다능함 및 프롬프트 정렬에 새로운 벤치마크를 설정합니다.

FLUX-dev는 흐름 매칭을 사용하며, 모델 아키텍처는 멀티모달 및 병렬 확산 트랜스포머 블록의 하이브리드 아키텍처를 기반으로 합니다. 아키텍처는 120억 개의 매개변수 를 가지고 있으며, 약 33 GB fp16/bf16입니다. 따라서 FLUX-dev는 많은 매개변수 수와 반복적인 확산 프로세스로 인해 계산 집약적입니다. 사용자 경험이 중요한 대규모 추론 시나리오에서는 효율적인 추론이 필수적입니다.

NVIDIA의 Blackwell GPU 아키텍처: B200

Blackwell 아키텍처는 5세대 텐서 코어(fp8, fp4), 텐서 메모리(TMEM) 및 CTA 쌍(2 CTA)과 같은 새로운 기능을 포함합니다.

-

TMEM: 텐서 메모리는 새로운 온칩 메모리 수준이며, 레지스터, 공유 메모리(L1/SMEM) 및 전역 메모리의 기존 계층 구조를 보강합니다. Hopper(예: H100)에서 온칩 데이터는 레지스터(스레드당)와 공유 메모리(스레드 블록당 또는 CTA당)를 통해 관리되었으며, 텐서 메모리 가속기(TMA)를 통해 공유 메모리로의 고속 전송이 있었습니다. Blackwell은 이들을 유지하지만 SM당 256 KB의 SRAM 추가인 TMEM을 텐서 코어 연산 전용으로 추가 합니다. TMEM은 CUDA 커널을 작성하는 방식을 근본적으로 변경하지 않습니다(논리적 알고리즘은 동일함) 하지만 데이터 흐름 최적화 를 위한 새로운 도구를 추가합니다(ThunderKittens Now Optimized for NVIDIA Blackwell GPUs 참조).

-

2CTA (CTA 쌍) 및 클러스터 협력: Blackwell은 또한 CTA 쌍 을 같은 SM에서 두 CTA를 긴밀하게 결합하는 방식으로 소개합니다. CTA 쌍은 본질적으로 크기 2인 클러스터입니다(하나의 SM에서 동시에 예약된 두 스레드 블록, 특수 동기화 기능 포함). Hopper는 최대 8개 또는 16개의 CTA가 DSM을 통해 데이터를 공유할 수 있는 클러스터를 허용하는 반면, Blackwell의 CTA 쌍은 공통 데이터에 대해 텐서 코어를 집합적으로 사용 할 수 있게 합니다. 실제로 Blackwell PTX 모델은 두 CTA가 서로의 TMEM에 액세스하는 텐서 코어 명령을 실행할 수 있도록 합니다.

-

5세대 텐서 코어(fp8, fp4): B200의 텐서 코어는 크기가 더 크며 H100의 텐서 코어보다 약 2배에서 2.5배 빠릅니다. 높은 텐서 코어 활용률은 주요 신세대 하드웨어 속도 향상을 달성하기 위해 중요합니다(Benchmarking and Dissecting the Nvidia Hopper GPU Architecture 참조).

희소성 없는 성능 수치

| 기술 사양 | ||

|---|---|---|

| H100 SXM | HGX B200 | |

| FP16/BF16 | 0.989 PFLOPS | 2.25 PFLOPS |

| INT8 | 1.979 PFLOPS | 4.5 PFLOPS |

| FP8 | 1.979 PFLOPS | 4.5 PFLOPS |

| FP4 | NaN | 9 PFLOPS |

| GPU 메모리 | 80 GB HBM3 | 180GB HBM3E |

| GPU 메모리 대역폭 | 3.35 TB/s | 7.7TB/s |

| GPU당 NVLink 대역폭 | 900GB/s | 1,800GB/s |

GEMM 및 어텐션의 연산자 수준 마이크로벤치마킹에서 다음을 보여줍니다:

- BF16 및 FP8 cuBLAS, CUTLASS GEMM 커널: H100의 cuBLAS GEMM보다 최대 2배 빠름;

- 어텐션: cuDNN 속도는 H100의 FA3보다 2배 빠름.

벤치마킹 결과는 B200이 특히 높은 메모리 처리량과 밀집 컴퓨팅을 필요로 하는 생성형 모델을 포함하여 대규모 AI 워크로드에 매우 적합함을 시사합니다.

표준 추론 스택의 과제

H100 같은 고사양 GPU에서도 일반적인 추론 파이프라인(예: PyTorch + Hugging Face Diffusers)에서 FLUX-dev를 실행하는 것은 여러 과제를 제시합니다:

- CPU-GPU 오버헤드 및 커널 융합 부족으로 인한 이미지당 높은 지연 시간;

- 최적화되지 않은 GPU 활용 및 유휴 텐서 코어;

- 반복적인 확산 단계 동안 메모리 및 대역폭 병목 현상.

대규모 및 저비용 추론 제공의 최적화 목표는 처리량 향상 및 지연 시간 감소 이며, 이미지 생성 비용을 줄입니다.

WaveSpeedAI의 독점 추론 프레임워크

WaveSpeedAI는 생성형 추론을 위해 특별히 개발한 독점 프레임워크로 이러한 병목 현상을 해결합니다. 설립자 Zeyi Cheng이 개발한 이 프레임워크는 FLUX-dev 및 Wan 2.1 과 같은 최고 수준의 확산 트랜스포머 모델을 위해 특별히 최적화된 사내 고성능 추론 엔진입니다. 추론 엔진의 주요 혁신 사항:

- 엔드-투-엔드 GPU 실행 으로 CPU 병목 현상 제거;

- 최적화된 실행을 위한 맞춤형 CUDA 커널 및 ** 커널 융합**;

- 고급 양자화 및 혼합 정밀도(BF16/FP8) 를 Blackwell 트랜스포머 엔진 사용하면서 최고 정밀도 유지;

- 최적화된 메모리 계획 및 사전 할당;

- 지연 시간 우선 스케줄링 메커니즘 으로 배치 깊이보다 속도 우선.

우리의 추론 엔진은 HW-SW 협설계를 따르며, B200의 컴퓨팅 및 메모리 용량을 완전히 활용합니다. 이는 AI 모델 서빙의 상당한 도약을 나타내며, 프로덕션 규모에서 매우 낮은 지연 시간과 높은 효율성의 추론을 제공할 수 있게 합니다. 우리는 이러한 최적화가 출력 품질에 미치는 영향을 평가하며, 손실 없는 대 느슨한 최적화를 우선시합니다. 즉, 모델 기능을 크게 줄이거나 텍스트 렌더링 및 장면 의미론처럼 표시되는 출력 품질을 완전히 붕괴시킬 수 있는 최적화를 적용하지 않습니다.

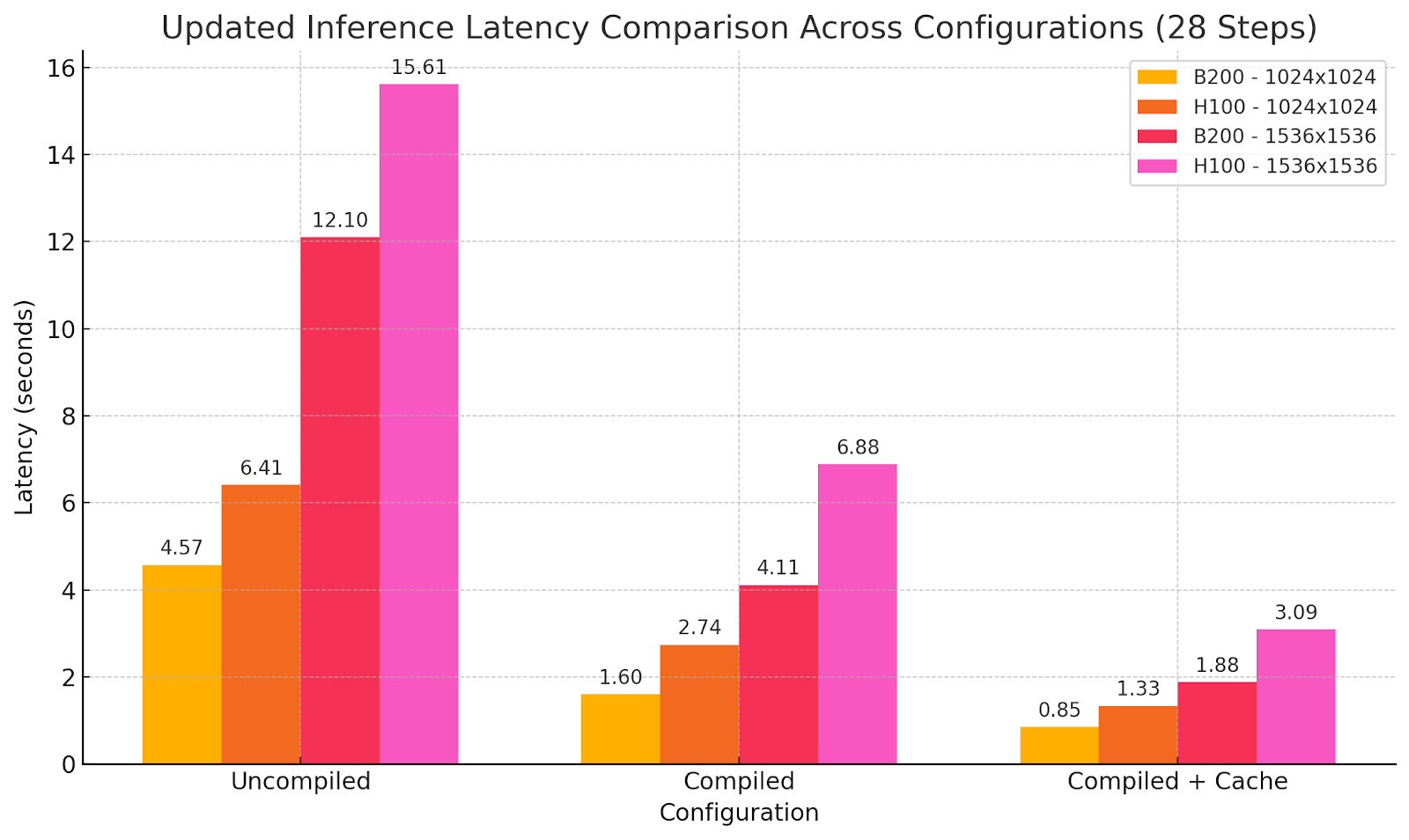

벤치마크: B200의 WaveSpeedAI와 H100 기준 비교

다양한 최적화 설정을 사용한 모델 출력:

프롬프트: 오렌지색 반다나, 밝은 갈색 긴 머리, 맑은 틀 안경, 중격 피어싱을 한 대체 여성의 사진 [오류], 어깨에서 떨어져 있는 베이지색 오버올, 속에 흰색 튜브탑, 그녀는 보헤미안 러그 위 아파트에 앉아 있습니다, 보그 매거진 촬영 스타일로

함의

성능 개선은 다음으로 이어집니다:

- AI 알고리즘 설계(예: DiT 활성화 캐싱) 및 ** 시스템 최적화**, GPU 아키텍처 튜닝 커널 사용, 더 나은 HW 활용도;

- 추론 지연 시간 감소 로 새로운 가능성 활성화(예: 확산 모델의 테스트 타임 컴퓨팅);

- 향상된 효율성 및 감소된 하드웨어 활용로 인한 이미지당 낮은 비용.

우리는 B200 동일 H100 비용-성능 비율이지만 절반의 생성 지연 시간 을 달성했습니다. 따라서 생성당 비용은 증가하지 않으면서 이제 모델 기능을 희생하지 않고 새로운 실시간 가능성을 활성화합니다. 때때로 더 많은 것이 더 많은 것이 아니라 다른 것이며, 여기서 우리는 새로운 성능 단계를 달성했고, 최고 수준의 모델을 사용하는 이미지 생성에서 새로운 수준의 사용자 경험을 제공합니다.

이는 반응성이 뛰어난 창의적 도구, 확장 가능한 콘텐츠 플랫폼 및 규모에서 생성형 AI를 위한 지속 가능한 비용 구조를 가능하게 합니다.

결론 및 다음 단계

B200 배포를 사용한 FLUX-dev는 세계 수준의 하드웨어가 최고 수준의 소프트웨어를 만날 때 무엇이 가능한지를 보여줍니다. 우리는 WaveSpeedAI에서 추론 속도와 효율성의 경계를 밀어붙이고 있으며, stable-fast, ParaAttention 및 사내 추론 엔진의 창시자인 Zeyi Cheng이 설립했습니다. 다음 릴리스에서는 효율적인 비디오 생성 추론과 거의 실시간 추론을 달성하는 방법에 중점을 둘 것입니다. DataCrunch와의 파트너십은 B200 같은 최첨단 GPU와 곧 출시될 NVIDIA GB200 NVL72(DataCrunch에서 NVL72 GB200 클러스터 사전 주문)에 액세스하면서 중요한 추론 인프라 스택을 함께 개발할 기회를 나타냅니다.”

오늘 시작하세요:

세계에서 가장 빠른 생성형 추론 인프라 구축에 동참하세요.