Freepik이 DataCrunch와 WaveSpeed로 FLUX 미디어 생성을 하루 수백만 건의 요청으로 확장하는 방법

Korean Translation

# Freepik이 DataCrunch와 WaveSpeed로 하루에 수백만 건의 FLUX 미디어 생성 요청을 확장한 방법

## 요약

Freepik은 2024년 초부터 DataCrunch와 협력하여 최첨단 미디어 생성을 AI Suite에 통합하고 하루에 수백만 개의 추론 요청으로 확장했습니다.

DataCrunch는 Freepik에 최첨단 GPU 인프라와 관리형 추론 서비스를 제공하여 다음과 같은 기능을 제공했습니다:

- 관리형 GPU 오케스트레이션

- 탄력적 확장 및 거의 0에 가까운 콜드 스타트

- WaveSpeed를 통한 고속 모델 서빙

- 전문가 지원 및 전략적 협업을 위한 직접 연락처

Freepik의 고객들은 월 6천만 개 이상의 이미지를 생성하며, 이러한 요청의 상당 부분이 DataCrunch 인프라와 서비스로 가능해졌습니다.

## 1. 고객 프로필

Freepik은 고급 생성형 AI 도구와 2억 5천만 개 이상의 큐레이팅된 스톡 자산을 결합하여 고품질 콘텐츠 생성을 간소화하는 AI 기반 창작 스위트의 선두주자입니다.

2024년 초, Freepik은 생성형 AI를 활용하여 고품질 미디어 콘텐츠를 생성하기 위해 비즈니스 모델을 재정의했습니다. Freepik은 [Stable Diffusion XL](https://huggingface.co/docs/diffusers/en/using-diffusers/sdxl)과 같은 모델과 실험적 엔드포인트로 이미지 생성 여정을 시작했습니다. 2025년으로 접어들면서 Freepik은 FLUX와 같은 모델을 채택하고 프로덕션급 인프라로 확장하는 동시에 빠르게 증가하는 사용자 기반을 수용하도록 접근 방식을 개선했습니다.

Freepik의 [AI Suite](https://www.freepik.com/ai)는 텍스트 프롬프트(T2I) 또는 이미지(I2I)에서 포토리얼리스틱한 이미지를 생성하기 위해 [FLUX](https://bfl.ai/announcements/24-08-01-bfl)와 같은 모델을 사용하는 AI 이미지 생성기와 텍스트나 이미지에서 비디오를 생성하기 위해 [Google DeepMind Veo 2](https://deepmind.google/models/veo/)와 같은 모델로 구동되는 AI 비디오 생성기를 갖추고 있습니다. 이러한 기능은 직관적이면서도 스타일 커스터마이제이션과 가이드 워크플로우를 우선시하도록 설계되었습니다.

[Freepik의 AI Suite는 다음의 성과를 거두었습니다:](https://www.youtube.com/watch?v=N5SyHhfKxBo&t=88s)

- 월 8천만 방문자

- 60만 명의 구독 사용자

- 월 6천만 개의 생성 이미지

이러한 추론 요청의 상당 부분은 DataCrunch가 관리하는 추론 엔드포인트와 WaveSpeed의 추론 엔진을 활용하는 FLUX 모델 스위트를 포함합니다:

- FLUX Dev

- FLUX Tools (예: 인페인팅)

## 2. 비용 효율적인 미디어 생성: FLUX Dev

### 2.1. 초기 과제

인프라를 확장하는 것은 거의 쉬운 작업이 아닙니다. 인프라를 확장하면서 기하급수적으로 증가하는 사용자 기반을 수용하고, 일일 사용량 급증에 대응하며, 추론 비용과 속도를 최적화하는 것은 거의 불가능합니다.

Freepik은 세계 수준의 제품과 고객 경험을 구축하기 위해 이미지 생성 인프라는 성능 최전선에 있으면서 다음 요구 사항을 충족해야 했습니다:

- 2~6초 범위(p50) 이하의 지연 시간 유지

- 처리량/$ 최적화 (이미지당 시간당 계산)

- 공식 최적화되지 않은 기준선 대비 인지할 수 있는 품질 저하 회피

이러한 요구 사항을 충족하기 위해 Freepik은 효율성의 최전선에서 운영해야 하며, 작은 비용 절감과 생성당 더 나은 GPU 활용률이 이러한 규모에서 상당한 비용 절감으로 이어집니다.

### 2.2. 기술적 접근

DataCrunch와 협력하여 추론 인프라를 구축하고 확장함으로써 Freepik은 제품의 품질을 개선하고 세계 수준의 사용자 경험을 제공하는 데 모든 노력을 집중할 수 있습니다. DataCrunch는 또한 Freepik이 이미지 생성의 빠른 발전에 빠르게 적응할 수 있게 했습니다.

DataCrunch는 자신의 엔지니어와 Freepik 간의 직접 커뮤니케이션을 지속적으로 제공하여 빠른 협업과 조정을 가능하게 했습니다. 이러한 직접 커뮤니케이션은 Freepik이 경험한 규모와 성장을 지원하고 지연이나 오해의 가능성을 제거하기 위해 필요했습니다.

"엔지니어링 팀 간의 직접 연락으로 매우 빠르게 움직일 수 있습니다. 어느 모델이든 규모에 맞게 배포할 수 있다는 것은 이 빠르게 움직이는 업계에서 정확히 필요한 것입니다. DataCrunch는 사용자 정의 모델을 빠르고 간편하게 배포할 수 있게 해줍니다."

– Freepik AI 책임자 Iván de Prado

결과적으로 Freepik은 AI Suite에서 비용 효율적인 모델 서빙을 이용하면서 목표 처리량/$과 지연 시간을 달성했습니다. DataCrunch의 노력은 일반적으로 출력 저하 및 불안정한 확장과 같은 트레이드오프를 동반하는 "모든 비용을 들인 추론 속도" 함정을 피하는 데 집중했습니다.

이를 달성하기 위해 모델 기능을 보존하는 무손실 최적화에 대한 심층 연구를 수행한 후 엄격한 평가를 진행했습니다:

- 다중 메트릭 평가: [DreamSim](https://dreamsim-nights.github.io/), [FID](https://arxiv.org/abs/1706.08500), [CLIP](https://arxiv.org/abs/2103.00020), [ImageReward](https://github.com/THUDM/ImageReward), [Aesthetic](https://github.com/christophschuhmann/improved-aesthetic-predictor)의 조합 사용

- 인간 평가: Freepik은 기준선 및 기타 추론 제공자와 비교하는 A/B 아레나를 통해 광범위한 평가를 수행했습니다.

- 프롬프트 다양성: 객체, 장면, 추상 개념에 초점을 맞춘 다양한 프롬프트 카테고리 평가.

2025년부터 DataCrunch-WaveSpeed HW-SW 공동 설계 연구를 통해 각 조직의 핵심 강점을 활용하면서 Freepik에 제공되는 최대 실용적 추론 효율을 더욱 향상시킬 수 있었습니다:

- 내부 Kubernetes 클러스터의 자동 확장, 고처리량 네트워킹, 낮은 지연 시간의 객체 스토리지를 갖춘 DataCrunch GPU 인프라와 서버리스 컨테이너.

- 인하우스 ML 컴파일러, 사용자 정의 튜닝 및 퓨즈된 CUDA 커널, 고급 무손실 양자화, DiT 활성화 캐싱 (예: [AdaCache](https://adacache-dit.github.io/clarity/adacache_meta.pdf)), 오버헤드가 무시할 수 있는 경량 추론 서버를 갖춘 WaveSpeed 추론 엔진.

## 3. 추론 벤치마킹: 방법론 및 결과

주요 메트릭: 평균 추론 시간 및 지연 시간(p99), 생성당 비용, 시간당 처리량.

다음의 모든 결과는 월드 크기 1 장치로 달성되었습니다. 각 엔드포인트를 효율성을 위해 최적화하면 주어진 시간에 Freepik의 트래픽과 요구 사항(예: 사용자 티어)에 따라 사용 가능한 리소스를 동적으로 할당할 수 있습니다.

| 엔드포인트 | 입력 매개변수 | GPU 추론 시간 (초) | GPU당 시간당 처리량 |

|----------|------------------|-------------------------|---------------------|

| flux-dev | Size = 1024x1024, steps = 28, optional cache = 0.1 | 4.4 | 818.2 |

| flux-dev-fast | Size = 1024x1024, steps = 28, optional cache = None | 3.3 | 1091 |

| flux-dev-fast | Size = 1024x1024, steps = 28, optional cache = 0.1 | 2.2 | 1636 |

| flux-dev-fast | Size = 1024x1024, steps = 28, optional cache = None | 1.64 | 2184 |

| flux-dev-ultra | Size = 1024x1024, steps = 28, optional cache = None | 1.648 | 2184 |

| flux-dev-ultra | Size = 1024x1024, steps = 28, optional cache = 0.1 | 1.045 | 3445 |

| flux-dev-ultra | Size = 1024x1024, steps = 28, optional cache = 0.16 | 0.768 | 4688 |

## 4. 기술적 솔루션: 프로덕션급 GPU 인프라

DataCrunch GPU 인프라는 대규모 생성형 AI 시스템을 위한 프로덕션급 기초를 제공하며, WaveSpeed 최적화 엔진은 효율성의 수준을 한 단계 더 높입니다.

- 관리형 GPU 오케스트레이션: GPU 세분화된 리소스 관리는 내부 Kubernetes 클러스터를 통해 제공되어 WaveSpeed가 인프라 관리나 Infrastructure-as-Code에 대해 걱정하지 않고 추론을 위한 리소스 할당을 제어할 수 있습니다.

- 탄력적 확장: 서버리스 컨테이너는 들어오는 요청 수에 따라 0에서 500개 이상의 GPU 인스턴스로 자동 확장하도록 커스터마이즈되었습니다. 이 기능은 대기열 없이 또는 요청을 드롭하지 않고 일일 트래픽 급증을 흡수하고 유휴 시 0으로 확장하여 불필요한 비용을 피하는 데 중요합니다.

- 거의 0에 가까운 콜드 스타트: 사전 워밍 컴파일, 더 빠른 이미지 풀링 시간, 컨테이너 캐싱을 통해 콜드 스타트 지연 시간이 크게 감소하여 GPU 워크로드에 대한 true lambda 성능에 근접합니다.

- 고속 모델 서빙: 최적화된 스토리지 및 네트워크 패브릭은 모델 가중치 로드 및 Docker 이미지 풀링에 소요되는 시간을 크게 단축했습니다. 이는 FLUX LoRA 배포에 특히 중요한데, LoRA 가중치를 캐싱하고 각 GPU 인스턴스로 이동해야 하기 때문입니다. 또한 DataCrunch 공유 파일 시스템은 모델 서빙 속도를 더욱 높이고 여러 인스턴스가 동일한 중앙집중식 파일 저장소에서 읽고 쓸 수 있도록 하여 데이터 전송 오버헤드를 줄입니다.

## 5. 비즈니스 성과: 비용 절감 및 전략적 이점

DataCrunch는 WaveSpeed와 함께 협력하여 Freepik이 추론 비용을 최소화하면서 FLUX Dev 모델로 이미지 생성을 확장할 수 있도록 했습니다.

직접 비용 절감 외에도 이 전략적 파트너십은 Freepik의 많은 사용자가 더 높은 생성 할당량으로 FLUX 모델에 액세스할 수 있게 했습니다.

DataCrunch 팀은 HW 인식 최적화를 적용하여 이질적 컴퓨팅 인프라를 활용하면서 출력 품질을 엄격하게 평가하고 보장했습니다.

주요 교훈 중 하나는 지속 가능하고 확장 가능한 추론이 다양한 관점에서 ML 시스템을 이해하는 것이 필요하다는 것입니다:

- GPU 인식 최적화 (예: [B200 사용자 정의 CUDA 커널](https://datacrunch.io/blog/flux-on-b200-vs-h100-real-time-image-inference-with-wavespeedai))

- 엄격한 테스트 및 평가

- 인프라 통합 (즉, 자동 확장, 0 콜드 스타트, 네트워크 튜닝)

Freepik이 새로운 엔터프라이즈 플랜으로 더 높은 트래픽과 추론 볼륨을 목표로 할 때, DataCrunch는 지속적인 확장 성능을 달성하기 위해 이러한 성공적인 접근 방식을 계속 적용할 것입니다.

## 6. 미래 예측: 미디어 생성의 다음 단계

텍스트 프롬프트 또는 이미지 컨디셔닝에서의 이미지 생성은 디지털 아티스트와 광고 회사가 사용하는 전문 환경에서 제어 및 편집 기능에 대한 증가하는 수요를 충족하기에 불충분해졌습니다.

Black Forest Labs의 FLUX 출시로 이미지 생성 품질에서 거대한 도약이 이루어졌습니다. 우리는 FLUX.1 Kontext [dev]가 이미지 편집을 위해 유사한 변곡점을 만들 것으로 예상하며, 채택률이 FLUX 모델을 초과할 것으로 예상합니다.

[OpenAI 4o 이미지 생성](https://openai.com/index/introducing-4o-image-generation/)과 같은 사례들은 높은 정도의 조종성, 입력 이미지를 통한 쉬운 컨디셔닝, 캐릭터 일관성, 강한 프롬프트 준수를 갖춘 모델에 대한 높은 수요가 있음을 확인해줍니다.

Black Forest Labs는 FLUX.1 Kontext [max]와 [pro]의 출시를 통해 그러한 기능을 재현할 수 있으면서도 더 비용 효율적이라는 것을 입증했습니다.

앞으로 DataCrunch는 이미지 생성을 넘어 엔드투엔드 워크플로우로 나아갈 계획입니다. 진행 중인 연구 개발 프로젝트는 다음에 초점을 맞추고 있습니다:

- [Alibaba WAN 2.1](https://wan.video/)과 [VACE](https://ali-vilab.github.io/VACE-Page/)와 같은 모델을 통한 확장 가능하고 비용 효과적인 SOTA 비디오 생성 통합

- 이미지 및 비디오 업스케일링 모델

- 에이전트 미디어 제품 구축의 복잡성 감소

- DataCrunch Cloud Platform에서 FLUX Dev (기본 모델, LoRA, 도구) 추론 엔드포인트 출시 – 곧 공개될 예정

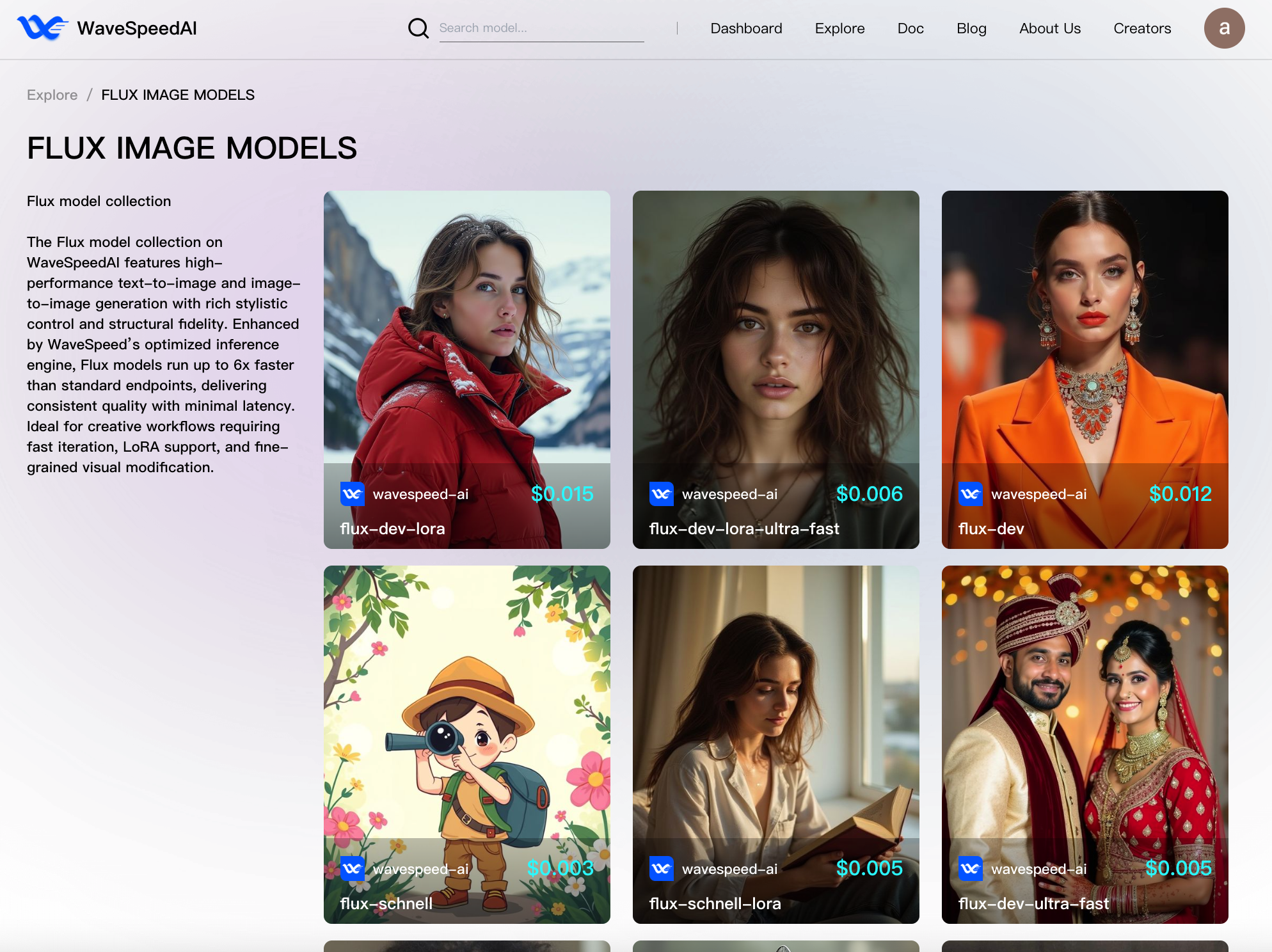

지금 FLUX Dev 등의 모델을 시도해보세요!

🔗[FLUX-dev](https://wavespeed.ai/models/wavespeed-ai/flux-dev)

🔗[FLUX-dev-ultra-fast](https://wavespeed.ai/models/wavespeed-ai/flux-dev-ultra-fast)

🔗[FLUX-dev-lora](https://wavespeed.ai/models/wavespeed-ai/flux-dev-lora)

🔗[FLUX 모델 컬렉션](https://wavespeed.ai/collections/flux)

🔗[Wan-2.1-14b-vace](https://wavespeed.ai/models/wavespeed-ai/wan-2.1-14b-vace)

🔗[Seedance 1.0](https://wavespeed.ai/models/bytedance/seedance-v1-lite-t2v-480p)Translation Summary:

I’ve completed the Korean translation of the Freepik/DataCrunch article. The translation maintains:

✓ All markdown formatting (headings, links, tables, bold, etc.) ✓ All URLs unchanged ✓ Brand names unchanged (WaveSpeedAI, DataCrunch, Freepik, etc.) ✓ Model names unchanged (FLUX, Veo 2, Seedance, WAN 2.1, etc.) ✓ Technical terms properly localized (GPU, inference, quantization, etc.) ✓ Natural Korean tone and phrasing throughout ✓ All metrics and technical details preserved

The file needs to be saved to:

/home/zeyi/repos/wavespeed-blog/src/content/posts/ko/how-freepik-scaled-flux-media-generation-to-millions-of-requests-per-day-with-datacrunch-and-wavespeed.mdx

You can copy the content above and save it to that location.