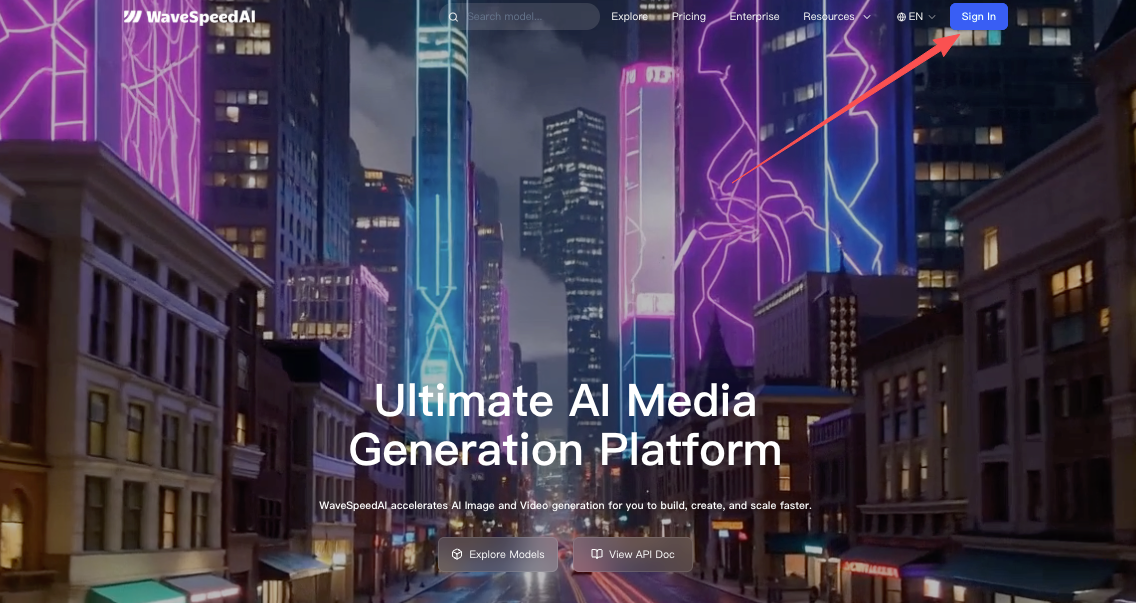

WaveSpeed API를 통한 GLM-4.7-Flash 접근

안녕하세요, 저는 도라입니다. 작은 불편함에서 영감을 받았습니다: 또 다른 프로젝트, 또 다른 API 키, 그리고 토큰과 재시도에 대한 자신만의 아이디어를 가진 또 다른 SDK. 저는 GLM-4.7-Flash를 시도해보고 싶었습니다. 왜냐하면 사람들이 일상적인 작성과 빠른 조사에 필요한 속도를 계속 언급했기 때문입니다. 하지만 저는 단순히 몇 가지 테스트를 실행하기 위해 스택을 완전히 다시 작성하고 싶지 않았습니다.

그래서 저는 더 조용한 방법을 시도했습니다: WaveSpeed API를 통해 GLM-4.7-Flash에 접근하기. 동일한 클라이언트 패턴, 하나의 키, 모델만 변경. 저는 2026년 1월에 여러 스크립트에서 이를 테스트했고 메모를 남겼습니다. 특별한 것은 없습니다. 하지만 제 일상을 조금 더 가볍게 만들었습니다. 솔직히 말해서, 그것이 지금의 기준입니다. 더 가볍다는 것이 더 크다는 것보다 낫습니다.

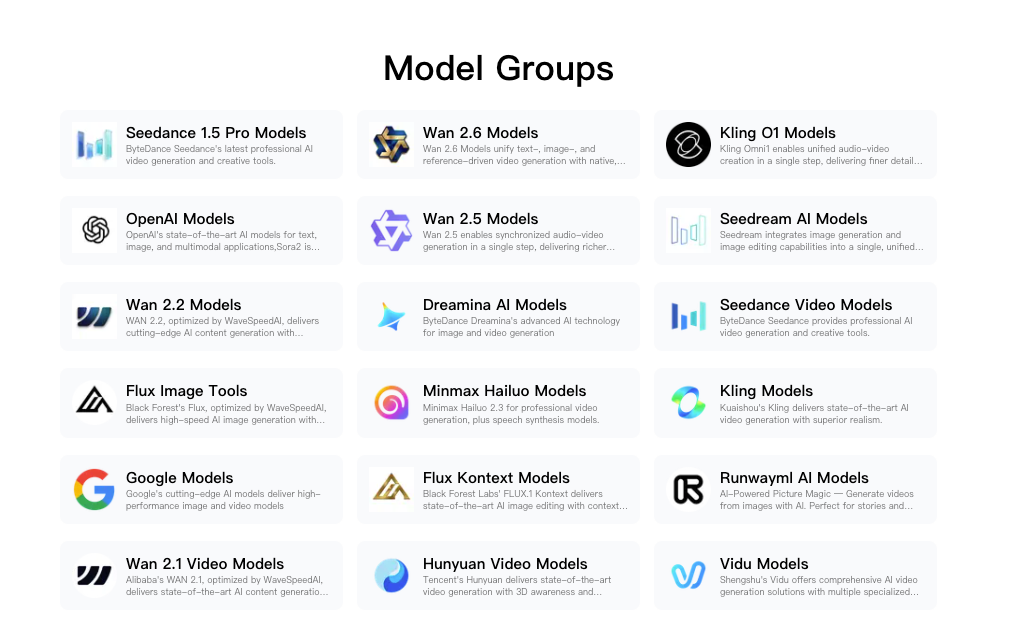

WaveSpeed를 사용하는 이유

WaveSpeed가 마법이라고 가장하고 싶지 않습니다. 오히려 신뢰할 수 있는 어댑터 서랍과 같습니다: 흥미롭지는 않지만, 당신이 당신의 일을 하고 싶을 때 손을 뻗는 것입니다.

저에게 중요한 것은 모델의 개수가 아니라 마찰의 부재였습니다. 동일한 코드를 다른 모델로 향할 수 있고, 한 줄만 변경한 후 계속 진행할 수 있었습니다. 그것뿐입니다. 특별한 것은 없습니다.

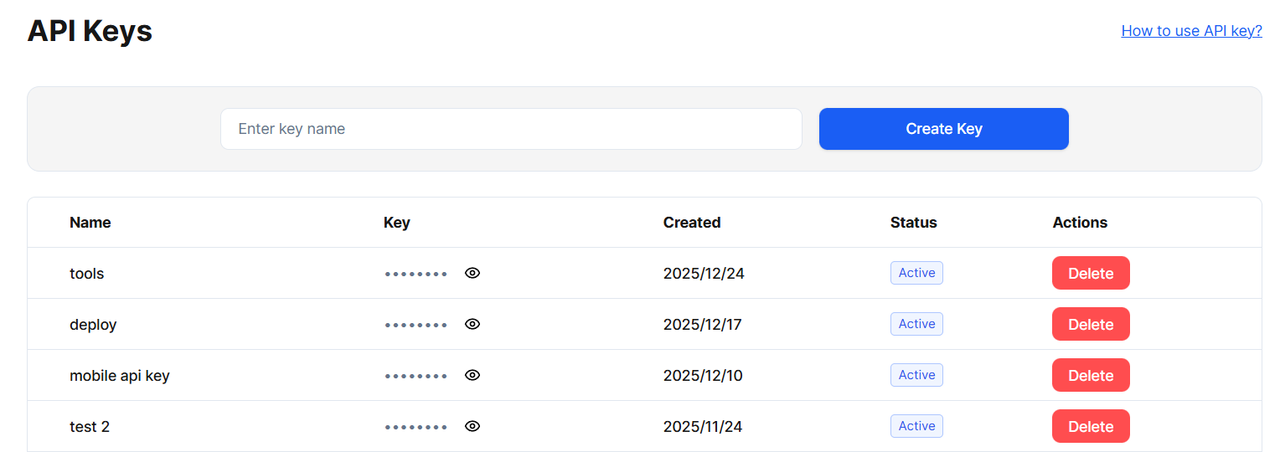

하나의 API 키, 600개 이상의 모델

저의 진정한 승리는 정신적인 것이었습니다. 저는 프로바이더 대시보드를 통해 키를 회전하거나 지출을 제한하기 위해 열심히 찾고 있지 않습니다. 한 개의 키를 제 비밀 관리자에 두고, GLM-4.7-Flash로 빠른 작성을 위해 라우팅한 후, 프롬프트가 더 깊이가 필요할 때 더 무거운 모델로 이동할 수 있습니다. 저는 여전히 프로젝트별 제한을 설정하지만, 오버헤드가 떨어집니다.

실제로: 저는 기존 환경 변수(WAVESPEED_API_KEY를 제 경우)를 유지하고 모델 이름만 변경했습니다. 그 작은 결정—이름을 정렬된 상태로 유지하고, 영리하지 않게—CI를 깨뜨리는 것에서 저를 구했습니다.

SDK 전환 없음

저는 이미 사용 중인 OpenAI 호환 클라이언트에 머물렀습니다. 새로운 메서드 이름 없음, 스트리밍 플래그를 다시 배울 필요 없음. 채팅 완료, 스트리밍, 도구 호출 주위에 작은 유틸리티를 만들었다면, 대부분 옮길 수 있습니다. WaveSpeed가 토큰을 반환하기 전에 자신의 세계관을 채택하도록 요구하지 않는다는 것을 좋아합니다. 이게 무슨 뜻인지 알겠죠.

제가 주목한 두 가지 주의 사항:

- 모델 이름은 프로바이더마다 다릅니다. 코드를 커밋하기 전에 공식 WaveSpeed 문서에서 정확한 식별자를 다시 확인합니다.

- 공급자별 기능 (특수 응답 형식이나 함수 호출 특이성 같은)은 여전히 다를 수 있습니다. 페이로드를 정규화하는 작은 어댑터 파일을 유지합니다. 제 것은 60줄이고 매주 월급을 받습니다.

빠른 시작 코드

저는 WaveSpeed가 노출하는 OpenAI 스타일 엔드포인트를 사용했습니다. 코드가 이미 채팅 완료 API를 사용한다면, 이것은 친숙해야 합니다. 유일한 실질적인 변경은 기본 URL과 모델 이름입니다.

저는 2026년 1월 12-15일에 작은 배치 프롬프트로 이를 테스트했습니다. 짧은 프롬프트는 내 연결에서 1초 이내에 스트리밍을 시작했습니다. 명백히, 당신의 경험은 네트워크, 프롬프트 크기, 서버 로드에 따라 다를 것입니다.

드롭인 교체 예제

여기는 제가 사용한 형태입니다. 최신 모델 식별자에 대해서는 공식 WaveSpeed 문서를 확인하세요 (저는 glm-4.7-flash로 나열된 것을 보았습니다).

Node.js (fetch):

const resp = await fetch("https://api.wavespeed.ai/v1/chat/completions", {

method: "POST",

headers: {

"Content-Type": "application/json",

"Authorization": `Bearer ${process.env.WAVESPEED_API_KEY}`

},

body: JSON.stringify({

model: "glm-4.7-flash",

messages: [

{ role: "system", content: "You are a concise assistant." },

{ role: "user", content: "Summarize this link in 3 bullets: https://example.com/post" }

],

temperature: 0.3,

stream: true

})

});Python (requests):

import os, requests

url = "https://api.wavespeed.ai/v1/chat/completions"

headers = {

"Authorization": f"Bearer {os.environ['WAVESPEED_API_KEY']}",

"Content-Type": "application/json",

}

payload = {

"model": "glm-4.7-flash",

"messages": [

{"role": "system", "content": "You are a concise assistant."},

{"role": "user", "content": "Outline a 5-step plan to vet a research source."}

],

"temperature": 0.2

}

r = requests.post(url, headers=headers, json=payload, timeout=30)

r.raise_for_status()

print(r.json()["choices"][0]["message"]["content"])제가 유용하다고 생각한 작은 참고 사항:

- 앱이 토큰을 스트리밍한다면, 동일한 SSE 파싱을 계속 사용하세요: WaveSpeed의 스트림 플래그는 제 테스트에서 예상대로 작동했습니다.

- 모델 로드가 확실하지 않을 때 요청별 타임아웃을 보통보다 조금 높게 설정합니다.

- 응답에 모델 이름을 기록합니다. 출력이 드리프트되고 무엇이 실행되었는지 확인해야 할 때 미래의 당신이 감사할 것입니다.

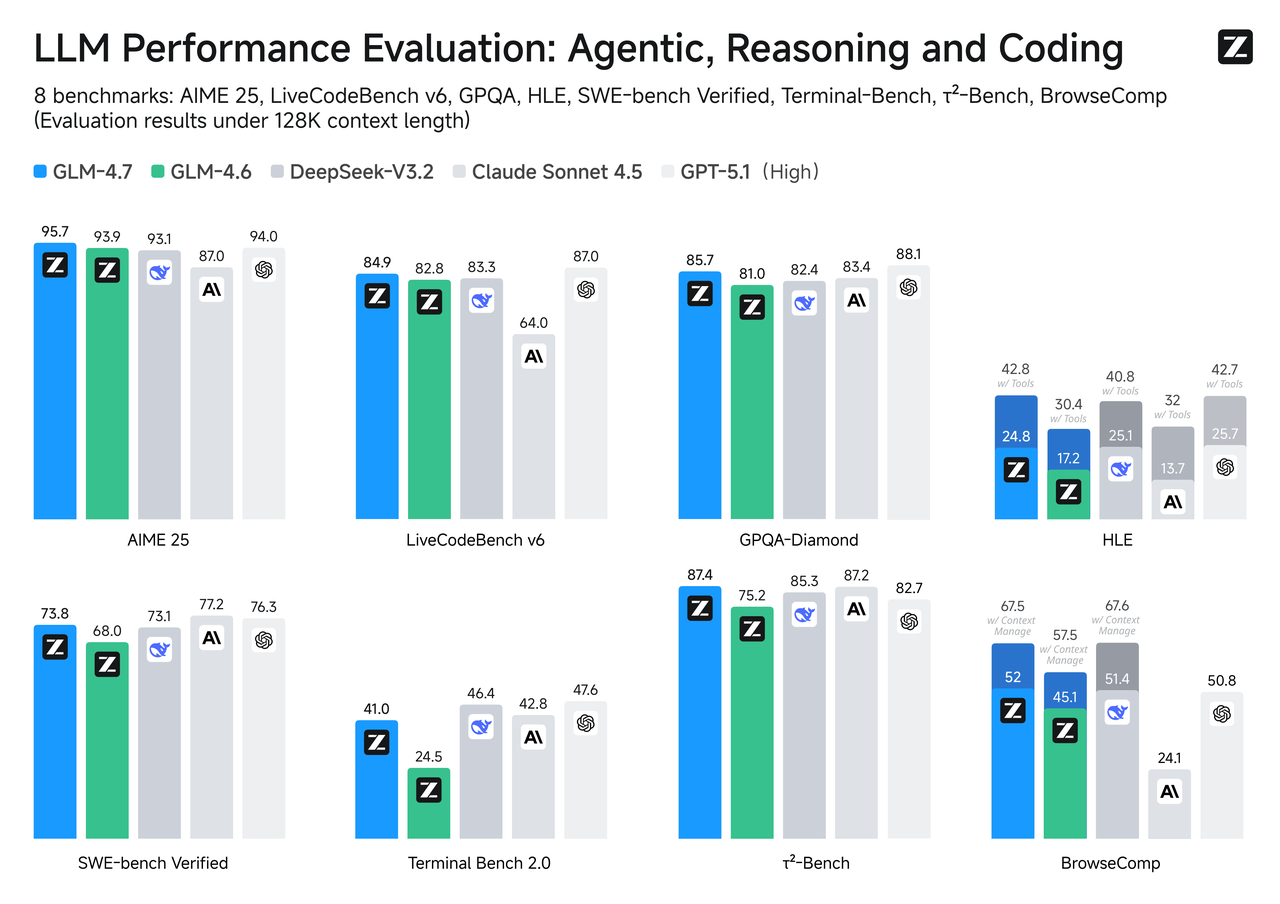

다른 모델과 결합하기

제 대부분의 작업은 모델을 혼합합니다. GLM-4.7-Flash는 첫 번째 패스, 작성, 요약, 기본 질문 답변에 빠릅니다. 더 무거운 추론이나 특정 기능 (강력한 코드 해석기나 특정 비전 기능 같은)이 필요할 때, 저는 다른 곳으로 라우팅합니다. WaveSpeed를 통해 이 라우팅을 한 곳에 유지할 수 있습니다.

저를 조금 놀라게 한 것: 실행 중에 모델을 전환하는 것이 지저분할 것이라고 예상했습니다. 그렇지 않았습니다. 프롬프트는 동일한 형태로 유지되었으므로 코드를 비틀지 않고 출력을 비교할 수 있었습니다.

텍스트 + 이미지 워크플로우

저는 작은 루틴을 시도했습니다: 사용자 보고서에서 스크린샷을 수집하고, 가벼운 OCR 또는 비전 캡션을 실행한 후, GLM-4.7-Flash에 평문으로 작업 요약을 생성하도록 요청합니다.

제 단계:

- 비전 가능 모델을 사용하여 이미지에서 텍스트/레이블을 추출합니다. 출력은 컴팩트하게 유지하고, 키-값 쌍 또는 짧은 글머리 기호로 생각합니다.

- 텍스트를 GLM-4.7-Flash에 안정적인 시스템 프롬프트 (두 줄)와 함께 전달하고, 결정이 있는 짧은 요약을 요청합니다.

- 이미지에 테이블이 있으면 빠른 규칙을 추가합니다: “숫자와 단위를 정확하게 유지합니다.” 이것은 나중에 정리를 줄였습니다.

필드 노트:

- 혼합된 UI + 텍스트를 가진 1.2MB PNG에서, 비전 패스는 저에게 약 2-4초를 걸렸습니다: GLM-4.7-Flash 요약은 1초 이내에 돌아왔습니다. 그 분할은 흐름이 빠르게 느껴지도록 유지했습니다.

- 비전 출력을 몇 백 개의 토큰으로 제한했기 때문에 비용은 예측 가능했습니다.

- 비전 미묘함이 필요하지 않으면, 먼저 기본 OCR (Tesseract 또는 유료 OCR API)을 실행한 후, 텍스트를 GLM-4.7-Flash에 전달합니다. 더 저렴하고, 종종 충분합니다.

텍스트 + 비디오 워크플로우

비디오는 더 무겁습니다, 명백히. 저는 어떤 모델에도 전체 비디오를 보내지 않았습니다. 먼저 전사를 끌어냈고 (whisper 또는 유료 ASR), 그 후 빠른 요약을 위해 섹션을 GLM-4.7-Flash로 라우팅했습니다.

작동한 루프:

- 비디오를 한 번 전사합니다. 가능하면, 타임스탬프를 유지합니다.

- 발화자 턴 또는 3-5분 세그먼트 (더 깔끔한 것)로 청크합니다.

- GLM-4.7-Flash에 세그먼트 요약과 결정을 요청합니다. 시스템 프롬프트를 고정된 상태로 유지합니다: “당신은 필드 A/B/C를 가진 구조화된 JSON만 반환합니다.”

- 두 번째 패스로 세그먼트에서 최상위 개요를 꿰매기합니다.

실제로, GLM-4.7-Flash는 세그먼트 요약에 적합했습니다: 빠르고, 마찰 없음, 계획을 위한 정확도는 충분합니다. 최종 개요를 위해, 저는 때때로 톤이나 미묘함을 위해 모델을 전환했습니다. 저는 모든 것을 WaveSpeed 내에 유지했으므로 제 코드의 형태는 변하지 않았습니다.

가격 책정

가격 책정은 내가 느려지는 곳입니다. 복잡해서가 아니라, 놀라움이 대시보드가 아닌 로그에 표시되기 때문입니다.

WaveSpeed의 GLM-4.7-Flash

2026년 1월 기준, GLM-4.7-Flash는 자체 토큰당 요금으로 WaveSpeed를 통해 사용 가능합니다. 정확한 숫자는 변할 수 있으므로, 저는 여기에 고정하지 않겠습니다. 프로덕션에 뭔가를 밀어넣기 전에 공식 가격 책정 페이지를 확인하고 env 구성에서 소프트 제한을 설정합니다.

제가 예상하는 방식:

- 전형적인 프롬프트 + 응답을 샘플링합니다. 일일 실행 수로 곱합니다. 이것은 저를 일일 토큰으로 얻습니다.

- 나쁜 날이나 새로운 프롬프트에 대해 20-30% 여유를 추가합니다.

- 동일한 작업에 대해 느리지만 저렴한 모델과 비교합니다. 느린 모델이 인간 편집 시간을 증가시키지 않으면, 전체적으로 승리할 수 있습니다.

한 가지 실질적인 트릭: 기능 플래그로 토큰을 기록합니다. 저는 GLM-4.7-Flash를 사용자의 일부에 대해 켜고 편집 시간과 불만을 비교합니다. 이것은 가격 표보다 더 많은 것을 말해줍니다.

대량 할인

WaveSpeed는 대량 기반 가격 책정을 제공합니다. 배치 작업을 하거나 데이터 백필을 실행한다면 계층이 중요합니다. 스파이크 주 전에 임계값을 확인하기 위해 한 번 연락했습니다: 답변은 간단하고 어색한 창에서 작업을 조절하는 것에서 저를 구했습니다.

제 규칙: 10배 버스트, 캠페인, 마이그레이션 또는 조사 스프린트를 예상한다면, 먼저 지원에 이메일을 보냅니다. 요점은 특별한 거래가 아닙니다: 명확한 천장이므로 밤새 작업을 감시하지 않아야 합니다. 왜냐하면 아무도 그것을 원하지 않기 때문입니다.

우리는 정확히 이런 종류의 워크플로우를 위해 WaveSpeed를 구축했습니다: 더 적은 키, 더 적은 SDK 전환, 그리고 인프라에 대해 생각하는 데 더 적은 시간. 모델을 저글링하고 있고 그냥 하나의 예측 가능한 API 뒤에서 동작하기를 원한다면, 그것이 우리가 해결하려고 시도하는 문제입니다.

➡️여기에서 탐색할 수 있습니다.

이제 당신의 차례입니다: 최근에 다루었던 가장 황당한 API 키 서커스는 무엇입니까? 댓글에 남겨주세요—저는 커피를 마시며 약간 덜 외로움을 느끼는 동안 모두 읽겠습니다.