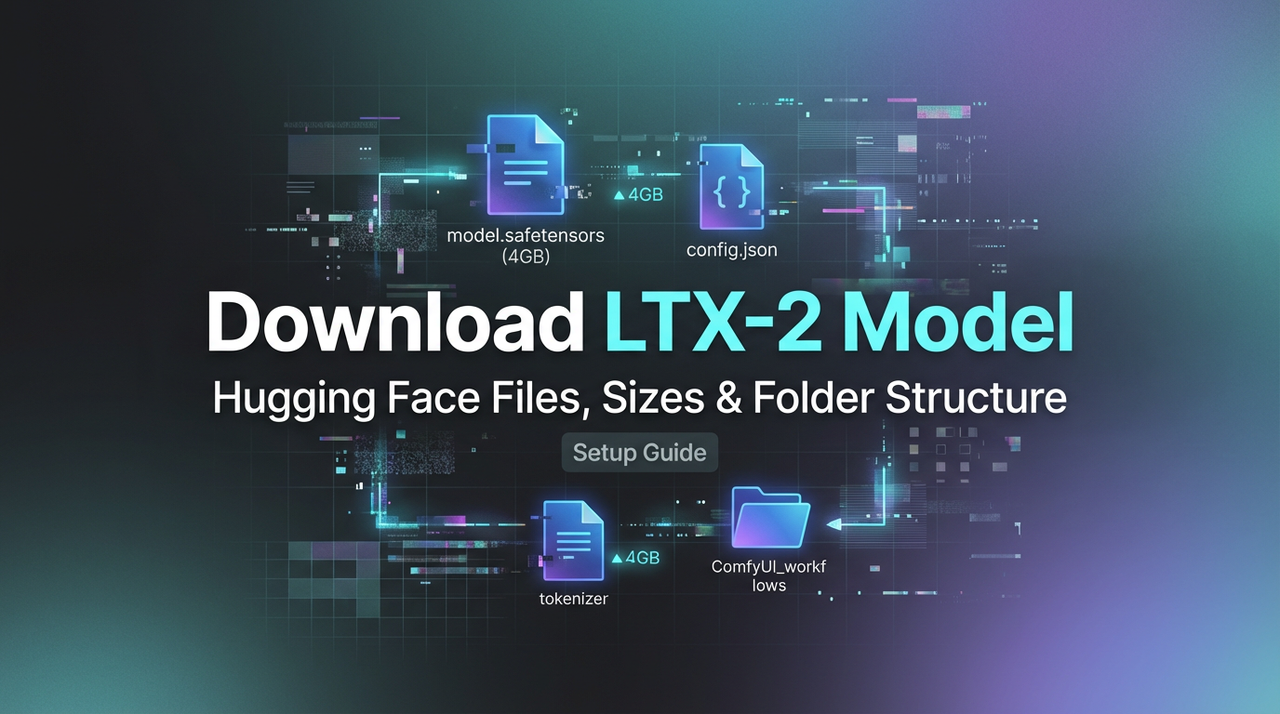

LTX-2 모델 다운로드: Hugging Face 파일, 크기 및 폴더 구조

나는 처음 **LTX-2 다운로드**를 찾으러 나갔을 때, 그리 대대적인 계획을 세우지 않았다. 단지 ComfyUI를 통해 작은 배치를 실행하고 싶었을 뿐인데, 자꾸만 같은 두 가지 마찰에 걸렸다: 92%에서 멈추는 느린 다운로드와 드디어 파일을 받은 후 나타나는 암호 같은 “Model not found” 메시지. 극적이지는 않았다. 그저 워크플로우를 정리하도록 자극하는 반복적인 짜증일 뿐이었다.

2026년 1월 초 저녁 몇 시간을 들여 다양한 소스, 포맷(NVFP4 vs NVFP8), 24GB GPU 상자의 폴더 레이아웃을 테스트했다. 화려한 것은 아니었고, 무엇이 견고하고 무엇이 취약한지 보기 위해 충분히 실행했을 뿐이다. 여기 내 혼란을 줄인 경로가 있으며, 필요하면 훑어보고 빌려갈 수 있는 노트들이다.

공식 LTX-2 다운로드 소스 (Hugging Face 모델 카드)

나는 미러를 쫓지 않는다. 모델이 내 워크플로우에 중요하다면, 경로는 단순하고 신뢰할 수 있어야 한다. LTX-2의 경우, 그것은 공식 Hugging Face 모델 카드에서 시작한다는 뜻이다.

나는 미러를 쫓지 않는다. 모델이 내 워크플로우에 중요하다면, 경로는 단순하고 신뢰할 수 있어야 한다. LTX-2의 경우, 그것은 공식 Hugging Face 모델 카드에서 시작한다는 뜻이다.

다운로드를 클릭하기 전에 나는 다음을 살펴본다:

- 발행자: LTX-2와 연결된 확인된 조직 또는 저자인가? 나는 조직 배지를 확인하고 네임스페이스의 다른 리포지토리들이 활발하고 일관성 있어 보이는지 본다.

- 라이센스 및 약관: 일부 LTX-2 변형은 제한되거나 사용 제한이 있다. 약관 수락에 토큰이 필요하면, 나중에 인증 오류를 디버그하는 것보다 한 번에 하고 싶다.

- 아티팩트 목록: 주 모델, 인코더, 축소 또는 양자화 변형이 있는지 훑어본다. 명확한 파일명이 영리한 파일명보다 낫다.

- 지침: 모델 카드가 ComfyUI나 노드 특정 문서로 연결되면, 먼저 그것을 따른다. 예상 폴더에 대한 한 줄이 30분의 추측을 절약할 수 있다.

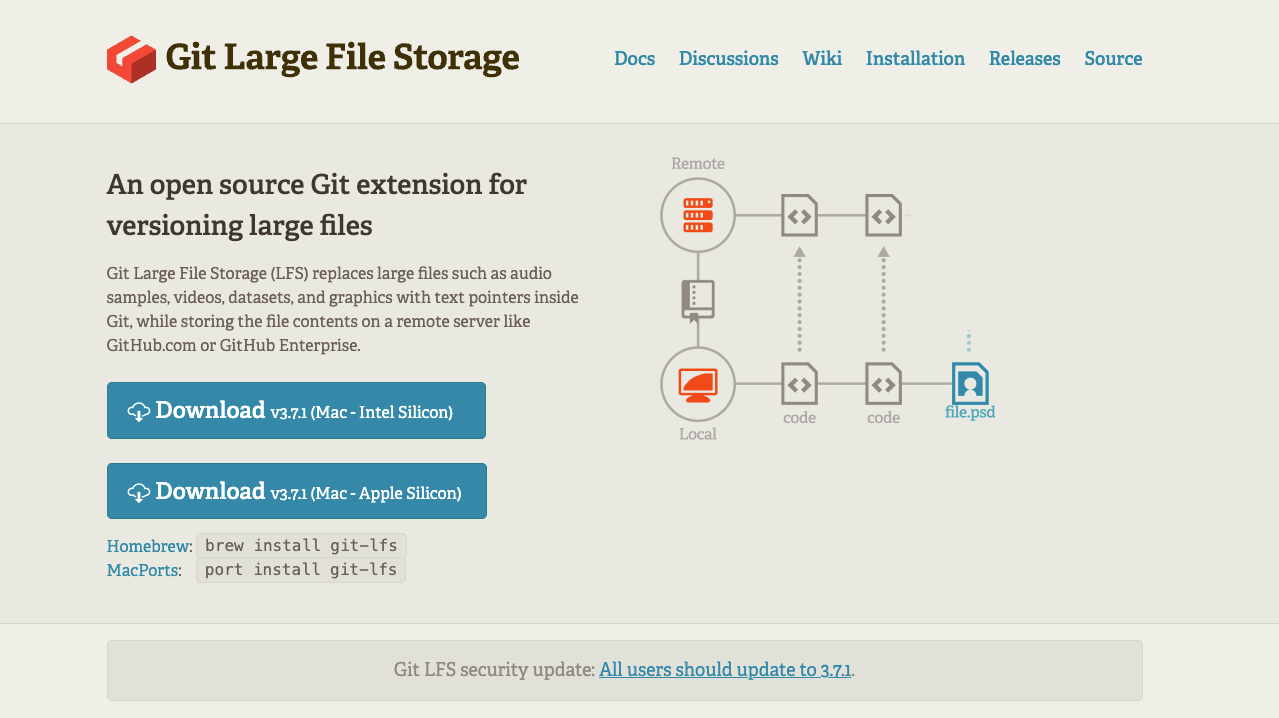

실용적인 팁: 자격 증명이 설정된 상태에서 Hugging Face CLI를 사용하라. 제한된 리포지토리는 토큰 없이 원본 git-lfs를 통해 가져올 수 없으며, 부분 파일과 로드 시도 때까지 오류가 없는 상황으로 끝나는 가장 빠른 방법이다.

pip install huggingface_hub git-lfs

huggingface-cli login # 토큰 붙여넣기나는 알고 있다, 명백하다. 하지만 침묵하는 403이 다운스트림에서 “model not found”로 바뀌는 것을 본 횟수는… 0이 아니다.

파일 목록 및 크기 (주 모델 / 인코더 / 축소)

나는 파일 크기를 외우지 않는다. 나는 단지 디스크를 계획하고 먼저 어떤 변형을 가져올지 결정하기 위한 대략적인 크기가 필요할 뿐이다. 여기 내가 최근 LTX-2 출시에서 실제로 본 것들이다. 네 리포지토리는 다를 수 있으니, 항상 내 노트보다 모델 카드를 신뢰하라.

너가 볼 일반적인 아티팩트:

- 주 모델 체크포인트 (종종

.safetensors또는 런타임 특정 포맷): ~2.5–6.0 GB. 추가 헤드나 다중 정밀도를 포함하면 더 크고; 양자화되면 더 작다. - 텍스트/이미지 인코더 (CLIP 또는 유사): ~400 MB–1.5 GB. 일부 빌드는 이것을 번들링하고; 다른 것들은 별도 파일로 배송한다.

- VAE 또는 레이턴트 어댑터 (해당하는 경우): ~100–500 MB.

- 축소 변형: ~1–3 GB. 더 빠르고 가볍고, 때로 약간 부드러운 출력. 프로토타이핑에 좋다.

- 양자화 변형 (NVFP8/NVFP4): 크기는 다양하지만, 전체 정밀도보다 30–60% 적은 디스크를 예상하라.

내가 주의 깊게 보는 이름 지정 패턴:

ltx-2.safetensors(주)ltx-2-encoder.safetensors또는open_clip-vit-…(인코더)ltx-2-vae.safetensors(별도인 경우)ltx-2-distilled-…(더 작고 빠름)ltx-2-nvfp8/ltx-2-nvfp4(포맷 특정)

디스크가 부족하면, 나는 축소 버전을 먼저 가져오고, 내 파이프라인을 검증한 다음, 전체 모델을 가져온다. 이것은 단지 속도에 관한 것이 아니다: 첫 실행의 인지적 부담을 줄이는 것은 VRAM과 즉시 싸우지 않고도 프롬프트와 노드를 테스트하도록 도와준다.

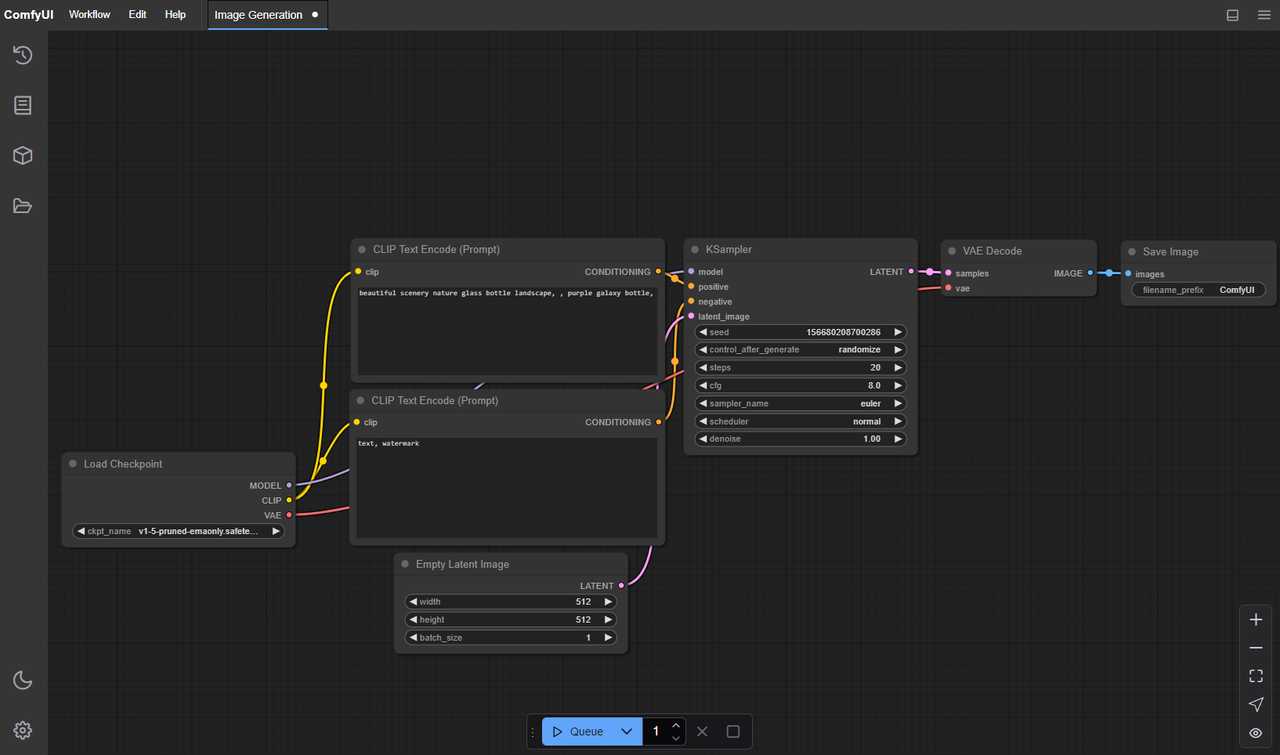

LTX-2를 위한 ComfyUI 폴더 구조 (정확한 경로)

여기가 1일 차에 나를 걸어 넘친 곳이다: 내 파일은 좋았지만, ComfyUI는 어디를 봐야 할지 몰랐다. 다양한 커스텀 노드는 약간 다른 위치를 기대하지만, 아래 기본값은 내게 안전했다.

표준 ComfyUI 설치에서 (커스텀 노드 오버라이드 없음):

- 주 모델 체크포인트:

ComfyUI/models/checkpoints/LTX-2.safetensors - 텍스트/이미지 인코더 (CLIP 또는 유사):

ComfyUI/models/clip/LTX-2-encoder.safetensors- 일부 빌드는 open_clip 이름을 사용한다: 그것들도

models/clip/에 배치하라.

- 일부 빌드는 open_clip 이름을 사용한다: 그것들도

- VAE (별도인 경우):

ComfyUI/models/vae/LTX-2-vae.safetensors - LoRA/패치 (사용하는 경우):

ComfyUI/models/loras/

TensorRT 또는 엔진 파일에 의존하는 노드를 사용하는 경우:

ComfyUI/models/trt/ltx-2/*.engineComfyUI/models/unet/ltx-2/*.engine

지루하지만 유용한 두 가지 습관:

- 파일명을 노드가 기대하는 것과 정확히 일치시켜라. 나는 이름을 짧게 유지하고 공백을 제거한다.

- 파일을 이동한 후, ComfyUI의 모델 새로고침을 사용하거나 다시 시작하라. 핫 리로드는 때때로 작동한다: 완전한 재시작이 더 일관성이 있다.

외부 디스크나 공유 모델 폴더를 사용하는 경우, ComfyUI의 Extra Model Paths를 설정하여 조용히 잘못된 드라이브를 스캔하지 않도록 하라. Linux의 대소문자 민감도는 나를 한 번 이상 물었다.

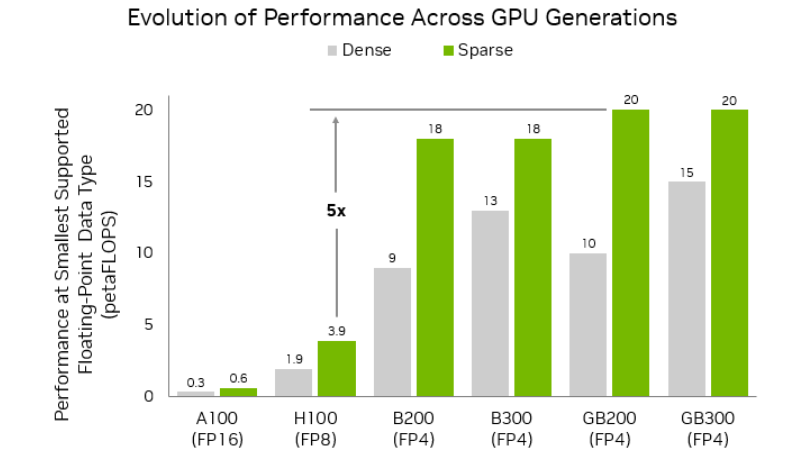

NVFP4 vs NVFP8 가중치: 어떤 것을 다운로드할 것인가

나는 NVFP4가 추가 압축의 가치가 있는지 궁금했다. 짧은 답변: 아마도, VRAM에 쥐어짜고 네 노드가 실제로 지원한다면.

나는 NVFP4가 추가 압축의 가치가 있는지 궁금했다. 짧은 답변: 아마도, VRAM에 쥐어짜고 네 노드가 실제로 지원한다면.

2026년 1월 빌드의 내 상자(Hopper 클래스 GPU)에서 실제 느낌이 이렇다:

NVFP8

- 균형: 좋은 중간 지점. 전체 정밀도보다 눈에 띄게 낮은 메모리, 최소한의 출력 드리프트.

- 호환성: 더 나음. 지금 FP4보다 더 많은 노드와 런타임이 FP8을 수용한다.

- 내가 선택할 때: 최소 풋프린트보다 안정성을 원하는 일상적인 실행.

NVFP4

- 풋프린트: 더 작음. 그것은 내가 FP8이 할 수 없는 곳에서 해상도나 컨텍스트를 한 단계 올릴 수 있게 했다.

- 드리프트: 경계 경우에 약간 더 많은 아티팩트 또는 부드러움. 항상 그런 것은 아니지만, 충분히 그래서 내가 주목한다.

- 호환성: 더 까다로움. 일부 로더는 올바른 커널을 감지하지 않으면 폴백되거나 실패한다.

- 내가 선택할 때: 빠른 초안, 그리드 검색, 또는 워크플로우가 노드의 FP4 경로에 의해 엄격히 지원되는 경우.

또 한 가지: 이 포맷들은 일반적으로 그들을 적절히 가속할 수 있는 NVIDIA 스택에 있다고 가정한다. 노드가 명시적으로 “NVFP4/NVFP8 지원됨”이라고 말하지 않으면, 나는 전체 정밀도 또는 축소 .safetensors 빌드로 기본 설정한다. 미세한 이득을 쫓는 것은 렌더 중간에 신비로운 충돌의 가치가 없다.

LTX-2 다운로드 가속 & 체크섬 검증 팁

나는 큰 모델 풀을 다른 큰 파일 작업처럼 취급한다: 속도를 높이고, 검증한다.

실제로 도움이 된 가속:

- Hugging Face 전송 가속:

HF_HUB_ENABLE_HF_TRANSFER=1환경 변수를huggingface_hub사용 전에 설정하라. 이것은 이용 가능한 경우 그들의 가속 백엔드를 켠다.

병렬 청크용 aria2c:

aria2c -x 16 -s 16 -k 1M -c-c 플래그는 내 연결이 97%에서 딸깍할 때 부분 다운로드를 깔끔하게 다시 시작한다.

git-lfs 튜닝 풀

git lfs install그 다음git clone.- Git LFS 설치 가이드를 따르면서, 거대한 리포지토리인 경우, 때로 내가 사용할 수 없는 예제를 피하기 위해 sparse-checkout을 사용한다.

내가 실제로 하는 검증 (더 이상 건너뛰지 않음)

모델 카드 (또는 리포지토리의 .sha256 파일)에서 SHA256을 로컬 파일과 비교하라.

- macOS/Linux:

shasum -a 256 - Windows:

certutil -hashfile SHA256

파일 크기 상식 확인

- 예상 크기가 4.2 GB이고 3.3 GB가 보이면, 거기서 멈춘다. 부분 파일은 가끔 “로드”되지만, 나중에 쓰레기 오류를 던진다.

작은 습관이 시간을 절약한다: 나는 모델 파일 옆에 출처 URL, 날짜, 해시와 함께 작은 README.txt를 보관한다. 3개월 후에 다시 방문할 때, 나는 내 과거 자아의 선택을 역산할 필요가 없다.

”Model Not Found” 수정

이 오류는 내가 돌아오지 않을 시간을 먹었다. 다음은 실제로 바늘을 움직인 수정들이다:

- 잘못된 폴더: ComfyUI는

models/checkpoints/의 체크포인트,models/clip/의 인코더,models/vae/의 VAE를 기대한다. 다른 곳에 넣으면 스캐너는 무시할 수 있다. - 파일명 불일치: 일부 노드는 특정 기본명을 찾는다. 노드가

ltx-2.safetensors라고 말하면, 그것을LTX-2 (final).safetensors라고 부르지 마라. 나는 적극적으로 이름을 바꾼다. - 대소문자 민감도: Linux에서

ltx-2.safetensors≠LTX-2.safetensors. 내가 어떻게 아는지 묻지 마라. - 캐시 인덱싱: 파일 이동 후 모델을 새로고침하거나 ComfyUI를 다시 시작하라. 인덱스는 항상 실시간이 아니다.

- 누락된 종속성: 노드가 외부 인코더를 기대하고 주 모델만 다운로드했다면, 모호한 오류가 나타난다. 모델 카드에 나열된 인코더를 가져오고 다시 시도하라.

- 토큰 없이 제한된 모델: 로그인하지 않고 복제했으면 (또는 토큰이 만료되었으면), 로컬 파일은 스텁일 수 있다.

huggingface-cli login으로 다시 로그인하고 다시 가져오라. - 커스텀 노드와 대체 경로: 일부 노드는 기본 폴더를 오버라이드한다. 예상 경로나 환경 변수는 README를 확인하라. 의심스러우면, 공유 모델 디렉터리에서 예상 로컬 경로로 심볼릭 링크를 떨어뜨려라.

내가 막혔을 때, 나는 일시적으로 노드를 알려진-좋은, 작은 모델로 가리켜서 로더가 작동하는지 확인한다. 작은 것이 로드되면, 버그는 LTX-2 파일에 있고, 내 환경이 아니다.

WaveSpeed를 사용하여 LTX-2 다운로드 건너뛰기

나는 여행 노트북에서 다른 경로를 시도했다: 로컬 다운로드를 완전히 건너뛰고 WaveSpeed를 통해 LTX-2를 실행한다. 그것은 가중치를 원격으로 스트림하거나 호스팅하여 디스크에 10+ GB를 주차하지 않고도 ComfyUI와 같은 그래프를 연결할 수 있게 한다.

내게 작동한 것:

내게 작동한 것:

- 온보딩은 가벼웠다. 나는 그래프를 그들의 LTX-2 엔드포인트로 가리켰고 로컬 폴더를 건드리지 않았다.

- 콜드 스타트는 더 느렸다 (첫 실행은 세션을 회전시킨다), 하지만 따뜻한 실행은 작은 배치에 정상적으로 느껴졌다.

- 그것은 내 노트북 팬이 울부짖지 않게 했다. 그것만으로도 길 위에서 유용했다.

내가 주목한 트레이드오프:

- 레이턴시: 약간의 오버헤드가 있으며, 많은 짧은 실행으로 더 명백하다. 긴 렌더의 경우, 나는 알아차리기를 멈췄다.

- 제어: 버전 핀닝의 일부를 포기한다. 그들은 모델을 유지 관리하게 되어 좋을 때까지, 이전 결과를 재현하고 싶을 때까지.

- 비용/할당량: 그것은 “다운로드처럼 무료”가 아니다. 타이트한 예산에 있거나 무거운 배치 작업이 필요하면, 로컬이 여전히 이긴다.

- 개인정보: 나는 민감한 프롬프트와 자산을 로컬로 유지한다. 공개 또는 테스트 작업의 경우, 나는 좋다.

이것을 좋아할 수 있는 사람: 약한 기계에서 LTX-2를 테스트하는 사람들, 또는 전체 로컬 설정에 커밋하기 전에 워크플로우를 스케치하고 싶은 누구든.RAM이 풍부하고 정확한 재현성에 신경 쓴다면, 로컬 설치는 여전히 더 낫다.

나는 이것을 좋아할 거라고 기대하지 않았지만, 빠른 실험의 경우, 다운로드를 건너뛰는 것은 작은 안심이었다.