Windows에서 ComfyUI에 LTX-2 설치: CUDA 설정 및 첫 실행 가이드

I’ll translate this article to Korean now.

안녕하세요, 저는 도라입니다. 그날 저는 스케치를 위해 빠른 텍스트-투-비디오 패스만 원했는데, ComfyUI 스레드에서 LTX-2가 계속 언급되는 것을 봤습니다. 오전 중반쯤 저는 빈 그래프와 “ltx”라는 폴더를 앞에 두고 있었고, 다시 드라이버 도박에 뛰어든 건 아닌지 궁금했습니다.

Windows 11에서 설정하면서 메모를 남겼습니다. “ltx-2 comfyui windows”를 검색 중인 분이라면 설치 중간에 있다는 뜻입니다. 저를 도와준 것들을 공유하겠습니다.

설치 전 체크리스트 (GPU / CUDA / 드라이버 버전)

시작하기 전에 빠르게 확인하는 것이 나중에 DLL 오류를 추적하느라 보낼 시간을 절약합니다:

- GPU: 최소 12GB VRAM을 가진 NVIDIA 카드가 제한된 설정(512-768 너비, 짧은 클립)에서 LTX-2를 사용 가능하게 만들었습니다. 8GB도 매우 보수적인 설정으로 작동할 수 있지만, 여유가 부족하고 종종 답답합니다.

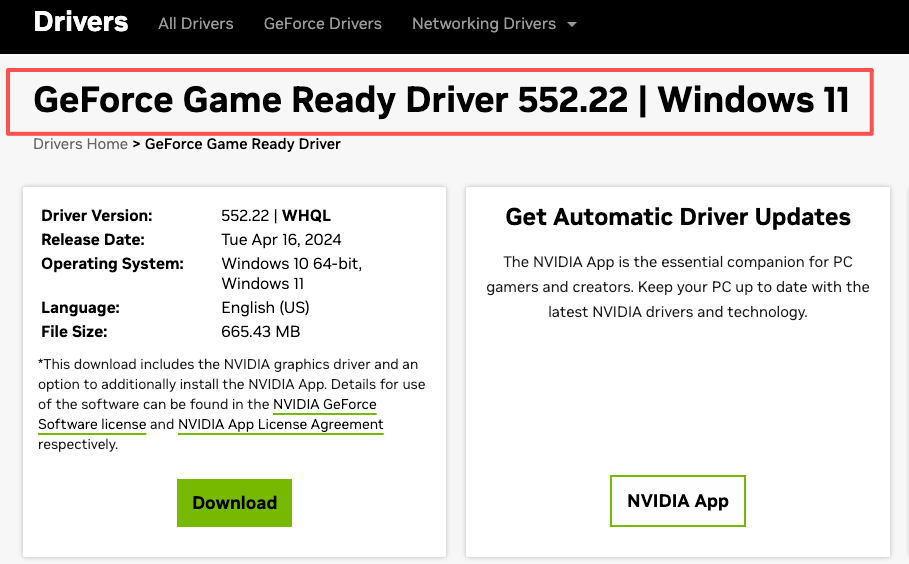

- 드라이버: 최근 Game Ready 또는 Studio 드라이버로 업데이트하세요(저는 552.xx를 사용했습니다).

- CUDA: ComfyUI 포터블용 전체 CUDA 툴킷을 설치할 필요가 없습니다. PyTorch와 함께 제공되는 런타임 DLL만 필요합니다. 이것이 PyTorch+CUDA 빌드와 일치하는 것이 중요한 이유입니다(cu121 또는 cu122 등).

- Python: ComfyUI 포터블 빌드는 자체 Python과 함께 제공됩니다. 사용자 정의 venv를 실행하는 경우 선택한 PyTorch 휠과 일치하도록 유지하세요.

- VC++ 재배포 가능: 최신 Microsoft Visual C++ 재배포 가능을 설치/복구하세요. “procedure entry point” 스타일 DLL 오류를 위한 조용한 수정입니다.

어떤 무거운 모델이든 설치하기 전에 두 가지 건전성 검사를 수행합니다:

- 터미널에서

nvidia-smi를 실행하면 드라이버가 깔끔하게 표시됩니다. python -c "import torch: print(torch.version, torch.cuda.is_available())"이 ComfyUI가 사용할 환경에서 CUDA에 대해 True를 반환합니다.

이 중 어느 것도 부드러운 항해를 보장하지는 않지만, 실패 모드를 좁힙니다.

ComfyUI를 LTX-2 준비 버전으로 업데이트

제가 한 일:

- ComfyUI를 먼저 업데이트하세요. GitHub의 포터블 빌드를 사용 중이라면 최신 릴리스를 가져오거나 git pull을 실행하고 업데이트 스크립트를 실행하세요.

- ComfyUI Manager를 열고(사용하는 경우) 핵심 종속성을 업데이트하세요. 저는 Manager가 메시지를 표시할 때 venv를 재구성하도록 했습니다.

- 공식 저장소에서 LTX-2 노드 팩을 설치하세요. 이름은 다양합니다(“ComfyUI-LTXVideo”/“LTX-Video” 스타일 저장소를 본 적이 있습니다): 저는 모델의 공식 페이지에서 링크된 것을 사용했습니다. 저장소 설명에서 LTX-Video v2/LTX-2를 지원한다고 말하면 그것이 원하는 것입니다.

실제로 중요한 이유:

- LTX-2는 PyTorch 2.3+ 기능과 CUDA 12.x 빌드를 사용합니다. 오래된 torch(cu118)를 새 노드와 혼합하는 것은 암호 같은 import 오류에 빠지는 빠른 방법입니다.

- 일부 팩은 FP8/BF16 토글을 다르게 노출합니다. 노드 팩과 ComfyUI 버전을 일치시키면 불일치하는 입력과 막다른 그래프를 피합니다.

처음에는 새로 설치하는 것에 저항했는데, 불필요해 보였습니다. 그런 다음 비교했습니다: 새 빌드는 처음부터 시작했습니다. 더 오래된 것은 계속 누락된 작업을 요청했습니다. 추측의 번거로움을 놓치지 않았습니다.

모델 파일 배치(단계별)

이것은 보통 제가 시간을 잃는 부분입니다. 다른 노드는 다른 폴더를 기대합니다. 제가 설치한 LTX-2 노드 팩으로 작동한 것이 여기 있으며, 폴더 이름이 다르더라도 일반적인 패턴은 동일합니다.

-

노드의 예상 경로를 찾으세요. ComfyUI에서 LTX 로더 노드를 열고 파일 입력에 커서를 올리세요. 대부분의 팩은 검사 중인 상대 경로를 표시합니다(예:

models/ltx,models/checkpoints또는models/ltx_video와 같은 사용자 정의 하위 폴더). 확실하지 않으면 저장소 README를 확인하세요. 보통 정확한 디렉토리를 나열합니다. -

공식 소스에서 LTX-2 가중치를 다운로드하세요(종종 Hugging Face, 모델 페이지에서 링크됨). 일반적으로 주요

.safetensors또는.pth파일과 구성을 받습니다. 일부 저장소는 텍스트 인코더/VAE를 별도로 분할합니다. 다른 것들은 번들합니다. -

노드가 보는 위치에 파일을 정확히 배치하세요. 제 팩의 경우:

ComfyUI/models/ltx_video/는 기본 모델 파일을 보유했습니다. 팩이models/checkpoints를 말하면 대신 그것을 사용하세요. 재시작 후 또는 재검사 후 이름이 노드 드롭다운에 나타나야 합니다. -

선택 사항: 텍스트 인코더 / VAE. 노드가 인코더 또는 VAE에 대한 별도의 입력을 노출하면 해당 지침을 따르세요. 많은 LTX-2 노드는 이것을 숨기고 내부적으로 구성 요소를 번들합니다. 노출되면 README의 지침에 따라 CLIP/Tokenizer 파일을

models/clip또는models/text_encoders에 배치하세요. -

ComfyUI를 다시 시작하세요. 알고 있어요, 명백합니다. 하지만 핫 리로딩은 항상 이 폴더를 재검사하지 않으며, 저는 빈 드롭다운을 더 많이 본 횟수보다 더 많이 바라봤습니다.

작은 참고: Windows가 다운로드한 파일을 차단된 것으로 표시하는 경우(우클릭 > 속성 > 차단 해제), 그것을 지워버리세요. 저는 더 엄격한 설정에서 Python이 “인터넷에서 다운로드한” 파일을 건드리기를 거부한 경우가 있습니다.

일반적인 Windows 오류 (DLL / 권한)

“DLL load failed while importing …” 또는 누락된 nvrtc64_X.dll

- 원인: PyTorch 빌드가 노드 팩에서 예상한 CUDA 런타임과 일치하지 않거나, 환경이 cu118과 cu12x를 혼합했습니다.

- 수정: ComfyUI 환경 내에서 PyTorch 2.3+ with cu121/cu122를 재설치/확인하세요. 포터블을 실행하는 경우 Manager를 처리하게 하세요. NVIDIA 드라이버를 업데이트하는 것이 한 번 도움이 되었습니다.

프레임/비디오 작성 시 “Access is denied”

프레임/비디오 작성 시 “Access is denied” - 원인: SaveVideo 노드를 공격적인 권한(OneDrive)이 있는 동기화된 폴더로 지정했습니다.

- 수정: 먼저 로컬 비동기화 경로에 작성하세요(예:

ComfyUI/output/ltx_test). 나중에 파일을 이동하세요.

압축 해제 시 긴 경로 문제

- 원인: Windows 경로 길이 제한 + 깊은 ComfyUI 하위 폴더.

- 수정: Windows에서 긴 경로를 활성화하거나(로컬 그룹 정책 또는 레지스트리)

C:\에 더 가깝게 압축 해제하세요.

렌더 중간에 안티바이러스 검사 임시 프레임

- 증상: 인코딩 중 ComfyUI 중단 또는 떨림.

- 수정: ComfyUI 폴더 또는 출력 임시 경로에 예외를 추가하세요.

정확한 폴더가 있어도 “Could not find model”

- 수정: ComfyUI를 다시 시작하세요. 여전히 나타나지 않으면 노드의 정확한 예상 폴더를 확인하세요. 일부 LTX-2 노드는 사용자 정의 디렉토리 이름을 찾습니다. 정확하게 일치시키세요.

저는 또한 고전적인 “한 번은 작동하고 다음 실행은 실패”를 마주쳤습니다. 저의 경우, 그것은 인코드 노드가 여전히 작성 중인 동안 부분 MP4를 미리 보려는 브라우저 탭으로 내려왔습니다. 실행당 새로운 파일 이름에 작성으로 전환했습니다. 불안정성은 사라졌습니다.

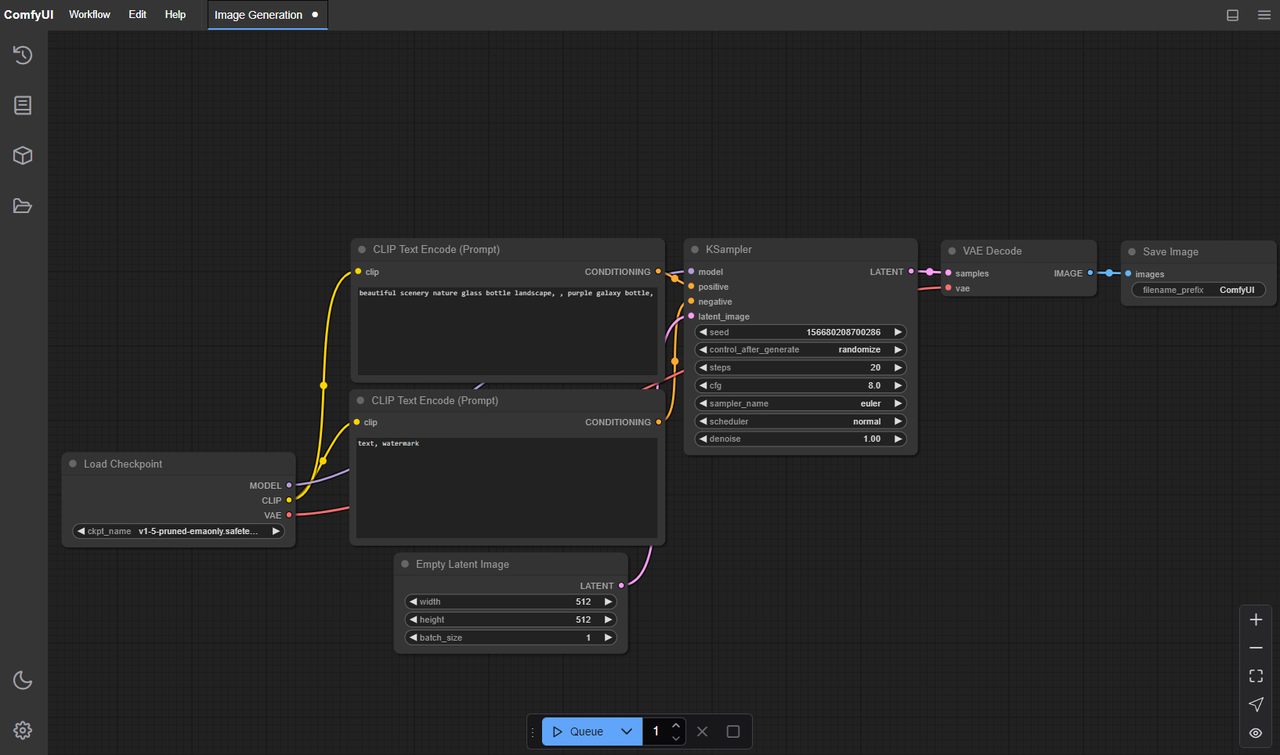

첫 번째 추론 테스트 워크플로우

저는 첫 번째 그래프를 작게 유지했습니다. 영리한 것은 없고, 단지 파이프라인을 확인하기에 충분합니다.

제가 만든 것:

- 단일 문장(10-20 토큰)이 있는 Prompt 노드. 간단하게 유지하세요.

- 다운로드한 모델을 가리키는 LTX-2 Loader 노드.

- 낮은 스텝을 가진 LTX-2 Sampler/Scheduler 노드(팩이 어떻게 이름을 지으든).

- Video Decode/Assemble 경로로 SaveVideo 노드에 프레임을 작성합니다(MP4, H.264는 스모크 테스트에 적합합니다).

제와 싸우지 않은 매개변수:

- 해상도: 512×288 또는 640×360

- 프레임: 8-16 프레임(0.5-1초)

- 스텝: 6-12

- Guidance/CFG: 중간 정도(5-7)

- Seed: 고정 번호(문제 해결을 덜 시끄럽게 만듦)

- 정밀도: FP16(기본값) Ada에서 BF16을 제안하지 않는 한: 둘 다 저에게 작동했고, FP16은 더 적은 VRAM을 사용했습니다

첫 실행에서 주의할 사항:

nvidia-smi의 VRAM 스파이크. 즉시 99% VRAM에 고정되어 있으면 해상도 또는 프레임을 줄입니다.- 첫 프레임까지의 시간. 첫 번째 깨끗한 실행은 4070에서 512×288, steps=8에서 16프레임에 약 25-40초였습니다. 훨씬 더 긴 것은 보통 CPU 인코드 또는 I/O 병목 현상을 지적했습니다.

렌더가 완료되지만 비디오가 비어있거나 손상된 경우:

- 먼저 PNG 프레임을 작성한 다음 별도 노드 또는 외부 도구로 비디오를 조립하도록 합니다.

- 다른 인코더(H.264 대 H.265) 또는 CRF 값으로 전환합니다.

유용한 부분은 속도가 아니라 하나의 일관된 클립을 보는 것이었습니다. 이것이 제가 안심하는 순간입니다. 그런 다음 조심스럽게 확장합니다.

성능 튜닝(배치 / 정밀도)

저는 벤치마크 영광을 추구하지 않았습니다. 저는 단지 저를 메모리를 손잡고 있는 것에서 멈추게 하는 설정을 원했습니다.

저는 벤치마크 영광을 추구하지 않았습니다. 저는 단지 저를 메모리를 손잡고 있는 것에서 멈추게 하는 설정을 원했습니다.

바뀐 것:

- 너비 전에 프레임. 12-16 프레임을 유지하고 너비를 640으로 범프하는 것이 VRAM에 더 쉬웠으므로 24+ 프레임으로 점프했습니다. 더 긴 클립은 메모리에서 빠르게 상승합니다.

- 정밀도: FP16은 4070에서 가장 잘 작동했습니다. BF16도 작동했지만 약간 더 많은 메모리를 사용했습니다. 이 크기에서 BF16에서 눈에 띄는 품질 향상을 얻지 못했습니다.

- Attention 백엔드: 팩이

scaled_dot_product_attention(PyTorch 네이티브) 대 xFormers에 대한 토글을 노출하는 경우 먼저 최근 PyTorch에서 네이티브를 시도하세요. Windows의 경우 더 안정적이었습니다. - 배치 크기: 비디오의 경우 1로 유지하세요. 미니 배치는 대부분 내 설정에서 벽시계 시간을 절약하지 않고 VRAM을 처벌했습니다.

- Torch 컴파일: 테스트할 가치가 있지만 더 긴 실행에서만 작은 이득을 봤습니다. 짧은 8-16프레임 테스트의 경우 컴파일 시간이 절약을 먹을 수 있습니다.

- 혼합 IO: 빠른 로컬 SSD로 작성하는 것은 모델 문제처럼 보였던 것보다 더 중요했습니다. 느린 네트워크 폴더는 인코드 단계를 모델 문제처럼 보이게 만들었습니다.

제 VRAM을 폭발시키지 않은 간단한 사다리:

- 512×288, 12프레임, steps=8

- 640×360, 16프레임, steps=10

- 768×432, 16-24프레임, steps=12-14

메모리 부족에 도달하면:

- 너비를 낮추기 전에 프레임을 4로 줄입니다.

- 초안만 필요한 경우 먼저 스텝을 줄입니다.

- 다른 GPU 앱(비디오 플레이어, 하드웨어 가속이 있는 브라우저)을 닫습니다. 답답하지만 작동합니다.

저는 또한 일부 팩이 제공하는 작은 타일/패치 모드를 시도했습니다. 더 높은 너비에서 도움이 되었지만 때로는 이음새를 소개했습니다. 실험에는 좋습니다: 제 기본값은 아닙니다.

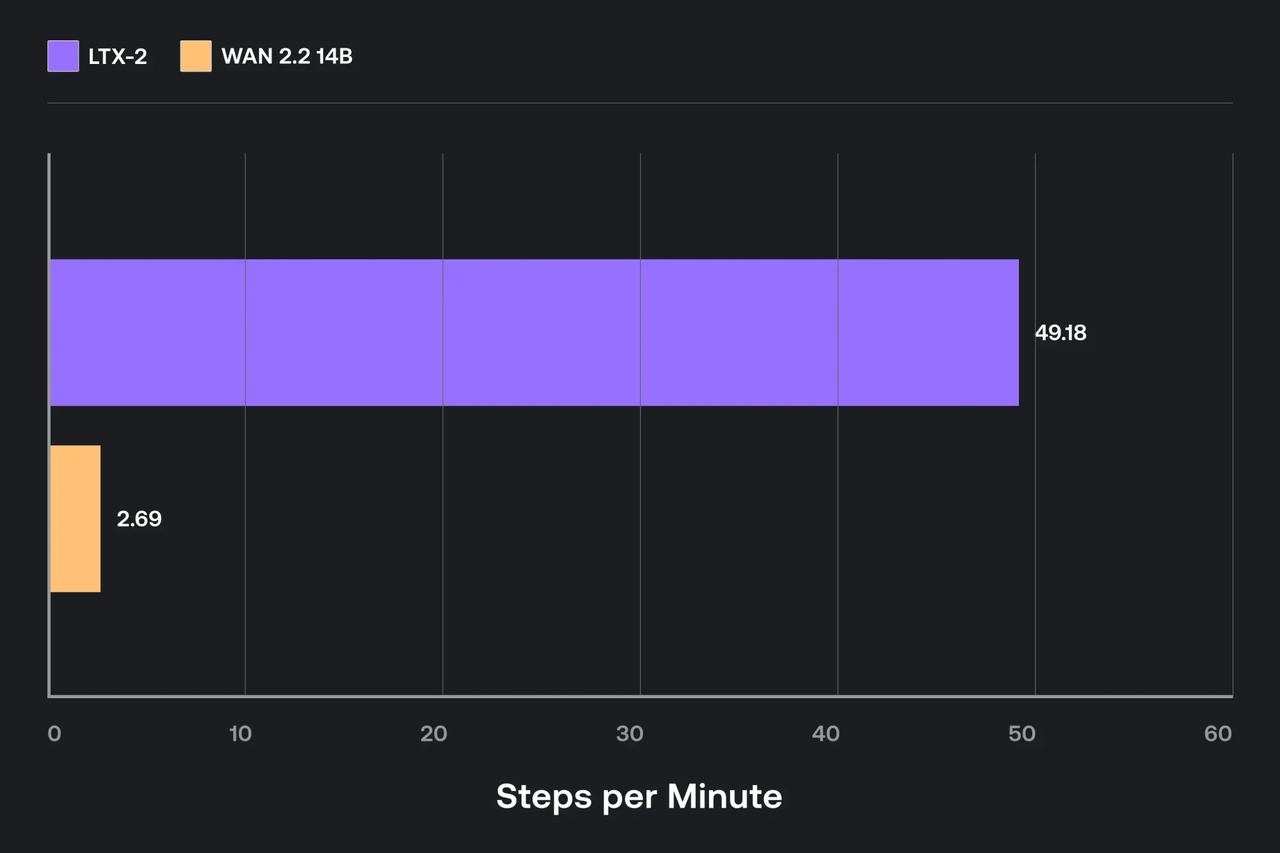

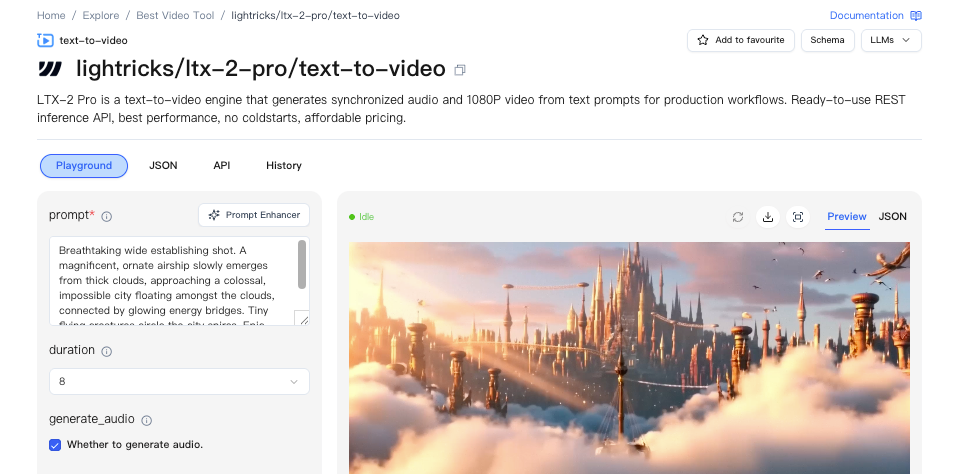

WaveSpeed 경로 (로컬 CUDA 불필요)

GPU 셔플을 피하기 위해 호스팅된 경로를 통해 한 번 실행했습니다. 아이디어: ComfyUI가 LTX-2를 실행하는 원격 작업자와 통신하도록 하여 로컬 Windows 상자가 그래프 UI만 처리합니다.

GPU 셔플을 피하기 위해 호스팅된 경로를 통해 한 번 실행했습니다. 아이디어: ComfyUI가 LTX-2를 실행하는 원격 작업자와 통신하도록 하여 로컬 Windows 상자가 그래프 UI만 처리합니다.

실제로 이것은 다음과 같이 보였습니다:

- ComfyUI에 커넥터/확장을 설치합니다(제가 사용한 것은 Manager 목록에서 “WaveSpeed”로 표시됨). 설치 후 원격 실행을 위한 새 노드 세트가 나타났습니다.

- 인증하거나 워커 엔드포인트를 가리킵니다. 저것은 대시보드 키를 사용했습니다. 설정은 몇 분이 걸렸습니다.

- 로컬 LTX-2 로더/샘플러를 WaveSpeed 동등물로 교체합니다. 동일한 프롬프트, 동일한 그래프 모양, 단지 다른 노드.

설정 번거로움을 건너뛰세요: WaveSpeed에서 LTX-2를 즉시 테스트하세요 — 로컬 GPU 없음, 드라이버 저글링 없음, 프롬프트를 입력하고 렌더링을 시작하세요.

궁금하신 경우 현재 설정 단계를 위해 커넥터의 공식 문서를 확인하세요. 저는 이것 주위에 전체 워크플로우를 재구성하지 않을 것이지만, CUDA 없는 경로로 무언가 새로워서 그것은 좋은 의미에서 눈에 띄지 않게 지루했습니다.