Freepik がDataCrunch と WaveSpeed を使用して FLUX メディア生成を 1 日あたり数百万のリクエストにスケーリング

Freepik が DataCrunch と WaveSpeed を使用して FLUX メディア生成を 1 日あたり数百万リクエストにスケーリング

サマリー

Freepik は 2024 年初頭から DataCrunch と提携し、最先端のメディア生成を AI Suite に統合し、1 日あたり数百万を超える推論リクエストにスケーリングしています。 DataCrunch は Freepik に最先端の GPU インフラストラクチャとマネージド推論サービスを提供し、以下の機能を実現しています:

- マネージド GPU オーケストレーション

- エラスティック スケーリングとほぼゼロのコールドスタート

- WaveSpeed を活用した高速なモデルサービング

- 専門家サポートと戦略的な協力のための直接的な連絡体制 Freepik のお客様は月間 6,000 万枚以上の画像を生成しており、これらのリクエストの大部分は DataCrunch インフラストラクチャとサービスによって実現されています。

1. 顧客プロファイル

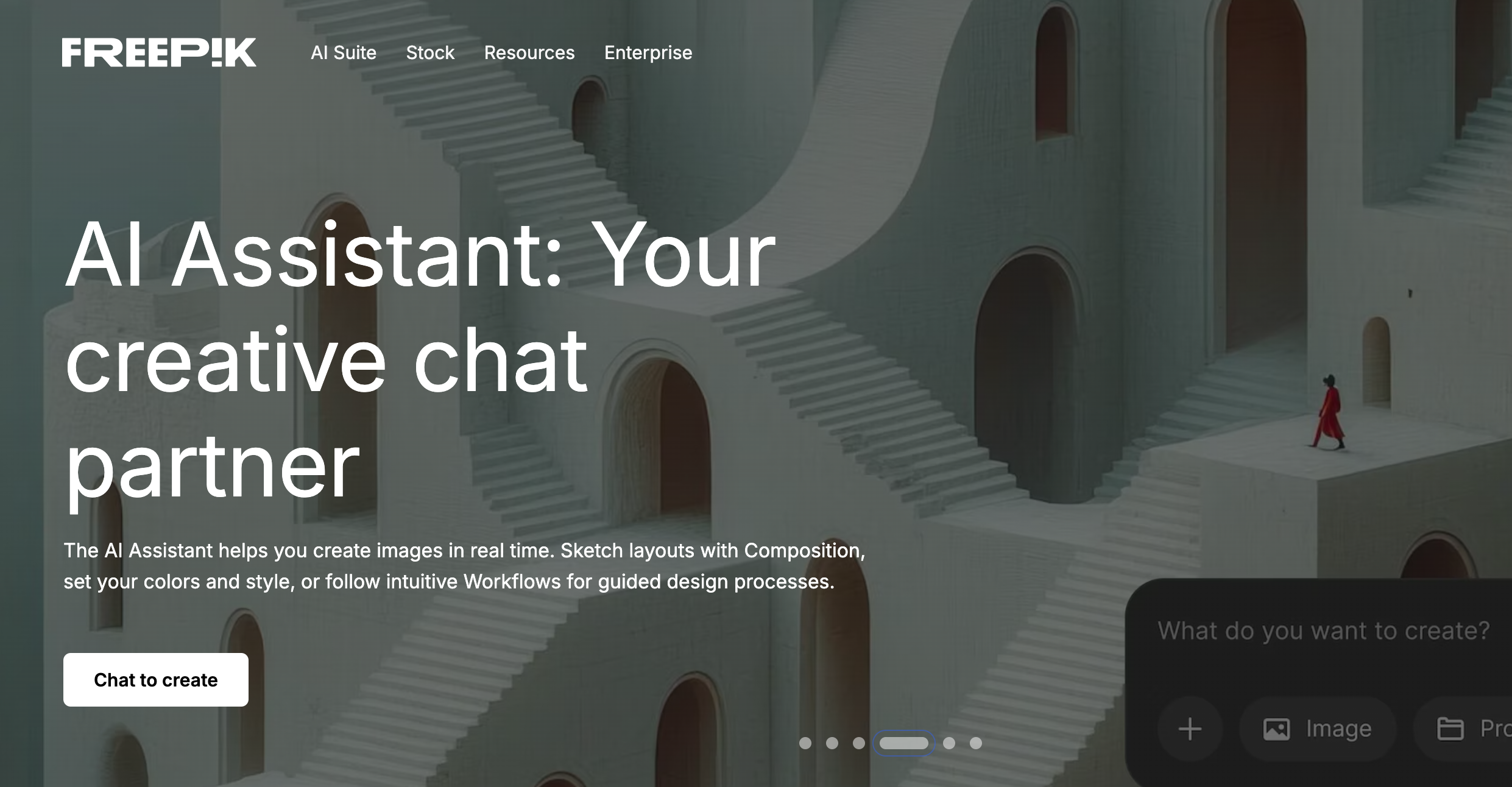

Freepik は、最先端の生成 AI ツールと 2 億 5,000 万以上のキュレーションされたストック資産を組み合わせた、AI を活用した創造的なスイートのリーディング企業です。

2024 年初頭、Freepik は生成 AI を活用して高品質なメディア コンテンツを作成するビジネス モデルを再定義しました。Freepik は Stable Diffusion XL などのモデルと実験的なエンドポイントで画像生成のジャーニーを開始しました。2025 年に向けて、Freepik は FLUX などのモデルを採用し、本番グレードのインフラストラクチャにスケーリングする一方で、急速に増加するユーザーベースに対応するアプローチを改善しました。

Freepik の AI Suite には AI Image Generator が搭載されており、これは FLUX などのモデルを使用してテキストプロンプト (T2I) または画像 (I2I) から写真にリアルな画像を生成し、AI Video Generator は Google DeepMind Veo 2 などのモデルを活用してテキストまたは画像からビデオを作成します。これらの機能は直感的であることを優先する一方で、スタイルのカスタマイズとガイド付きワークフローを重視して設計されました。

Freepik の AI Suite は以下を超える成果を達成しました:

- 月間 8,000 万を超える訪問者

- 60 万を超えるサブスクリプション ユーザー

- 月間 6,000 万枚の画像生成

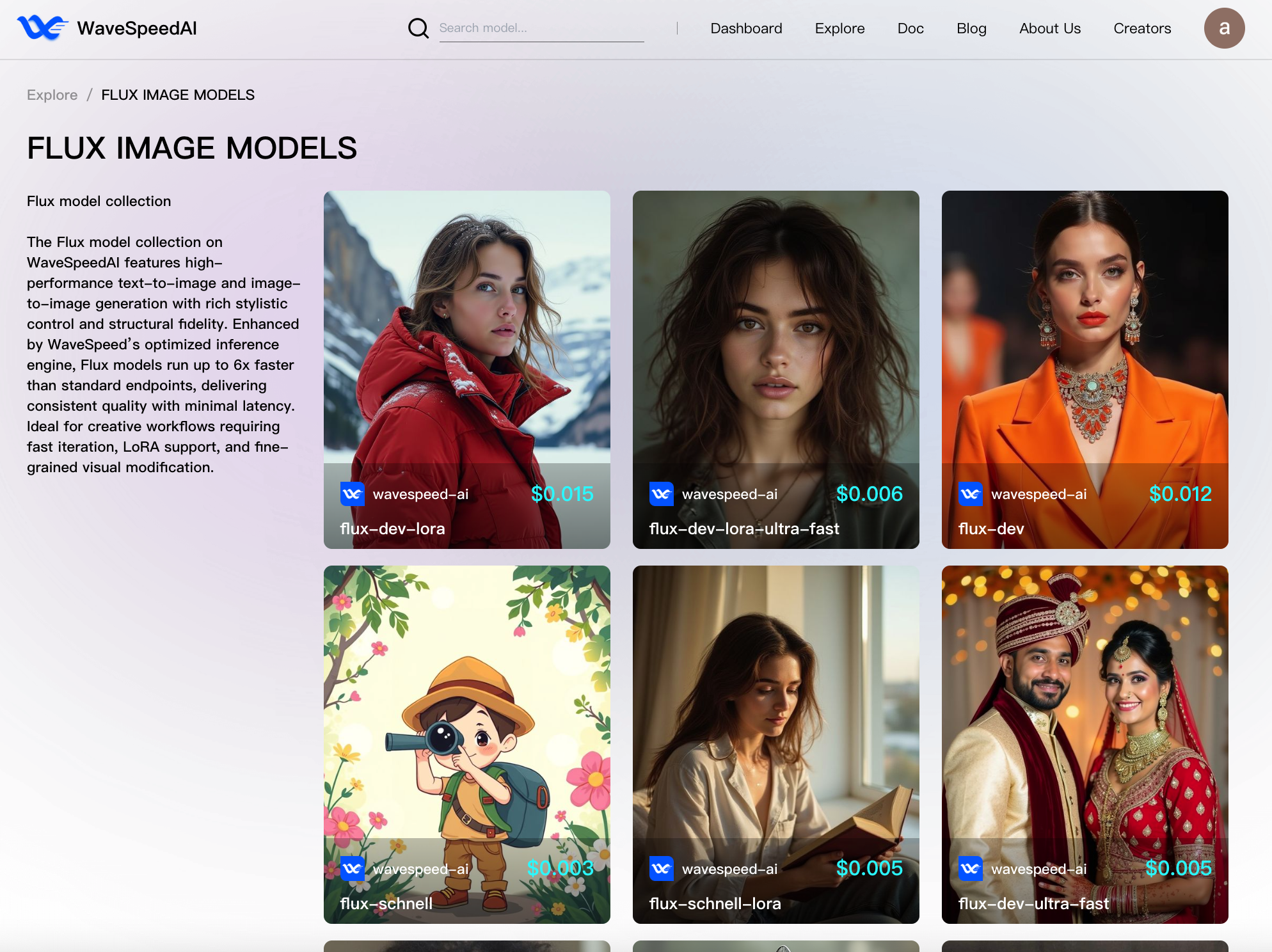

これらの推論リクエストの大部分は FLUX モデル スイートに関連しており、推論エンドポイントは DataCrunch によってマネージドされ、WaveSpeed の推論エンジンを使用しています:

- FLUX Dev

- FLUX Tools (例:インペインティング)

2. コスト効率的なメディア生成:FLUX Dev

2.1. 初期課題

インフラストラクチャをスケーリングすることはめったに容易ではありません。指数関数的に増加するユーザーベースに対応しながら、日次使用量の急増に対応し、推論コストとスピードを最適化しながらインフラストラクチャをスケーリングすることは、ほぼ不可能に近いです。 Freepik は世界レベルの製品とカスタマー エクスペリエンスを構築することを目指しているため、画像生成インフラストラクチャはパフォーマンスの最前線にあり、以下の要件を満たす必要がありました:

- レイテンシを 2~6 秒の範囲 (p50) 以下に維持する

- スループット/$ の最適化 (コンピュートあたりの 1 時間あたりの画像)

- 公式の最適化されていないベースラインに対する品質の低下を回避する

これらの要件を満たすために、Freepik はそのような規模では、わずかなセント単位の改善とより最適な生成あたりの GPU 使用率でさえも大幅なコスト削減につながるため、効率の最前線で運用する必要がありました。

2.2. 技術的アプローチ

DataCrunch と協力して推論インフラストラクチャを構築およびスケーリングすることで、Freepik は製品の品質を改善し、世界レベルのユーザー エクスペリエンスを提供することに全力を注ぐことができます。DataCrunch は Freepik が画像生成の急速な進歩に適応することも可能にしました。 DataCrunch は、エンジニアリング チーム間の継続的なコミュニケーションと Freepik を提供し、迅速なコラボレーションと調整を可能にしました。この直接的なコミュニケーションは、Freepik が経験したスケールと成長をサポートし、遅延または誤解の可能性を排除するために必要でした。

「エンジニアリング チーム間の直接的な連絡により、非常に高速に移動することができます。任意のモデルをスケールで展開できることは、この急速に変化する業界で必要なものです。DataCrunch により、カスタム モデルを迅速かつ簡単に展開できます。」 – Iván de Prado、Freepik の AI ヘッド

その結果、Freepik は AI Suite でコスト効率的なモデル サービングの恩恵を受けながら、目標スループット/$ とレイテンシを達成しました。DataCrunch での私たちの努力は、「推論速度は何としても」という落とし穴を回避することに向けられました。これは通常、出力の低下や不安定なスケーリングなどのトレードオフを伴います。 これを実現するために、モデルの機能を保持するロスレス最適化の詳細な調査を実施し、その後、厳密な評価を実施しました:

- マルチメトリック評価:DreamSim、FID、CLIP、ImageReward、および Aesthetic の組み合わせを使用

- ヒューマン評価:Freepik はベースラインおよび他の推論プロバイダーとの比較による A/B アリーナを通じて広範な評価を実施しました。

- プロンプト多様性:物体、シーン、および抽象的な概念に焦点を当てた多様なプロンプト カテゴリーを評価しました。

2025 年から、DataCrunch-WaveSpeed HW-SW 共同設計研究により、各組織の中核的な強みを活用しながら、Freepik に提供される最大実用的な推論効率をさらに向上させることが可能になりました:

- DataCrunch GPU インフラストラクチャとサーバーレス コンテナ:内部 Kubernetes クラスター上の自動スケーリング、高スループット ネットワーキング、および低レイテンシ オブジェクト ストレージ

- WaveSpeed 推論エンジン:社内 ML コンパイラ、カスタム チューニングおよびフューズド CUDA カーネル、高度なロスレス量子化、DiT アクティベーション キャッシング (例:AdaCache)、および無視できるオーバーヘッドを持つ軽量推論サーバー

3. 推論ベンチマーク:方法論と結果

主要メトリクス:平均推論時間とレイテンシ (p99)、生成あたりのコスト、1 時間あたりのスループット。

以下のすべての結果は、ワールド サイズが 1 デバイスの場合に達成されました。各エンドポイントを効率用に最適化することにより、特定の時点での Freepik のトラフィックと要件 (例:ユーザー ティア) に基づいて、利用可能なリソースを動的に割り当てることができました。

| エンドポイント | 入力パラメータ | GPU 推論時間 (秒) | GPU あたりの 1 時間あたりのスループット |

|---|---|---|---|

| flux-dev | サイズ = 1024x1024、ステップ = 28、オプション キャッシュ = 0.1 | 4.4 | 818.2 |

| flux-dev-fast | サイズ = 1024x1024、ステップ = 28、オプション キャッシュ = なし | 3.3 | 1091 |

| flux-dev-fast | サイズ = 1024x1024、ステップ = 28、オプション キャッシュ = 0.1 | 2.2 | 1636 |

| flux-dev-fast | サイズ = 1024x1024、ステップ = 28、オプション キャッシュ = なし | 1.64 | 2184 |

| flux-dev-ultra | サイズ = 1024x1024、ステップ = 28、オプション キャッシュ = なし | 1.648 | 2184 |

| flux-dev-ultra | サイズ = 1024x1024、ステップ = 28、オプション キャッシュ = 0.1 | 1.045 | 3445 |

| flux-dev-ultra | サイズ = 1024x1024、ステップ = 28、オプション キャッシュ = 0.16 | 0.768 | 4688 |

4. 技術ソリューション:本番グレードの GPU インフラストラクチャ

DataCrunch GPU インフラストラクチャは、大規模な生成 AI システムのための本番グレードの基盤を提供し、WaveSpeed 最適化エンジンがさらに効率の限界を押し広げます。

- マネージド GPU オーケストレーション:GPU の細粒度リソース管理は内部 Kubernetes クラスター経由で配信され、WaveSpeed がインフラストラクチャ管理やインフラストラクチャ as コードの詳細を心配することなく、推論のためのリソース割り当てを制御できるようにします。

- エラスティック スケーリング:サーバーレス コンテナは、受信リクエスト数に基づいてゼロから 500 以上の GPU インスタンスに自動スケーリングするようにカスタマイズされました。この機能は、キューイングやリクエストの破棄なしにトラフィックの日次スパイクを吸収し、アイドル時にゼロにスケーリングして不要なコストを避けるために重要です。

- ほぼゼロのコールドスタート:コンパイルの事前ウォーミング、より高速なイメージ プルタイム、およびコンテナ キャッシングを通じて、コールドスタート レイテンシが大幅に削減され、GPU ワークロードの真の Lambda パフォーマンスに近づきました。

- 高速なモデルサービング:最適化されたストレージとネットワーク ファブリックにより、モデル ウェイトのロードと Docker イメージの取得に費やされる時間が大幅に削減されました。これは FLUX LoRA デプロイメントにとって特に重要です。LoRA ウェイトはキャッシュされ、各 GPU インスタンスに移動する必要があります。さらに、DataCrunch Shared Filesystem は、複数のインスタンスが同じ一元化されたファイル リポジトリへの読み取りと書き込みを可能にすることで、モデル サービング速度をさらに向上させ、データ転送のオーバーヘッドを削減します。

5. ビジネスの成果:コスト削減と戦略的な利点

DataCrunch は WaveSpeed と共同で、FLUX Dev モデルを使用した画像生成をスケーリングしながら、推論コストを最小化することを Freepik に可能にしました。 直接的なコスト削減に加えて、戦略的パートナーシップにより、Freepik ユーザーの大部分がより高い生成クォータで FLUX モデルにアクセスできるようになりました。 DataCrunch チームは、HW を認識した最適化を適用することで、異なるコンピュート インフラストラクチャを活用しながら、出力品質を厳密に評価および保証しました。 主要な成果の 1 つは、持続可能でスケーラブルな推論には異なる視点から ML システムを理解する必要があるということでした:

- GPU を認識した最適化 (例:B200 カスタム CUDA カーネル)

- 厳密なテストと評価

- インフラストラクチャ統合 (つまり、自動スケーリング、ゼロ コールドスタート、ネットワーク チューニング) Freepik は新しいエンタープライズ プランでさらに高いトラフィックと推論ボリュームを目指しているため、DataCrunch はこの成功したアプローチを継続的に適用して、継続的なスケーリング パフォーマンスを達成します。

6. 将来の予測:メディア生成の次のステップ

テキスト プロンプトからの画像生成または画像条件付けは、デジタル アーティストおよび広告代理店が使用する専門環境での制御とスキル機能の増加する需要を満たすのに不十分になっています。 FLUX のリリースにより、Black Forest Labs は画像生成品質で大きな飛躍を遂行しました。FLUX.1 Kontext [dev] が画像編集の同様の転換点を作成し、その採用率が FLUX モデルの採用率を超えることを予想しています。 OpenAI 4o 画像生成などのストーリーは、高度な操舵性、入力画像での簡単な条件付け、キャラクター一貫性、および強いプロンプト準拠を備えたモデルの高い需要があることを確認しています。 FLUX.1 Kontext [max] および [pro] のリリースにより、Black Forest Labs は、より費用効率的でありながら、そのような機能を再現できることを実証しました。 今後、DataCrunch は画像生成を超えて、エンドツーエンド ワークフローに向けて進む予定です。進行中の研究開発プロジェクトは以下に焦点を当てています:

- Alibaba WAN 2.1 や VACE などのモデルを使用した、最先端のビデオ生成のスケーラブルでコスト効率的な統合

- 画像とビデオのアップスケーリング モデル

- エージェントメディア製品の構築の複雑さの削減

- DataCrunch Cloud Platform での FLUX Dev (ベース モデル、LoRA、ツール) 推論エンドポイントのリリース – お楽しみに

FLUX Dev とその他のモデルを試してみてください!

🔗FLUX-dev

🔗FLUX-dev-ultra-fast

🔗FLUX-dev-lora

🔗FLUX model collection

🔗Wan-2.1-14b-vace

🔗Seedance 1.0