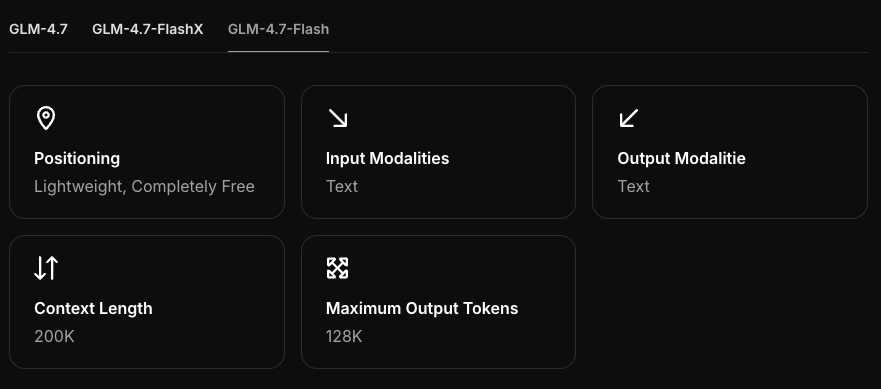

GLM-4.7-Flashをローカルで実行: Ollama、Mac、Windowsのセットアップガイド

私はDoraです。数日前、ちょっとした不便さが私をこれに突き動かしました。リモート完成を小さなドラフトタスク用に待ち続けていました。数分ではなく、ほんの少しの遅延で、メールに目がいって思考の流れを失うのに十分な時間でした。先週(2026年1月)、GLM-4.7-Flashをローカルで実行してみて、その数秒を削ることで実際にもっとまっすぐに考えられるかどうか試してみました。

簡潔に言うと:そうでしたが、派手な理由ではありませんでした。GLM-4.7-Flashは見出しモデルというより、堅実なアシスタントのように感じました。フロー状態を保つのに十分な速さで、ラップトップで実行してもオーバーヒートしない程度に軽量です。機能したこと、立ち往生したところ、退屈な良い意味での状態を保つセットアップを共有します。

ハードウェア要件

最小GPU / RAM

GLM-4.7-Flashを3台のマシンで実行しました:

- MacBook Pro M3 Pro(12コアCPU / 18コアGPU、36 GB RAM)

- Mac mini M2(24 GB統合メモリ)

- RTX 4090搭載Windowsデスクトップ(24 GB VRAM)

これらのテストから、実用的な下限は以下の通りです:

- CPU のみ(Mac/Windows/Linux):16 GB システムメモリで動作、32 GB がより親切です。最初のトークンが遅くなることを覚悟してください。

- Apple Silicon(Metal):16 GB統合メモリは4ビット/5ビット量子化と控えめなコンテキスト(2~4K)で使用可能です。8 GBは窮屈に感じました。

- NVIDIA:8~12 GB VRAMが4ビット量子化を試す最小限です。16 GB以上がより快適です。

GLM-4.7-Flashは中堅サイズモデル(10~12Bパラメータ以下と考えてください)のように感じます。4ビットでは、通常、デバイスメモリ~5~6 GB + KVキャッシュを見ています。長いコンテキストや多数の並列プロンプトをプッシュすると、メモリが増えます。

推奨スペック

その「常に応答性がある」という感触が欲しい場合:

- Apple Silicon:M3以降、24~36 GB統合メモリ:コンテキストを4~8Kに保つ。

- NVIDIA:24 GB VRAM(例:3090/4090)により、より高いコンテキストと同時実行性が可能になります。

- ストレージ:高速SSD:モデルがより速くロードされ、スワップが少なくなります。

メモリ圧力がかかるとモデルが「派手」に見えなくなることに気付きました。ページアウトまたはVRAMスピルにより、フローを破る微妙なスタッターが追加されます。少しだけ余裕があると大いに役立ちます。

Ollama セットアップ

ローカル実行をシンプルで、マシン間で一貫性のあるものに保つためにOllamaを使用しました。バージョンコンテキストはここで重要です。

Ollama 0.14.3+のインストール

- macOS:brew install ollama(またはbrew upgrade ollamaで更新)。

- Windows:Ollamaサイトから公式インストーラーを使用してください。

- Linux:ドキュメントのcurlスクリプトに従ってください。

このテスト時点(2026年1月)では0.14.3です。新しいバージョンはデフォルトバックエンドまたは量子化動作を変更することがあるため、ジャンプする理由ができるまで、安定しているバージョンに固執しています。

GLM-4.7-Flashの取得と実行

2つのパスが機能しました:

-

Ollamaライブラリに公式GLM-4.7-Flashビルドが含まれている場合:

- ollama pull glm-4.7-flash

- ollama run glm-4.7-flash

-

表示されない場合(1台のマシンで発生):

- GLM-4.7-Flashの既知のGGUFまたは互換アーティファクトを指すModelfileを作成してください。

- 例Modelfile(簡略版):

- FROM ./glm-4.7-flash-q4.gguf

- 必要な場合のみプロンプトテンプレートを追加してください:最小限に保ちました。

- その後:ollama create glm-4.7-flash-local -f Modelfile

- 実行:ollama run glm-4.7-flash-local

使用からのメモ:

- 最初のロードはキャッシュが温まるため遅くなります。

- num_ctxを控えめに保ちます(4Kまたは8K)。本のドラフトを要約する場合を除きます。より大きなコンテキストはいいですが、メモリを多く消費し、日常的なドラフティングの質に常に役立つわけではありません。

- 生成が躊躇しているように見える場合、温度を0.6~0.7に下げて、top_pをわずかに上げてみてください:速度を失わずに出力が締まりました。

参考:Ollamaドキュメントはプラットフォーム固有のフラグと現在のバックエンドに関する詳細情報は堅実です。

Mac パフォーマンス

M4 / M3 / M2 ベンチマーク

これらは実験室レベルではなく、執筆と軽いコードプロンプト、温度0.7、4Kコンテキスト、4ビット量子化での安定した実行です:

- M4(借りたマシン、48 GB):温めた後60~85トークン/秒。最初のトークンは~350~500ミリ秒。

- M3 Pro(36 GB):35~55トークン/秒。最初のトークンは~500~800ミリ秒。

- M2(24 GB):20~30トークン/秒。最初のトークンは~900~1200ミリ秒。

範囲を雰囲気チェックとしてください。M3 Proで8Kコンテキストをいくつか推し進めました:速度は~20~30%低下しましたが、ドラフティングのために使用可能なままでした。M2では、長いコンテキストが「粘っこい」のラインを越えています。そこでは2~4Kに保ちました。

メモリ最適化

macOSで最も役立ったもの:

- モデルを実行している端末タブを少なくします。明らかですが、忘れます。

- コンテキストのサイズを適切にします。4Kは私にとって甘いスポットです。

- できるだけ4ビット量子化を使用してください。5ビットは質的に同じように感じましたが、遅くなりました。

- GPUタイムをつかむアプリを閉じます(ビデオエディター、WebGLを含む一部のブラウザタブ)。

また、安定したシステムプロンプトを使用するとやり直しが減ることに気付きました。紙の上では速くありませんが、再試行が少ないほど「感じられる速度」は向上します。小さなプロンプトのような:「簡潔に、プレーンな英語を使用して、マーケティングトーンなし。」モデルの強みに合います。

Windows + NVIDIA

RTX 3090 / 4090 構成

4090(24 GB)では、GLM-4.7-Flashは一貫して高速に感じました:

- 4ビット量子化、4~8Kコンテキスト:ウォームアップ後120~220トークン/秒。

- 最初のトークン:~250~400ミリ秒。

- 並列プロンプト:スタッターが見える前に2~3ストリーム。

友人がそれを3090(24 GB)で実行し、同じ設定で~15~25%低いスループットを見ました。8Kコンテキストを超えてプッシュするか、多くの応答を同時に実行し続けると、VRAMの余裕に達します。通常は4~6Kにバックオフして、バッチを小さく保ちます。

CUDA セットアップ

実際に重要だったこと:

- 最新のNVIDIAドライバ(クリーンインストールは1台のマシンが吃音するのを停止しました)。

- CUDA 12.xと、Ollama以外でステップバイステップする場合は対応するランタイム(vLLM/SGLang)。Ollama自体の場合、常に完全なツールキットが必要なわけではありませんが、最新のドライバは交渉の余地がありません。

- 電源設定:GPUを「パフォーマンスを最大化する」に設定します。ゲーマーアドバイスのように聞こえますが、長時間実行中のクロックスロットリングが停止しました。

ロードエラーまたはCPUへの異常フォールバックに見舞われた場合、次をダブルチェックします:

- ドライババージョンとCUDAランタイムの配置。

- ウイルス対策がモデルディレクトリをスキャンしているかどうか(それは起こりました:それはばかげていました:それは遅くなりました)。

参考:NVIDIAのドライバ-CUDA互換性テーブルは、デバッグに1時間を費やす前に確認する価値があります。

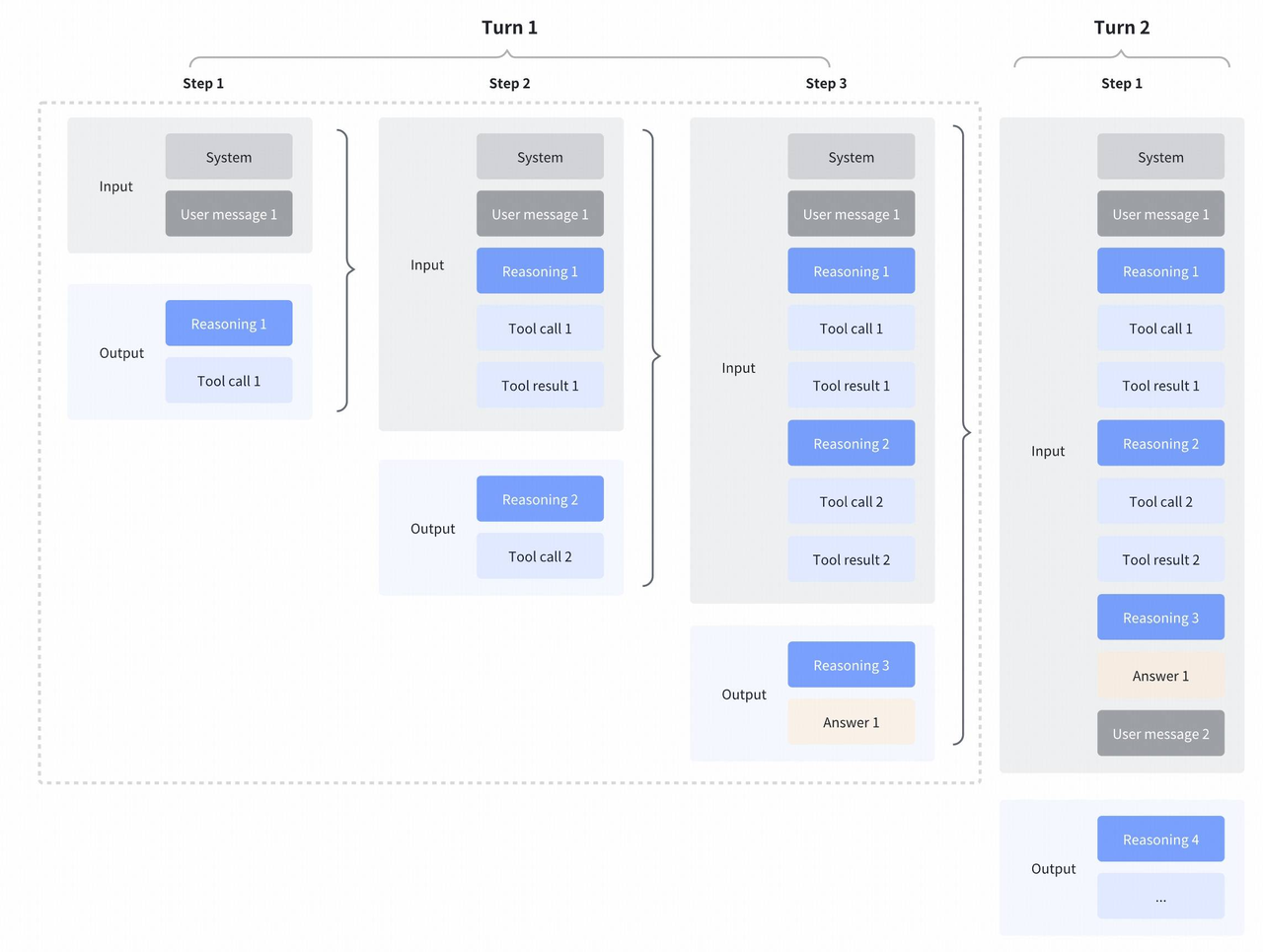

vLLM / SGLang

バッチと化学エンドポイント処理のより多くの制御が欲しかったときに、GLM-4.7-FlashをvLLMとSGLangで試しました。

vLLM

- インストール:最新のPython、CUDA互換PyTorch、次にpip install vllm。

- 実行:

python -m vllm.entrypoints.openai.api_server --model <your_glm_flash_id> --dtype auto --max-model-len 4096 - 私が使用した理由:安定したOpenAI互換API、マルチユーザーまたはマルチタブワークフロー用の堅実なスループット。

SGLang

- インストール:pip install sglang

- 実行:

python -m sglang.launch_server --model <your_glm_flash_id> --context-length 4096 - 私が使用した理由:低レイテンシーストリーミングはキビキビに感じられました、小さなルーティングタスクもうまく再生されました。

どちらも適切なモデルパスまたはHFリポIDが必要です。GLM-4.7-Flashがデフォルトインデックスに存在しない場合、ローカルGGUFまたは互換性のある重み形式を指す必要があります。また:CUDAとドライババージョンを一致させるか、不透明なカーネルエラーを追い求めます。dtypeを自動に保ち、VRAMを余裕で持っていることがわかっているときだけfp16を強制しました。

シングルユーザー書き込みセッションの場合、Ollamaはシンプルなままです。vLLM/SGLangはOpenAIスタイルのエンドポイントが必要なツールをテストしたときに意味がありました。

トラブルシューティング

モデル ロード の失敗

私が見たもの:

- ロード中に「メモリ不足」。修正:より小さな量子化(例:4ビット)に切り替える、num_ctxを下げるか、GPUヘビーアプリを閉じます。

- Windowsで「互換バックエンドなし」。修正:GPUドライバを更新:vLLM/SGLangを使用している場合、CPU専用のPyTorchをインストールしなかったことを確認:ドライバアップグレード後に再起動します。

- Ollamaでモデルが見つかりません。修正:Modelfileを作成し、ollama createを実行:または、存在する場合は正確なリポタグから取得します。

モデルがサイレントにCPUにフォールバックする場合、テルは騒音(または欠如)と同じ化学速度/秒です。モデルが「悪化した」と仮定する前にデバイス使用率をチェックすることを学びました。

遅い推論 修正

私が予想していたよりも重要だった小さな変更:

- コンテキストのサイズを適切にしてください。コンテキストを半分にすることは、サンプリングをいじるよりもしばしば高速化します。

- キャッシュを温めてください。クイック短期実行は次の実行を改善します。

- 並列ストリームを減らします。同時実行効率的に見えるまで、KVキャッシュが転倒します。

- NVIDIA用:高パフォーマンス電源モード、オーバーレイアプリを閉じる、背景エンコーダーを停止します。

- macOS:充電器を接続したままにしてください:一部のラップトップはバッテリーの時点で下方シフトします。

もう1つ:最大トークン/秒を追い求めるのをやめました。私にとっての方が良い指標は「最初の使用可能な思考」でした。GLM-4.7-Flashは、プロンプトをフォーカスし、コンテキストを妥当に保つと、すぐにそれを与えてくれました。

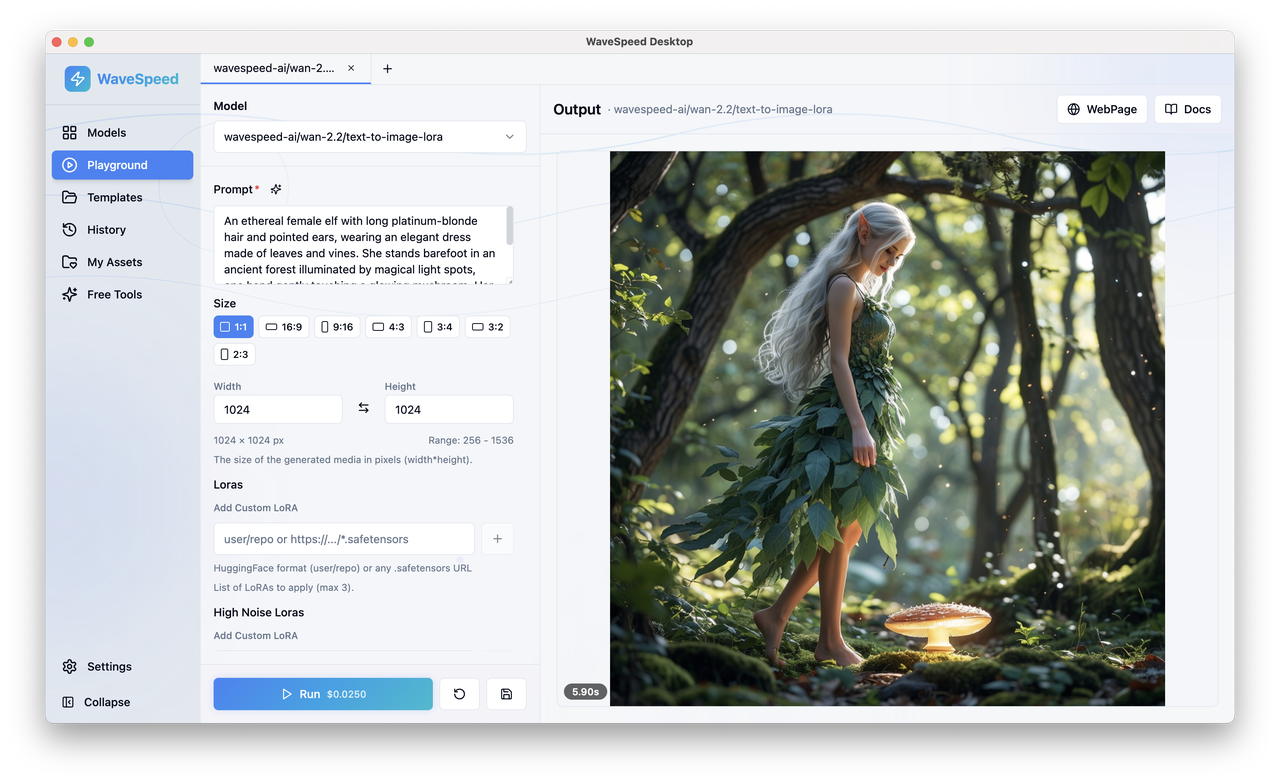

GLM-4.7-Flashのスピードが好きですが、ドライバ、CUDAバージョン、またはバックエンド動作を赤ちゃんがいるのが好きではない場合、WaveSpeedを試してください-低レベルチューニングなしで安定した高速推論に焦点を当てた独自のプラットフォーム。モデルファイル、量子化形式、またはGPU互換性について心配することなく、予測可能なレイテンシーを取得します。

GLM-4.7-Flashのスピードが好きですが、ドライバ、CUDAバージョン、またはバックエンド動作を赤ちゃんがいるのが好きではない場合、WaveSpeedを試してください-低レベルチューニングなしで安定した高速推論に焦点を当てた独自のプラットフォーム。モデルファイル、量子化形式、またはGPU互換性について心配することなく、予測可能なレイテンシーを取得します。