WAN 2.2 LoRA トレーニング設定: 最適な学習率、ステップ数、トリガーワード

私の友人へ。ご存知ですか?WAN 2.2がスキンとライティングをどのように処理するかが気に入りました。しかし、私の通常のLoRA学習習慣がきれいに変換されませんでした。顔は光沢が強くなりすぎて、モデルは背景を同じ柔らかいスタジオルックに引き込み続けました。「間違っている」わけではなく、単に私のものではなかったのです。2026年1月上旬に、WAN 2.2に特化したLoRA学習設定を見つけるために、短い実験を何度か行いました。これらの設定は正気を保つものでした。華やかなものではありません。プラスチックの光沢を少し減らし、被写体を安定させ、それでもベースモデルに息をさせるのに十分でした。

クイックテンプレートを探しているなら、これはそうではありません。複数回の実行で保持されたもの、躊躇した場所、どのように調整したかを共有しています。ここでのターゲットキーワードは明確です。WAN 2.2 LoRA学習設定ですが、目標は新しいウサギの穴ではなく、より落ち着いた仕事です。

WAN LoRAが異なる理由

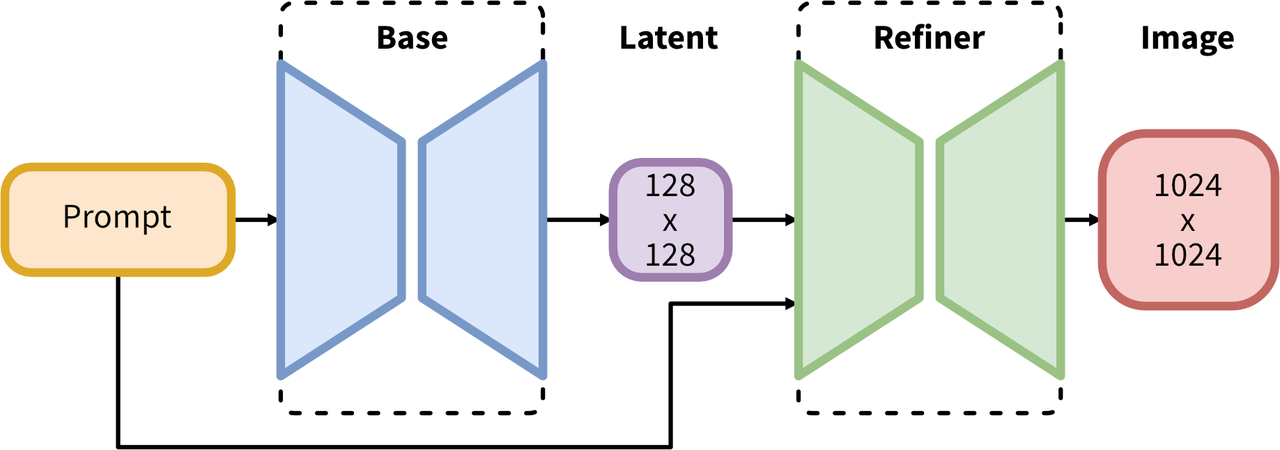

WAN 2.2は非常に意見的なSDXLチェックポイントのように動作することに気付きました。鮮明なポートレート、滑らかなグラデーション、シネマティックライトのために調整されています。より単純なSDXLベースで私が行うようにLoRAを訓練したとき、WANは私の結果をその磨き上げたスタジオの雰囲気に向かって押し戻し続けました。

フィールドノート:

- プロンプト重力は強いです。軽い重み(0.4~0.6)でさえ、きれいな肌と対称的なフレーミングに向かいます。

- 色クラスタリングは早期に現れます。データセットが暖色系の場合、WANはそれを増幅します。

- 背景が均質化します。調整がなければ、何をフィードしたかに関係なく、浅い被写界深度と柔らかいボケのデフォルトになります。

実際に変わったこと:学習率を下げ、いつもより多くの正則化画像を使用し、キャプションを意図的につまらなくしました。WAN 2.2は慎重さに報い。スタイルと被写体を同時に「教える」ようにしたとき、過剰適合が素早く潜入しました。

SD 1.5 LoRA習慣から来ている場合は、次のように考えてください。より少ない賢いトリック、より制御されたベースライン。SDXLに慣れている場合は、通常より少しゆっくり進み、正則化をより早く焼き込みます。

データセットサイズガイド

キューレーションされたポートレートセット(2026年1月5~12日)で4回のパスを実行しました。各パスは、整理されたキャプションと混合されたライティングを備えていました。ここで保持されたものは以下の通りです:

- 8~12画像:特定の人物または製品のシルエットを固定するのに十分です。強力な正則化を使用します。構図を多様に保ちます。

- 15~30画像:単一被写体のアイデンティティと軽度のスタイルに最適です。背景を一般化したい場合は、非ポートレートショットを20~40%追加します。

- 40~80画像:一貫したブランドルックまたはマルチアングルのオブジェクトラインをエンコードしている場合に便利です。慎重なキャプションとより多くのステップが必要になります。

生カウントより重要だったこと:

- 位置の多様性よりもポーズの多様性。WANは位置を上手く一般化します。すべてのショットが同じ角度の場合に苦労します。

- 露出バランス。セットの半分が露出不足の場合、WANはその後すべてを暗くします。トレーニングの前に私はヒストグラムを標準化しました。

- キャプションの単純さ。詩的ではなく説明的。「subject_token、デニムジャケット、窓光、中程度のクローズアップ」は「雨の窓の近くでのムーディーなキャンディッド肖像」に勝ります。

アイデンティティLoRAの場合、12~20画像を信頼できるフロアに着陸させました。スタイルLoRAの場合、30~50はWANのデフォルトの肖像の光沢に崩壊することなく呼吸する余地を与えました。

LR/ステップのベースライン

私にとって安定していたWAN 2.2 LoRA学習設定(Kohya-ssおよびSDXLベース):

- ランク(dim):16~32。アイデンティティは16、スタイルは32がデフォルトです。

- アルファ:dimと一致(例:16/16)。低いアルファは結果が脆くなりました。

- オプティマイザー:weight_decay 0.01のAdamW。

- 学習率:アイデンティティの場合は5e-5、スタイルの場合は7e-5~1e-4。WANは高いLRを使用するとプラスチックのような肌と損失スパイクで罰します。

- スケジューラー:ウォームアップ付きのコサイン。ウォームアップは総ステップの5%。

- バッチサイズ:2~4(A100/4090)。必要に応じて勾配蓄積を8をシミュレートします。

- 解像度:SDXL-ネイティブ1024に長辺をバケティング(例:1024×768、1024×1024)。アップサイズしないでください。ノイズを記憶するだけです。

- エポック/ステップ:エポックではなくステップで停止します。

- 12~20画像:1,200~2,000ステップ

- 30~50画像:2,000~3,500ステップ

- 60~80画像:3,500~5,000ステップ

私が使用したサニティチェック:

- 200~400ステップごとに保存し、固定プロンプト+シードでプレビューします。

- ステップ600の前にサンプルが鋭くなりすぎる場合、LRは高いです。

- 20画像セットで約1,400ステップまでにアイデンティティがロックされない場合、キャプションまたは正則化がLRより多くずれています。

これらの数字はリーダーボードに勝つことはありませんが、WANがすべてを滑らかにする傾向に抵抗します。

トリガーワード戦略

トリガーを最小限に保ちました。WANはすでに強い事前分布を持っています。かわいいトークンを積み重ねるだけでノイズが増えます。

私がしたこと:

- 1つのインスタンストークン+1つのクラストークン。例:インスタンスとして「sora_person」、キャプションでクラスとして「person」または「woman/man」。

- 各キャプションの最初にインスタンストークンを配置します。小文字に保ち、できれば1語。

- 同じLoRAでスタイルトークンを避けてください。本当にスタイルLoRAを望まない限り。WAN 2.2でアイデンティティとスタイルを混ぜるのは混乱しました。

プロンプトでは、LoRAとインスタンストークンのみを呼び出し、その後、穏やかなステアリングをレイヤーします:

- lora:0.5~0.8で名前

- プロンプトの早期のインスタンストークン

- 後期および軽い(「自然光、きれいな色、最小限の修整」)のスタイル単語

WAN固有のトリガーを試しました。彼らは助けにはなりませんでした。ベースは既にその部分を行います、LoRAは必要なものを彫り出すべきで、WAN 2.2が得意なものを再度発表しません。

正則化画像

これは静かなヒーローでした。トレーニング画像あたり1~3倍の正則化画像を使用し、キャプションに合わせてクラス一致させました。

- アイデンティティLoRA:20~60レグ画像は同じクラス(「person」)としてラベル付けされます。WAN 2.2自体から、通常のプロンプト「写真人物、中立背景、中程度のクローズアップ、自然光。」を生成しました。

- オブジェクトLoRA:製品クラスごとのレグ画像(「shoe」、「bottle」、「chair」)。それらを正確に保ちます。クラスを混ぜないでください。

それが重要だった理由:WAN 2.2はポートレートの美学をすべてに刻印するのが好きです。レグ画像は、LoRAがアイデンティティを保持しながら、ベースの範囲を保つ許可を与えました。それらなしでは、私のLoRAは肌の滑らかさとボケを過度に強調し、その後、去ることを拒否しました。

適切に感じた設定:

- レグ画像を視覚的に退屈で適切に露出された状態に保ちます。

- レグ画像をインスタンストークンでキャプションしないでください。クラスのみです。

- 全体を通して(開始時のみではなく)トレーニングバッチの10~20%をレグ画像と混ぜます。

時間が足りない場合は、オプティマイザーを調整する前にレグ画像を追加してください。ここでより大きなレバーです。

過剰適合検出

損失だけに依存しませんでした。WANは美しいサンプルの背後に過剰適合を隠しています。これらは私の兆候でした:

- プロンプト慣性:プロンプトを変更しても、出力はほとんど変わりません。すべてが同じレンズと背景にドリフトします。

- スキンプラスチック性:頬と額の周りで特に毛穴が均一に消え、ざらざらしたライティングプロンプトでも。

- ポーズエコー:異なるシード全体で繰り返される肩/首の角度。

- カラーロック:異なるホワイトバランスキューにしがみつく暖色の色合い。

200~400ステップごとに実行したクイックチェック:

- 敵対的なプロンプト:「厳しいオーバーヘッド事務室の光、蛍光、不親切」に切り替えて、テクスチャが戻ってくるかどうかを確認します。

- 背景フリップ:「混雑した通り、散らかった棚」を強制して、構図の柔軟性をテストします。

- ネガティブプロンプト圧力:「過度に滑らかな肌、プラスチック質感、重い修整」を追加して、それが聞いているかどうかを確認します。

2つのテストが連続して失敗した場合、以前のチェックポイントにロールバックし、より多くのレグ画像を追加するか、LRを1ノッチ下げました。

崩壊の修正

2種類の崩壊にぶつかりました。アイデンティティが溶けてスタイルロック。

アイデンティティが溶けたとき(顔がドリフト、目が不整列):

- LRを1ステップ下げます(例:7e-5→5e-5)。

- データセットに十分な角度がある場合にのみ、ランクを16から32に増やします。そうしないと、アイデンティティではなくポーズを記憶します。

- キャプションをきつくします。形容詞を切ってください、焦点距離のヒントを保ちます、インスタンストークンを最初に保ちます。

- 同じクラスの10~20のより多くのレグ画像を追加します。

スタイルがロックされたとき(すべてがWANのデフォルトスタジオポートレートのように見えました):

- データセットに非ポートレートショット(環境、手、部分的な体)を追加します。

- コサインスケジュールで400~800ステップを増やします。LRをスパイクしないでください。

- 推論時にLoRA重量を削減(0.8→0.5)し、ガイダンスを下げるのをくすぐります(CFG 5~6→3.5~4.5)。WANは低CFGに上手く反応します。

- ノイズオフセットまたは重い色のオグを使用している場合は、それらをダイヤルバック。WANはすでに色を安定化させます。追加のオグは出力を泥だらけにしました。

助けになったその他のノブ:

- 1.0での勾配クリッピングで突然のスパイクを避けます。

- 小さな実行でEMAをオフにします。小さなデータセットで、EMAはアイデンティティのプレビューの背後に遅れました。

- シード規律:毎回固定シードでプレビューします。他のすべてが静止しているとき、小さな変更は判断しやすくなります。

エクスポート&再利用

いくつかの習慣は後で時間を節約しました:

- 明確な名前の増分チェックポイントを保存します。モデル、ランク、LR、ステップ、日付。例:wan22_lora_id_r16_lr5e-5_s1800_2026-01-09.safetensors。

- ツールがサポートしている場合、LoRAメタデータにトレーニングプロンプト、検証プロンプト、シードを保持します。将来の私はいつも過去の私に感謝します。

- バージョン固着使用法:WAN 2.2でトレーニングされたLoRAはWAN 2.2および近い兄弟に最適に機能しました。それらは他のSDXLベースで使用可能でしたが、色と肌の処理がシフトしました。私はそれらを「WANファースト」として扱います。

- よく感じた推論デフォルト:

- LoRA重量0.5~0.8(アイデンティティ)、0.3~0.6(スタイルオーバーレイ)

- CFG 3.5~5.5

- 安定したサンプラー(DPM++ 2M Karrasが上手くいった)を備えた30~40ステップ

- プロンプトを短く保つ:WANは微妙なくすぐりを聞きます

LoRAをマージしたい場合:小さな単一目的のLoRA(0.6でのアイデンティティ+0.3で軽い色のルック)をスタックする方がより良い運がありました。1つの大きな「すべて」LoRAを訓練します。WANはモジュール性を尊重します。

より詳細なWAN 2.2のワークフローと例については、公式ComfyUIドキュメンテーションをご覧ください。

トレーニングの場合、ローカルで物を走らせるのが好きで、すべてのノブが見られます。しかし、推論、モデルルーティング、またはAPIをジャグリングせずにベースモデルを切り替えることになると、WaveSpeedを試すことができます。これは異なるモデルを1つの一貫したエンドポイントの背後に保つため、インフラストラクチャの代わりにプロンプトと出力に焦点を当てることができます。