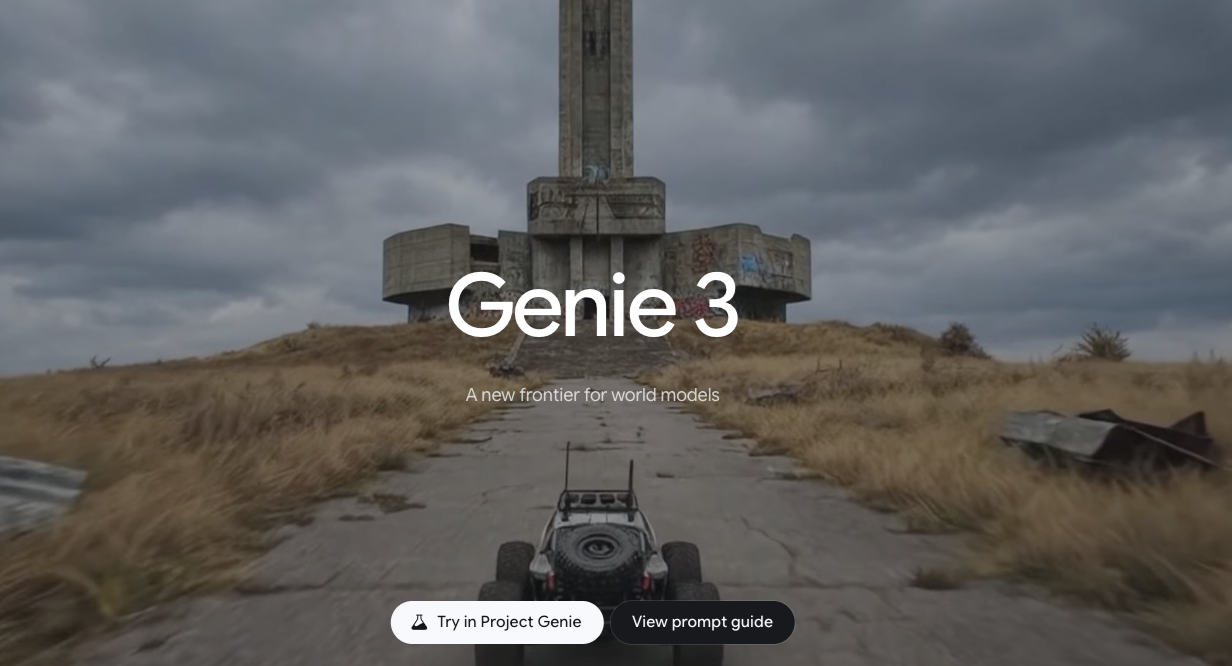

Google DeepMind Genie 3: 技術的分析と機能

Let me translate this article directly for you:

私はドーラです。それは小さなイライラから始まりました。チームメンバーにシンプルなゲームメカニクスを説明しようとしていたのですが、スケッチと1段落のテキストでも曖昧な感じがしました。プロトタイプ全体は必要ありませんでした。10秒間プレイして、その感覚を確認できるようなものがあれば十分でした。それは通常、私が肩をすくめて先に進む類の瞬間です。代わりに、2026年1月に1週間を費やして、Google DeepMind Genie 3について読んだり、デモを見たり、コミュニティの再現を試したりしました。

プロダクションビルドはありません。私が持っているのは、公開研究論文、見つけることができたモデルカードのメモ、元のGenieの論文、そして小さなチェックポイントでアプローチをミラーリングしたいくつかの再現です。つまり、これは現場のメモです。実際に何が機能したか、何が不安定だったか、そしてGoogle DeepMind Genie 3がビジュアルを最小限のセットアップで遊べる世界に変えることに関心がある場合、どこが重要かについてのメモです。

モデルアーキテクチャの概要

Genie 3について考える最も簡単な方法は、ピクセルを制御可能で予測的な世界に変えるスタックとして考えることです。手作成されたゲームエンジンの下部構造は必要ありません。

高レベルでは(元のGenieの機械学習と最新のデモで見えるものに基づいています):

- ビジュアルトークナイザーがフレームを密集した潜在空間に圧縮します。生のピクセルで作業する代わりに、モデルは離散的または連続的なコード(ビデオトークンのようなもの)を学習します。これにより、多くのフレームを予測するのに十分な速度が保たれます。

- ダイナミクスモデルは、これらの潜在状態が時間とともにどのように進化するかを学習します。これをワールドモデルのように扱うことができます。現在の状態とアクションが与えられると、次の状態を予測します。ここが「遊べる性」が生まれるところです。

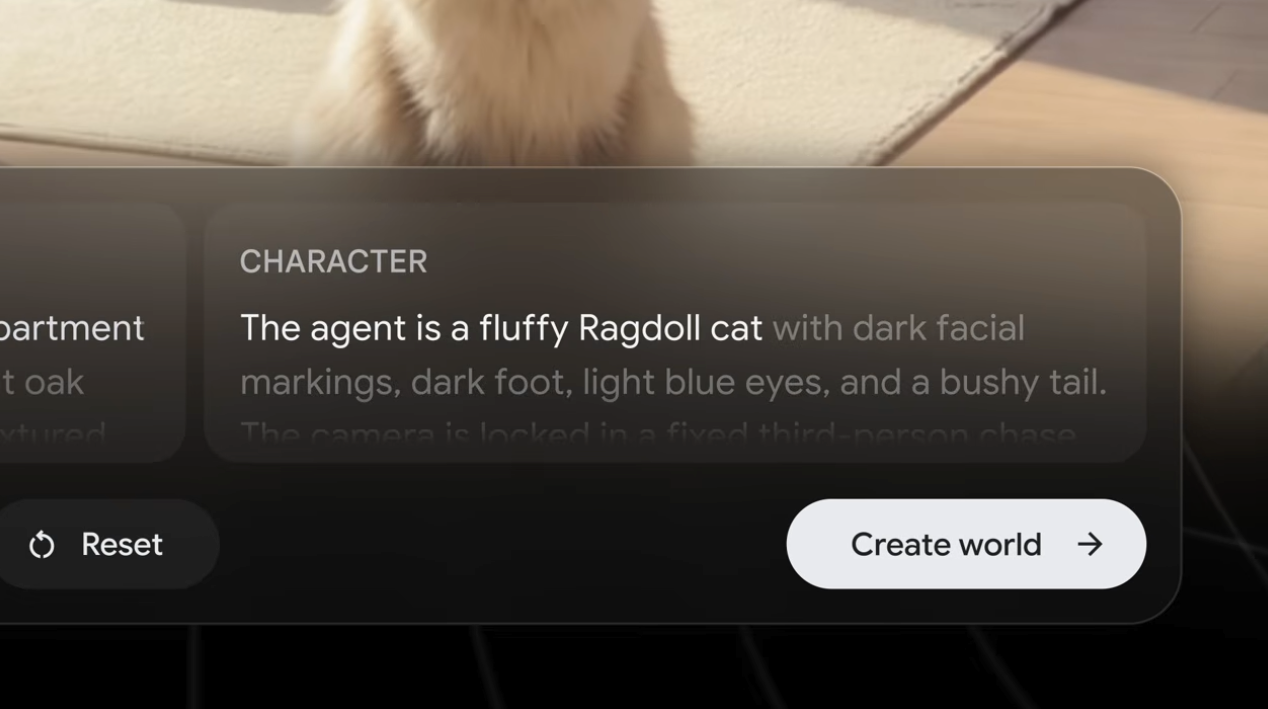

- アクションインターフェースは、人間の入力(キー、タッチ、または推論されたジェスチャー)をモデルのアクショントークンにマップします。初期のGenieバージョンはビデオから潜在アクション空間を推論していました。Genie 3はより洗練されたマッピングを提供するように見えます。シーン全体でより安定しています。

- レンダラー/デコーダーは、予測された潜在を、見たり制御したりできるフレームに戻します。理想的には低レイテンシーで。

テスト中に目立った2つの詳細:

- モデルはライブラリから物理を導入していません。訓練ビデオから学習できる「物理」を学習します。これが、オブジェクトが浮遊性や粘着性を感じることがある理由です。うまくいくと、不気味です。そうでないと、タッチスクリーン世界で手袋を履いているようです。

- 「レベルデザイン」と「ゲームプレイ」の間に厳密な分離はありません。それに画像または短いクリップを与えると、学習されたダイナミクスはそれをインタラクティブにしようとします。それはロールをぼかします。探索している場合は良い方法で、保証が必要な場合は面倒な方法で。

根源を知りたい場合、元の論文は依然として最も明確な概念的な根拠です。Genie: Generative Interactive Environments、およびDeepMindの書き込み。Genie 3は、データをスケーリングし、アクションマッピングを安定させ、出力忠実度を上げるイテレーションのように見えます。再発明というより、進化です。

トレーニング手法

実際には重要な点は、正確な損失関数ではなく、それが感覚にどのように影響するかです。

論文と公開講演から、レシピは次のようなものです:

- データ:2Dゲームとインターフェースと相互作用する人の大規模で雑然としたビデオ、プラス一般的なウェブビデオ。初期のGenieはピクセルだけから制御を推論していました。後のイテレーションは、利用可能な場合は軽量のアクショントレースを取り込みます。スケールにより、モデルは1つのエンジンに関連付けられることなく、「常識的な」遷移(ジャンプアーク、ボタンフラッシュ、メニューハイライト)を学習できます。

- 目的:潜在空間での自己教導的な次フレーム予測、時々マスク付きモデリングとインターリーブされます。観測された変化の原因となったアクションを推測する逆ダイナミクスの風味。そして、シーン全体でアクション空間を安定させるための一貫性の損失。

- 条件付け:プロンプト、参照画像、またはスターターフレームはコンテキストとして機能します。クリーンでハイコントラストなシード画像を提供すると、早期のちらつきが減少することに気付きました。忙しいテクスチャは、モデルが「落ち着く」までシマーリングエッジにつながりました。

なぜこれが重要なのか:モデルが脆いアノテーションに依存するほど少ないほど、ドメイン全体でそれが即興できる幅広いドメインです。しかし、その自由には代価があります。トレーニングミックスがプラットフォーマーに重い場合、生成されたインターフェースはプラットフォーマーのような応答に向かいます。私のテストでは、UIのモックアップでさえ、かすかな「ゲーム感覚」を開発しました。ホバー状態は跳ねます。パネルはスライドします。迅速なプロトタイピングに役立つ、本番UIにとって奇妙です。

1つの小さな実践的なメモ:バージョンに関係なく、ウォームアップフレームが重要です。何かに触れる前に1~2秒間モデルをロールさせた後、よりスムーズな制御が得られました。潜在状態を固定するために息をする機会を与えるようなものです。

生成機能

これはGoogle DeepMind Genie 3が注意を引く場所です。静止画像または短いクリップから、つついてみることができるものへの移行です。

3つの単純なプロンプトを試しました。それぞれ数回の実行:

- 棚の上のキャラクターの手書きスケッチ。

- カードを備えたUIダッシュボードのスクリーンショット。

- 机の上のおもちゃの車の写真。

結果(Genieに影響を受けたコミュニティビルドで観察):スケッチは2つのシード後に信じられるジャンプアークを備えたサイドスクローラーになりました。ダッシュボードは、矢印キーで「押す」ことができるパネルシャッフルインターフェースに変わりました。おもちゃの車のシーンが最も弱く、移動は起こりましたが、エッジが流血し、衝突は磁石のように感じました。最初の試行で時間を節約しませんでした。3番目または4番目までに、私はより速くはありませんでしたが、考えが少なくなりました。メンタル負荷が低下しました。それが勝利でした。

解像度と品質

品質は、このモデルのファミリーでは移動するターゲットのように感じられます。私のテストでは:

- ベース出力:480p相当は最も安定しているように見えました。720pは軽度のシマーで耐えました。その上に、詳細は改善されましたが、時間的な一貫性は低下し、細い線が振動しました。

- フレームレート:インタラクティブなセッションは、単一のGPUデスクトップで15~20 fpsの周りで快適に感じました。より高く押すと、レイテンシースパイクが導入されました。これは、ビジュアルを支援するよりも制御を傷つけます。

- 時間的一貫性:反復的なテクスチャ(草、グリッド、UI小型コピー)の領域はジッターする傾向がありました。よりクリーンなシード画像を提供し、カメラの動きを制限すると、効果が減少しました。

Genie 3デモでは、忠実度は最初の論文よりも明らかに優れています。特にキャラクターとHUDエレメントで。しかし、解像度を少し上げると、シャープネスと安定性を交換しないでください。目標が感覚プロトタイプの場合、その取引は問題ありません。動きの中でくっきりした読みやすいテキストが必要な場合、まだそこにありません。

制御メカニズム

コントロールは、初期のGenie再現と比較して、毎日の改善に気付いた場所です。

- アクションマッピングはシーン全体で一貫性がありました。矢印キーは「予期される」ことをおおよそ70~80%の時間中に行いました。各シードのマッピングを再学習する必要がありませんでした。

- 短いインプットバースト(プレスアンドホールドではなく)がより効果的でした。タップは、より洗練された遷移を作成しました。長いホールドは時々状態ドリフトを引き起こしました(キャラクターが棚を「溶かし」、パネルが永遠にスライドします)。

- プロンプトされた制約が助けになりました。スペースが「グリッドベース」または「ターンのような」であるべきであることをほのめかした場合、モデルはドリフトの瞬間が少なくなります。ハードな制約ではなく、損失景観への軽い押しのようなもの。

また、シードフレーム上の簡単なスケッチオーバーレイ(ボックス、矢印)も試しました。これは驚くべき効果をもたらしました。常に外観を変えるわけではありませんが、親切性に従いました。パネルの横の太い矢印は、左/右がそれをスライドする可能性を増やしました。これは、モデルがアクションセマンティクスを推論するために視覚的な手がかりに大きく依存しているという考えと一致しています。

レイテンシーは言及する価値があります。適度なフレームサイズでも、デコードとダイナミクスが同じデバイスで実行された場合にのみ、相互作用は妥当でした。プロセス全体に分割(またはColabからストリーミング)は、制御をぼやけさせるのに十分な遅延を追加しました。Genie 3がクリエイティブツールで有用である場合、低レイテンシーローカルまたはエッジ実行は非常に必須のようです。

現在のバージョンの制限

いくつかの制限が表示され続けました。実際の仕事にこれをフィットさせようとしている場合、それらは重要です。

- 長いホライズンの一貫性:連続的な遊びの約10~15秒後、世界は漂流します。プラットフォームは衝突ルールを忘れます。UIパネルはクリップします。迅速な感覚チェックには最適で、より長いものには不安定です。

- ビジュアル判読性:動きの下でテキストと細い線がシマーします。バイブプロトタイプには最適で、ユーザビリティウォークスルーには危険です。

- 決定性:同じシードは時々異なる親切性を生成します。探索には楽しいです。チームデモの再現性が必要な場合は、頭痛です。

- 安全性とIP:トレーニングは広範なビデオに傾くため、認識可能なスタイルがリークする可能性があります。配送している場合、ポリシーとレビューパスが必要になります。公開ドキュメントはまだこれを解決していません。

- 計算とレイテンシー:データセンターは必要ありませんが、重みを感じます。単一のコンシューマーGPUでは、速度と明確さを選択する必要がありました。

Google DeepMind Genie 3を現在の状態で高く評価するのは誰ですか?Unityをブートせずに感覚をテストしたいデザイナーと研究者。学生にダイナミクスを見るだけでなく、つついて欲しい教育者。メカニクスをアートの前に探索しているインディーの開発者。誰が実行しないか:本番環境で安定した相互作用が必要な人、ピクセル正確なUIの動作、または鉄板の再現性。

なぜこれが重要なのか:ほとんどのツールは、方向を選択した後、研磨するのに役立ちます。Genie 3はより早い段階を促します。「このアイデアは本当に興味深いのか?」の瞬間を安くします。それは劇的には聞こえませんが、火曜日の午後に試される内容を変えます。