Akses GLM-4.7-Flash melalui WaveSpeed API

Hei guys, aku Dora. Dorongannya berasal dari gangguan kecil: proyek lagi, API key lagi, dan SDK lain dengan idenya sendiri tentang token dan retry. Aku ingin mencoba GLM-4.7-Flash karena orang-orang terus menyebutkan kecepatannya untuk draft harian dan riset cepat. Tapi aku tidak ingin merekonstruksi stack aku hanya untuk menjalankan beberapa tes.

Jadi aku mencoba jalan yang lebih tenang: akses GLM-4.7-Flash via WaveSpeed API. Pola klien yang sama, satu key, model diganti. Aku menguji ini di beberapa script di Januari 2026 dan mencatat semuanya. Tidak ada yang dramatis di sini. Tapi ini membuat hari-hari aku sedikit lebih ringan. Dan jujur, itulah standarnya sekarang—lebih ringan mengalahkan lebih keras.

Mengapa Menggunakan WaveSpeed

Aku tidak akan pura-pura WaveSpeed adalah sihir. Ini lebih seperti laci adapter yang andal: tidak menarik, tapi itu yang aku ambil ketika aku ingin melanjutkan pekerjaan aku.

Yang penting bagi aku bukanlah jumlah model, tapi kekurangan gesekan. Aku bisa mengarahkan kode yang sama ke model berbeda, mengganti satu baris, dan melanjutkan. Itu saja, tidak ada drama.

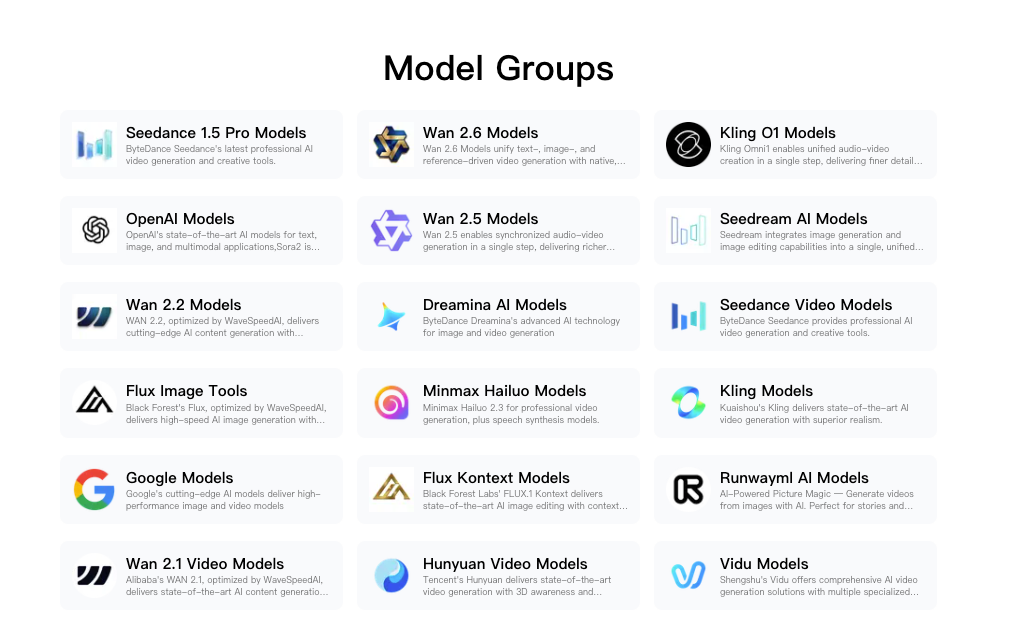

Satu API Key, 600+ Model

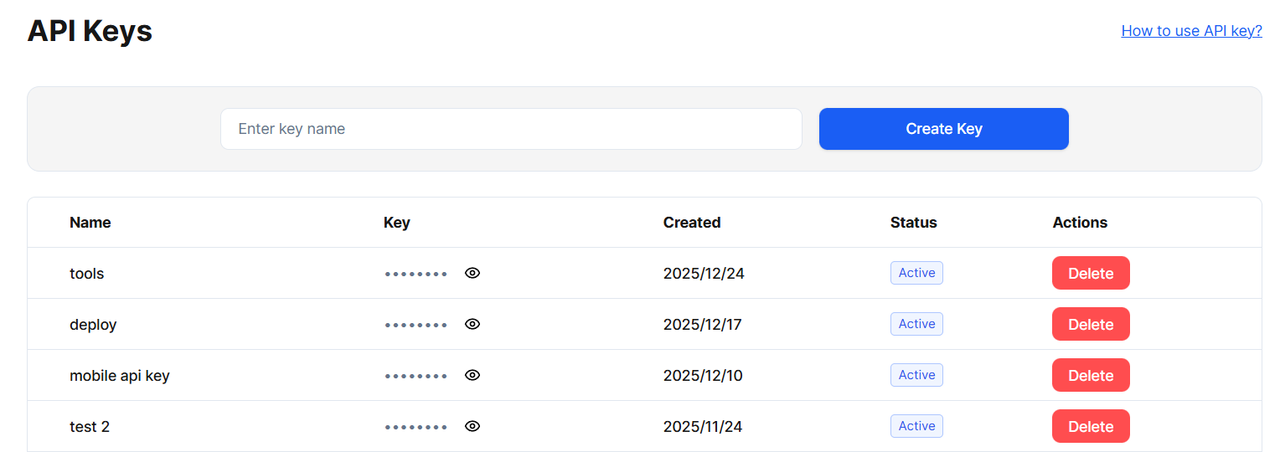

Kemenangan nyata aku adalah mental. Aku tidak berburu melalui dashboard provider untuk memutar key atau membatasi pengeluaran. Satu key di manajer rahasia aku, dan aku bisa merutekan ke GLM-4.7-Flash untuk draft cepat, kemudian lompat ke model yang lebih berat ketika prompt butuh kedalaman lebih. Aku masih menetapkan batasan per-proyek, tapi overheadnya berkurang.

Dalam praktik: aku menyimpan variabel lingkungan yang ada (WAVESPEED_API_KEY dalam kasus aku), dan hanya mengganti nama model. Keputusan kecil itu—menjaga nama selaras, bukan pintar—menyelamatkan aku dari memecahkan CI.

Tidak Ada Pengalihan SDK

Aku tetap dengan klien yang kompatibel OpenAI yang sudah aku gunakan. Tidak ada nama metode baru, tidak ada pembelajaran ulang flag streaming. Jika kami telah membangun utilitas kecil di sekitar chat completion, streaming, dan tool call, mereka sebagian besar terbawa. Aku suka bahwa WaveSpeed tidak meminta aku untuk mengadopsi pandangan dunianya sebelum ia mengembalikan token, jika itu masuk akal.

Dua peringatan yang aku perhatikan:

- Nama model bervariasi di seluruh provider. Aku memeriksa dua kali pengidentifikasi yang tepat dalam dokumen WaveSpeed resmi sebelum melakukan komit kode.

- Fitur khusus provider (seperti format respons khusus atau quirk function-call) masih bisa berbeda. Simpan file adapter kecil di mana kami menormalkan payload. Milik aku adalah 60 baris dan membayar sewa setiap minggu.

Kode Mulai Cepat

Aku menggunakan endpoint gaya OpenAI yang WaveSpeed ekspos. Jika kode amu sudah mencapai Chat Completions API, ini seharusnya terasa akrab. Satu-satunya perubahan nyata adalah URL dasar dan nama model.

Aku menguji ini pada 12–15 Jan, 2026 dengan prompt batch kecil. Prompt pendek mulai streaming dalam waktu kurang dari satu detik pada koneksi aku. Jelas, pengalaman amu akan bervariasi dengan jaringan, ukuran prompt, dan beban server.

Contoh Pengganti Drop-in

Ini adalah bentuk yang aku gunakan. Periksa dokumen WaveSpeed resmi untuk pengidentifikasi model terbaru (aku telah melihatnya terdaftar sebagai glm-4.7-flash).

Node.js (fetch):

const resp = await fetch("https://api.wavespeed.ai/v1/chat/completions", {

method: "POST",

headers: {

"Content-Type": "application/json",

"Authorization": `Bearer ${process.env.WAVESPEED_API_KEY}`

},

body: JSON.stringify({

model: "glm-4.7-flash",

messages: [

{ role: "system", content: "You are a concise assistant." },

{ role: "user", content: "Summarize this link in 3 bullets: https://example.com/post" }

],

temperature: 0.3,

stream: true

})

});Python (requests):

import os, requests

url = "https://api.wavespeed.ai/v1/chat/completions"

headers = {

"Authorization": f"Bearer {os.environ['WAVESPEED_API_KEY']}",

"Content-Type": "application/json",

}

payload = {

"model": "glm-4.7-flash",

"messages": [

{"role": "system", "content": "You are a concise assistant."},

{"role": "user", "content": "Outline a 5-step plan to vet a research source."}

],

"temperature": 0.2

}

r = requests.post(url, headers=headers, json=payload, timeout=30)

r.raise_for_status()

print(r.json()["choices"][0]["message"]["content"])Catatan kecil yang aku temukan berguna:

- Jika aplikasi amu streaming token, bawa parsing SSE yang sama: flag stream WaveSpeed berperilaku seperti yang diharapkan dalam tes aku.

- Aku menetapkan timeout per-permintaan sedikit lebih tinggi dari biasanya ketika aku tidak yakin tentang beban model.

- Catat nama model dalam respons. Masa depan-amu akan berterima kasih ketika output melenceng dan amu perlu mengkonfirmasi apa yang berjalan.

Gabungkan dengan Model Lain

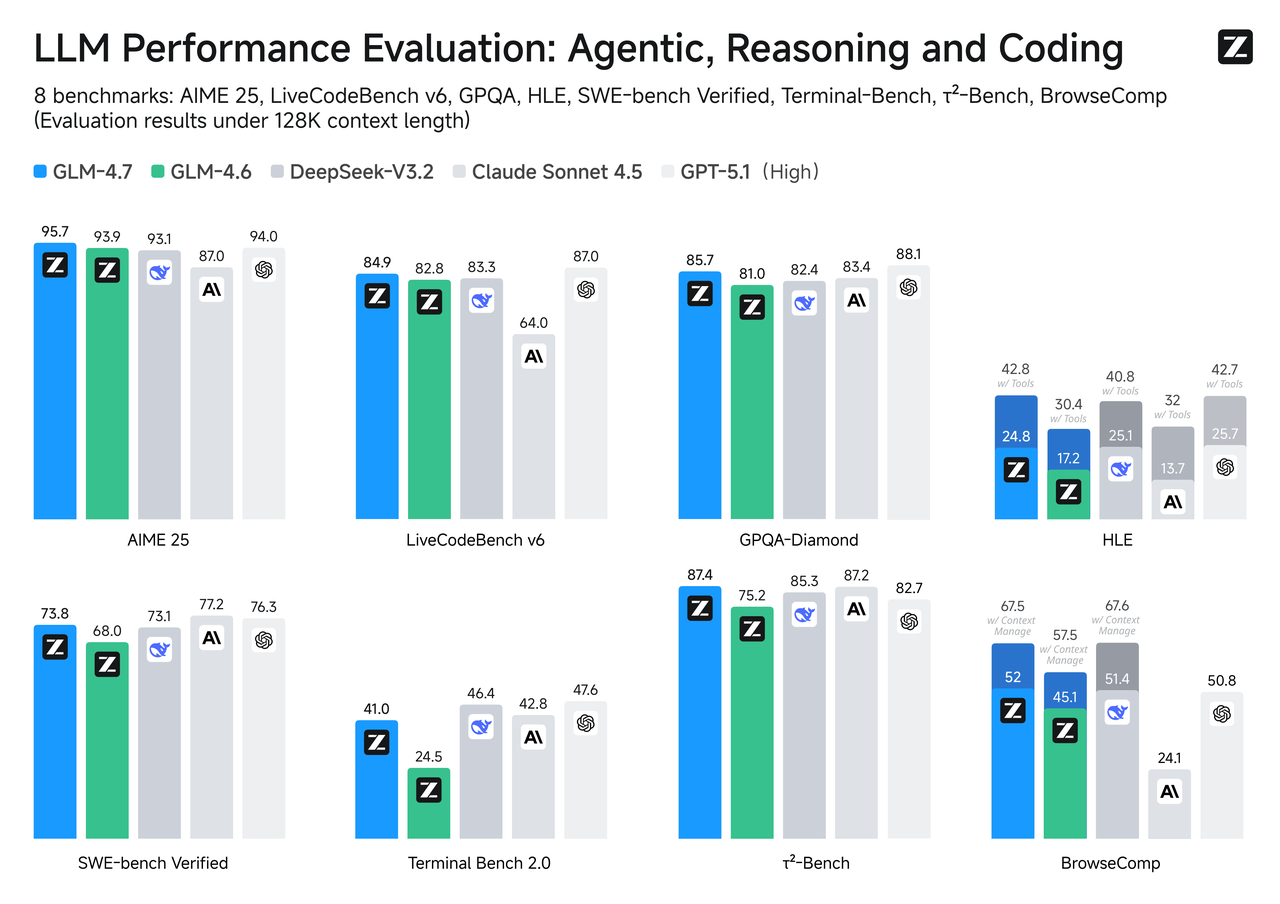

Sebagian besar pekerjaan aku mencampur model. GLM-4.7-Flash cepat untuk pass pertama, draft, merangkum, menjawab pertanyaan dasar. Ketika aku butuh penalaran lebih berat, atau kemampuan spesifik (seperti penerjemah kode yang kuat atau fitur visi tertentu), aku merutekan ke tempat lain. WaveSpeed membiarkan aku menyimpan routing itu di satu tempat.

Apa yang sedikit mengejutkan aku: aku mengharapkan switching model mid-run terasa berantakan. Tidak. Prompt tetap dalam bentuk yang sama, jadi aku bisa membandingkan output tanpa memutar kode.

Alur Kerja Teks + Gambar

Aku mencoba rutinitas kecil: kumpulkan screenshot dari laporan pengguna, jalankan OCR ringan atau caption visi, kemudian minta GLM-4.7-Flash untuk menghasilkan ringkasan tindakan dalam bahasa biasa.

Langkah aku:

- Gunakan model yang mampu visi untuk mengekstrak teks/label dari gambar. Jaga output tetap kompak, pikirkan pasangan kunci-nilai atau bullet pendek.

- Berikan teks itu ke GLM-4.7-Flash dengan prompt sistem yang stabil (dua baris), dan minta ringkasan pendek dengan keputusan.

- Jika gambar memiliki tabel, aku tambahkan aturan cepat: “Pertahankan angka dan unit dengan tepat.” Ini mengurangi pembersihan nanti.

Catatan lapangan:

- Pada PNG 1.2MB dengan UI + teks campuran, pass visi memakan waktu ~2–4 detik untuk aku: ringkasan GLM-4.7-Flash kembali dalam waktu kurang dari satu detik. Split itu membuat alur terasa snappy.

- Biaya dapat diprediksi karena aku membatasi output visi ke beberapa ratus token sebelum menyerahkannya.

- Jika amu tidak membutuhkan nuansa visi, jalankan OCR dasar terlebih dahulu (Tesseract atau API OCR berbayar), kemudian berikan teks ke GLM-4.7-Flash. Lebih murah, sering cukup baik.

Alur Kerja Teks + Video

Video lebih berat, jelas. Aku tidak mengirim video lengkap ke model apa pun. Aku tarik transcript terlebih dahulu (whisper atau ASR berbayar), kemudian rutekan bagian ke GLM-4.7-Flash untuk ringkasan cepat.

Loop yang bekerja:

- Transkripsikan video sekali. Jika amu bisa, simpan timestamp.

- Chunk dengan speaker turn atau segmen 3–5 menit (mana pun lebih bersih).

- Minta GLM-4.7-Flash untuk ringkasan segmen dan keputusan. Jaga prompt sistem yang tertambat: “Amu mengembalikan hanya JSON terstruktur dengan field A/B/C.”

- Jahit outline tingkat atas dari segmen dengan pass kedua.

Dalam praktik, GLM-4.7-Flash terasa tepat untuk ringkasan segmen: cepat, gesekan rendah, akurasi cukup baik untuk perencanaan. Untuk outline akhir, aku kadang-kadang model switched untuk tone atau nuansa. Aku menyimpan semuanya di dalam WaveSpeed jadi kode aku tidak mengubah bentuk.

Harga

Harga adalah tempat aku memperlambat. Bukan karena rumit, tapi karena kejutan muncul di log, bukan dashboard.

GLM-4.7-Flash di WaveSpeed

Mulai Januari 2026, GLM-4.7-Flash tersedia melalui WaveSpeed dengan tarif per-token miliknya sendiri. Angka pastinya bisa bergeser, jadi aku tidak akan mengikat mereka di sini. Aku memeriksa halaman harga resmi sebelum mendorong apa pun ke produksi dan menetapkan soft limit di config env aku.

Bagaimana aku memperkirakan:

- Sampel prompt tipikal + respons. Kalikan dengan jumlah run harian. Itu membawa aku ke token harian.

- Tambahkan 20–30% ruang kepala untuk hari buruk atau prompt baru.

- Bandingkan itu dengan model yang lebih lambat tetapi lebih murah untuk tugas yang sama. Jika model yang lebih lambat tidak meningkatkan waktu editing manusia, itu mungkin menang secara keseluruhan.

Satu trik praktis: log token oleh feature flag. Aku beralih GLM-4.7-Flash untuk slice pengguna dan membandingkan waktu edit dan keluhan. Itu memberitahu aku lebih banyak daripada tabel harga.

Diskon Volume

WaveSpeed menawarkan harga berbasis volume. Tier penting jika amu batch job atau jalankan data backfill. Aku menghubungi sekali untuk mengkonfirmasi threshold sebelum minggu lonjakan: jawabannya jelas dan menyelamatkan aku dari pembatasan pekerjaan dalam jendela yang canggung.

Aturan aku: jika aku mengharapkan ledakan 10x, kampanye, migrasi, atau sprint penelitian, aku email support terlebih dahulu. Poin itu bukan deal khusus: itu adalah ceiling yang jelas jadi aku tidak babysit job semalaman, karena tidak ada yang menginginkan itu.

Kami membangun WaveSpeed untuk tepat jenis alur kerja ini: lebih sedikit key, lebih sedikit pengalihan SDK, dan lebih sedikit waktu yang dihabiskan untuk memikirkan infrastruktur. Jika amu menggali model dan hanya ingin mereka berperilaku di balik API tunggal yang dapat diprediksi, itu adalah masalah yang kami coba selesaikan.

➡️Amu bisa mengeksplornya di sini.

Sekarang giliran amu: apa sirkus API-key paling konyol yang telah amu hadapi akhir-akhir ini? Turunkannya di komentar—aku akan membacanya semua sambil menyeruput kopi dan merasa sedikit lebih tidak sendirian.