Pengaturan Pelatihan LoRA WAN 2.2: Learning Rate, Langkah, dan Trigger Words Terbaik

Hei teman-teman. Kalian tahu nggak? Saya suka bagaimana WAN 2.2 menangani kulit dan pencahayaan, tapi kebiasaan pelatihan LoRA saya yang biasa tidak diterjemahkan dengan bersih. Wajah menjadi terlalu mengkilap, dan model terus menarik latar belakang ke tampilan studio lembut yang sama. Bukan “salah,” hanya bukan milik saya. Jadi di awal Januari 2026, saya menjalankan beberapa eksperimen singkat untuk menemukan pengaturan pelatihan LoRA khusus WAN 2.2 yang terasa masuk akal. Tidak ada yang meriah. Hanya cukup untuk mengurangi kilau plastik, mempertahankan subjek tetap stabil, dan tetap membiarkan model dasar bernapas.

Jika Anda mencari template cepat: ini bukan itu. Saya berbagi apa yang bertahan selama beberapa kali menjalankan, di mana saya ragu-ragu, dan bagaimana saya menyesuaikan. Kata kunci target di sini jelas, pengaturan pelatihan LoRA WAN 2.2, tetapi tujuannya adalah pekerjaan yang lebih tenang, bukan lubang kelinci baru.

Mengapa WAN LoRA Berbeda

Saya memperhatikan WAN 2.2 berperilaku seperti checkpoint SDXL yang sangat berpendapat: disesuaikan untuk potret yang tajam, gradien mulus, dan cahaya sinematik. Ketika saya melatih LoRA dengan cara yang saya lakukan pada basis SDXL yang lebih sederhana, WAN terus mendorong hasil saya kembali ke vibe studio yang halus itu.

Catatan lapangan:

- Gravitasi prompt sangat kuat. Bahkan bobot ringan (0,4–0,6) menarik menuju kulit bersih dan framing simetris.

- Pengelompokan warna muncul lebih awal. Jika dataset Anda condong hangat, WAN memperbesarnya.

- Latar belakang menjadi homogen. Tanpa dorongan, itu default ke kedalaman bidang dangkal dan bokeh lembut, apa pun yang Anda masukkan.

Apa yang berubah dalam praktik: Saya menurunkan tingkat pembelajaran, menggunakan lebih banyak gambar regularisasi dari biasanya, dan sengaja membuat keterangan membosankan. WAN 2.2 menghargai pengendalian diri. Ketika saya mencoba “mengajar” gaya dan subjek pada waktu yang sama, overfitting segera muncul.

Jika Anda datang dari kebiasaan LoRA SD 1.5, pikir: lebih sedikit trik yang cerdas, lebih banyak baseline yang terkontrol. Jika Anda terbiasa dengan SDXL, pergi sedikit lebih lambat dari normal dan bakar regularisasi lebih awal.

Panduan Ukuran Dataset

Saya menjalankan empat sesi dengan set potret yang dikurasi (5–12 Jan 2026), masing-masing dengan keterangan yang rapi dan pencahayaan campuran. Inilah yang bertahan:

- 8–12 gambar: Cukup untuk menambatkan silhouet orang atau produk tertentu. Gunakan regularisasi kuat. Jaga komposisi tetap bervariasi.

- 15–30 gambar: Titik manis untuk identitas subjek tunggal dengan gaya ringan. Tambahkan 20–40% shot non-potret jika Anda ingin latar belakang untuk digeneralisasi.

- 40–80 gambar: Berguna ketika Anda mengkodekan tampilan merek yang konsisten atau lini objek multi-sudut. Anda akan memerlukan keterangan yang cermat dan lebih banyak langkah.

Hal-hal yang penting lebih dari jumlah mentah:

- Keragaman pose di atas keragaman lokasi. WAN menggeneralisasi lokasi dengan baik: kesulitan ketika setiap shot adalah sudut yang sama.

- Keseimbangan eksposur. Jika setengah set Anda underexposed, WAN menggelapkan semuanya nanti. Saya menstandarkan histogram sebelum pelatihan.

- Kesederhanaan keterangan. Deskriptif, bukan puitis. “subject_token, jaket denim, cahaya jendela, close-up sedang” mengalahkan “potret candid yang murung di dekat jendela yang hujan.”

Untuk LoRA identitas, saya mendarat di 12–20 gambar sebagai dasar yang dapat diandalkan. Untuk gaya LoRA, 30–50 memberi saya ruang untuk bernapas tanpa runtuh ke kilauan potret standar WAN.

Baseline LR/Steps

Pengaturan pelatihan LoRA WAN 2.2 yang terasa stabil untuk saya (Kohya-ss dan basis SDXL):

- Rank (dim): 16–32. Saya default ke 16 untuk identitas, 32 untuk gaya.

- Alpha: cocokkan dim (mis., 16/16). Alpha yang lebih rendah membuat hasil rapuh.

- Optimizer: AdamW dengan weight_decay 0,01.

- Tingkat pembelajaran: 5e-5 untuk identitas, 7e-5 hingga 1e-4 untuk gaya. WAN menghukum LR tinggi dengan kulit plastik dan lonjakan kehilangan.

- Scheduler: cosine dengan warmup. Warmup 5% dari total langkah.

- Ukuran batch: 2–4 (A100/4090). Akumulasi gradien untuk mensimulasikan 8 jika diperlukan.

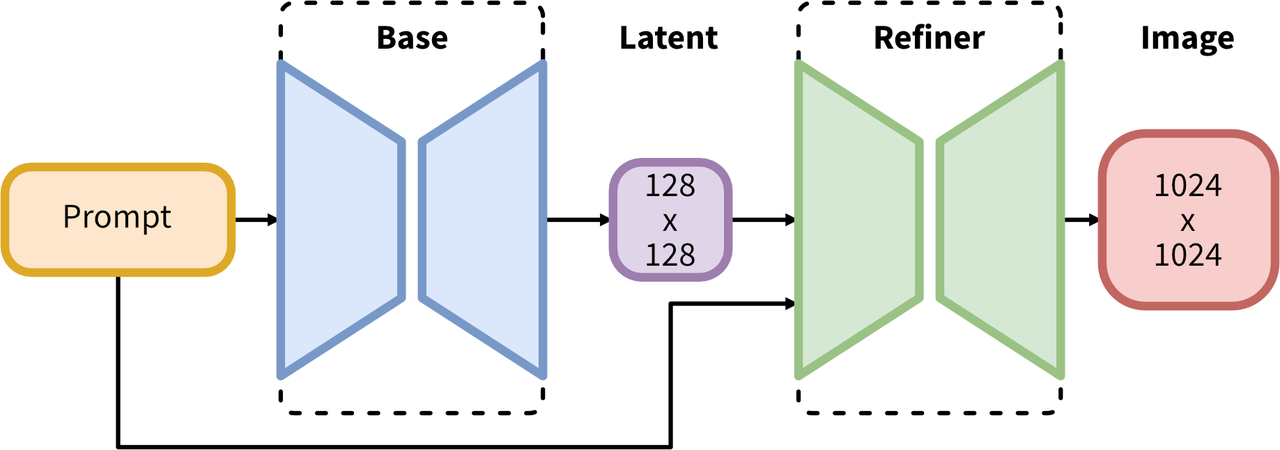

- Resolusi: SDXL-native 1024 di sisi panjang dengan bucketing (mis., 1024×768, 1024×1024). Jangan upsize: itu hanya mengingat kebisingan.

- Epochs/steps: Saya berhenti menggunakan langkah, bukan epoch.

- 12–20 gambar: 1.200–2.000 langkah

- 30–50 gambar: 2.000–3.500 langkah

- 60–80 gambar: 3.500–5.000 langkah

Pemeriksaan akal sehat yang saya gunakan:

- Simpan setiap 200–400 langkah dan pratinjau dengan prompt + seed yang tetap.

- Jika sampel tajam terlalu cepat sebelum langkah 600, LR tinggi.

- Jika identitas tidak terkunci pada ~1.400 langkah pada set 20-gambar, keterangan atau regularisasi lebih besar dari LR.

Angka-angka ini tidak akan memenangkan papan peringkat, tetapi mereka tahan terhadap kecenderungan WAN untuk menghaluskan semuanya.

Strategi Kata Pemicu

Saya membuat pemicu minimal. WAN sudah memiliki prior yang kuat: menumpuk token yang indah hanya menambah kebisingan.

Yang saya lakukan:

- Satu token instans + satu token kelas. Contoh: “sora_person” sebagai instans, “person” atau “woman/man” sebagai kelas dalam keterangan.

- Letakkan token instans di awal setiap keterangan. Jaga agar tetap lowercase, satu kata jika bisa.

- Hindari token gaya di LoRA yang sama kecuali Anda benar-benar menginginkan LoRA gaya. Pencampuran identitas dan gaya di WAN 2.2 menjadi keruh dengan cepat.

Dalam prompt, saya hanya memanggil LoRA dan token instans, kemudian menyusun kemudi yang lembut:

- lora: nama pada 0,5–0,8

- token instans awal dalam prompt

- kata gaya terlambat dan ringan (“cahaya alami, warna bersih, retouch minimal”)

Saya mencoba pemicu “gaya WAN” yang ditemukan karena penasaran. Mereka tidak membantu. Basis sudah melakukan bagian itu, LoRA harus mengukir apa yang Anda butuhkan, bukan mengumumkan kembali apa yang WAN 2.2 pandai.

Gambar Regularisasi

Ini adalah pahlawan yang diam. Saya menggunakan gambar regularisasi 1–3x per gambar pelatihan, cocok dengan kelas untuk keterangan.

- Untuk LoRA identitas: 20–60 gambar reg berlabel sebagai kelas yang sama (“person”). Saya menghasilkannya dari WAN 2.2 itu sendiri dengan prompt biasa: “foto orang, latar belakang netral, close-up sedang, cahaya alami.”

- Untuk LoRA objek: gambar reg per kelas produk (“shoe,” “bottle,” “chair”). Jaga agar tetap akurat: jangan campurkan kelas.

Mengapa itu penting: WAN 2.2 suka mencetak estetika potretnya di semuanya. Gambar reg memberinya izin untuk menjaga jangkauan basis sambil membiarkan LoRA menahan identitas. Tanpanya, LoRA saya over-aksen penghalusan kulit dan bokeh, kemudian menolak untuk pergi.

Pengaturan yang terasa benar:

Pengaturan yang terasa benar:

- Jaga gambar reg secara visual hambar dan well-exposed.

- Jangan caption gambar reg dengan token instans: hanya kelas.

- Campurkan 10–20% batch pelatihan dengan gambar reg di seluruh (bukan hanya di awal).

Jika Anda kekurangan waktu, tambahkan gambar reg sebelum Anda memodifikasi optimizer. Itu adalah tuas yang lebih besar di sini.

Deteksi Overfit

Saya tidak mengandalkan kerugian saja. WAN menyembunyikan overfitting di balik sampel yang cantik. Ini adalah penunjuk saya:

- Inersia prompt: mengubah prompt hampir tidak mengubah output. Semuanya melayang kembali ke lensa dan latar belakang yang sama.

- Plastisitas kulit: pori-pori menghilang secara merata, terutama di sekitar pipi dan dahi, bahkan dengan prompt pencahayaan yang kasar.

- Pose yang bergema: sudut bahu/leher yang berulang di seluruh seed yang bervariasi.

- Kunci warna: nada hangat yang menempel di seluruh isyarat keseimbangan putih yang berbeda.

Pemeriksaan cepat yang saya jalankan setiap 200–400 langkah:

- Prompt adversarial: beralih ke “cahaya kantor overhead yang keras, fluorescent, tidak menyenangkan” dan lihat apakah tekstur kembali.

- Flip latar belakang: paksa “jalan ramai, rak berantakan” untuk menguji fleksibilitas komposisi.

- Tekanan prompt negatif: tambahkan “kulit yang sangat halus, tekstur plastik, retouch berat” dan lihat apakah itu mendengarkan.

Jika dua tes itu gagal berturut-turut, saya kembali ke checkpoint sebelumnya dan menambahkan lebih banyak gambar reg atau menurunkan LR satu tingkat.

Fix Collapses

Saya mengalami dua jenis keruntuhan: peleburan identitas dan kunci gaya.

Ketika identitas mencair (wajah melayang, mata salign):

- Turunkan LR satu langkah (mis., 7e-5 → 5e-5).

- Tingkatkan rank dari 16 ke 32 hanya jika dataset memiliki sudut cukup: jika tidak, itu mengingat pose, bukan identitas.

- Ketatkan keterangan: potong sifat, pertahankan hints panjang fokus, pertahankan token instans terlebih dahulu.

- Tambahkan 10–20 gambar reg lebih banyak dari kelas yang sama.

Ketika gaya terkunci (semuanya terlihat seperti potret studio standar WAN):

- Tambahkan shot non-potret ke dataset (lingkungan, tangan, tubuh parsial).

- Tingkatkan langkah sebesar 400–800 dengan jadwal cosine: jangan lonjak LR.

- Kurangi bobot LoRA pada inferensi (0,8 → 0,5) dan dorong bimbingan lebih rendah (CFG 5–6 → 3,5–4,5). WAN merespons dengan baik terhadap CFG yang lebih rendah.

- Jika menggunakan noise offset atau aug warna berat, kurangi. WAN sudah menstabilkan warna: aug ekstra membuat output saya keruh.

Knob lain yang membantu:

- Gradient clipping pada 1,0 untuk menghindari lonjakan mendadak.

- EMA off untuk run kecil: dengan dataset kecil, EMA membuat identitas tertinggal dari pratinjau.

- Disiplin seed: pratinjau dengan seed tetap setiap saat. Perubahan kecil lebih mudah dinilai ketika semuanya berdiri diam.

Export & Reuse

Beberapa kebiasaan menghemat waktu saya nanti:

- Simpan checkpoint inkremental dengan nama yang jelas: model, rank, LR, steps, dan tanggal. Contoh: wan22_lora_id_r16_lr5e-5_s1800_2026-01-09.safetensors.

- Jaga prompt pelatihan, prompt validasi, dan seed dalam metadata LoRA jika alat Anda mendukungnya. Saya di masa depan selalu berterima kasih kepada saya di masa lalu.

- Penggunaan versi-sticky: LoRA yang dilatih pada WAN 2.2 bekerja terbaik pada WAN 2.2 dan saudara dekat. Mereka dapat digunakan di basis SDXL lainnya, tetapi penanganan warna dan kulit bergeser. Saya memperlakukan mereka sebagai “WAN-first.”

- Default inferensi yang terasa baik:

- Bobot LoRA 0,5–0,8 (identitas), 0,3–0,6 (overlay warna gaya)

- CFG 3,5–5,5

- 30–40 langkah dengan sampler stabil (DPM++ 2M Karras berfungsi baik)

- Jaga prompt tetap pendek: WAN mendengar nudge halus

Jika Anda ingin menggabungkan LoRA: saya memiliki keberuntungan yang lebih baik menumpuk LoRA kecil yang berpurpose tunggal (identitas pada 0,6 + tampilan warna ringan pada 0,3) daripada melatih satu LoRA besar “semuanya.” WAN menghormati modularitas.

Untuk alur kerja dan contoh WAN 2.2 yang lebih terperinci, lihat dokumentasi ComfyUI resmi.

Untuk pelatihan, saya masih lebih suka menjalankan hal-hal secara lokal di mana saya bisa melihat setiap knob. Tetapi ketika menyangkut inferensi, routing model, atau beralih antar model dasar tanpa mengocok API, Anda dapat mencoba WaveSpeed kami. Itu menjaga model yang berbeda di balik satu endpoint konsisten sehingga saya dapat fokus pada prompt dan output alih-alih infrastruktur.

Untuk pelatihan, saya masih lebih suka menjalankan hal-hal secara lokal di mana saya bisa melihat setiap knob. Tetapi ketika menyangkut inferensi, routing model, atau beralih antar model dasar tanpa mengocok API, Anda dapat mencoba WaveSpeed kami. Itu menjaga model yang berbeda di balik satu endpoint konsisten sehingga saya dapat fokus pada prompt dan output alih-alih infrastruktur.