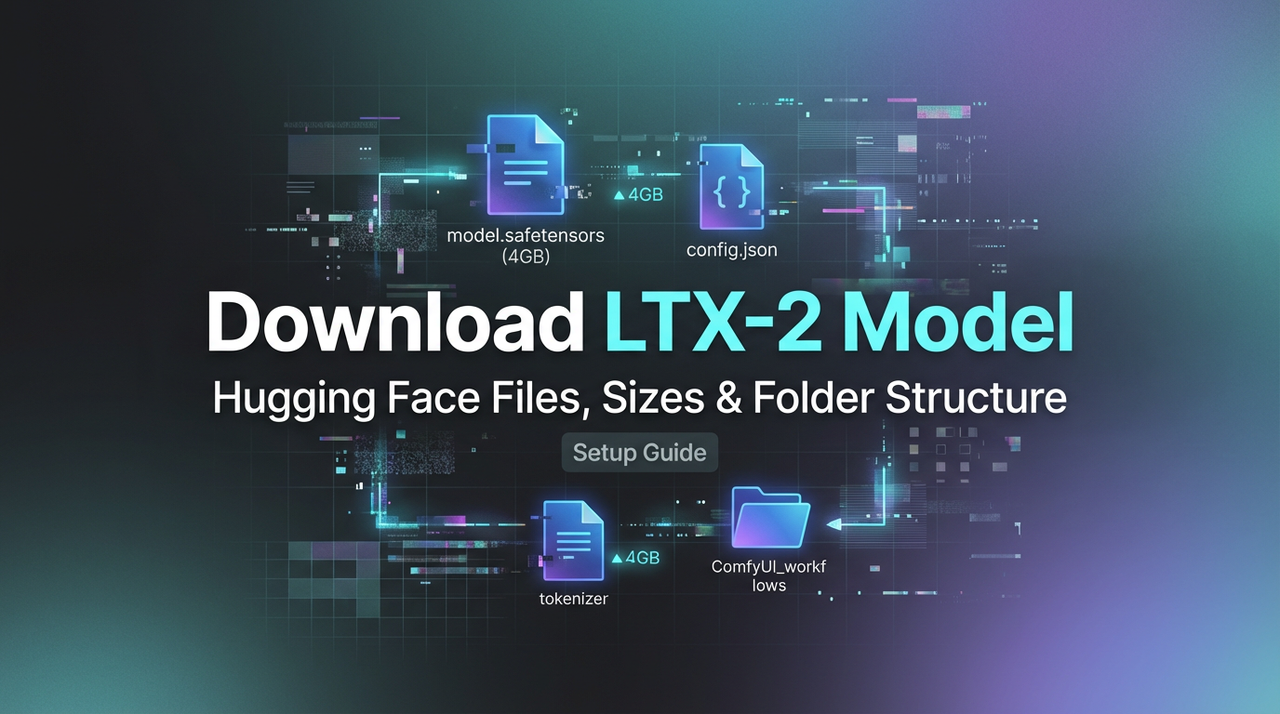

Download Model LTX-2: File Hugging Face, Ukuran & Struktur Folder

Pertama kali saya mencari unduhan LTX-2, itu bukan rencana besar. Saya hanya ingin menjalankan batch kecil melalui ComfyUI dan terus tersandung pada dua hambatan yang sama: unduhan lambat yang macet di 92%, dan pesan misterius “Model not found” setelah saya akhirnya memiliki file. Tidak dramatis. Hanya jenis gangguan berulang yang mendorong Anda untuk berhenti dan merapikan alur kerja.

Saya menghabiskan beberapa malam di awal Januari 2026 menguji sumber berbeda, format (NVFP4 vs NVFP8), dan tata letak folder di kotak GPU 24GB. Tidak ada yang mencolok, hanya cukup untuk melihat apa yang solid versus rapuh. Berikut adalah jalan yang mengurangi kekacauan bagi saya, dengan catatan yang dapat Anda baca dan pinjam.

Sumber Unduhan LTX-2 Resmi (Kartu Model Hugging Face)

Saya tidak mengejar mirror. Jika model penting untuk alur kerja saya, saya ingin jejak yang membosankan dan dapat diandalkan. Untuk LTX-2, itu berarti dimulai dari kartu model Hugging Face resmi.

Saya tidak mengejar mirror. Jika model penting untuk alur kerja saya, saya ingin jejak yang membosankan dan dapat diandalkan. Untuk LTX-2, itu berarti dimulai dari kartu model Hugging Face resmi.

Apa yang saya cari sebelum saya klik unduh:

- Penerbit: Apakah itu organisasi yang terverifikasi atau penulis yang terikat pada LTX-2? Saya memeriksa lencana organisasi dan bahwa repo lain di namespace terlihat hidup dan konsisten.

- Lisensi & ketentuan: Beberapa varian LTX-2 dibatasi atau memiliki batasan penggunaan. Jika menerima persyaratan memerlukan token, saya lebih suka melakukannya sekali daripada debug kesalahan auth nanti.

- Daftar artefak: Saya menyorot model utama, encoder apa pun, dan varian yang disaring atau dikuantisasi. Nama file yang jelas mengalahkan yang cerdas.

- Instruksi: Jika kartu menghubungkan ke ComfyUI atau dokumentasi khusus node, saya mengikuti yang pertama. Satu baris tentang folder yang diharapkan dapat menghemat setengah jam menebak.

Tip praktis: gunakan CLI Hugging Face dengan kredensial yang ditetapkan. Repo yang dibatasi tidak akan ditarik di atas git-lfs mentah tanpa token, dan itu adalah cara tercepat untuk berakhir dengan file parsial dan tidak ada kesalahan sampai Anda mencoba memuatnya.

pip install huggingface_hub git-lfs

huggingface-cli login # tempel token AndaSaya tahu, jelas. Tetapi berapa kali saya telah melihat 403 senyap berubah menjadi “model not found” di hilir adalah… tidak nol.

Daftar File & Ukuran (model utama / encoder / disaring)

Saya tidak menghafal ukuran file. Saya hanya membutuhkan perkiraan untuk merencanakan disk dan memutuskan varian mana yang akan diambil terlebih dahulu. Berikut adalah apa yang benar-benar saya lihat di seluruh penurunan LTX-2 terbaru. Repo Anda mungkin berbeda, selalu percayai kartu model daripada catatan saya.

Artefak tipikal yang akan Anda lihat:

- Titik pemeriksaan model utama (sering

.safetensorsatau format khusus runtime): ~2,5–6,0 GB. Lebih besar jika termasuk kepala ekstra atau multi-presisi; lebih kecil jika dikuantisasi. - Encoder teks/gambar (CLIP atau serupa): ~400 MB–1,5 GB. Beberapa build menggabungkan ini; yang lain mengirimkannya sebagai file terpisah.

- VAE atau adaptor laten (jika berlaku): ~100–500 MB.

- Varian yang disaring: ~1–3 GB. Lebih cepat dan lebih ringan, terkadang dengan output sedikit lebih lembut. Bagus untuk prototipe.

- Varian yang dikuantisasi (NVFP8/NVFP4): ukuran bervariasi, tetapi harapkan 30–60% lebih sedikit disk daripada presisi penuh.

Pola penamaan yang saya perhatikan:

ltx-2.safetensors(utama)ltx-2-encoder.safetensorsatauopen_clip-vit-…(encoder)ltx-2-vae.safetensors(jika terpisah)ltx-2-distilled-…(lebih kecil, lebih cepat)ltx-2-nvfp8/ltx-2-nvfp4(khusus format)

Jika disk terbatas, saya ambil yang disaring terlebih dahulu, validasi saluran saya, lalu tarik model penuh. Bukan hanya tentang kecepatan: mengurangi beban kognitif run pertama membantu saya menguji prompt dan node tanpa langsung memerangi VRAM.

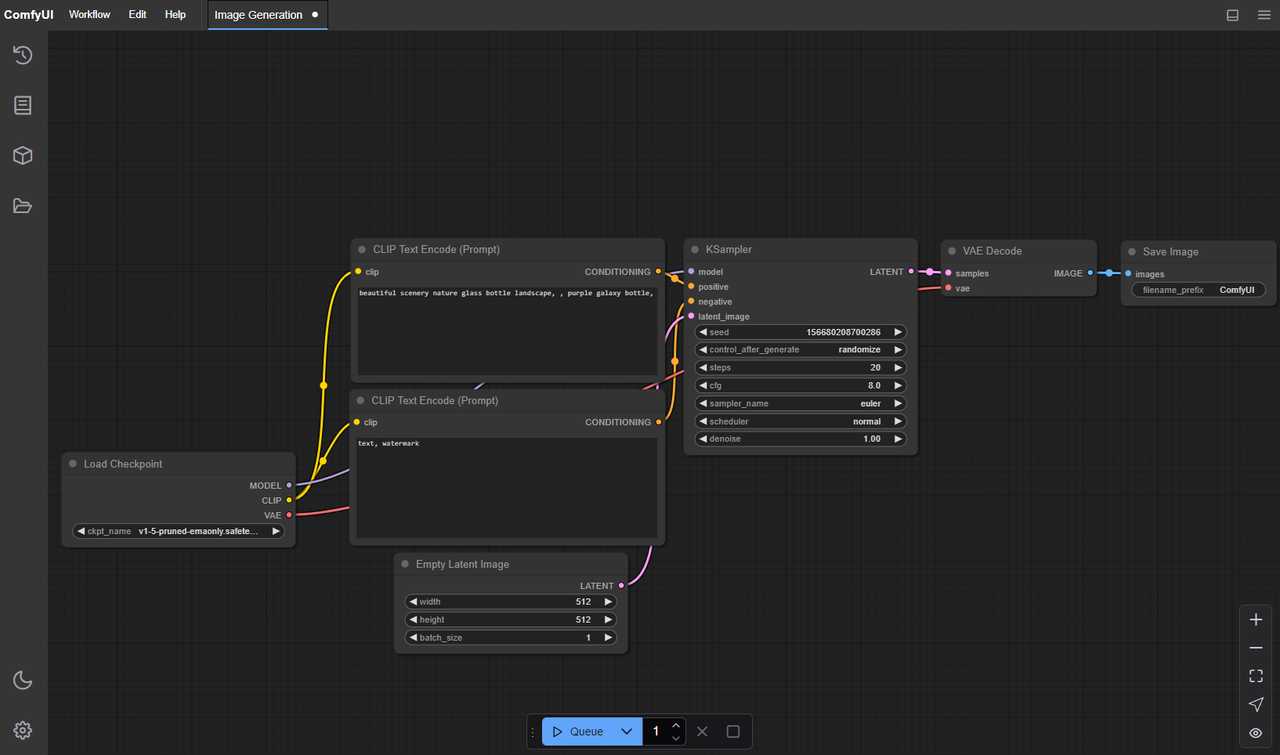

Struktur Folder ComfyUI untuk LTX-2 (Jalur Eksak)

Di sinilah saya tersandung di hari pertama: file saya baik-baik saja, tetapi ComfyUI tidak tahu ke mana harus mencari. Node kustom yang berbeda mengharapkan lokasi yang sedikit berbeda, tetapi default di bawah telah aman untuk saya.

Pada instal ComfyUI standar (tidak ada penggantian node kustom):

- Titik pemeriksaan model utama:

ComfyUI/models/checkpoints/LTX-2.safetensors - Encoder teks/gambar (CLIP atau serupa):

ComfyUI/models/clip/LTX-2-encoder.safetensors- Beberapa build menggunakan penamaan open_clip: letakkan juga di

models/clip/.

- Beberapa build menggunakan penamaan open_clip: letakkan juga di

- VAE (jika terpisah):

ComfyUI/models/vae/LTX-2-vae.safetensors - LoRA/patch (jika Anda menggunakannya):

ComfyUI/models/loras/

Jika Anda menggunakan node yang bergantung pada file TensorRT atau engine:

ComfyUI/models/trt/ltx-2/*.engineComfyUI/models/unet/ltx-2/*.engine

Dua kebiasaan membosankan tetapi berguna:

- Cocokkan nama file dengan tepat apa yang diharapkan node Anda. Saya menyimpan nama pendek dan menghapus spasi.

- Setelah memindahkan file, gunakan penyegaran model ComfyUI atau restart. Reload panas kadang bekerja: restart penuh lebih konsisten.

Jika Anda menggunakan disk eksternal atau folder model bersama, atur ComfyUI Extra Model Paths sehingga tidak diam-diam memindai drive yang salah. Sensitivitas kasus di Linux telah menggigit saya lebih dari sekali.

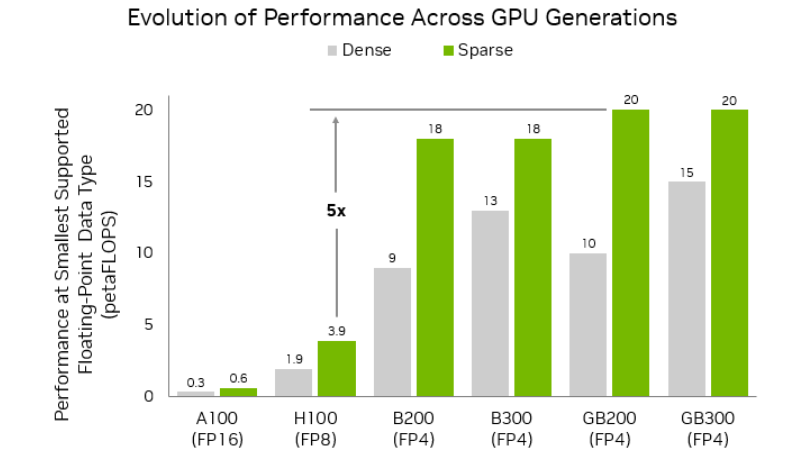

Bobot NVFP4 vs NVFP8: Mana yang Harus Diunduh

Saya penasaran apakah NVFP4 layak kompresi ekstra. Jawaban singkat: mungkin, jika Anda sempit di VRAM dan node Anda benar-benar mendukungnya.

Saya penasaran apakah NVFP4 layak kompresi ekstra. Jawaban singkat: mungkin, jika Anda sempit di VRAM dan node Anda benar-benar mendukungnya.

Inilah cara rasanya dalam praktik di kotak saya (GPU kelas Hopper, build Januari 2026):

NVFP8

- Keseimbangan: Titik tengah yang baik. Memperhatikan memori lebih rendah dari presisi penuh dengan penyimpangan output minimal.

- Kompatibilitas: Lebih baik. Lebih banyak node dan runtime menerima FP8 daripada FP4 sekarang.

- Kapan saya memilihnya: Lari sehari-hari di mana saya menginginkan stabilitas daripada jejak terkecil.

NVFP4

- Jejak: Lebih kecil. Ini memungkinkan saya meningkatkan resolusi atau konteks satu tingkat di mana FP8 tidak akan.

- Penyimpangan: Sedikit lebih banyak artefak atau kelembutan pada kasus tepi. Tidak selalu, tetapi cukup untuk saya perhatikan.

- Kompatibilitas: Lebih pilih-pilih. Beberapa loader kembali atau gagal jika mereka tidak mendeteksi kernel yang tepat.

- Kapan saya memilihnya: Draf cepat, pencarian grid, atau ketika alur kerja didukung ketat oleh jalur FP4 node.

Satu hal lagi: format ini biasanya mengasumsikan Anda berada di tumpukan NVIDIA yang dapat mempercepat mereka dengan tepat. Jika node Anda tidak secara eksplisit mengatakan “NVFP4/NVFP8 didukung,” saya default ke presisi penuh atau build .safetensors yang disaring. Mengejar keuntungan marginal tidak layak untuk kerusakan misterius pertengahan render.

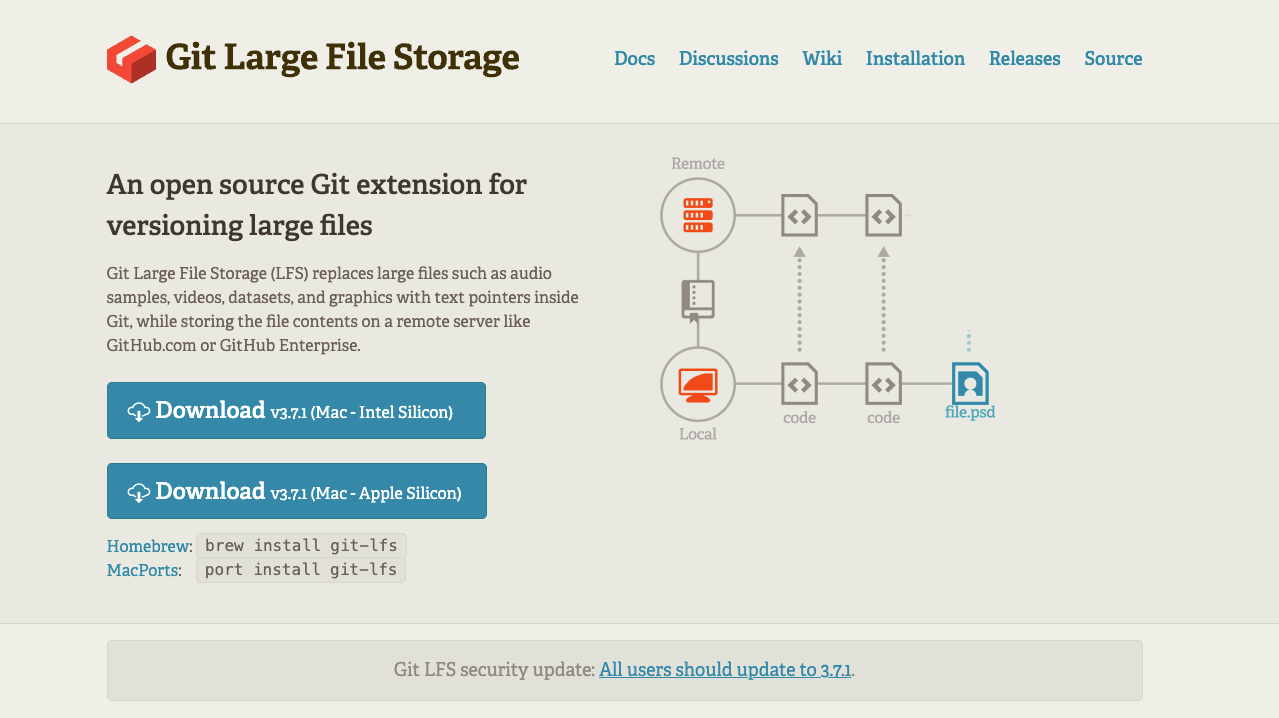

Tips Akselerasi Unduhan LTX-2 & Verifikasi Checksum

Saya memperlakukan pull model besar seperti pekerjaan file besar lainnya: percepat, lalu verifikasi.

Akselerasi yang benar-benar membantu:

- Akselerasi transfer Hugging Face: atur variabel env

HF_HUB_ENABLE_HF_TRANSFER=1sebelum menggunakanhuggingface_hub. Ini menyalakan backend mereka yang dipercepat di mana tersedia.

aria2c untuk chunk paralel:

aria2c -x 16 -s 16 -k 1M -cBendera -c melanjutkan unduhan parsial dengan bersih ketika koneksi saya tersandung di 97%.

git-lfs tarikan yang disetel

git lfs installlalugit clone.- Mengikuti panduan instalasi Git LFS, jika itu repo besar, saya kadang menggunakan sparse-checkout untuk menghindari menarik contoh yang tidak akan saya gunakan.

Verifikasi yang sebenarnya saya lakukan (dan jangan lewatkan lagi)

Bandingkan SHA256 dari kartu model (atau file .sha256 repo) terhadap file lokal Anda.

- macOS/Linux:

shasum -a 256 - Windows:

certutil -hashfile SHA256

Pemeriksaan akal ukuran file

- Jika ukuran yang diharapkan adalah 4,2 GB dan saya melihat 3,3 GB, saya berhenti di sana. File parsial kadang-kadang “memuat,” lalu melempar kesalahan sampah nanti.

Kebiasaan kecil yang menghemat waktu: saya menyimpan README.txt kecil di sebelah file model dengan URL asal, tanggal, dan hash. Ketika saya kunjungi kembali tiga bulan kemudian, saya tidak perlu merekayasa balik pilihan diri saya sendiri.

Perbaikan “Model Tidak Ditemukan”

Kesalahan ini memakan jam yang tidak akan saya dapatkan kembali. Berikut adalah perbaikan yang benar-benar menggerakkan jarum bagi saya:

- Folder yang salah: ComfyUI mengharapkan checkpoint di

models/checkpoints/, encoder dimodels/clip/, dan VAE dimodels/vae/. Letakkan mereka di tempat lain dan pemindai mungkin mengabaikan mereka. - Ketidakcocokan nama file: Beberapa node mencari nama dasar tertentu. Jika node mengatakan

ltx-2.safetensors, jangan memanggilLTX-2 (final).safetensors. Saya mengganti nama secara agresif. - Sensitivitas kasus:

ltx-2.safetensors≠LTX-2.safetensorsdi Linux. Tanya saya bagaimana saya tahu. - Pengindeksan cache: Refresh model atau restart ComfyUI setelah memindahkan file. Indeks tidak selalu real-time.

- Dependensi yang hilang: Jika node mengharapkan encoder eksternal dan Anda hanya mengunduh model utama, Anda akan mendapat kesalahan yang samar. Tarik encoder yang tercantum di kartu model dan coba lagi.

- Model yang dibatasi tanpa token: Jika Anda menggandakan tanpa login (atau token Anda kedaluwarsa), file lokal dapat berupa stub. Login ulang dengan

huggingface-cli logindan tarik ulang. - Node kustom dan jalur alternatif: Beberapa node mengganti folder default. Periksa README mereka untuk jalur yang diharapkan atau env var. Ketika ragu, letakkan tautan simbolik dari direktori model bersama Anda ke jalur lokal yang diharapkan.

Ketika saya terjebak, saya sementara mengarahkan node ke model kecil yang dikenal baik hanya untuk mengkonfirmasi loader berfungsi. Jika yang kecil dimuat, bug hidup dalam file LTX-2, bukan lingkungan saya.

Lewati Unduhan LTX-2 Menggunakan WaveSpeed

Saya mencoba rute berbeda di laptop perjalanan: lewati unduhan lokal sepenuhnya dan jalankan LTX-2 melalui WaveSpeed. Itu mengalirkan atau meng-host bobot dari jarak jauh sehingga Anda dapat menghubungkan grafik seperti ComfyUI tanpa memarkirkan 10+ GB di disk Anda.

Apa yang berhasil untuk saya:

Apa yang berhasil untuk saya:

- Onboarding ringan. Saya menunjuk grafik ke titik akhir LTX-2 mereka dan tidak menyentuh folder lokal.

- Cold start lebih lambat (run pertama memutar sesi), tetapi warm run terasa normal untuk batch kecil.

- Itu membuat kipas laptop saya dari melolong. Saja membuatnya berguna di jalan.

Trade-off yang saya perhatikan:

- Latensi: Ada overhead kecil, lebih jelas dengan banyak run pendek. Untuk render panjang, saya berhenti memperhatikan.

- Kontrol: Anda menyerah beberapa pin versi. Mereka menyimpan model ditambal, yang bagus, sampai Anda ingin mereproduksi hasil yang lebih tua.

- Biaya/kuota: Itu bukan “gratis seperti unduhan.” Jika Anda pada anggaran ketat atau memerlukan pekerjaan batch berat, lokal masih menang.

- Privasi: Saya menyimpan prompt sensitif dan aset secara lokal. Untuk pekerjaan publik atau uji coba, saya baik-baik saja.

Siapa yang mungkin menyukai ini: orang-orang menguji LTX-2 di mesin yang kurang bertenaga, atau siapa pun yang ingin mengira alur kerja sebelum berkomitmen pada setup lokal penuh. Jika Anda kaya VRAM dan peduli dengan reproduktibilitas yang tepat, install lokal masih terasa lebih baik.

Saya tidak mengharapkan untuk menyukainya, tetapi untuk eksperimen cepat, melewati unduhan adalah bantuan kecil.